Clear Sky Science · it

Un dataset di domande di scienze per la scuola primaria in cinese per la generazione del processo di risoluzione dei problemi

Aiutare i bambini a imparare le scienze con un'IA più intelligente

Genitori e insegnanti vedono sempre più l'intelligenza artificiale come un potenziale compagno di studio, ma gli attuali chatbot spesso forniscono spiegazioni o troppo superficiali o troppo avanzate per i bambini. Questo articolo presenta un nuovo dataset di Domande di Scienze per la Scuola Primaria in cinese (CSQ) progettato per insegnare ai grandi modelli linguistici come spiegare la scienza come farebbe un buon insegnante di elementari: passo dopo passo, con la difficoltà adeguata e strettamente allineato a ciò che i bambini effettivamente apprendono in classe.

Un nuovo archivio di domande per i giovani studenti di scienze

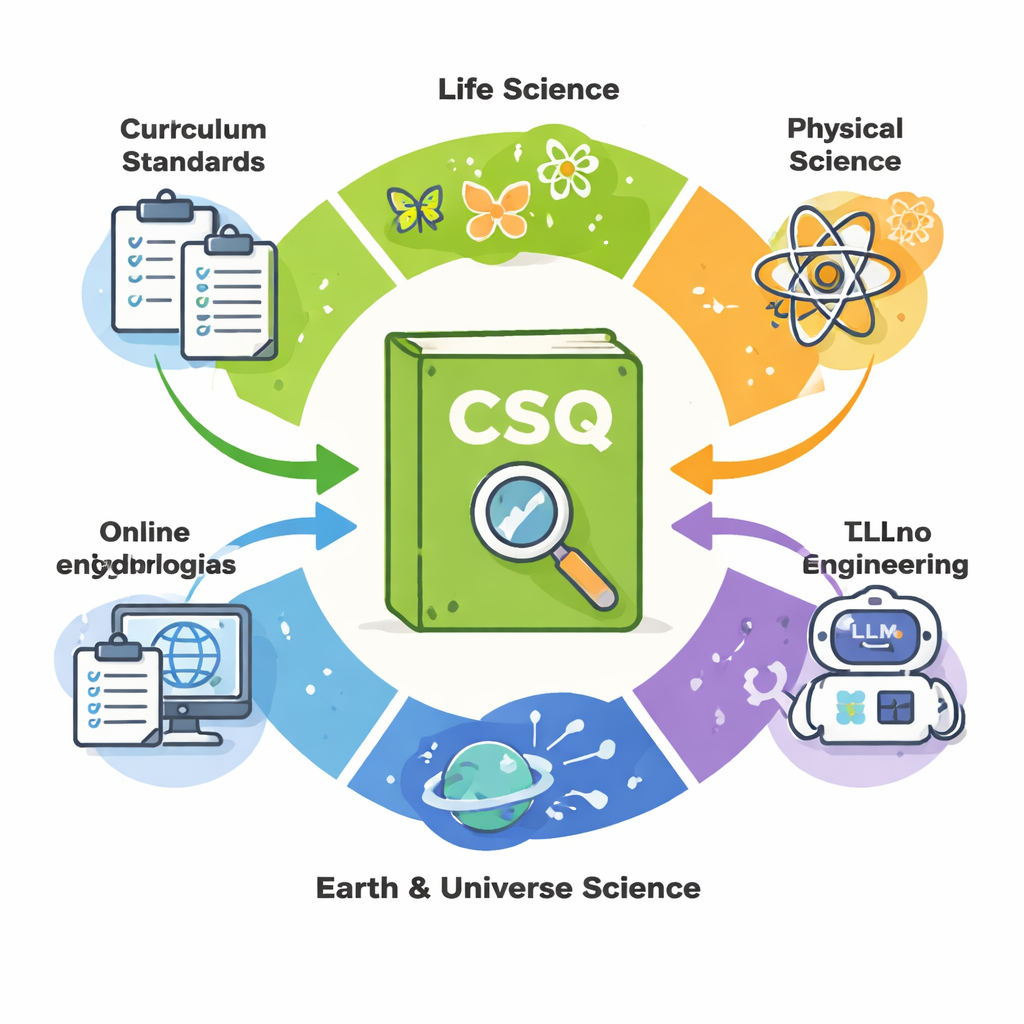

Il dataset CSQ è una raccolta di 12.000 domande di scienze accuratamente elaborate, tratte dal curriculum della scuola primaria cinese, da prove d'esame scolastiche e da risorse online affidabili. Le domande coprono quattro ampie aree—scienze della vita, scienze fisiche, terra e spazio, e tecnologia e ingegneria—per i gradi dalla prima alla sesta classe. A differenza di molti archivi esistenti che riportano solo la domanda e la risposta corretta, ogni elemento CSQ include anche informazioni sul livello di classe, sull'argomento e sulle competenze scientifiche testate, oltre a una spiegazione completa e adatta all'età della soluzione.

Catturare il modo in cui i bambini pensano realmente

Un'innovazione chiave del CSQ è l'attenzione al «pensiero risolutivo» dietro ogni risposta. Per ogni domanda, gli esperti esplicitano il processo di ragionamento in un linguaggio e con un livello di dettaglio adeguati alla classe di riferimento. Per i bambini più piccoli, le spiegazioni rimangono concrete e osservazionali—per esempio descrivendo ciò che si può vedere o percepire. Per gli studenti più grandi, vengono introdotte gradualmente idee più astratte, come i sistemi, le relazioni di causa ed effetto o modelli semplici. Ogni elemento contrassegna anche le competenze chiave coinvolte, come osservare un fenomeno, confrontare due oggetti o identificare la funzione di uno strumento. Questa struttura permette ai modelli di IA non solo di fornire la risposta corretta, ma di esercitarsi a guidare attraverso il tipo di pensiero che gli studenti sono chiamati a sviluppare.

Costruire il dataset con realismo da aula

La creazione di CSQ ha richiesto un processo strutturato e centrato sull'umano. Un team di 19 ricercatori con esperienza in educazione scientifica e IA ha suddiviso il lavoro in fasi. I membri senior del team hanno raccolto domande dagli standard curricolari ufficiali, da prove d'esame e da enciclopedie, assicurandosi che fossero riutilizzabili legalmente. Studentə di laurea hanno poi adattato e annotato le domande in modo che si adattassero a formati a scelta multipla o vero/falso e corrispondessero agli Standard del Curriculum di Scienze per l'Istruzione Obbligatoria (2022). La loro formazione ha enfatizzato il rispetto del vocabolario e della profondità cognitiva adeguati al grado. Ogni elemento di dato—domanda, proprietà disciplinari e soluzione—è stato verificato da un altro annotatore, e i disaccordi sulle competenze corrette o sulla profondità della spiegazione sono stati risolti utilizzando gli standard nazionali come guida.

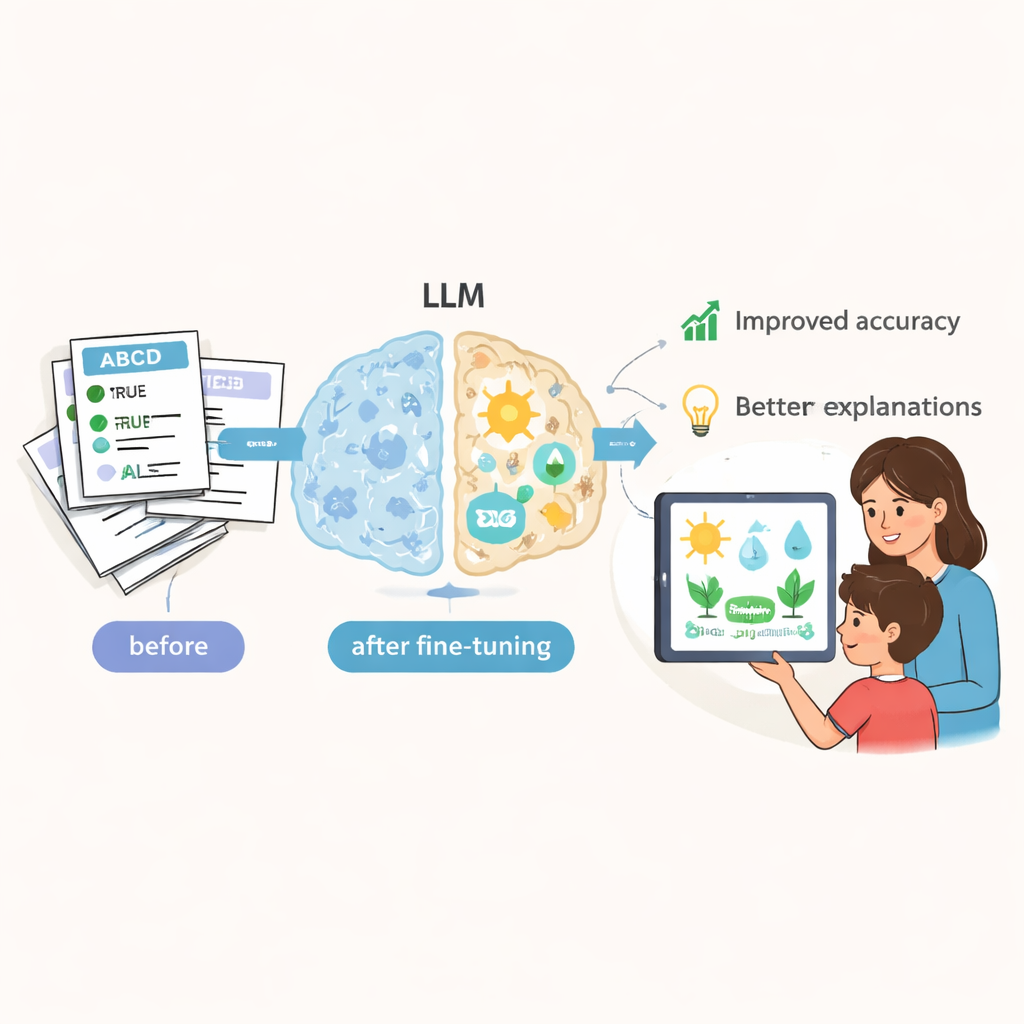

Insegnare all'IA a mostrare i propri passaggi

Per valutare il valore di CSQ, i ricercatori hanno effettuato il fine-tuning di diversi modelli linguistici open source, oltre a valutare un modello commerciale di punta, su questo dataset. Non si sono limitati a misurare se i modelli sceglievano la risposta corretta a scelta multipla. Hanno anche valutato la qualità del ragionamento generato usando sia metriche testuali automatiche sia valutazioni di esperti umani. Dopo l'addestramento su CSQ, i modelli open source hanno mostrato evidenti miglioramenti in accuratezza e nella chiarezza e completezza delle loro spiegazioni. Per esempio, un modello che in precedenza rispondeva a una domanda elementare sul suono usando la teoria avanzata delle onde si è orientato verso una descrizione più semplice e adatta all'età dopo il fine-tuning. I giudici umani hanno rilevato che i modelli perfezionati erano molto migliori nel mantenersi nel livello di classe del bambino, evitando il «sovraccarico di conoscenza» in cui idee eccessivamente tecniche confondono invece di aiutare.

Limiti attuali, un modello per il futuro

Gli autori riconoscono che CSQ riflette la struttura del curriculum di scienze cinese e si concentra solo su formati di domanda come scelta multipla e vero/falso, non su esperimenti pratici o progetti a risposta aperta. Le spiegazioni sono state redatte da studenti di laurea formati, non da insegnanti di classe o dagli stessi bambini, quindi c'è ancora lavoro da fare per corrispondere pienamente al linguaggio reale dell'aula. Nonostante ciò, il quadro alla base di CSQ—collegare ogni domanda a materia, argomento, grado, competenze specifiche e ragionamento passo dopo passo—è sufficientemente generale da poter ispirare risorse simili per altre lingue e sistemi scolastici. In termini semplici, questo lavoro mostra come set di domande progettati con cura possano aiutare l'IA a diventare un tutor di scienze più affidabile e sensibile all'età per i giovani studenti.

Citazione: Li, D., Liu, Z., Wen, C. et al. A Chinese Elementary Science Question Dataset in Problem-Solving Process Generation. Sci Data 13, 291 (2026). https://doi.org/10.1038/s41597-026-06618-4

Parole chiave: educazione scientifica primaria, grandi modelli linguistici, dataset di domande e risposte, tutoraggio personalizzato, curriculum cinese