Clear Sky Science · it

RAID-Dataset: risposte umane a distorsioni affini delle immagini e rumore gaussiano

Perché piccoli cambiamenti nelle immagini contano per i tuoi occhi

Ogni giorno i tuoi occhi affrontano senza sforzo foto inclinate, zoomate, spostate o leggermente granulose—pensa a quando scatti un soggetto in movimento con il telefono o scorri immagini lievemente sfocate sui social. Ma in che modo le persone avvertono esattamente questi cambiamenti, e si possono istruire i computer a giudicare la qualità di un’immagine come facciamo noi? Questo articolo presenta un nuovo dataset, chiamato RAID, che misura con cura come gli osservatori umani reagiscono a distorsioni d’immagine semplici ma comuni, fornendo un ponte tra l’esperienza visiva quotidiana e gli algoritmi che alimentano fotocamere, servizi di streaming e intelligenza artificiale.

Modifiche comuni alle immagini messe alla prova

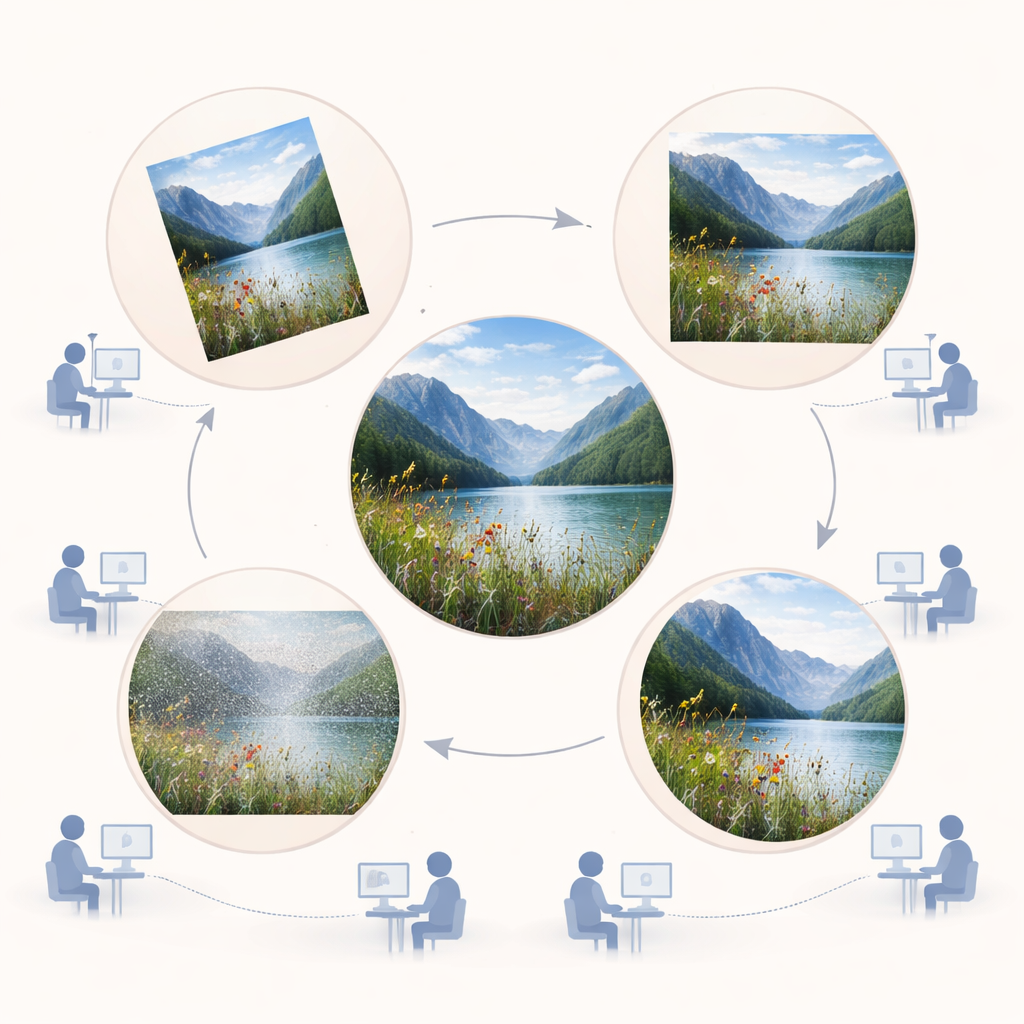

I ricercatori si sono concentrati su quattro cambiamenti molto elementari che avvengono continuamente sia nel mondo reale sia nelle immagini digitali: rotazione (inclinare un’immagine), traslazione (scivolarla lateralmente), scala (zoomare dentro o fuori) e aggiunta di grana nota come rumore gaussiano. Diversamente da molti database di qualità d’immagine esistenti che enfatizzano artefatti di compressione o glitch digitali, queste trasformazioni imitano ciò che succede quando muovi la testa, sposti lo sguardo, o quando gli oggetti si muovono e cambia l’illuminazione. Usando 24 fotografie a colori naturali da una nota raccolta Kodak, il team ha creato nove livelli crescenti di ciascuna distorsione, più l’originale, per un totale di 888 immagini.

Come le persone hanno confrontato le differenze tra immagini

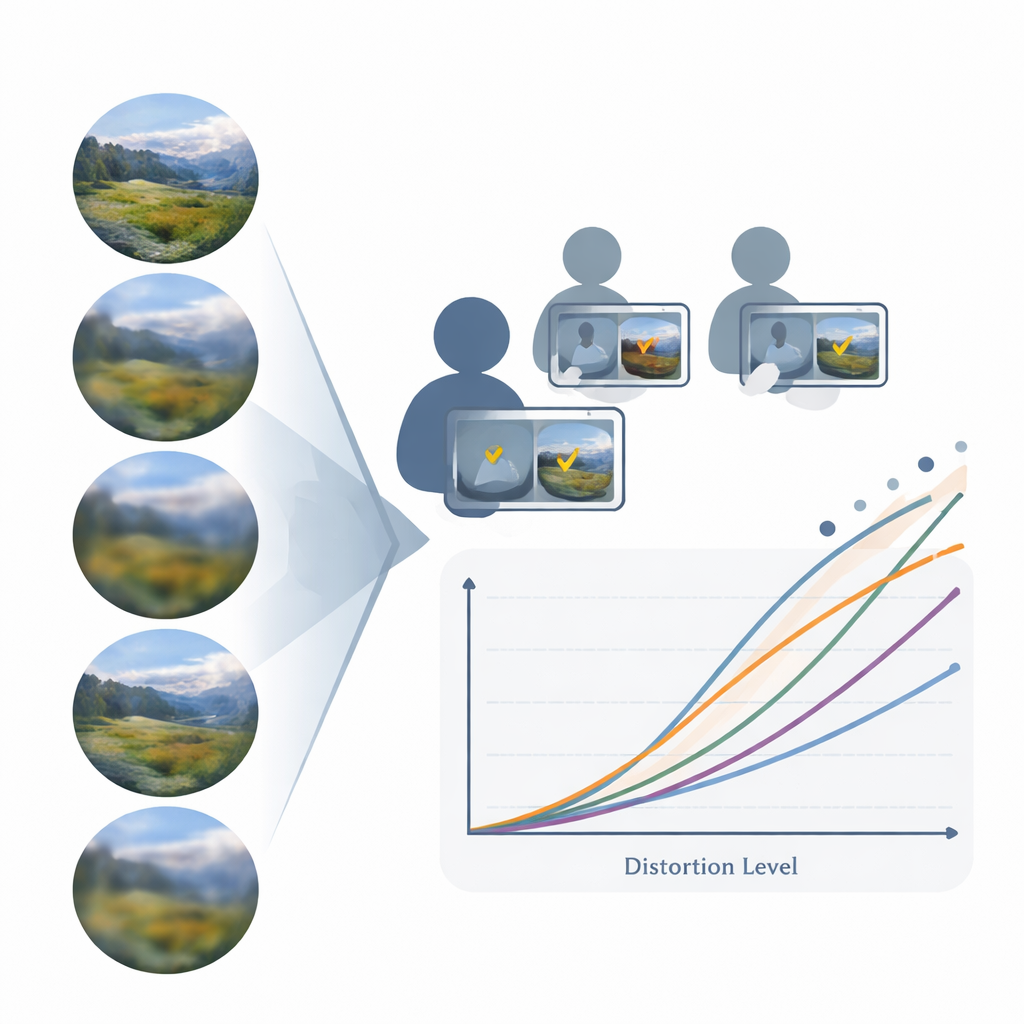

Per scoprire quanto siano davvero percettibili questi cambiamenti, 210 volontari sono venuti in laboratorio controllato, si sono seduti davanti a monitor calibrati e hanno partecipato a oltre 40.000 prove. In ogni prova hanno visto due coppie di immagini sullo schermo e dovevano rispondere a una domanda semplice: quale coppia appare più diversa tra loro, quella a sinistra o quella a destra? Questo metodo, noto nella scienza della visione come Maximum Likelihood Difference Scaling, ha permesso ai ricercatori di trasformare molte di queste scelte in una “scala percettiva” continua per ogni distorsione. Ogni punto su una scala indica quanto forte appare un dato livello di distorsione per l’osservatore medio, da appena visibile a chiaramente evidente.

Cronometrare quanto velocemente reagisce il cervello

Mentre le persone effettuavano le loro scelte, l’esperimento ha registrato anche quanto tempo impiegavano a rispondere. Questi tempi di reazione hanno rivelato un andamento classico osservato in altri ambiti della percezione: quando la differenza tra le immagini era molto piccola o estremamente grande, i partecipanti rispondevano relativamente in fretta, mentre a difficoltà intermedie rallentavano. Con l’aumentare della forza delle distorsioni, il sistema visivo impiegava meno tempo a decidere quale coppia differisse di più. Questo comportamento corrisponde a una regola ben nota in psicologia, la legge di Piéron, che collega segnali sensoriali più forti a risposte più rapide e supporta l’idea che il dataset stia catturando proprietà genuine della visione umana piuttosto che rumore casuale nelle decisioni delle persone.

Confronto con i punteggi di qualità esistenti

Per rendere i nuovi dati utili a ingegneri e scienziati che già si affidano a benchmark consolidati di qualità d’immagine, gli autori hanno confrontato le loro misure per le immagini rumorose con i punteggi di un database popolare chiamato TID2013, dove le persone valutavano la qualità delle immagini su una tipica scala di “opinion score”. Hanno trovato una relazione forte, quasi lineare: le distorsioni che gli osservatori RAID giudicavano più evidenti tendevano a ricevere punteggi di qualità più bassi in TID2013. Questo legame ha permesso al team di derivare una formula semplice per convertire i valori della loro scala percettiva nei punteggi di opinione standard, rendendo facile combinare RAID con dataset più vecchi e inserirlo nelle pipeline di valutazione esistenti.

Perché questo è importante per la visione e l’IA

Oltre a confermare lavori precedenti, il nuovo dataset mette in luce casi in cui le sue misure accurate superano i tradizionali punteggi di opinione. Cercando intenzionalmente coppie di immagini in cui un metodo afferma che le distorsioni sono simili mentre l’altro le considera molto diverse, e poi chiedendo alle persone chi ha ragione, gli autori dimostrano che il loro approccio tende ad allinearsi meglio con ciò che gli spettatori effettivamente vedono. Il dataset rivela anche pattern intuitivi: una leggera inclinazione è molto più evidente in un paesaggio marino con un orizzonte marcato che in una scena affollata piena di forme inclinate, e il rumore risalta di più su cieli uniformi che su texture dettagliate. Nel complesso, questi risultati significano che RAID offre una descrizione più ricca e centrata sull’umano di come notiamo i cambiamenti quotidiani nelle immagini, fornendo un terreno di prova solido per migliorare sia i modelli della visione umana sia i sistemi di IA che mirano a vedere il mondo come lo vediamo noi.

Citazione: Daudén-Oliver, P., Agost-Beltran, D., Sansano-Sansano, E. et al. RAID-Dataset: human responses to affine image distortions and Gaussian noise. Sci Data 13, 256 (2026). https://doi.org/10.1038/s41597-026-06581-0

Parole chiave: qualità dell'immagine, visione umana, percezione visiva, distorsioni dell'immagine, fisica della percezione