Clear Sky Science · it

Dataset linguistico Kymata Soto: un dataset elettro‑magnetoencefalografico per l’elaborazione del linguaggio naturale

Ascoltare come il cervello percepisce le conversazioni reali

La maggior parte di ciò che diciamo e ascoltiamo ogni giorno sono conversazioni informali, non singole parole o frasi lette con attenzione. Eppure gran parte della ricerca sul linguaggio ha fatto affidamento su compiti artificiali. Il Dataset linguistico Kymata Soto cambia questo approccio fornendo una ricca raccolta aperta di registrazioni cerebrali di persone che semplicemente ascoltano vivaci discussioni radiofoniche in inglese e in russo, offrendo agli scienziati una nuova finestra potente su come i nostri cervelli elaborano il parlato naturale.

Una nuova biblioteca di risposte cerebrali al parlato reale

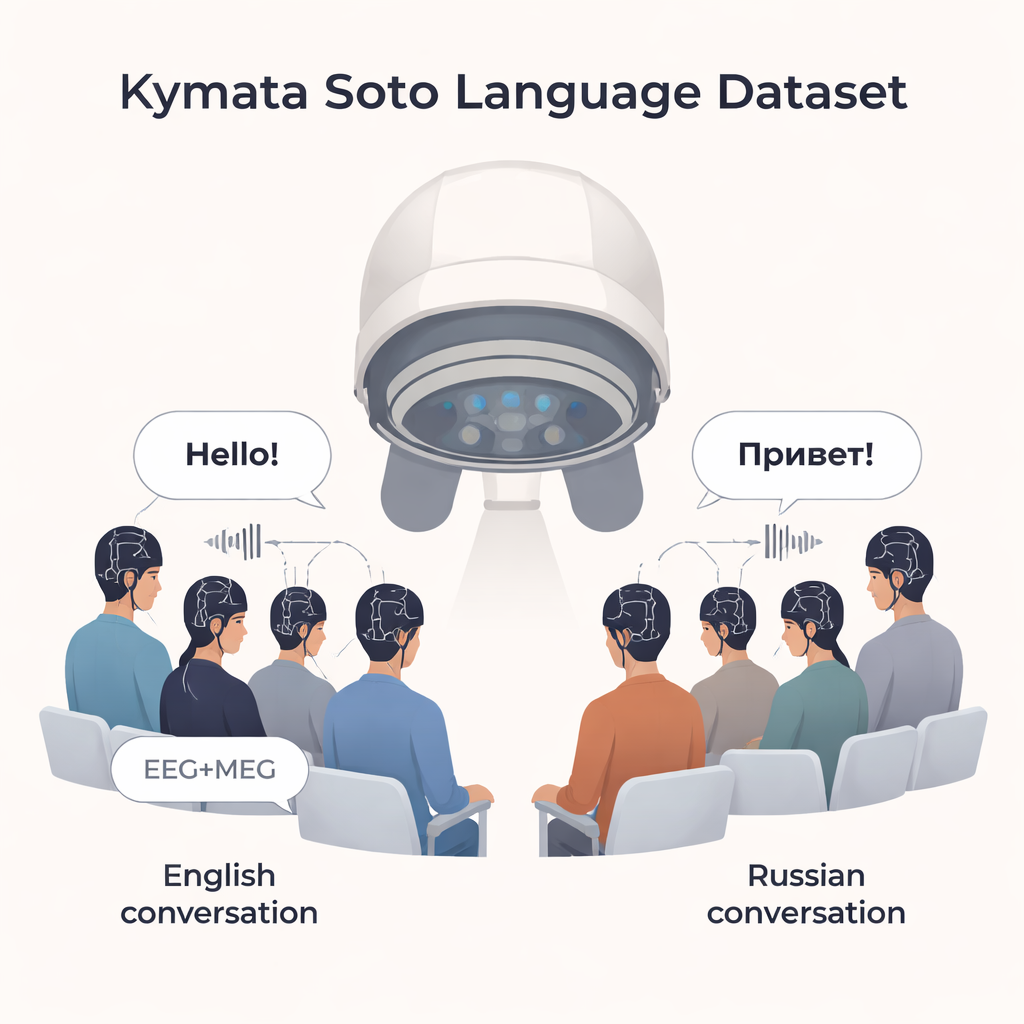

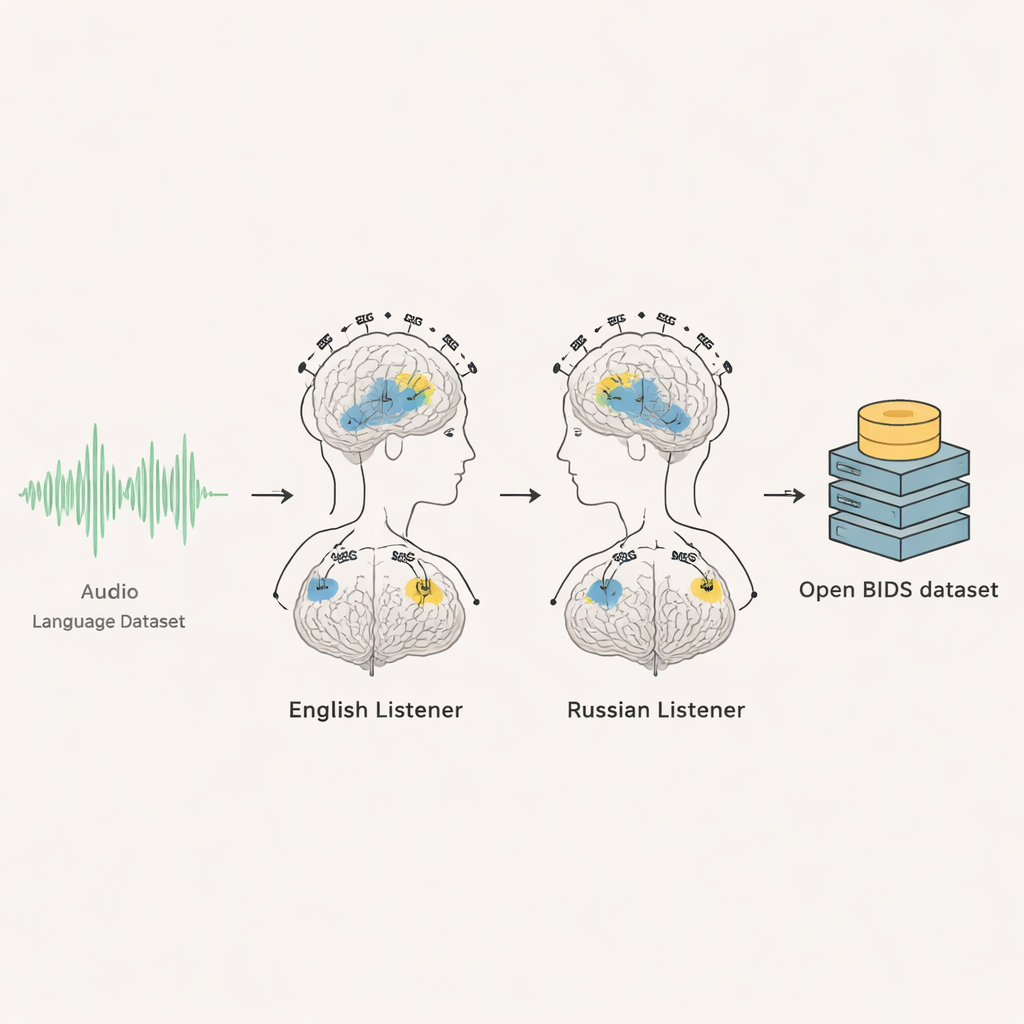

Questo progetto mette insieme due metodi avanzati di registrazione cerebrale—elettroencefalografia (EEG) e magnetoencefalografia (MEG)—per 35 adulti: 20 madrelingua inglese e 15 madrelingua russa. Mentre stavano seduti in silenzio e ascoltavano circa sei minuti e mezzo di conversazione in stile radiofonico nella loro lingua, l’attività cerebrale è stata registrata mille volte al secondo. Ogni persona ha ascoltato lo stesso audio più volte, permettendo ai ricercatori di mediare tra le ripetizioni e isolare le risposte cerebrali affidabili dal rumore di fondo. Il risultato è un registro dettagliato e sincronizzato nel tempo di come il cervello reagisce, momento dopo momento, mentre le persone seguono una discussione in corso.

Conversazioni su gelato e caffè

Invece di usare racconti classici o frasi artificiali, il team ha scelto argomenti coinvolgenti ma quotidiani: la storia del gelato per gli ascoltatori inglesi e la storia del caffè colombiano per gli ascoltatori russi. Entrambe le registrazioni provengono da discussioni in studio della BBC con tre parlanti (due uomini e una donna). Le conversazioni sono state editate a circa 400 secondi e presentate a livelli di ascolto confortevoli attraverso auricolari. Dopo ogni ripetizione, i partecipanti hanno risposto a una o due semplici domande a scelta multipla sul contenuto—quanto basta per assicurarsi che rimanessero attenti e seguissero la storia, non per testarli in modo rigoroso.

Tenersi occupati con gli occhi, ma mantenere la mente sul suono

Mentre i partecipanti ascoltavano, fissavano una croce centrale su uno schermo. Intorno ad essa, nuvole di punti colorati si muovevano e cambiavano in modo apparentemente casuale. Questi punti in movimento avevano due scopi: aiutare a mantenere stabile lo sguardo dei partecipanti, migliorando la qualità dei dati, e creare pattern visivi controllati di moto e colore che altri ricercatori possono analizzare successivamente. È importante che i punti non fossero sincronizzati con il contenuto del parlato, quindi non "illustravano" la storia né aggiungevano significato, ma fornivano uno sfondo visivo coerente che può essere studiato insieme ai suoni.

Dai segnali cerebrali grezzi ai dati pronti all’uso

I ricercatori hanno documentato con cura ogni parte dell’esperimento e hanno organizzato il dataset usando uno standard internazionale per i dati cerebrali chiamato BIDS. Per ogni volontario sono disponibili registrazioni EEG e MEG grezze, marcatori temporali per l’inizio dell’audio, eventi visivi secondo secondo e segmenti di pratica. Il team fornisce anche i file audio originali, trascrizioni complete e tempi precisi per l’inizio di ogni parola e persino di ogni singolo suono del parlato. Sono inclusi script in modo che altri possano riprodurre automaticamente gli stessi estratti audio utilizzati. Per il gruppo inglese sono condivise scansioni MRI cerebrali anonimizzate in modo che le risposte cerebrali possano essere mappate sull’anatomia cerebrale individuale; per il gruppo russo, il consenso non ha permesso la condivisione delle immagini MRI, pertanto si consiglia agli utenti di fare affidamento su modelli cerebrali medi standard.

Verificare che i segnali abbiano senso

Per assicurarsi che i dati fossero scientificamente affidabili, gli autori hanno condotto analisi di validazione incentrate su come il cervello segue le variazioni di intensità sonora nel tempo. Hanno trasformato l’audio in diverse descrizioni matematiche della "loudness variabile nel tempo" e poi hanno esaminato dove e quando le risposte cerebrali si allineavano con quei pattern di intensità. Per gli ascoltatori sia inglesi sia russi, il cervello ha mostrato pattern temporali simili, coerenti con quanto riportato in lavori precedenti. Questo accordo tra le lingue e con studi passati è un forte segnale che le registrazioni sono pulite, affidabili e pronte per essere sfruttate da altri.

Perché è importante per la ricerca futura su cervello e linguaggio

Per i non specialisti, la conclusione principale è che questo dataset è una nuova risorsa comune che permette a molti team di ricerca diversi di studiare come il parlato reale e spontaneo venga elaborato nel cervello. Poiché è aperto, ben annotato e registrato in due lingue diverse, può supportare progetti che vanno da domande fondamentali su come comprendiamo una conversazione, a confronti tra lingue, fino a sforzi ambiziosi per decodificare il parlato direttamente dall’attività cerebrale. In breve, il Dataset linguistico Kymata Soto è meno finalizzato a rispondere a una singola domanda e più orientato a offrire alla comunità scientifica una base condivisa e di alta qualità per esplorare come i nostri cervelli danno senso alle conversazioni che riempiono la nostra vita quotidiana.

Citazione: Yang, C., Parish, O., Klimovich-Gray, A. et al. Kymata Soto Language Dataset: an electro-magnetoencephalographic dataset for natural speech processing. Sci Data 13, 254 (2026). https://doi.org/10.1038/s41597-026-06579-8

Parole chiave: cervello e linguaggio, percezione del parlato, EEG MEG, conversazione naturalistica, dati di neuroimmagine aperti