Clear Sky Science · it

Sintetizzare la letteratura scientifica con modelli linguistici aumentati dalla ricerca

Perché restare aggiornati con la scienza è così difficile

Ogni anno milioni di nuovi articoli scientifici compaiono online. Nessun ricercatore umano può leggerli tutti; eppure trattamenti medici importanti, intuizioni sul clima e scoperte tecnologiche potrebbero essere nascosti in questa ondata di informazioni. Questo articolo esplora se sistemi avanzati di IA possono aiutare gli scienziati a cercare in quell’oceano di studi e a trasformarli in riassunti chiari e affidabili—senza inventare fatti.

Un nuovo tipo di assistente per la ricerca

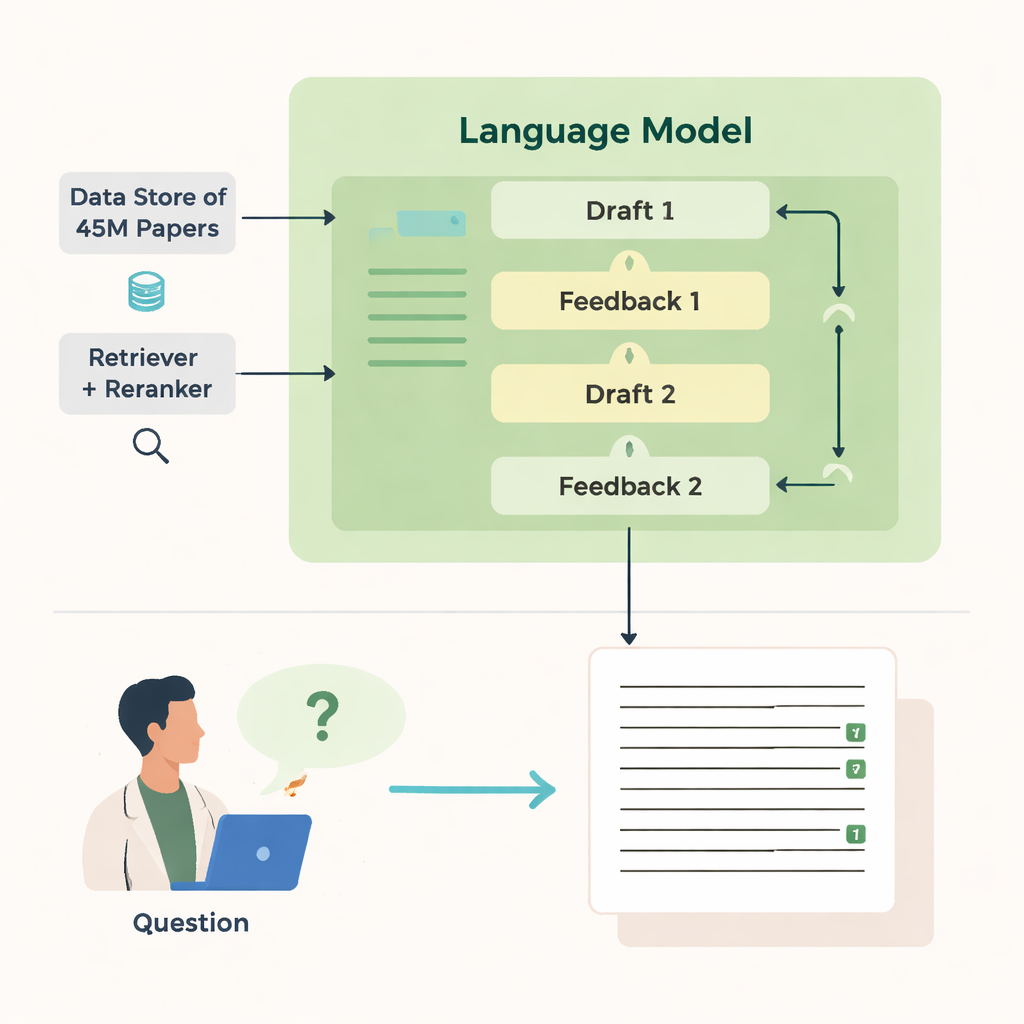

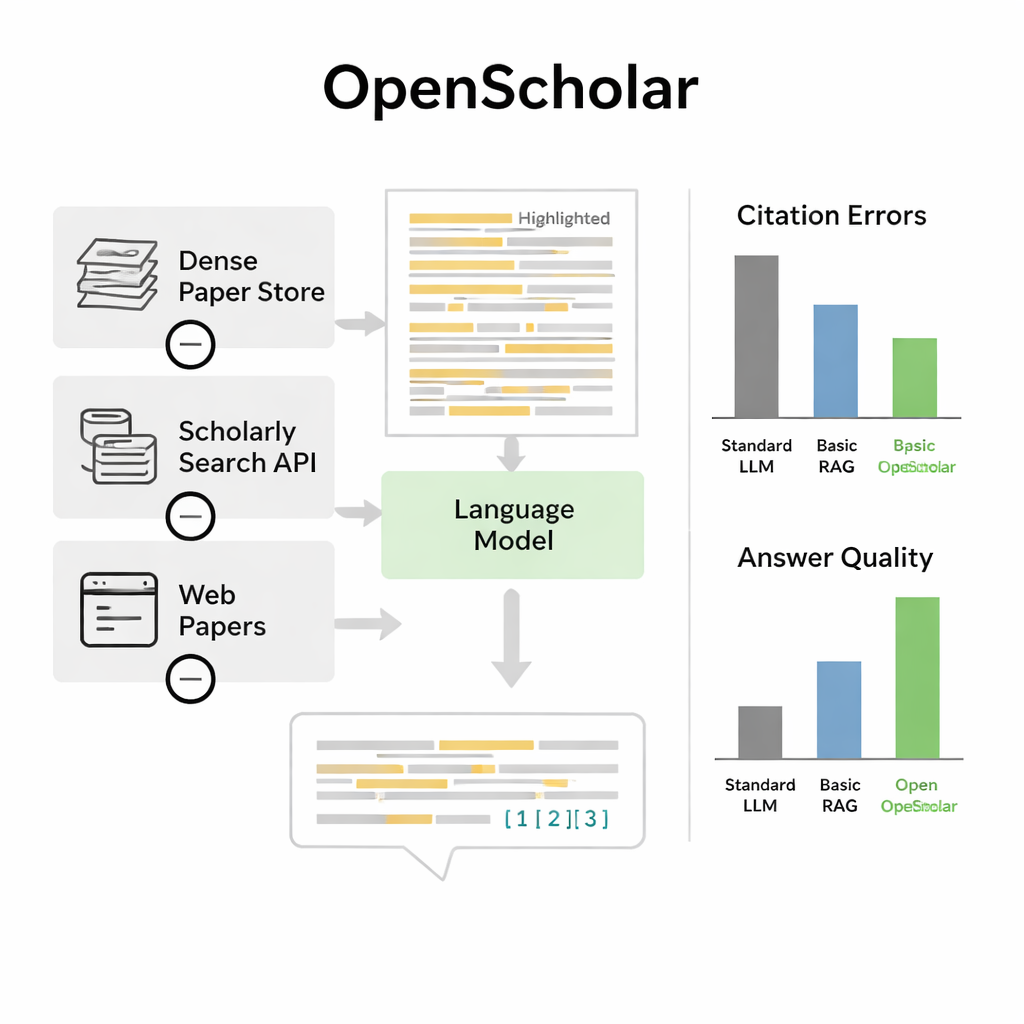

Gli autori presentano OpenScholar, un sistema di intelligenza artificiale costruito appositamente per leggere e sintetizzare la letteratura scientifica. Diversamente dai chatbot generici, OpenScholar è strettamente collegato a un enorme database aperto di circa 45 milioni di articoli di ricerca, chiamato OpenScholar DataStore. Quando uno scienziato pone una domanda—per esempio come raffreddare nanoparticelle levitate o quali metodi funzionano meglio per l’imaging cerebrale—il sistema prima cerca in questo database passaggi rilevanti, poi redige una risposta con citazioni inline, simile a un articolo di recensione scritto da un umano. Ripete questo processo più volte, criticando e perfezionando le proprie bozze per migliorare chiarezza, completezza e qualità delle citazioni.

Come cerca e scrive

La forza di OpenScholar deriva da più componenti coordinate. Un modulo “retriever” scansiona embedding di testo pre-calcolati da milioni di articoli per trovare estratti promettenti, mentre un “reranker” riorganizza questi estratti per concentrarsi sui più pertinenti. Il modello linguistico usa poi queste evidenze per produrre una risposta estesa con riferimenti numerati. Dopo la prima bozza, il modello genera feedback per se stesso—evidenziando prospettive mancanti, struttura debole o evidenze scarse—e, quando necessario, avvia ricerche più mirate. Quindi riscrive la risposta, integrando nuovi articoli e aggiustando le citazioni. Un controllo finale assicura che le affermazioni che richiedono supporto siano sostenute da almeno una fonte recuperata.

Mettere alla prova affermazioni e citazioni

Per verificare se OpenScholar sia davvero utile, gli autori hanno creato ScholarQABench, un ampio benchmark progettato per imitare domande tipiche da revisione della letteratura. Include quasi 3.000 domande redatte da esperti e centinaia di risposte lunghe in informatica, fisica, neuroscienze e biomedicina. È importante notare che queste domande di solito richiedono la lettura di diversi articoli, non solo di un abstract. Il team ha valutato i sistemi su più assi: correttezza fattuale, quanto bene le risposte coprivano i punti chiave, chiarezza espositiva e quanto le citazioni riflettessero accuratamente gli articoli sottostanti. Hanno combinato controlli automatici con valutazioni dettagliate da parte di esperti con dottorato che hanno confrontato risposte generate dall’IA con quelle scritte dagli umani.

Battere chatbot potenti e avvicinarsi agli esperti

Su questo benchmark, OpenScholar ha superato sia i modelli linguistici standard sia strumenti precedenti che aggiungevano semplicemente il retrieval a un chatbot generico. Una versione compatta da otto miliardi di parametri, addestrata interamente su dati aperti, ha ottenuto risultati migliori in un compito esigente di sintesi multi-articolo rispetto a GPT-4o e a un sistema concorrente chiamato PaperQA2, nonostante questi ultimi facessero affidamento su modelli proprietari più grandi. Una scoperta notevole è stata la frequenza con cui i chatbot comuni inventavano riferimenti: nel 78–90% dei casi, le loro liste di citazioni includevano articoli che non esistevano o non supportavano le affermazioni. Per contro, l’accuratezza delle citazioni di OpenScholar si è avvicinata a quella degli esperti umani. Quando gli esperti hanno confrontato le risposte direttamente, hanno preferito OpenScholar-8B alle risposte scritte da esperti circa la metà delle volte, e una pipeline OpenScholar basata su GPT-4o circa il 70% delle volte, in gran parte perché l’IA copriva più studi rilevanti e li organizzava in modo chiaro.

Limiti e miglioramenti futuri

Nonostante questi progressi, gli autori sottolineano che OpenScholar non sostituisce gli scienziati. Il sistema può ancora tralasciare gli articoli più rappresentativi, sovraenfatizzare lavori meno importanti o introdurre affermazioni errate, specialmente nei modelli più compatti. Anche il benchmark ha limiti: si concentra principalmente su informatica, biomedicina e fisica, e le domande accuratamente annotate sono ancora relativamente poche perché il tempo degli esperti è costoso. Le valutazioni faticano inoltre a cogliere pienamente qualità più sottili, come se le citazioni mettano in evidenza lavori davvero seminali o se una risposta guiderebbe effettivamente un nuovo esperimento.

Cosa significa per la scienza di tutti i giorni

Per i non specialisti, la conclusione principale è che strumenti di IA progettati con cura possono già aiutare gli scienziati a orientarsi nella letteratura in modo più efficace, a condizione che siano collegati a dati reali e soggetti a rigorosi standard di evidenza e trasparenza. OpenScholar dimostra che quando un sistema IA è costruito dal basso per recuperare, verificare e citare articoli reali—e quando le sue prestazioni sono testate rispetto a esperti umani—può produrre sintesi della letteratura non solo leggibili ma anche verificabili. In pratica, questi strumenti potrebbero liberare i ricercatori per concentrarsi maggiormente sulla progettazione di esperimenti e sull’interpretazione dei risultati, mantenendo tuttavia gli esseri umani saldamente responsabili del giudizio su ciò che è vero e importante.

Citazione: Asai, A., He, J., Shao, R. et al. Synthesizing scientific literature with retrieval-augmented language models. Nature 650, 857–863 (2026). https://doi.org/10.1038/s41586-025-10072-4

Parole chiave: revisione della letteratura scientifica, modelli linguistici aumentati dalla ricerca, OpenScholar, accuratezza delle citazioni, strumenti di ricerca basati sull'IA