Clear Sky Science · it

Superare i limiti della fattorizzazione dimensionale nei modelli di diffusione discreta tramite l’apprendimento della distribuzione congiunta quantistica

Perché questa nuova svolta tra IA e quantistico conta

I sistemi di IA moderni sono notevolmente abili nel generare testo, immagini e altri dati, ma restano in difficoltà quando molte parti dei dati sono fortemente interconnesse. Questo articolo mostra che una classe importante di modelli generativi, chiamata modelli di diffusione discreta, presenta un limite intrinseco: man mano che i dati diventano a dimensione maggiore e più correlati, i loro errori possono crescere rapidamente. Gli autori propongono un nuovo approccio che sfrutta computer quantistici per apprendere queste relazioni complesse in modo più fedele, potenzialmente offrendo modelli generativi più veloci e più flessibili rispetto alle tecniche classiche odierne.

Quando scomporre significa perdere ciò che conta

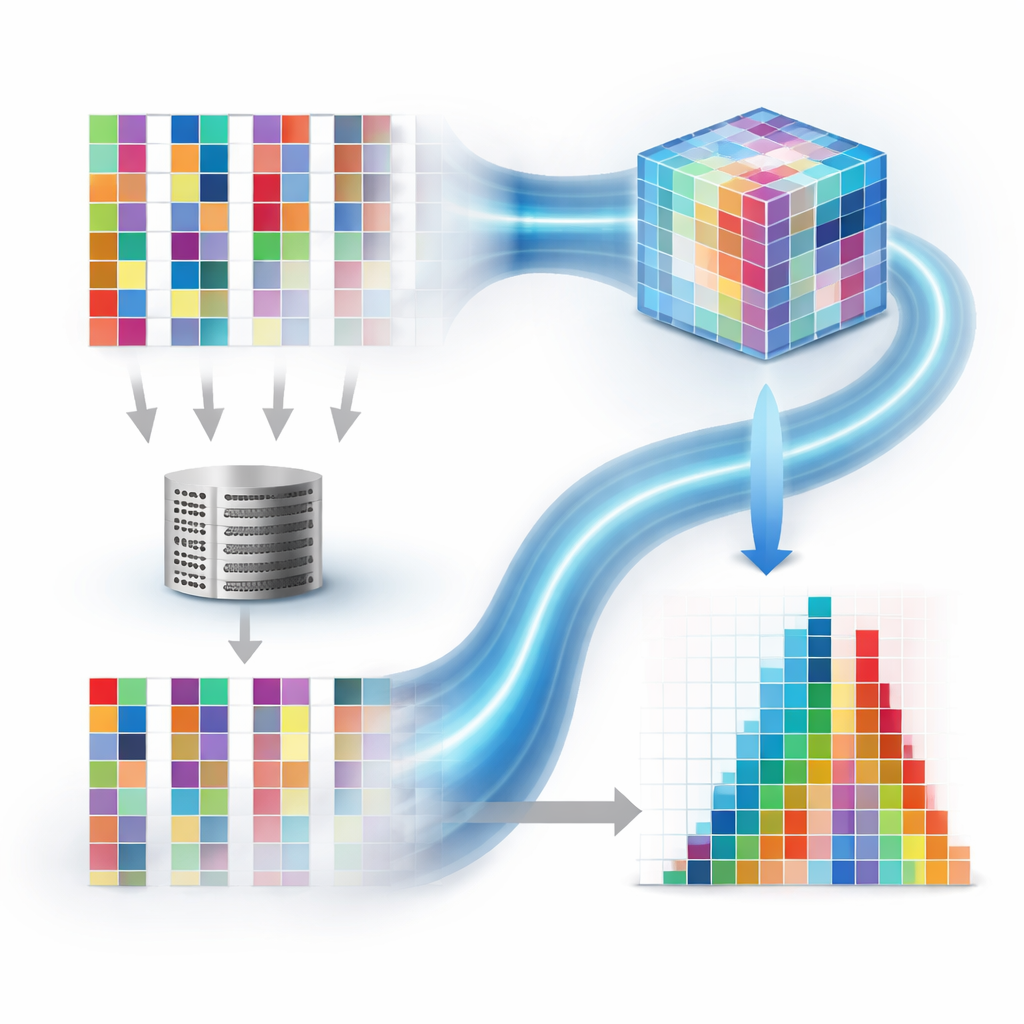

I modelli classici di diffusione discreta funzionano corrompendo gradualmente i dati con rumore e poi imparando a invertire questo processo, passo dopo passo, per generare nuovi campioni. Per mantenere i calcoli gestibili, trattano ogni dimensione — come ogni pixel in un’immagine o ogni simbolo in una sequenza — come se cambiasse indipendentemente. Questa “fattorizzazione” evita un’esplosione esponenziale di complessità, ma ignora anche le correlazioni tra le dimensioni. Gli autori analizzano uno scenario pessimistico in cui ogni parte dei dati è fortemente legata a tutte le altre. Dimostrano che, per dati di questo tipo, la discrepanza tra la distribuzione reale e quella che un modello fattorizzato può apprendere può crescere approssimativamente in proporzione al numero di dimensioni. In altre parole, man mano che i dati diventano più grandi e strutturati, i modelli classici di diffusione discreta possono fallire in modo fondamentale nel cogliere come le informazioni dipendono reciprocamente.

Usare stati quantistici per mantenere intatte le correlazioni

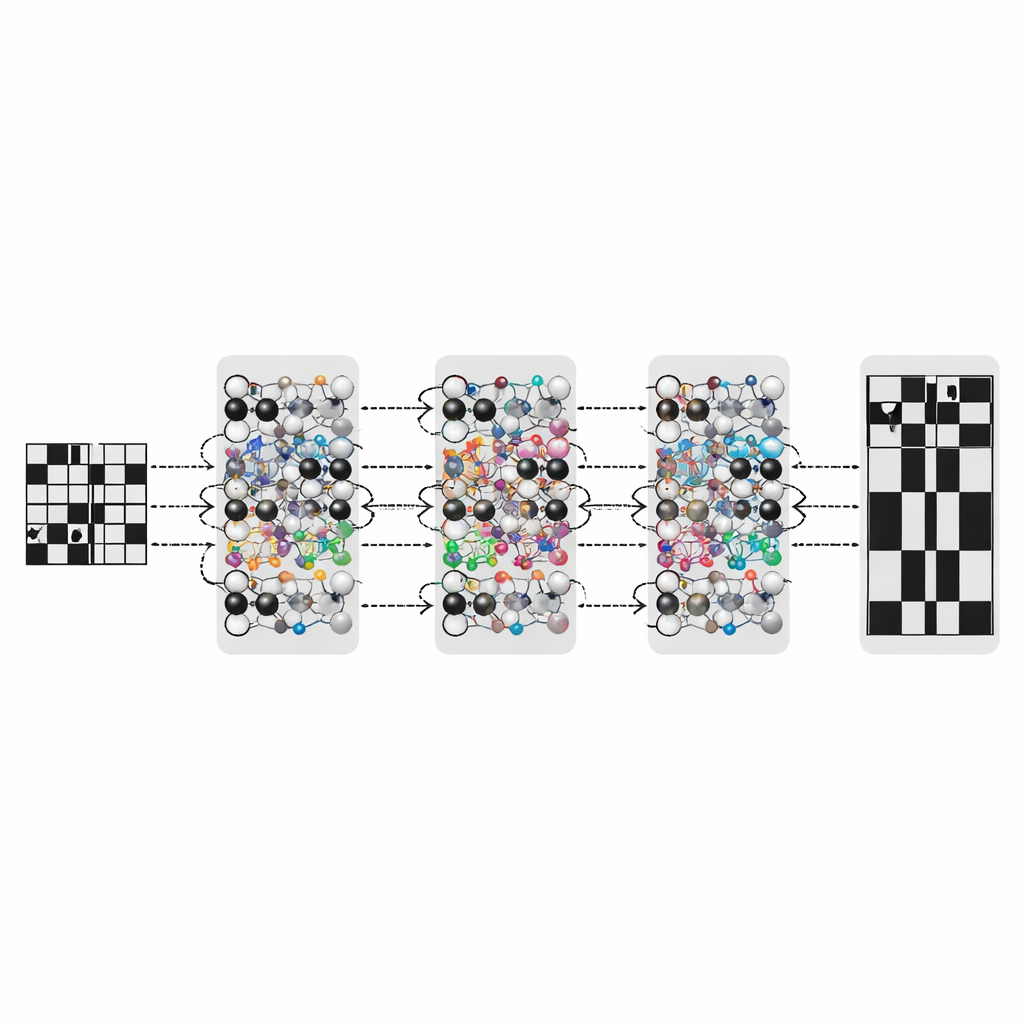

Il modello proposto, il modello quantistico discreto denoising diffusion probabilistic model (QD3PM), affronta questo problema rappresentando i dati come stati quantistici anziché come variabili classiche separate. In un sistema quantistico, una collezione di qubit vive naturalmente in uno spazio combinato molto ampio dove le configurazioni congiunte e le correlazioni sono immagazzinate insieme. QD3PM codifica dati discreti in questo spazio, applica un processo di “diffusione” controllata che aggiunge rumore tramite canali quantistici, e poi impara a invertire quel processo con un circuito quantistico addestrabile. Fondamentalmente, il modello opera sullo stato congiunto completo, quindi l’interdipendenza tra dimensioni viene preservata durante tutta la diffusione e la denoising. Usando una versione della regola di Bayes adattata alla teoria quantistica, gli autori derivano come calcolare l’esatto stato quantistico “posteriore” che dovrebbe guidare l’addestramento, e progettano circuiti che implementano fisicamente questo aggiornamento.

Da molti passi lenti a un singolo salto quantistico

I modelli di diffusione standard solitamente richiedono molte iterazioni di denoising graduale per trasformare rumore puro in un campione realistico, il che li rende costosi dal punto di vista computazionale. QD3PM viene inizialmente descritto in questo modo iterativo familiare, ma gli autori mostrano poi come addestrare la stessa circuiteria quantistica a saltare direttamente dal rumore ai dati puliti in un solo passo. Lo fanno facendo sì che il circuito quantistico apprenda la distribuzione dei dati originali condizionata su un input rumoroso, e poi componendo attentamente questa mappatura appresa con le regole quantistiche di diffusione e aggiornamento. Grazie alle proprietà delle operazioni e delle misure quantistiche, il campionamento finale dipende solo da certi elementi diagonali dello stato quantistico, il che permette di semplificare la procedura senza cambiare gli esiti osservabili. Questo produce un generatore one‑shot che, in linea di principio, può essere molto più veloce della diffusione classica a più passi pur modellando l’intera distribuzione congiunta.

Colmare i vuoti senza ricominciare da capo

Un vantaggio pratico di QD3PM è la sua gestione naturale di compiti condizionati come l’inpainting — riempire parti mancanti di un’immagine date le regioni visibili. Poiché il modello descrive la distribuzione congiunta completa su tutte le dimensioni, gli autori possono condizionare su valori noti semplicemente resettando ripetutamente quelle parti dei dati durante i passi di denoising mentre permettono alle parti ignote di variare. Questo guida dolcemente il processo di campionamento verso la corretta distribuzione condizionata, senza cambiare il circuito o riaddestrarlo. In simulazioni su dataset sintetici che includono pattern altamente strutturati a “barre e strisce”, QD3PM non solo si adatta alla distribuzione complessiva in modo più accurato rispetto sia ai modelli di diffusione classici sia ai modelli quantistici che si basano sulla fattorizzazione, ma funziona anche in modo robusto con livelli realistici di rumore dell’hardware quantistico e gestisce bene la generazione condizionata.

Cosa significano i risultati per il futuro

Presi insieme, l’analisi e gli esperimenti mostrano che trattare le dimensioni in modo indipendente è un collo di bottiglia serio per i modelli di diffusione discreta quando i dati sono fortemente correlati. Utilizzando invece stati quantistici per apprendere direttamente le distribuzioni congiunte, QD3PM evita questo limite e può, in teoria, riprodurre perfettamente distribuzioni target complesse nei casi in cui gli approcci classici fattorizzati non ci riescono. Il lavoro dimostra inoltre come i modelli generativi quantistici possano offrire non solo potenza espressiva grezza, ma anche vantaggi pratici come il campionamento one‑step più rapido e l’inferenza condizionata flessibile senza riaddestramento. Pur essendo le dimostrazioni attuali limitate a sistemi relativamente piccoli che possono essere simulati su computer classici, il quadro fornisce una roadmap concreta per come l’hardware quantistico emergente potrebbe un giorno migliorare i meccanismi fondamentali dell’IA generativa.

Citazione: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Parole chiave: modelli generativi quantistici, modelli di diffusione, apprendimento della distribuzione congiunta, correlazioni ad alta dimensione, generazione condizionata