Clear Sky Science · it

Un framework multimodale per la rilevazione della guida in stato di affaticamento tramite fusione di caratteristiche visive e tattili

Perché restare svegli al volante è importante

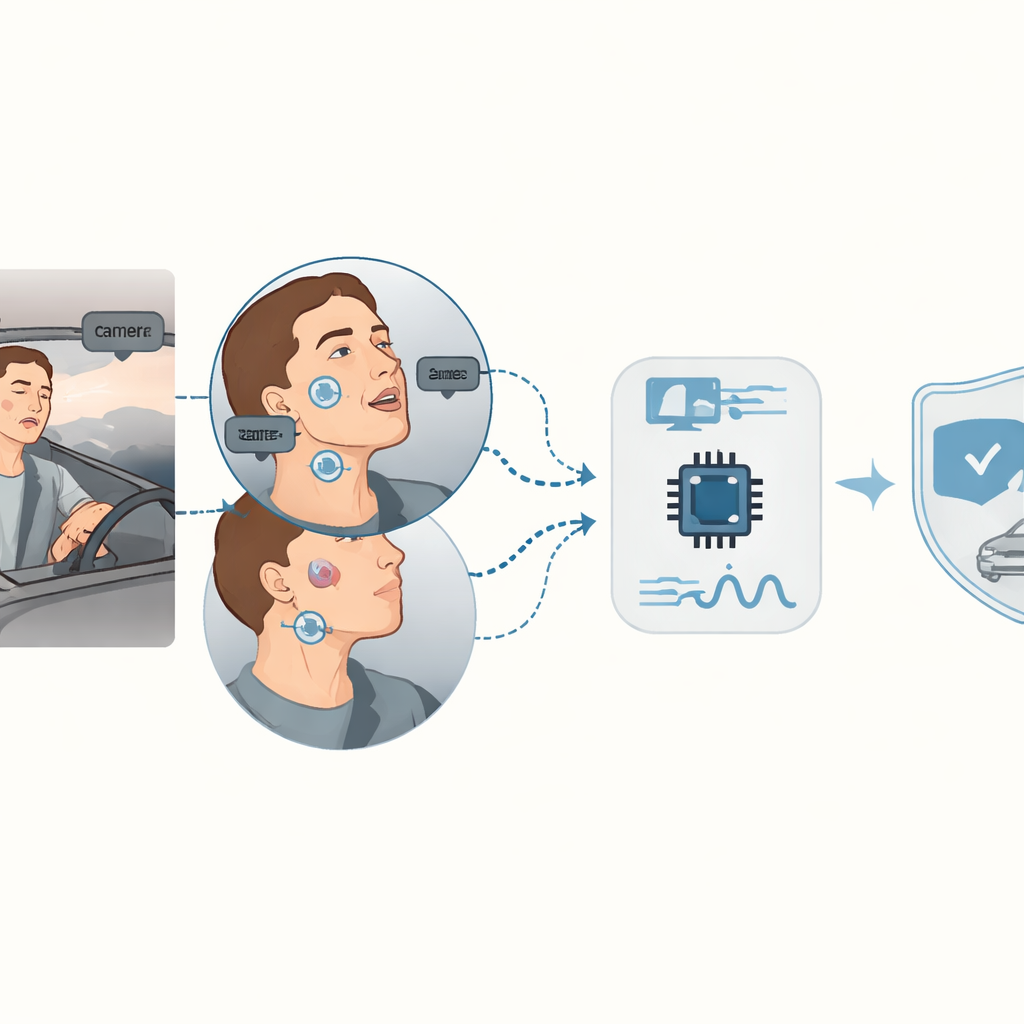

Viaggi lunghi, nottate e ritmi serrati fanno sì che molte persone guidino quando sono troppo stanche. L’affaticamento rallenta silenziosamente i tempi di reazione e offusca l’attenzione, contribuendo a una quota rilevante di incidenti gravi ogni anno. Questo studio presenta un nuovo sistema di monitoraggio in auto che osserva sia il volto del conducente sia sottili variazioni di pressione sulla pelle per rilevare la sonnolenza in modo precoce e più affidabile rispetto alle soluzioni odierne basate solo su telecamere o solo su sensori.

Due sensi valgono più di uno

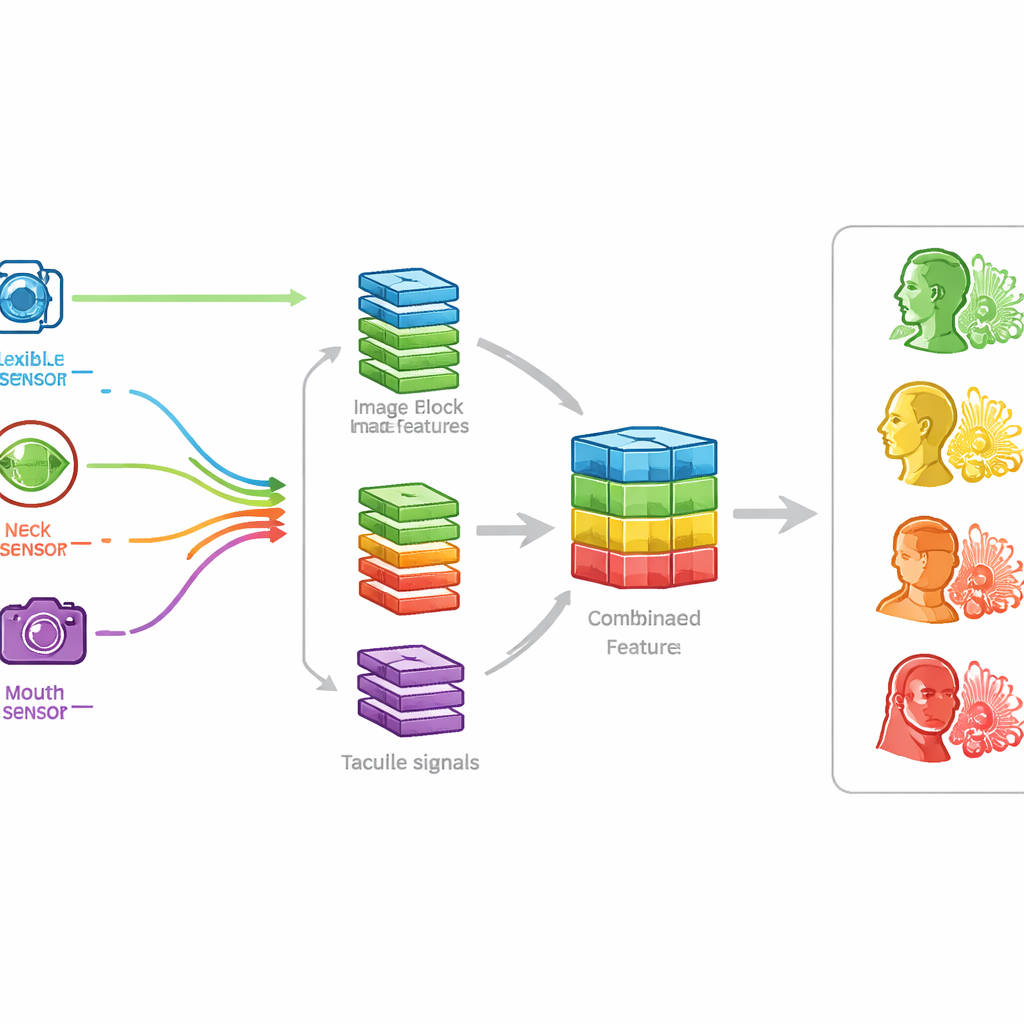

La maggior parte dei sistemi attuali cerca di individuare l’affaticamento da una sola fonte di informazione. Gli strumenti basati su telecamere cercano indizi come palpebre abbassate, ammiccamenti prolungati e sbadigli, ma faticano di notte, in presenza di abbagliamento o quando il volto è parzialmente coperto da occhiali o maschere. Altri approcci si basano su segnali elettrici del corpo o su dispositivi ingombranti da indossare, che possono risultare scomodi e rumorosi. Il team di ricerca invece imita il modo in cui il cervello umano integra tatto e vista: il loro sistema combina il video del volto del conducente con letture tattili delicate provenienti da patch morbidi e compatibili con la pelle posti vicino agli occhi, alla bocca e al collo, quindi lascia che un modello di intelligenza artificiale valuti se il conducente è vigile o sta scivolando verso il sonno.

Sensoristica morbida che percepisce ciò che le camere perdono

Al centro del sistema ci sono sensori di pressione flessibili realizzati con una plastica porosa leggera mescolata a un polimero conduttivo e modellata in piccole strutture simili a vermi. Questo materiale spugnoso si comprime facilmente e modifica il comportamento elettrico in risposta a pressioni e piegamenti molto piccoli. Quando incollato con delicatezza sulla pelle, una patch vicino agli occhi risponde alla chiusura delle palpebre, un’altra sul collo percepisce il movimento del capo che annuisce, e una terza vicino alla bocca rileva l’apertura ampia e l’allungamento tipici dello sbadiglio. I test hanno mostrato che questi sensori reagiscono in pochi millesimi di secondo, possono rilevare pressioni estremamente leggere e continuano a funzionare in modo affidabile anche dopo decine di migliaia di cicli di piegamento e compressione — caratteristica importante per qualcosa che potrebbe essere indossato ogni giorno in un’auto in movimento.

Addestrare il sistema a riconoscere la stanchezza

Per insegnare al sistema come si manifesta l’affaticamento, i ricercatori hanno costruito un dataset che abbina brevi clip video di cinque volontari con i segnali corrispondenti provenienti dalle tre patch cutanee. Hanno registrato quattro stati tipici: guida normale, chiusura degli occhi, annuire del capo e sbadiglio, sia in piena luce diurna sia con illuminazione fioca come in un parcheggio. Una rete moderna di riconoscimento delle immagini ha imparato a estrarre i pattern chiave dalle immagini del volto, mentre una seconda rete ha convertito le letture dei sensori in firme compatte. Questi due flussi di informazione sono poi stati fusi in una rappresentazione combinata, permettendo al modello di rilevare quando tatto e vista concordano sui segni di stanchezza e di appoggiarsi maggiormente ai sensori quando il video è scuro o degradato.

Da segnali istantanei a avvisi concreti

Una volta che il sistema ha riconosciuto i quattro stati di base con circa il 98 percento di accuratezza nei test controllati, il team ha fatto un passo avanti: trasformare i giudizi fotogramma per fotogramma in consigli pratici per il conducente. Hanno definito regole semplici basate sulla frequenza di ammiccamenti prolungati, annuimenti o sbadigli al minuto e hanno convertito quei conteggi in un punteggio di affaticamento a tre livelli: normale, lievemente stanco o gravemente affaticato. Il sistema gira in tempo reale su un computer compatto di bordo, aggiornando continuamente il punteggio del conducente e attivando un promemoria gentile per una pausa a livelli lievi o un forte avviso “fermati ora” quando si rileva affaticamento grave. Ha mantenuto alte prestazioni su diverse età, tonalità della pelle, peli del viso, uso di maschere e persino con scarsa illuminazione o vibrazioni di movimento, dimostrando che l’approccio combinato telecamera-e-tatto è robusto in condizioni realistiche.

Cosa significa questo per la guida di tutti i giorni

Per il pubblico generale, la conclusione è semplice: fondendo ciò che una telecamera vede con ciò che sensori cutanei morbidi percepiscono, questo studio offre un “co-pilota” più intelligente che nota segnali sottili di sonnolenza prima che diventino disastri. La tecnologia evita molte delle debolezze dei sistemi solo-camera durante la notte e dei dispositivi medici scomodi, restando al contempo sufficientemente veloce ed efficiente da funzionare all’interno di un’auto. Sebbene siano ancora necessari test su strada più ampi e in condizioni reali, questo framework multimodale indica la direzione verso veicoli futuri che monitorano silenziosamente l’allerta del conducente e intervengono con avvisi tempestivi, aiutando a ridurre gli incidenti legati all’affaticamento e rendendo i viaggi lunghi più sicuri per tutti gli utenti della strada.

Citazione: Li, K., Yue, W., Shin, DB. et al. A multimodal framework for fatigue driving detection via feature fusion of vision and tactile information. npj Flex Electron 10, 40 (2026). https://doi.org/10.1038/s41528-026-00543-7

Parole chiave: rilevazione affaticamento del conducente, monitoraggio sicurezza in auto, sensori cutanei flessibili, IA multimodale, prevenzione guida sonnolenta