Clear Sky Science · it

Rappresentazione allineata delle direzioni del moto visivo e tattile in hMT+/V5 e nelle regioni fronto-parietali

Perché questo conta nella vita di tutti i giorni

Schiaffeggiare una zanzara sul braccio sembra un gesto senza sforzo, ma il cervello sta silenziosamente risolvendo un problema complesso: deve combinare ciò che vedi con ciò che senti per capire in che direzione qualcosa si sta muovendo sulla pelle e come reagire. Questo studio indaga dove nel cervello umano vista e tatto vengono messe in allineamento e come il cervello trasforma segnali molto diversi — luce sugli occhi e pressione sulla pelle — in una singola, condivisa percezione del movimento nel mondo che ci circonda.

Due modi per sapere dove si muovono le cose

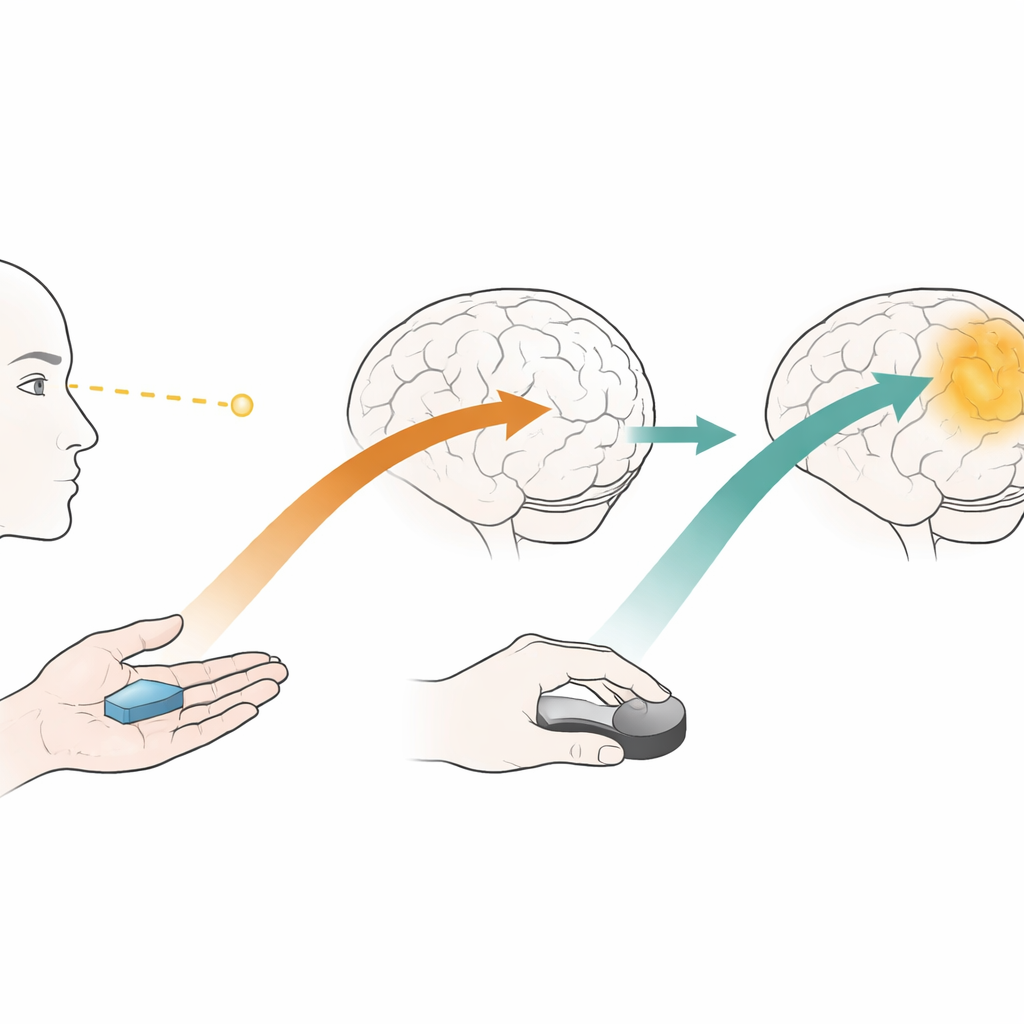

Visione e tatto iniziano col parlare due “lingue spaziali” diverse. Il moto visivo è prima mappato rispetto agli occhi: quale parte della retina è stimolata. Il moto tattile è mappato rispetto alla pelle: quale parte della mano viene sfiorata. Eppure le nostre azioni sono guidate da dove le cose si trovano nel mondo esterno, non solo su occhi o pelle. Il cervello deve quindi tradurre queste mappe corporee in un quadro comune basato sul mondo affinché un oggetto in movimento visto vicino alla mano e una sensazione corrispondente sulla pelle siano trattati come lo stesso evento.

Un test ingegnoso con punti in movimento e pennelli mobili

I ricercatori hanno usato la risonanza magnetica funzionale per monitorare l’attività cerebrale mentre le persone guardavano pattern di punti in movimento e sentivano un pennello scorrere sulla loro mano destra. Hanno cambiato la postura della mano — a volte con il palmo verso l’alto, a volte ruotata — così che lo stesso movimento fisico sulla pelle potesse puntare in direzioni diverse nello spazio esterno. Confrontando i pattern di attività cerebrale su molti piccoli punti di misura, hanno chiesto se una regione riuscisse a distinguere le direzioni del moto e se il suo “codice” per la direzione restasse coerente quando il moto era definito sulla pelle rispetto allo spazio esterno.

Un hub del moto visivo che percepisce anche il moto tattile

Un obiettivo centrale era hMT+/V5, una porzione della corteccia visiva nota da tempo per l’elaborazione del moto. Il team ha prima confermato che quest’area si attivava non solo per i punti visivi in movimento ma anche quando la mano veniva sfiorata, e che riusciva a distinguere le direzioni del moto in entrambi i domini. Ciò valeva anche per le sotto-regioni conosciute come MT e MST. Al contrario, le aree tattili primarie sul lato sinistro del cervello rispondevano fortemente al moto tattile ma non al moto visivo, coerentemente con il loro ruolo classico di mappa dettagliata della superficie corporea.

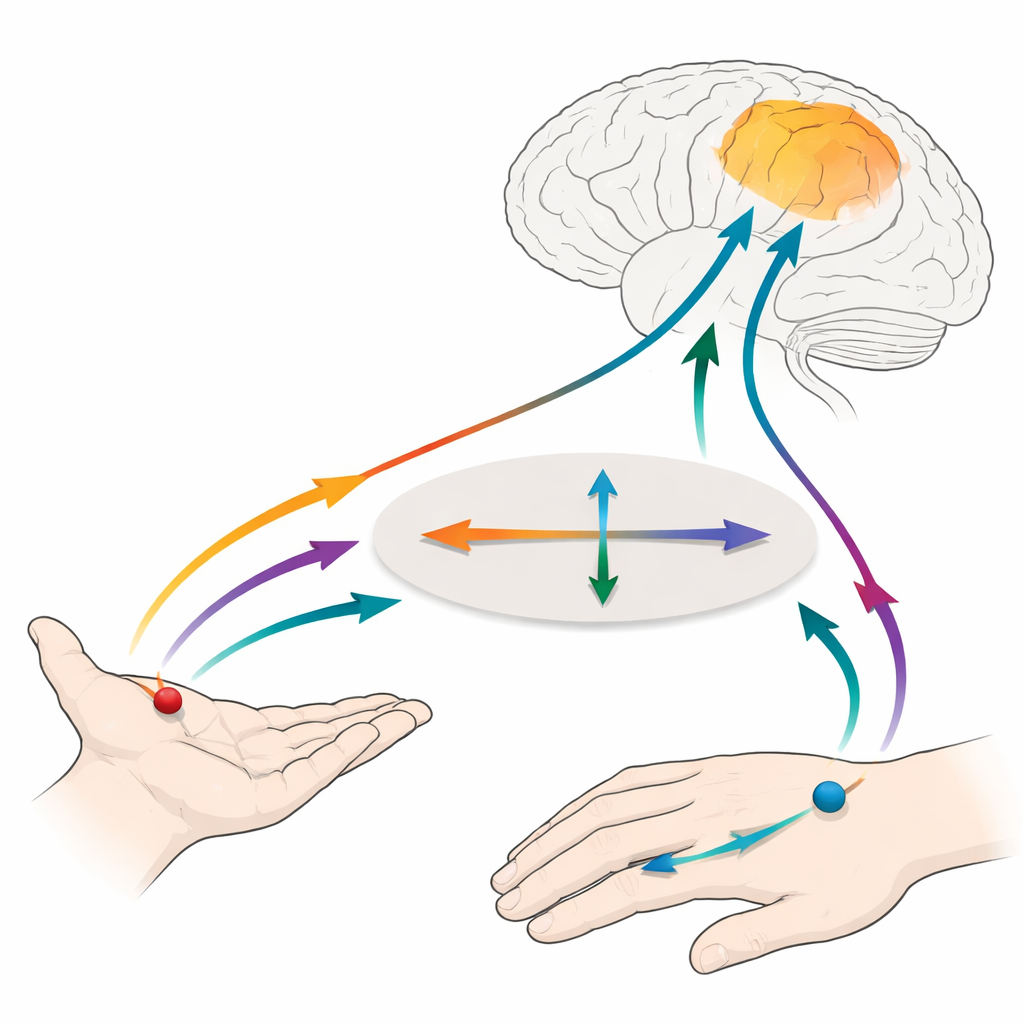

Dal moto basato sulla pelle al moto basato sul mondo

La domanda chiave era come queste aree gestissero i diversi “quadri di riferimento”. Nella corteccia tattile primaria, il moto lungo l’asse mignolo-pollice e il moto lungo l’asse dita-polso risultavano più chiaramente separati quando definiti puramente sulla pelle, mostrando un codice dominante basato sul corpo. Nel hMT+/V5 destro, invece, le direzioni tattili erano più nettamente distinte quando definite rispetto al mondo esterno — orizzontale versus verticale nello spazio — indipendentemente dalla postura della mano. Crucialmente, solo nel hMT+/V5 destro un classificatore addestrato su pattern di moto visivo riusciva a indovinare correttamente le direzioni del moto tattile, e questo decodifica cross-senso funzionava solo quando il tatto era descritto in coordinate esterne. Analisi su tutto il cervello hanno mostrato che mettere in corrispondenza moto visivo e tattile in questo modo coinvolgeva anche una rete di regioni parietali e frontali destre collegate all’attenzione spaziale e alla pianificazione del movimento.

Una mappa condivisa che conserva comunque l’origine sensoriale

Anche se il hMT+/V5 destro conteneva informazioni condivise sufficienti per allineare le direzioni del moto tra vista e tatto, non cancellava completamente la differenza tra i sensi: i pattern per il moto visivo e tattile erano ancora distinguibili. Gli autori sostengono che questa regione, insieme ai partner fronto-parietali, funzioni come un hub multisensoriale del moto. Converte input basati sulla pelle e sugli occhi in una mappa esterna parzialmente comune delle direzioni di movimento mantenendo però traccia di quale senso ha fornito l’informazione. Questo codice flessibile può aiutare il cervello a seguire eventi in movimento mentre i nostri occhi e arti si spostano, permettendoci di coordinare percezione e azione in modo fluido in un mondo affollato e dinamico.

Citazione: Shahzad, I., Battal, C., Cerpelloni, F. et al. Aligned representation of visual and tactile motion directions in hMT+/V5 and fronto-parietal regions. Nat Commun 17, 2625 (2026). https://doi.org/10.1038/s41467-026-70537-6

Parole chiave: moto multisensoriale, hMT+/V5, integrazione visivo-tattile, quadri di riferimento spaziali, neuroimaging