Clear Sky Science · it

Stime di incertezza affidabili nel deep learning con algoritmi Metropolis-Hastings efficienti

Perché un'incertezza più intelligente conta

Dalle scansioni mediche alle auto a guida autonoma, l'intelligenza artificiale moderna prende spesso decisioni in cui sbagliare con fiducia può essere pericoloso. I sistemi di deep learning standard sono eccellenti nel riconoscere pattern, ma sono notoriamente scarsi nel comunicarci quanto siano incerti. Questo articolo colma quella lacuna: presenta nuovi modi per dotare le reti neurali profonde di misure affidabili dell'incertezza, mantenendo sotto controllo il costo computazionale elevato dei metodi bayesiani tradizionali.

Dalla congettura alla confidenza misurata

Nel deep learning quotidiano, un modello viene addestrato una sola volta e poi usato così com'è. Fornisce un'unica migliore ipotesi, ma dà pochi indizi su quanto sia attendibile. Le reti neurali bayesiane seguono una strada diversa: invece di fissare un solo insieme di parametri del modello, trattano i parametri come variabili casuali e cercano di catturare un'intera distribuzione di modelli plausibili. Mediare le previsioni su questa collezione può rivelare sia la risposta più probabile sia quanto il modello debba fidarsi di sé stesso. La sfida è che campionare accuratamente da questa distribuzione con metodi di riferimento come Hamiltonian Monte Carlo è estremamente costoso per le reti e i dataset di oggi.

Campionamento più veloce senza perdere il quadro generale

Gli autori si concentrano su una famiglia di metodi chiamata stochastic gradient Hamiltonian Monte Carlo, che già riutilizza idee dell'addestramento standard—mini-batch e gradienti rumorosi—to accelerare il campionamento. L'ingrediente mancante è un "filtro" affidabile che decida quali aggiornamenti tentativi dei parametri mantenere. Nel classico Hamiltonian Monte Carlo, questo ruolo è svolto da un passaggio di accettazione Metropolis-Hastings che corregge gli errori numerici e impedisce al campionatore di derivare verso regioni sbagliate. Introdurre questo passo di accettazione nel mondo rumoroso dei mini-batch del deep learning è difficile, perché di solito richiede valutazioni sull'intero dataset e può bloccare i progressi se i tassi di accettazione sono troppo bassi.

Due nuovi modi di esplorare il paesaggio

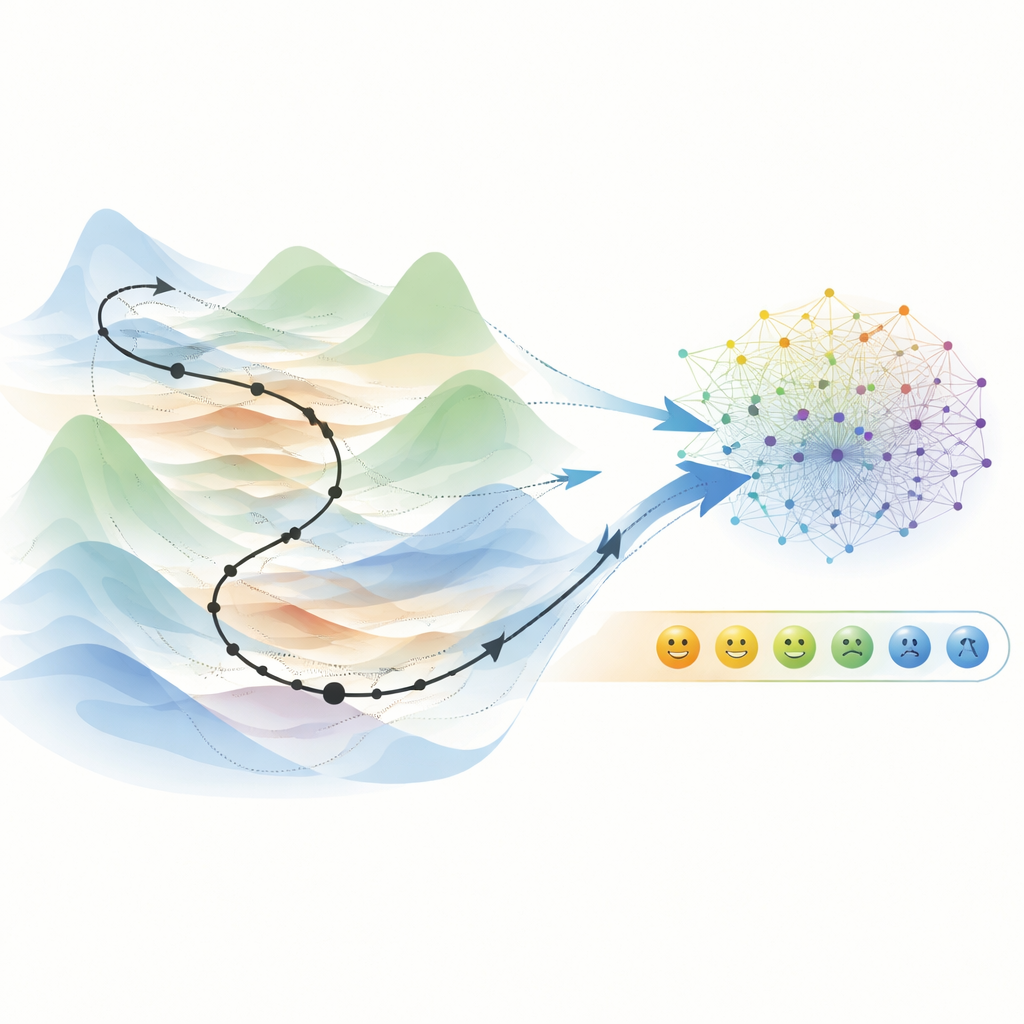

L'articolo introduce due strategie complementari. La prima, chiamata generalized stochastic gradient Hamiltonian Monte Carlo (GSGHMC), progetta un test di accettazione che funziona su mini-batch preservando la proprietà importante per cui gli ottimi genuini del problema completo vengono ancora correttamente riconosciuti. Utilizza un integratore numerico scelto con cura in modo che l'accettazione passo dopo passo rimanga stabile, anche se vede solo una fetta dei dati alla volta. Questo produce un campionatore efficiente che resta vicino al vero quadro bayesiano e genera ensemble di modelli con punteggi di confidenza particolarmente ben calibrati.

Percorrere traiettorie lunghe per previsioni migliori

Il secondo metodo, l'Hamiltonian Trajectory Ensemble (HTE), compie un compromesso deliberato: invece di insistere su un comportamento bayesiano esatto, favorisce camminate lunghe e guidate dall'inerzia nello spazio dei parametri che assomigliano a sessioni di addestramento aggressive. Alla fine di ciascuna di queste traiettorie, un test in stile Metropolis decide se conservare l'istantanea del modello risultante. Poiché questi percorsi tendono ad assestarsi in valli ampie e generalizzabili del paesaggio di perdita, i modelli raccolti formano un ensemble diversificato ma mirato. In benchmark di classificazione di immagini come EMNIST e CIFAR-10, HTE migliora l'accuratezza fino a circa sei punti percentuali rispetto a solidi baseline bayesiani, e di diversi punti rispetto all'addestramento deterministico ordinario, offrendo al contempo informazioni utili sull'incertezza e una forte rilevazione degli input fuori distribuzione.

Ensemble più piccoli, uso più intelligente

Campionare centinaia o migliaia di modelli sembra costoso in fase di test, quindi gli autori studiano anche quanti membri dell'ensemble siano realmente necessari. Scartando in modo greedy i modelli che hanno scarso effetto sulle prestazioni, trovano che circa un terzo dell'ensemble può spesso essere mantenuto senza danneggiare l'accuratezza, sebbene mantenere una calibrazione molto netta richieda generalmente più membri. Nei compiti di immagini e in un problema caotico di previsione di serie temporali, i loro metodi superano o eguagliano costantemente alternative popolari come l'inferenza variazionale, il Monte Carlo dropout e ensemble profondi più semplici, sebbene a un costo di addestramento superiore rispetto all'apprendimento deterministico puro.

Cosa significa per l'IA nel mondo reale

Per un non specialista, il messaggio centrale è che possiamo rendere il deep learning non solo preciso ma anche onesto su ciò che non sa, senza bisogno di risorse su scala di supercomputer. Intrecciando con cura idee di campionamento classiche nell'addestramento moderno basato su mini-batch, i due approcci proposti offrono previsioni migliori e stime di confidenza più affidabili rispetto a molte tecniche esistenti. Questa combinazione di efficienza, robustezza e incertezza calibrata è un passo cruciale per distribuire il deep learning in sicurezza in domini sensibili dove il costo della sovrastima della fiducia si misura in vite, non solo in punti percentuali.

Citazione: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Parole chiave: Reti neurali bayesiane, stima dell'incertezza, Hamiltonian Monte Carlo, ensemble nel deep learning, stochastic gradient MCMC