Clear Sky Science · it

Apprendimento senza feedback in forma chiusa con proiezione in avanti

Insegnare alle macchine senza messaggi all’indietro

L’intelligenza artificiale moderna impara prevalentemente con un metodo chiamato backpropagation, in cui gli errori vengono inviati all’indietro attraverso la rete per aggiustare le sue connessioni interne. Questo processo però è diverso da come funzionano i cervelli reali e può essere lento e dispendioso in termini di risorse. Questo articolo presenta un nuovo modo per le reti neurali di apprendere, chiamato Proiezione in Avanti (Forward Projection), che salta del tutto il passo all’indietro ottenendo comunque buone prestazioni, in particolare su compiti biomedici difficili con dati limitati.

Un nuovo modo di guidare l’apprendimento

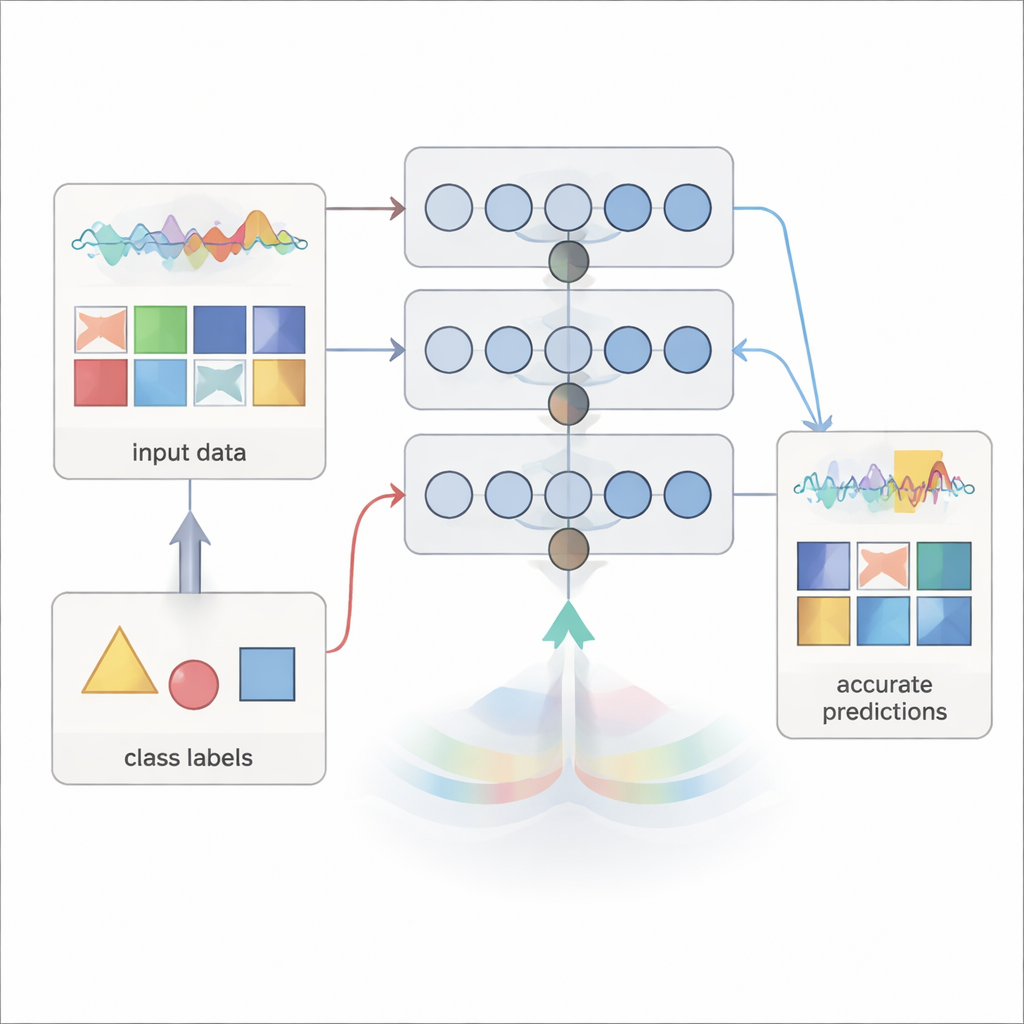

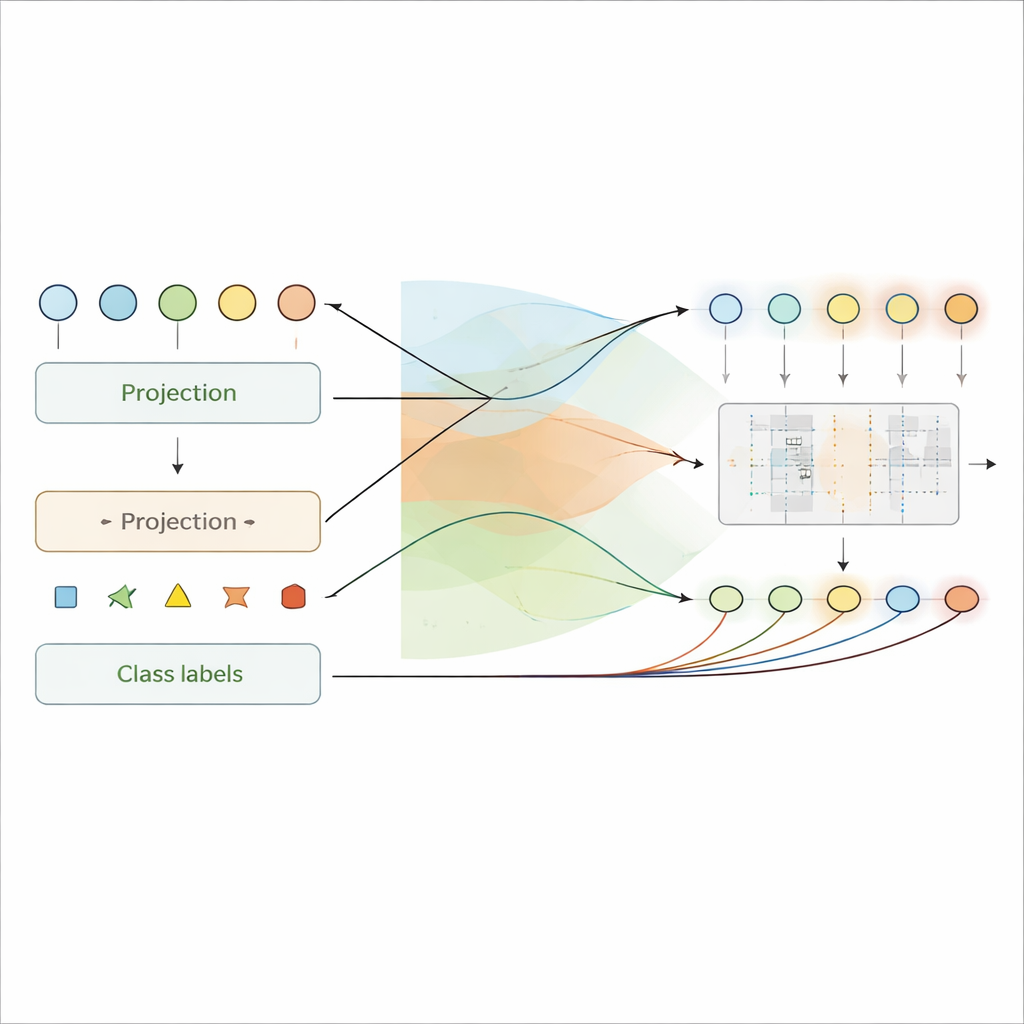

Le reti neurali tradizionali apprendono confrontando le loro predizioni con le risposte corrette e inviando segnali di errore all’indietro attraverso ogni livello per rifinire le connessioni. La Proiezione in Avanti prende una strada diversa. Invece di fare affidamento su questi segnali di errore retrogradi, usa solo informazioni disponibili mentre i segnali si muovono in avanti: l’attività del livello corrente e l’etichetta di destinazione. In ciascun livello, il metodo combina l’input per quel livello e l’etichetta desiderata usando proiezioni casuali fisse passate attraverso una semplice non linearità. Ciò produce un “bersaglio” di segnale interno per quel livello — un pattern di attività simile a potenziali elettrici che il livello dovrebbe cercare di riprodurre.

Una volta creati questi bersagli, i pesi di connessione di ogni livello vengono risolti in un’unica soluzione usando una regressione in forma chiusa, una formula statistica standard anziché una discesa del gradiente iterativa. Questo significa che la rete può essere addestrata con una sola passata sul dataset, senza rivedere ripetutamente gli stessi esempi o memorizzare un gran numero di attivazioni intermedie. Poiché non è necessario far viaggiare informazioni all’indietro, il metodo rispetta la comunicazione unidirezionale osservata nei neuroni biologici e potrebbe essere più semplice da implementare su hardware specializzato con connessioni a senso unico.

Vedere significato nell’attività nascosta

Un vantaggio notevole della Proiezione in Avanti è che i segnali interni nei layer nascosti diventano direttamente interpretabili. Poiché ogni livello è esplicitamente addestrato a codificare sia l’input sia l’etichetta nei suoi potenziali simili a membrane, questi valori interni possono essere letti come predizioni locali della classe. Gli autori mostrano come “decodare” approssimativamente questi segnali indietro nello spazio delle etichette, trasformando i pattern di attività in spiegazioni per livello di ciò che la rete ritiene a ogni stadio. Negli esperimenti, queste spiegazioni diventano più accurate negli strati più profondi, riflettendo un apprendimento progressivo — i primi livelli colgono pattern ampi, mentre gli strati successivi si concentrano su dettagli decisionali critici.

Questa interpretabilità è particolarmente preziosa in medicina, dove capire perché un modello ha preso una decisione può avere importanza pari alla decisione stessa. Utilizzando dati di elettrocardiogramma, gli autori mostrano che la Proiezione in Avanti evidenzia segni clinicamente noti di infarto — come le variazioni in segmenti specifici dell’onda — nei momenti temporali corretti. Su scansioni oculari usate per rilevare crescita anomala di vasi sanguigni, il metodo si concentra naturalmente su sacche di liquido, depositi brillanti e regioni simili a cicatrici che gli specialisti osservano, anche quando addestrato con appena 100 esempi per classe.

Addestramento rapido, risultati solidi

Il team ha confrontato la Proiezione in Avanti con diverse alternative che cercano anch’esse di evitare la backpropagation completa, oltre che con la backpropagation standard. Su compiti di immagini e sequenze come cifre Fashion-MNIST, riconoscimento di promotori del DNA, rilevamento di infarto da elettrocardiogrammi e riconoscimento di oggetti, il nuovo metodo ha eguagliato o superato le prestazioni di altre regole di apprendimento locali. In contesti standard, la backpropagation manteneva ancora un vantaggio complessivo, ma l’accuratezza della Proiezione in Avanti si è dimostrata sorprendentemente vicina pur usando una singola passata di addestramento.

I benefici sono emersi con maggior chiarezza negli scenari few-shot, dove sono disponibili solo pochi esempi etichettati, come spesso avviene nella pratica clinica. In questi casi, la Proiezione in Avanti si è spesso generalizzata meglio sia rispetto alla backpropagation sia rispetto ai metodi locali concorrenti su radiografie toraciche, scansioni retiniche e sottoinsiemi ridotti di immagini. La backpropagation tendeva o a sovradattare i dataset minuscoli o a non apprendere caratteristiche sufficientemente ricche, mentre la Proiezione in Avanti produceva rappresentazioni interne più stabili e riutilizzabili. Dal punto di vista computazionale, addestrare un grande layer richiedeva ordini di grandezza in meno di operazioni di moltiplicazione e accumulo rispetto all’esecuzione di molte epoche di backpropagation, traducendosi in accelerazioni significative e in un minore consumo energetico.

Cosa significa per il futuro dell’IA e del calcolo ispirato al cervello

In termini pratici, questo lavoro mostra che le reti neurali non devono fare affidamento su loop di feedback pesanti e biologicamente improbabili per apprendere rappresentazioni interne utili e interpretabili. Mescolando con ingegno input ed etichette in un’unica passata in avanti e risolvendo i pesi in forma chiusa, la Proiezione in Avanti offre un modo per addestrare modelli rapidamente, interpretare il loro funzionamento interno e gestire dataset biomedici piccoli e rumorosi. Pur rimanendo la backpropagation lo standard d’oro per molti compiti su larga scala, questo approccio senza feedback indica strategie di apprendimento più simili al cervello e più adatte all’hardware che potrebbero sostenere la prossima generazione di sistemi di IA efficienti e spiegabili.

Citazione: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Parole chiave: apprendimento senza feedback, reti neurali, addestramento few-shot, IA biomedica, deep learning interpretabile