Clear Sky Science · it

Calcolo vicino al sensore ispirato alla visione dei gufi

Vedere al buio come un gufo

Immaginate un drone in grado di individuare un escursionista perduto o un velivolo distante senza alcun faro, perfino sotto una luce stellare così debole che le fotocamere comuni non percepiscono quasi nulla. Questo articolo descrive un nuovo hardware per la visione ispirato ai gufi che avvicina quell’idea alla realtà. Imitando il modo in cui gli occhi del gufo si adattano all’oscurità e come il suo cervello elabora in modo efficiente segnali deboli, i ricercatori costruiscono una piccola «sinapsi» elettronica che sia sensore di luce sia esegue parte del calcolo necessario per il riconoscimento, direttamente sul sensore.

Perché le macchine attuali faticano di notte

L’intelligenza artificiale moderna riconosce volti, oggetti e scene con notevole accuratezza, ma farlo di solito richiede chip potenti che consumano enormi quantità di energia. Le fotocamere convenzionali separano inoltre il rilevamento dal calcolo: prima la camera cattura un’immagine; poi processori distanti elaborano i dati. In condizioni di luce molto bassa queste camere falliscono quasi sempre se non aiutate da lampade potenti o pesanti miglioramenti digitali. Per contro, l’occhio e il cervello di un gufo lavorano insieme: la retina accumula piccole correnti di fotoni nel tempo e i circuiti neurali si adattano così che forme deboli diventano gradualmente visibili. Gli autori mirano a trasferire una strategia simile, strettamente integrata ed efficiente dal punto di vista energetico, alla visione artificiale.

Un dispositivo minuscolo che impara dalla luce

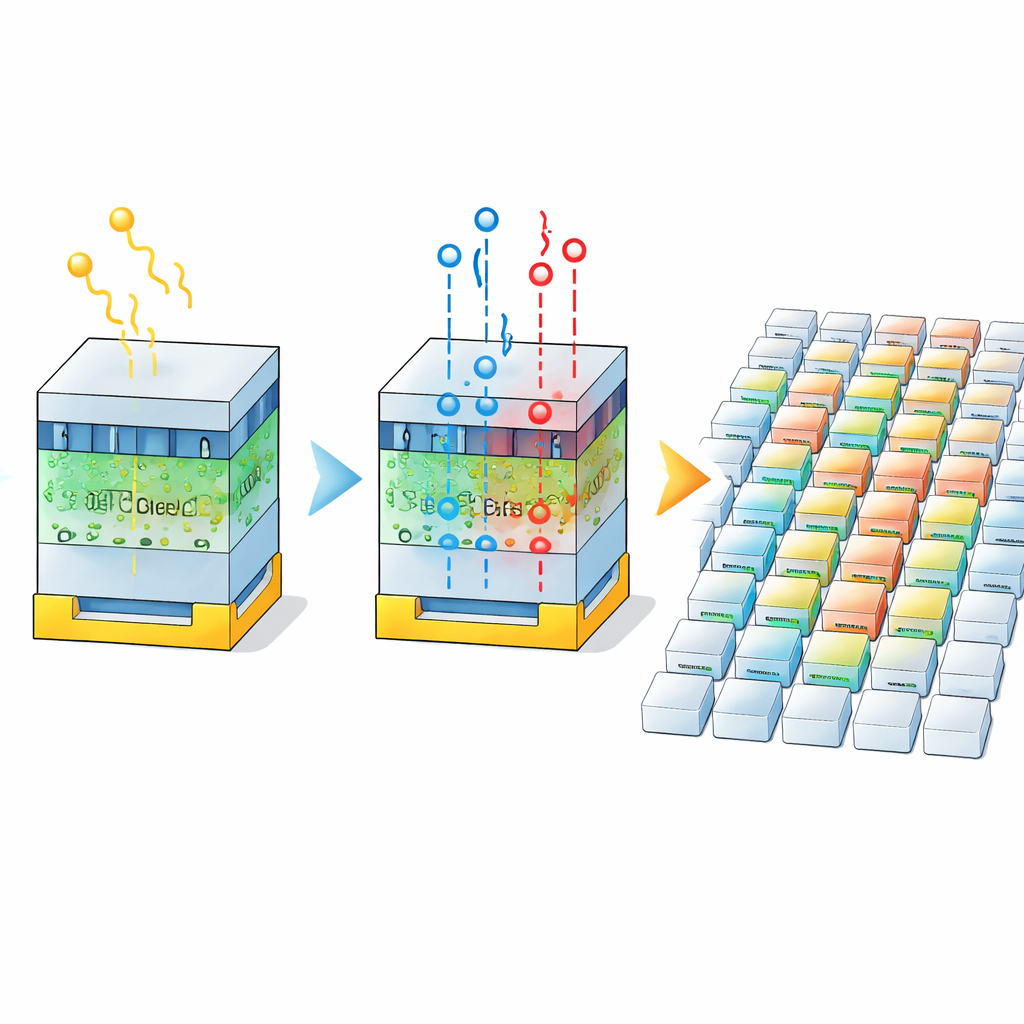

Al centro del lavoro c’è una «sinapsi adattiva a doppia modalità ispirata ai gufi»: un piccolo dispositivo a base di transistor che funge sia da sensore di luce sia da connessione apprendibile tra neuroni. Il dispositivo è costruito a strati: un elettrodo trasparente inferiore, un film dielettrico in grado di intrappolare cariche, una miscela appositamente ingegnerizzata che assorbe la luce e un canale semiconduttore organico in cima. Quando una luce fioca colpisce lo strato assorbente, si generano pochi portatori di carica che, guidati da una tensione applicata, vengono intrappolati nel dielettrico e accumulati nel canale. Questo aumenta gradualmente la risposta elettrica del dispositivo, proprio come le cellule bastoncellari nella retina di un gufo diventano più sensibili durante l’adattamento al buio. Gli autori mostrano che il loro dispositivo può rispondere a intensità luminose basse quanto 0,146 nanowatt per centimetro quadrato — circa tre ordini di grandezza più deboli rispetto a quanto riescono a gestire i normali chip delle fotocamere — pur mostrando un guadagno forte e regolabile che quantifica la sua adattazione al buio.

Agire come una sinapsi artificiale

Oltre a percepire la luce, il dispositivo imita anche il modo in cui le sinapsi biologiche si rafforzano o si indeboliscono con l’attività. Soggetto a impulsi luminosi ripetuti su un’ampia gamma di colori, dall’ultravioletto al vicino infrarosso, la corrente del dispositivo aumenta in passi duraturi, conservando la memoria della storia ottica. Sottoposto a impulsi elettrici applicati al gate, mostra potenziamento e depressione a lungo termine — cambiamenti graduali e reversibili nella conduttanza che codificano i «pesi» sinaptici nelle reti neurali artificiali. Questi pesi sono memorizzati in modo non volatile, cioè il dispositivo li ricorda senza alimentazione continua, e possono essere regolati attraverso più livelli come un valore digitale multi-bit. È fondamentale che ogni evento sinaptico consumi dell’ordine di 10 femtojoule di energia, comparabile o persino inferiore alle stime per le sinapsi biologiche e di molti ordini di grandezza sotto il budget energetico dell’hardware AI tipico.

Dalla singola sinapsi al sistema visivo

Per confermare che questo comportamento si mantiene su scala, il team fabbrica una matrice 19 per 17 di dispositivi e dimostra che operano in modo uniforme. Quando un pattern di luce fioca è proiettato sull’array, le photocorrenti nei punti illuminati crescono gradualmente durante l’adattamento, rivelando forme precedentemente nascoste sotto illuminazione ultra-bassa, proprio come la retina di un gufo affina un’immagine nel buio. Gli autori quindi mappano i molteplici livelli di conduttanza del dispositivo sui pesi in modelli di apprendimento automatico, inclusi percettroni multistrato semplici, reti convoluzionali e un’architettura profonda in stile VGG. Anche con pesi relativamente grezzi e discreti, queste reti simulate raggiungono oltre il 90 percento di accuratezza su dataset di immagini standard, dimostrando che gli stati sinaptici sono sufficienti per il calcolo pratico.

Visione notturna per droni e oltre

Per illustrare il potenziale nel mondo reale, i ricercatori simulano un sistema di riconoscimento aria-terra montato su un piccolo drone, addestrato a rilevare un bersaglio a forma di indumento a diversi livelli di luminosità corrispondenti a condizioni stellate. Collegando la risposta dipendente dal tempo del dispositivo al contrasto delle immagini catturate, costruiscono uno stadio di preelaborazione che «adatta» l’immagine, potenziando il contrasto utile rimanendo entro il comportamento realistico del sensore. Una popolare rete per il rilevamento di oggetti (YOLOv5) addestrata su questi dati adattati raggiunge oltre il 95 percento di accuratezza di riconoscimento anche al livello di luce più basso testato. In termini semplici, il lavoro mostra che combinando l’adattamento al buio in stile gufo con l’apprendimento sinaptico integrato direttamente sul sensore è possibile spingere la visione artificiale in condizioni in cui le fotocamere tradizionali falliscono, consumando molto meno energia. Tale tecnologia potrebbe infine sostenere droni per ricerca e soccorso, esploratori autonomi o strumenti astronomici che vedono di più emettendo meno luce.

Citazione: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Parole chiave: visione in condizioni di scarsa luminosità, sensore neuromorfico, imaging ispirato ai gufi, near-sensor computing, rilevamento di oggetti notturno