Clear Sky Science · it

Il transfer learning in DeepLC migliora la predizione del tempo di ritenzione LC attraverso modifiche e configurazioni sostanzialmente diverse

Perché è importante prevedere i tempi chimici

Ogni volta che gli scienziati studiano le proteine nelle nostre cellule, si affidano a una tecnica che invia prima piccoli frammenti proteici, chiamati peptidi, attraverso una colonna piena di liquido prima di pesarli in un spettrometro di massa. Quanto a lungo ogni peptide rimane nella colonna — il suo “tempo di ritenzione” — è estremamente informativo e aiuta i ricercatori a riconoscere e confermare ciò che stanno misurando. Ma poiché ogni laboratorio utilizza strumenti e impostazioni leggermente diversi, i modelli informatici che predicono questi tempi spesso falliscono quando vengono trasferiti da una configurazione all’altra. Questo articolo mostra come un trucco moderno del machine learning chiamato transfer learning possa rendere queste predizioni molto più affidabili e flessibili in molte condizioni sperimentali.

Misurare il viaggio dei frammenti proteici

Nella ricerca sulle proteine, la cromatografia liquida–spettrometria di massa è il metodo principale. Il passaggio di cromatografia liquida separa migliaia di peptidi in base alle loro proprietà chimiche, così non arrivano tutti contemporaneamente al rivelatore. Il tempo di ritenzione risultante, insieme alla massa misurata del peptide, fornisce ai ricercatori un potente identificatore bidimensionale. Nell’ultimo decennio, i ricercatori hanno addestrato modelli informatici per prevedere i tempi di ritenzione direttamente dalle sequenze peptidiche. Queste predizioni migliorano la confidenza nelle identificazioni dei peptidi, aiutano a progettare esperimenti migliori e sono essenziali per costruire grandi librerie spettrali generate al computer utilizzate nei moderni flussi di lavoro ad alto rendimento.

Il problema delle condizioni di laboratorio variabili

Sfortunatamente, il tempo di ritenzione è altamente sensibile a dettagli come l’acidità del solvente, il materiale della colonna, la pressione e la temperatura. Anche piccoli cambiamenti possono rimescolare l’ordine con cui i peptidi emergono dalla colonna. Gli approcci tradizionali cercano di ovviare a questo “calibrando” un modello addestrato altrove con un piccolo insieme di peptidi di riferimento, assumendo che l’ordine di eluizione dei peptidi rimanga lo stesso. Quando questa assunzione viene meno — per esempio quando cambia la chimica della colonna o il pH del campione — la calibrazione può fallire gravemente. Un’altra opzione è addestrare un modello completamente nuovo per ogni configurazione, ma questo richiede molti peptidi ben misurati, che non sono sempre disponibili, soprattutto per modifiche chimiche rare o insolite.

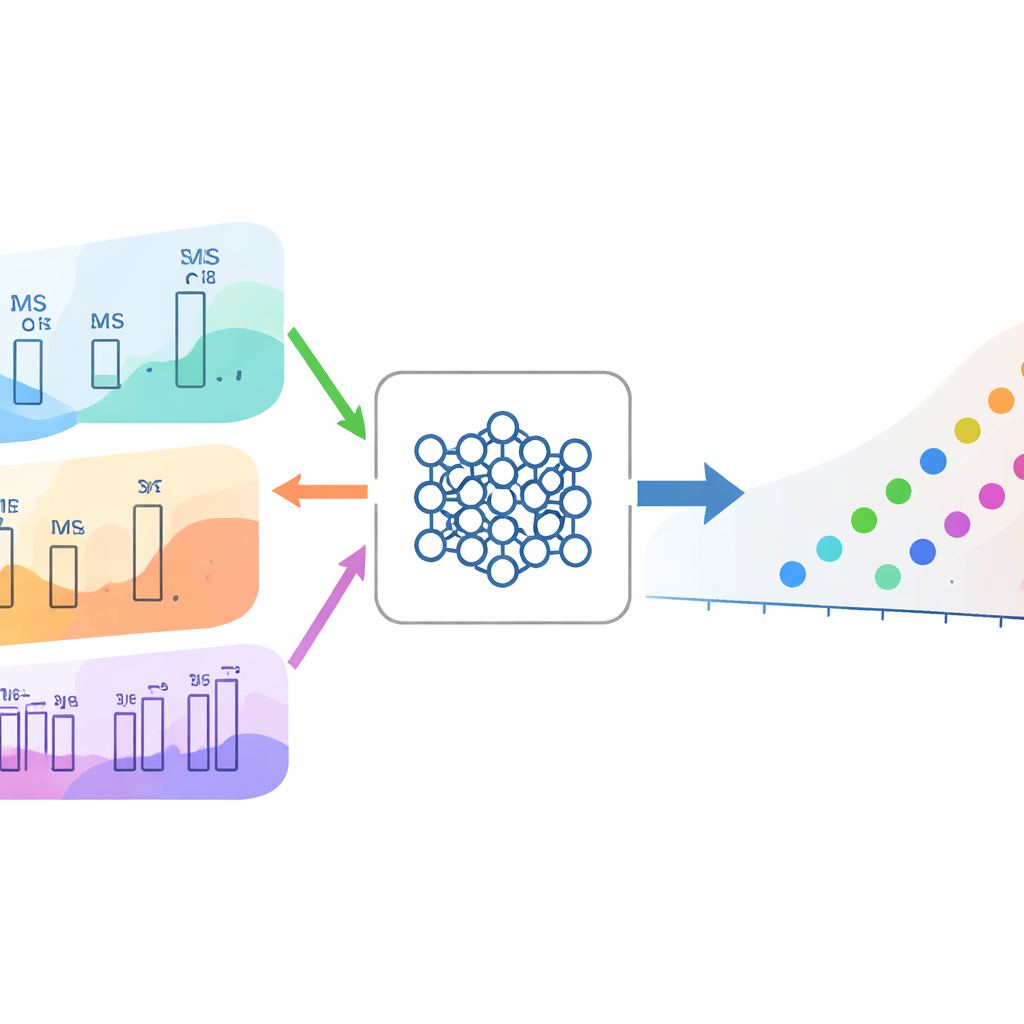

Riutilizzare la conoscenza con il transfer learning

Gli autori si basano su DeepLC, un modello di deep learning che già predice i tempi di ritenzione per molti tipi di peptidi. Invece di ricominciare da zero per ogni nuova situazione, riutilizzano un modello addestrato su un ampio dataset di alta qualità e lo rifiniscono su una collezione molto più piccola di peptidi provenienti dalla nuova configurazione. Su 474 dataset tratti da centinaia di esperimenti pubblici, questa strategia di transfer learning supera quasi sempre sia la semplice calibrazione sia l’addestramento di un nuovo modello da parametri iniziali casuali. I miglioramenti sono particolarmente evidenti quando sono disponibili solo poche centinaia o poche migliaia di peptidi di addestramento, uno scenario comune negli studi reali. Anche quando esistono molti esempi, il transfer learning tende comunque a fornire una precisione leggermente migliore.

Gestire chimiche insolite e condizioni estreme

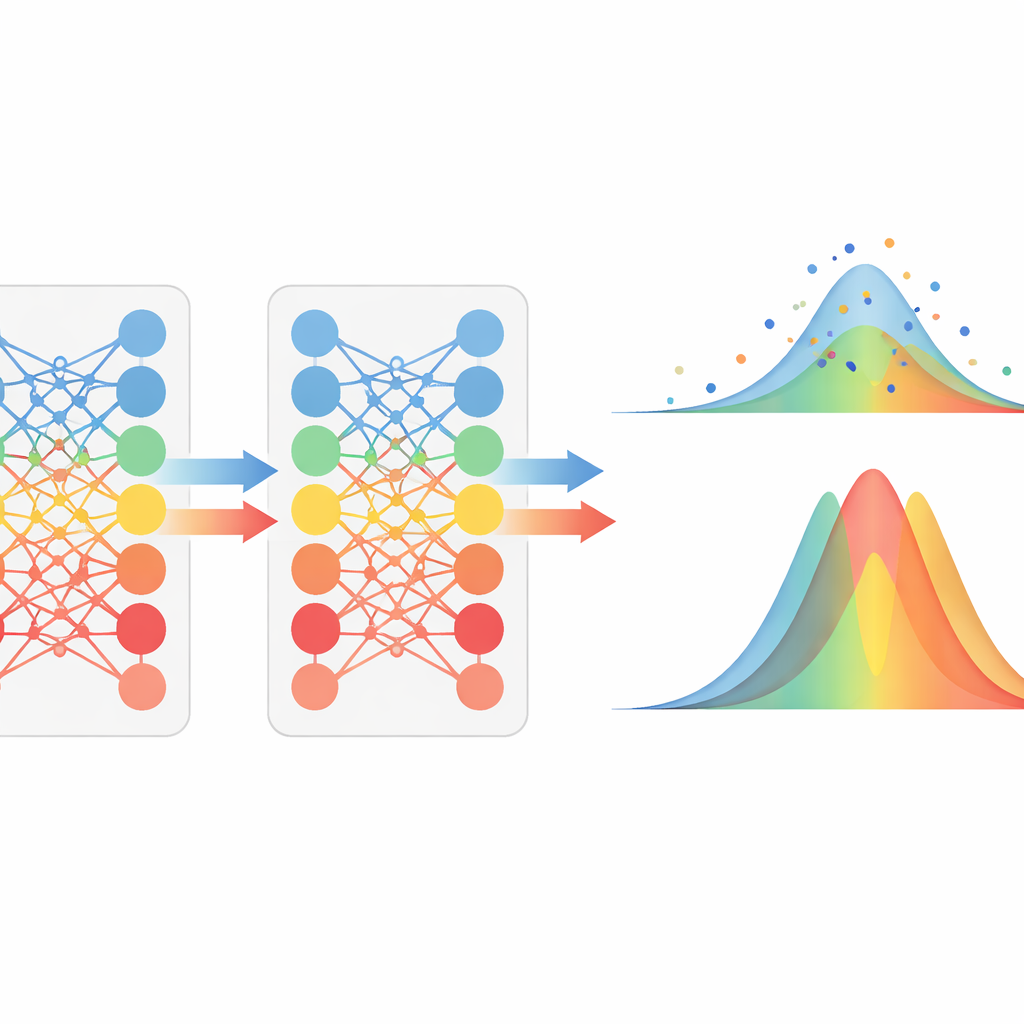

Per verificare fino a che punto questo approccio può arrivare, il team ha esaminato scenari molto impegnativi. In uno, i peptidi portavano un’etichetta chimica ingombrante che li rende molto più “untuosi”, spostando fortemente i loro tempi di ritenzione. In un altro, il liquido nella colonna era basico anziché acido, cambiando radicalmente come i peptidi interagiscono con la colonna. In entrambi i casi, la semplice calibrazione di un vecchio modello falliva, e anche un modello addestrato ex novo necessitava di molti esempi per raggiungere una buona accuratezza. Il transfer learning, invece, si è adattato rapidamente, ottenendo prestazioni simili o migliori con due-tre volte meno peptidi di addestramento. Il metodo ha anche migliorato le predizioni per un ampio pannello di modifiche post-traduzionali mai viste durante l’addestramento, indicando che la conoscenza precedente del modello sulla chimica dei peptidi si trasferisce a nuove modifiche.

Cosa significa per i futuri studi sulle proteine

Per i non specialisti, il messaggio centrale è che riutilizzare ciò che una rete neurale ha già appreso sul comportamento dei peptidi rende molto più semplice ottenere predizioni temporali precise in nuove condizioni sperimentali. Invece di raccogliere faticosamente grandi set di addestramento o accettare prestazioni scarse dalla calibrazione semplice, i ricercatori possono rifinire un modello DeepLC esistente con un numero modesto di esempi e ottenere comunque tempi di ritenzione altamente accurati. Questo rende gli strumenti di predizione avanzati più robusti e accessibili, permettendo analisi affidabili attraverso diversi strumenti, condizioni chimiche e modifiche peptidiche rare, e in ultima analisi aiutando gli scienziati a leggere il mondo delle proteine con maggiore chiarezza ed efficienza.

Citazione: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Parole chiave: proteomica, cromatografia liquida, predizione del tempo di ritenzione, deep learning, transfer learning