Clear Sky Science · it

Meccanismi computazionali neurone-per-neurone della codifica visiva degli oggetti nel lobo temporale umano

Come il cervello sa quello che stiamo guardando

Ogni volta che dai uno sguardo a una strada affollata, il tuo cervello ti dice all’istante quali forme sono persone, quali sono automobili e quali sono segnali, anche se sono parzialmente nascosti o stranamente illuminati. Questo articolo pone una domanda apparentemente semplice: come trasforma il cervello umano l’ondata di dettagli visivi grezzi che colpisce i nostri occhi in idee stabili come “cane” o “tazza” che possiamo riconoscere, ricordare e nominare?

Dalle immagini dettagliate alle cose significative

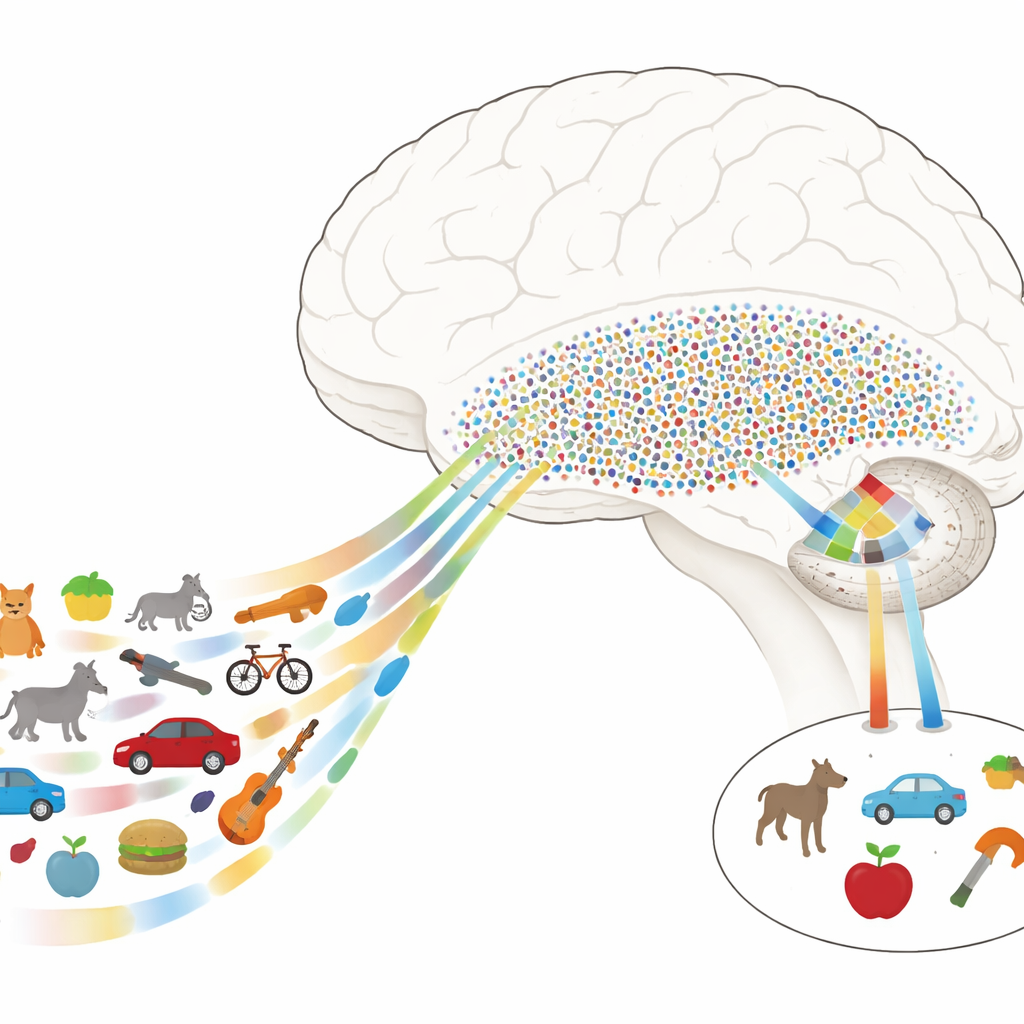

I ricercatori sanno che il riconoscimento degli oggetti dipende molto da una catena di aree situate nella parte inferiore del cervello chiamata via visiva ventrale. Le fasi iniziali elaborano caratteristiche semplici come contorni e texture, mentre le fasi successive si occupano più di oggetti interi e del loro significato. Negli esseri umani, un tratto chiave di questo percorso è la corteccia temporale ventrale (VTC), e subito a valle si trova il lobo temporale mediale (MTL), cruciale per la memoria. Il mistero è stato capire come il cervello passi dalle descrizioni dettagliate e di tipo fotografico del VTC ai codici sparsi e concettuali dell’MTL, che permettono a poche cellule di rappresentare molte viste diverse dello stesso oggetto.

Una mappa neurale dello spazio degli oggetti

Gli autori hanno registrato l’attività elettrica direttamente dal cervello di pazienti epilettici ai quali erano già stati impiantati elettrodi per motivi clinici. Mentre i pazienti eseguivano un compito semplice, hanno visto centinaia di immagini naturali estratte da molte categorie — animali, strumenti, cibi, veicoli, piante e altro. Nella VTC, i ricercatori hanno rilevato che le risposte potevano essere descritte come combinazioni di poche direzioni di caratteristica chiave, o “assi”, come quanto qualcosa appare naturale rispetto a artificiale, o quanto è animato rispetto a inanimato. Combinando matematicamente questi assi, hanno costruito uno “spazio di caratteristiche neurali” in cui ogni immagine occupa una posizione, e oggetti simili si raggruppano anche se differiscono nei dettagli di basso livello.

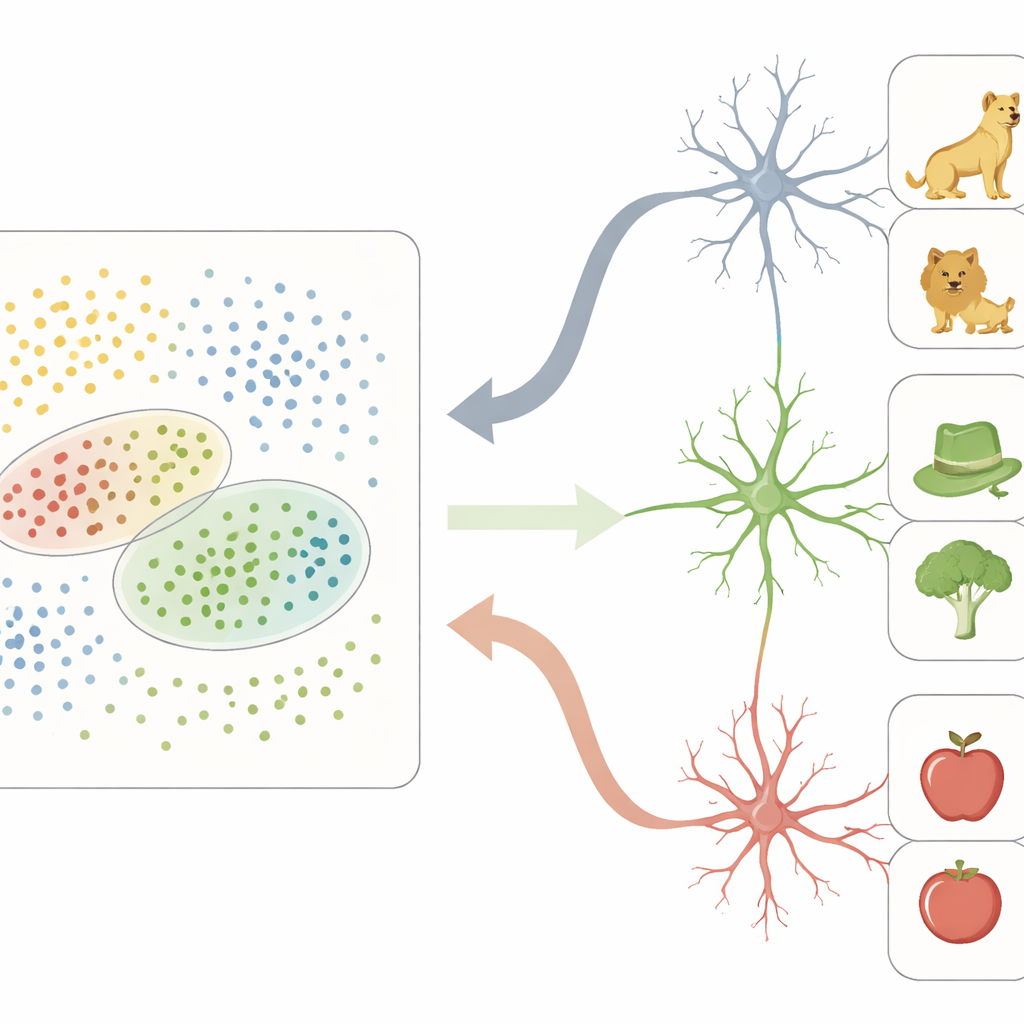

Dalle griglie dense di caratteristiche ai nodi concettuali sparsi

In questo spazio di caratteristiche neurali, la VTC agisce come una griglia densa: molti siti partecipano a rappresentare ciascun oggetto, codificando differenze visive fini. Al contrario, i neuroni registrati singolarmente nell’MTL si comportavano in modo molto diverso. Invece di seguire caratteristiche individuali, molte di queste cellule rispondevano intensamente solo agli oggetti che ricadevano in particolari regioni dello spazio delle caratteristiche della VTC. Ciascun neurone aveva effettivamente un “campo recettivo” non nello spazio fisico, ma in questa mappa astratta delle proprietà degli oggetti. Gli oggetti che cadevano all’interno della regione preferita di un neurone spesso condividevano sia tratti percettivi (per esempio forme arrotondate o colori tendenti al verde) sia significati di livello superiore (come l’essere organismi viventi o strumenti), inducendo quel neurone a sparare in modo sparso ma selettivo.

Collegare visione e memoria

Per dimostrare che non si tratta solo di un artificio matematico, il gruppo ha esaminato come queste aree cerebrali interagiscono in tempo reale. Hanno trovato che i siti della VTC che trasportavano forti segnali sugli assi delle caratteristiche erano particolarmente sincronizzati con siti sensibili alle categorie nell’MTL, soprattutto in certe oscillazioni ritmiche cerebrali. L’informazione tendeva a fluire dalla VTC all’MTL a frequenze più basse associate all’elaborazione feedforward, mentre il feedback dall’MTL alla VTC viaggiava su frequenze leggermente più alte. Crucialmente, quando un neurone dell’MTL era sintonizzato su una specifica regione dello spazio delle caratteristiche, i suoi spike si allineavano con ritmi rapidi nella VTC, e questo accoppiamento risultava più forte per le stesse immagini codificate da quel neurone. Un secondo insieme di esperimenti, usando una diversa raccolta di immagini, ha confermato che sia la mappa di caratteristiche della VTC sia la sintonizzazione delle regioni nell’MTL erano stabili attraverso set di stimoli differenti.

Perché questo importa per vedere e ricordare nella vita quotidiana

Nel loro insieme, questi risultati supportano una storia computazionale concreta: la VTC distribuisce gli oggetti visivi lungo assi di caratteristiche significative, formando un paesaggio ricco e continuo, e l’MTL piazza piccoli “puntatori” selettivi su regioni di questo paesaggio. Questa trasformazione converte un codice-immagine dettagliato e distribuito in un codice-concetto sparso, più facile da memorizzare, recuperare e combinare con altri ricordi. Per un pubblico non specialistico, la conclusione è che riconoscere un cane in una notte piovosa non è una semplice ricerca in un elenco, ma il risultato di un processo stratificato e cooperativo in cui una parte del cervello costruisce una mappa strutturata di apparenze e un’altra parte impara a segnare e leggere regioni di quella mappa come idee distinte e durature.

Citazione: Cao, R., Zhang, J., Zheng, J. et al. Computational single-neuron mechanisms of visual object coding in the human temporal lobe. Nat Commun 17, 2234 (2026). https://doi.org/10.1038/s41467-026-68954-8

Parole chiave: riconoscimento degli oggetti, corteccia temporale ventrale, lobo temporale mediale, codifica neurale, memoria visiva