Clear Sky Science · it

Lavoro squadra umano-AI per migliorare accuratezza ed efficienza del preselezionamento dei criteri di idoneità per studi oncologici: uno studio randomizzato di valutazione su cartelle cliniche elettroniche retrospettive

Perché trovare i pazienti giusti è importante

Per molte persone con cancro, partecipare a uno studio clinico può aprire la porta a terapie all’avanguardia e a risultati migliori. Eppure solo una piccola frazione degli adulti con cancro si iscrive mai a uno studio. Un importante collo di bottiglia si verifica molto prima che un paziente firmi il consenso: il personale deve scavare in cartelle cliniche lunghe e disordinate per capire chi è effettivamente idoneo. Questo studio verifica se affiancare esperti umani a un sistema di intelligenza artificiale può rendere quel primo screening più accurato—senza rallentare il processo.

Come funziona oggi lo screening per gli studi

Prima che una persona possa entrare in uno studio oncologico, il personale di ricerca clinica deve stabilire se il paziente soddisfa decine di regole d’ingresso dettagliate, come tipo e stadio del cancro, risultati di test e stato funzionale quotidiano. Gran parte di queste informazioni è sepolta in note non strutturate—referti radiologici, visite ambulatoriali, riepiloghi di laboratorio—che spesso sono ripetitive, incomplete o contraddittorie. Esaminare manualmente questi documenti è lento e faticoso, e anche personale esperto può perdere dettagli chiave. Di conseguenza, alcuni pazienti idonei non vengono mai identificati e si perdono opzioni potenzialmente salvavita.

Cosa hanno testato i ricercatori

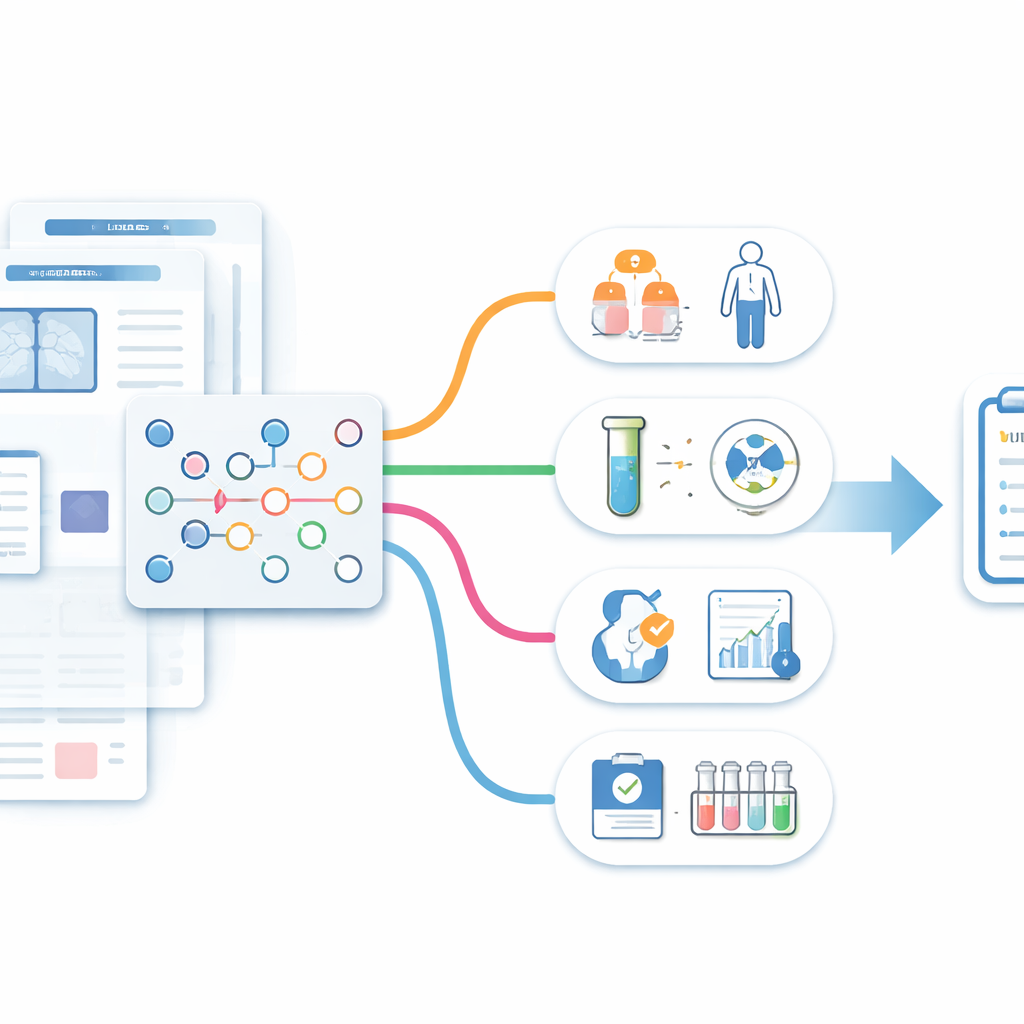

Per verificare se l’AI potesse aiutare, il team ha usato le cartelle elettroniche di 355 persone con cancro al polmone o del colon-retto trattate in una pratica clinica territoriale. Si sono concentrati su 12 criteri comuni degli studi, compresi lo stadio del tumore, biomarcatori specifici, risposta a trattamenti precedenti e condizioni di salute di base. Un sistema linguistico “neurosimbolico” specializzato ha prima convertito gli archivi scansionati in testo, quindi ha identificato fatti strutturati come risultati di test e dettagli di stadiazione. Due coordinatori di ricerca addestrati hanno quindi rivisto ogni cartella due volte—una con suggerimenti dell’AI sullo schermo (approccio Uomo+AI) e una senza (approccio Solo umano), in ordine casuale. Un gruppo separato di clinici aveva già creato una chiave di risposte “gold standard” per ogni cartella per valutare l’accuratezza.

Come ha performato il team umano–AI

Quando umani e AI hanno lavorato insieme, hanno corrisposto alle risposte gold-standard più spesso rispetto agli umani da soli. Complessivamente, il team Uomo+AI ha ottenuto circa tre dettagli corretti su quattro, rispetto a poco più di sette su dieci per i revisori umani da soli, e molto meglio rispetto al sistema AI autonomo. I guadagni maggiori si sono registrati in aree delicate come i test dei biomarcatori e i relativi risultati, la stadiazione precisa del tumore e la risposta del paziente a trattamenti precedenti. In queste categorie, la capacità dell’AI di setacciare grandi volumi di testo ha aiutato i coordinatori a individuare informazioni che altrimenti avrebbero potuto trascurare, mentre gli umani hanno corretto gli errori dell’AI e interpretato i casi incerti.

Velocità, compromessi e bias umano

In modo sorprendente, l’aggiunta dell’AI non ha reso il processo più veloce. Entrambi gli approcci hanno richiesto in media poco più di mezz’ora per cartella. Gli autori suggeriscono che, invece di far risparmiare tempo, l’AI ha spostato il lavoro dei coordinatori: invece di cercare ogni dettaglio da zero, hanno passato più tempo a verificare e interpretare le voci suggerite dall’AI. Questo può essere a sua volta una salvaguardia utile, riducendo il rischio che le persone accettino semplicemente le risposte della macchina senza metterle in discussione. Lo studio ha anche esplorato dove la collaborazione può fallare. In una misura dello stato funzionale del paziente, l’AI si è dimostrata inaffidabile, e i revisori umani che si sono affidati troppo ai suoi output hanno fatto leggermente peggio—un segnale di “bias da automazione”. In altre aree, gli umani sembravano sottoutilizzare segnali AI accurati, indicando un “bias di conferma”, in cui le persone preferiscono informazioni che confermano le loro impressioni iniziali.

Cosa significa per la futura cura del cancro

In termini chiari, questo trial mostra che una partnership ben progettata tra persone e AI può rendere il preselezionamento per gli studi un po’ più accurato senza rallentarlo. I miglioramenti sono modesti, ma concentrati proprio nei tipi di dettagli complessi—come lo stato dei biomarcatori e la stadiazione precisa—che spesso decidono se un paziente può entrare in uno studio. Se tali sistemi vengono ulteriormente perfezionati e testati nei flussi di lavoro clinici attivi, potrebbero aiutare a individuare più pazienti idonei, ampliare chi ha accesso a studi oncologici all’avanguardia e farlo mantenendo gli esseri umani saldamente responsabili delle decisioni finali.

Citazione: Parikh, R.B., Kolla, L., Beothy, E.A. et al. Human-AI teaming to improve accuracy and efficiency of eligibility criteria prescreening for oncology trials: a randomized evaluation trial using retrospective electronic health records. Nat Commun 17, 2306 (2026). https://doi.org/10.1038/s41467-026-68873-8

Parole chiave: studi clinici sul cancro, cartelle cliniche elettroniche, intelligenza artificiale, idoneità del paziente, collaborazione uomo-AI