Clear Sky Science · it

Addestrare sensori tattili a imparare la misura della forza l’uno dall’altro

Robot che possono sentire e condividere il loro senso del tatto

Man mano che i robot escono dalle fabbriche e entrano nelle case, negli ospedali e nei magazzini, hanno bisogno di un senso che di solito diamo per scontato: il tatto. Proprio come le nostre dita si regolano automaticamente quando afferriamo un chip di patata rispetto a una scatola pesante, i robot del futuro devono imparare quanto stringere e quando un oggetto sta per scivolare. Questo articolo presenta un nuovo modo per la “pelle” robotica di apprendere la misura della forza da altre pelli, riducendo costose calibrazioni e avvicinando le macchine a una destrezza simile a quella umana.

Perché è così difficile ottenere un tatto robotico accurato

I robot moderni dispongono già di molti tipi di pelle artificiale. Alcuni usano minuscole telecamere che osservano gel morbidi, altri si basano su magneti o su griglie elettroniche che rilevano la pressione. Ogni progetto eccelle in certi compiti, ma parlano tutti “dialetti” diversi del tatto: la stessa pressione su due sensori può produrre segnali molto diversi. Oggi, ogni nuovo sensore di solito richiede il proprio laborioso processo di addestramento con misuratori di forza precisi, ripetuto migliaia di volte. Peggio ancora, i materiali morbidi invecchiano e si usurano, perciò questa costosa calibrazione va ripetuta ogni volta che un sensore viene sostituito.

Prendere spunto dal cervello umano

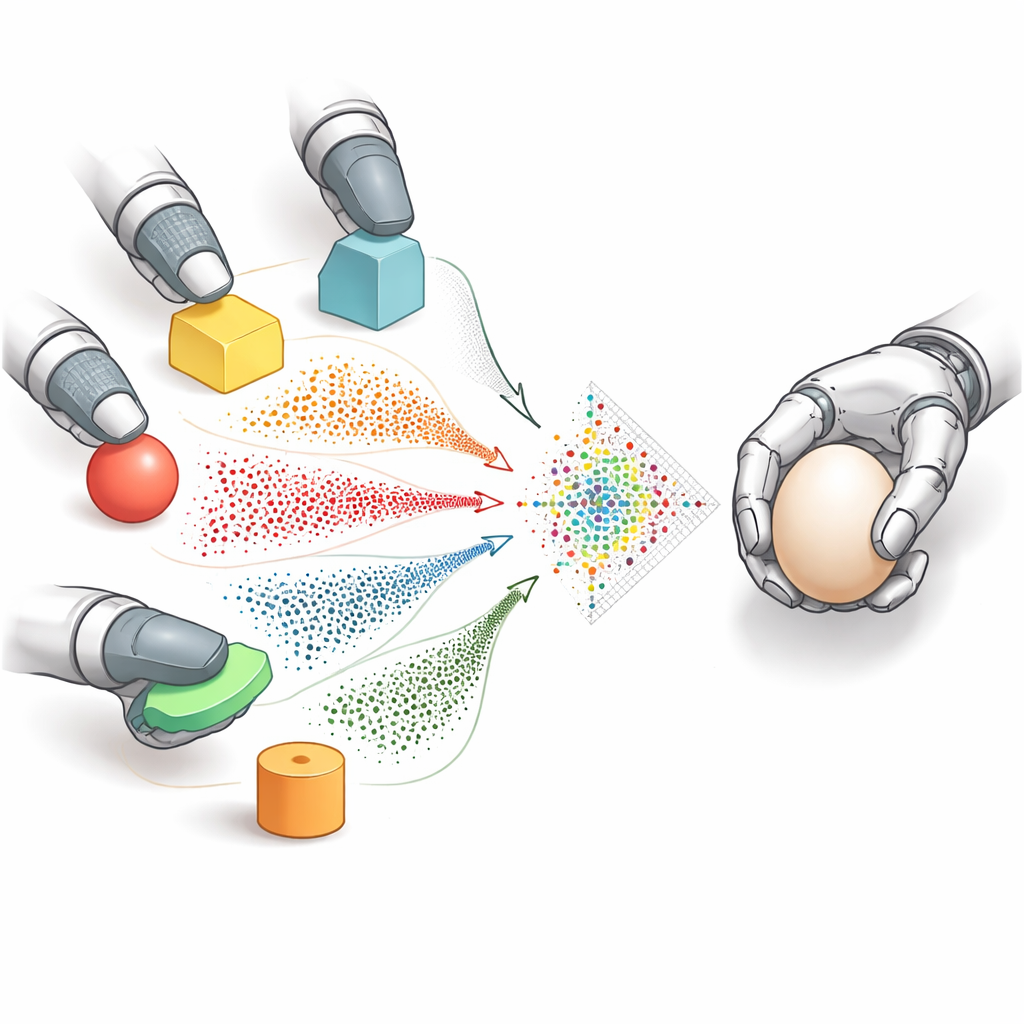

Gli esseri umani risolvono un problema simile con facilità. La nostra pelle è piena di diversi tipi di recettori del tatto, eppure il cervello converte tutti i loro segnali in un codice interno condiviso. Quella memoria tattile unificata ci permette di stimare come qualcosa si sentirebbe su una parte della mano che non l’ha mai toccata prima, attingendo semplicemente alle esperienze precedenti. I ricercatori dietro questo lavoro imitano quell’idea nei robot. Convertono tutte le uscite dei sensori—immagini di camera, letture magnetiche o segnali elettronici—in una forma comune simile a un’immagine fatta di punti, che rappresentano come la pelle si sta deformando. Questa rappresentazione condivisa a marker agisce come un semplice “linguaggio del tatto” che qualsiasi sensore può usare.

Insegnare a un sensore a imitare un altro

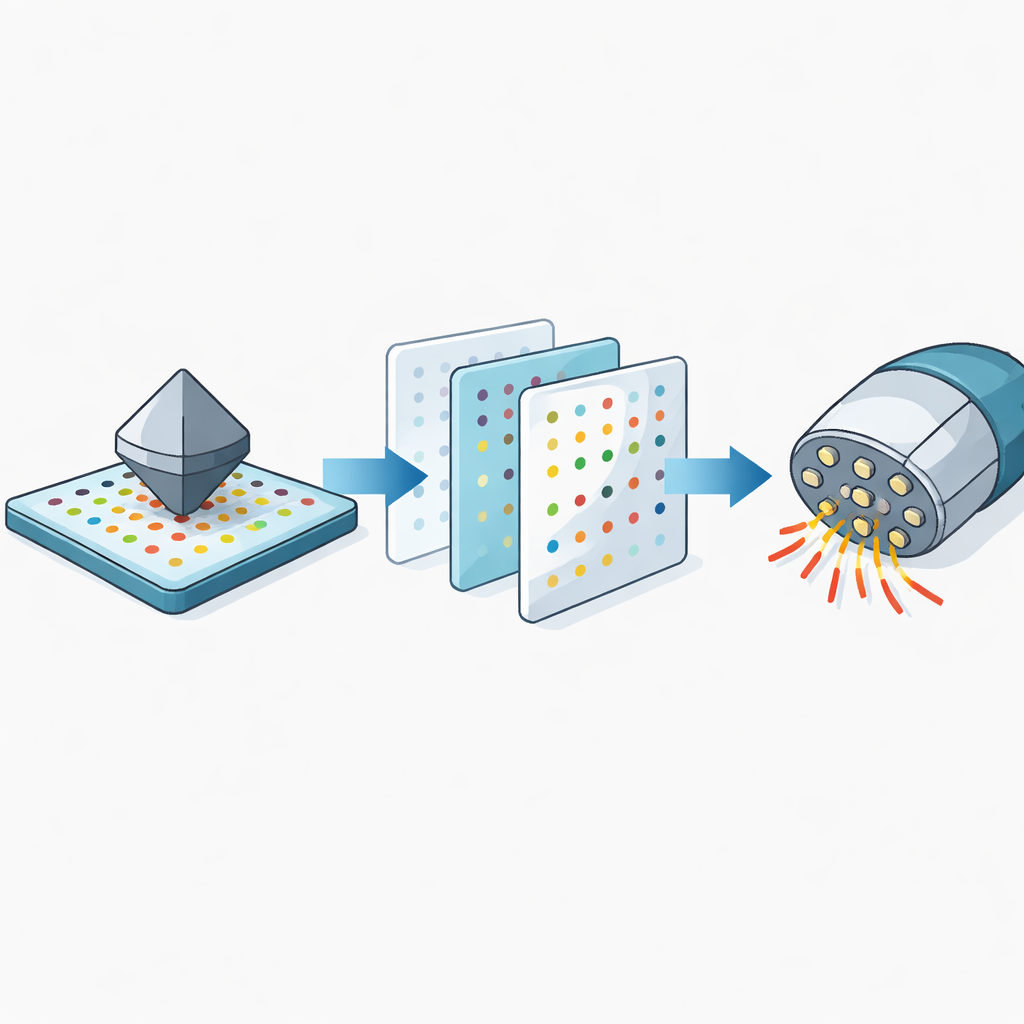

Una volta che tutti i sensori parlano questo linguaggio a punti, il team introduce una fase di traduzione chiamata marker-to-marker translation. Utilizzando potenti modelli generativi, addestrano un sistema che può trasformare il modello a punti di un sensore nel modello che un altro sensore avrebbe mostrato sotto lo stesso contatto. Ciò significa che un sensore ben calibrato può efficacemente “immaginare” cosa proverebbe un sensore non calibrato e generare dati sintetici di addestramento per esso. Un secondo modello poi analizza brevi sequenze di queste immagini a punti per prevedere come le forze cambiano nel tempo nelle tre direzioni, tenendo conto sia della pressione che delle forze di scorrimento laterali.

Affrontare le differenze reali nei materiali morbidi

In pratica, le diverse pelli robotiche non sono solo sagomate e cablate in modo diverso; sono anche fatte di materiali che possono essere più morbidi o più rigidi e che cambiano con l’invecchiamento. Queste differenze possono distorcere le stime della forza anche se i pattern sembrano simili. I ricercatori misurano come ogni tipo di materiale morbido si deforma sotto carico e costruiscono un semplice passaggio di correzione che scala le etichette di forza verso l’alto o verso il basso prima dell’addestramento. Questa compensazione del materiale riduce notevolmente gli errori, specialmente quando si trasferisce conoscenza tra pelli molto morbide e molto rigide.

Dai banchi di prova alla manipolazione quotidiana

Il team testa il loro metodo, chiamato GenForce, su un’ampia mescola di sensori, da più copie dello stesso pad a base di telecamera a design molto diversi che usano magneti o forme curve simili a punte di dito. In oltre 200 combinazioni in simulazione e su hardware, GenForce riduce nettamente gli errori di previsione rispetto al riutilizzo semplice di un modello addestrato su un altro sensore. Nelle dimostrazioni, una mano robotica equipaggiata con diverse pelli tattili su ogni dito usa modelli trasferiti per afferrare delicatamente oggetti fragili come frutta e chips di patata e per rilevare e correggere oggetti che scivolano coordinando le letture da entrambi i lati di una presa.

Cosa significa questo per il futuro delle mani robotiche

Permettendo ai sensori tattili di apprendere la misura della forza l’uno dall’altro invece di partire da zero, GenForce indica mani robotiche più facili ed economiche da distribuire su larga scala. Un singolo sensore attentamente calibrato potrebbe addestrarne molti altri, anche di design diversi, e i modelli pre-addestrati potrebbero essere adattati con solo una piccola quantità di nuovi dati. Per i non specialisti, la conclusione è semplice: questo lavoro rende più pratico per i robot percepire quanto stanno stringendo e rispondere rapidamente quando gli oggetti iniziano a scivolare, avvicinandoci a macchine che maneggiano il mondo reale con la stessa sicurezza tattile delle mani umane.

Citazione: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Parole chiave: tatto robotico, sensori tattili, rilevamento della forza, manipolazione robotica, transfer learning