Clear Sky Science · it

Percezione visiva ultrarapida oltre le capacità umane resa possibile dall’analisi del movimento mediante transistor sinaptici

Perché una visione robotica più veloce è importante

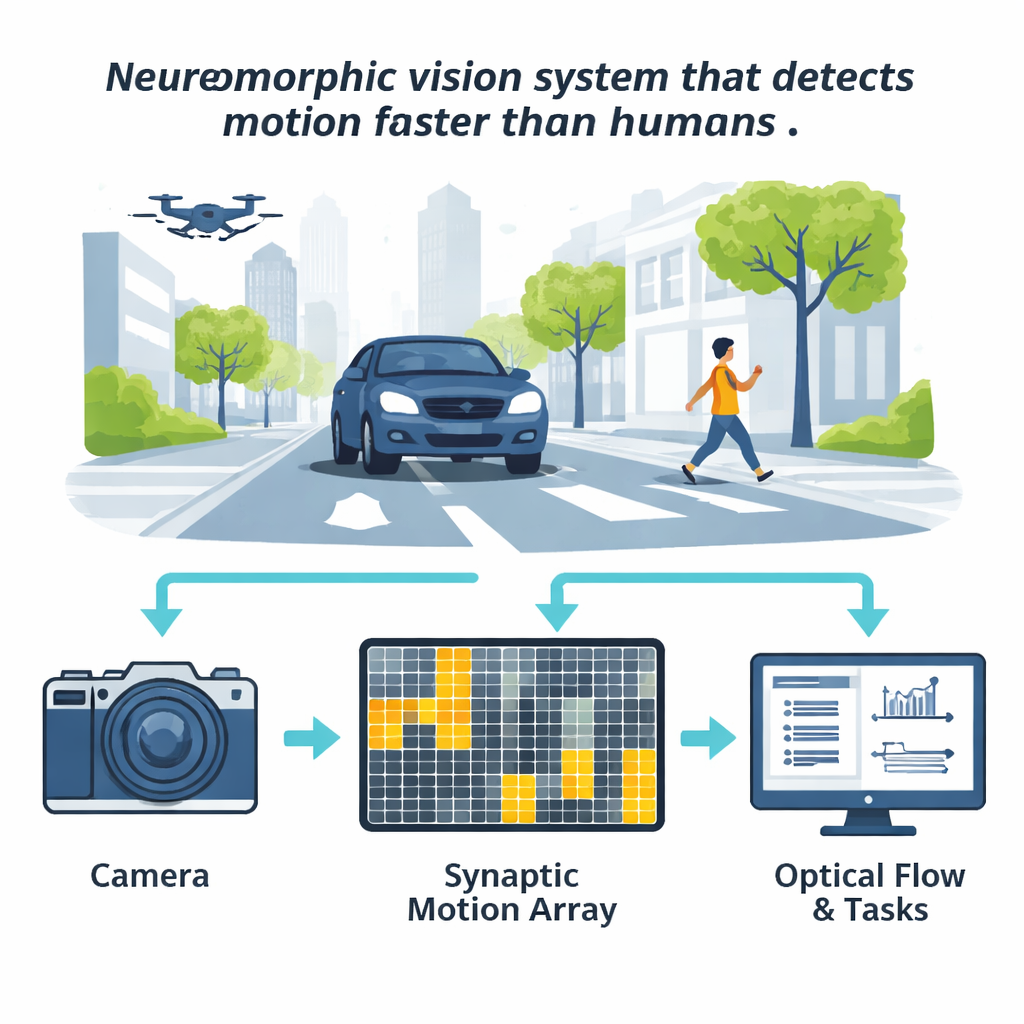

Quando il sistema di guida autonoma di un’auto o un drone reagisce anche solo una frazione di secondo troppo tardi, le conseguenze possono essere gravi. I migliori algoritmi di visione artificiale odierni possono eguagliare o superare gli esseri umani nei test standard, ma impiegano ancora troppo tempo per elaborare ogni fotogramma video in tempo reale. Questo articolo presenta un nuovo tipo di hardware visivo, ispirato al cervello, che consente alle macchine di rilevare il movimento molto più rapidamente rispetto all’uomo, senza sacrificare l’accuratezza.

Come normalmente insegniamo alle macchine a vedere il movimento

L’analisi del movimento convenzionale si basa su una tecnica chiamata flusso ottico, che stima come ogni punto in un’immagine si sposta da un fotogramma al successivo. Funziona bene ma è computazionalmente onerosa: per un’immagine in alta definizione completa, una potente scheda grafica può impiegare più di mezzo secondo per completare il calcolo. In scenari ad alta velocità, come la guida in autostrada, questo ritardo può tradursi in decine di metri percorsi prima che il sistema riconosca un pericolo. Diversamente dal sistema visivo umano, che si concentra rapidamente sulle parti più rilevanti di una scena, gli algoritmi standard processano scrupolosamente ogni pixel, anche nelle regioni di sfondo statico che contengono poche informazioni utili.

Prendere in prestito un trucco dalle prime fasi della visione biologica

La biologia risolve questo problema usando strati di filtraggio precoci nell’occhio e nel talamo per evidenziare dove avvengono i cambiamenti e attenuare il resto. Gli autori imitano questa idea nel silicio costruendo un modulo neuromorfico di “attenzione temporale”. Una normale videocamera continua a catturare le immagini, ma anche le variazioni di luminosità vengono inviate a una griglia compatta di transistor sinaptici—dispositivi elettronici che si comportano un po’ come connessioni regolabili nel cervello. Ogni dispositivo accumula localmente quanto la luce nella sua regione assegnata è cambiata in una breve finestra temporale. Le porzioni della griglia che registrano forti variazioni si illuminano come regioni di interesse, mentre le aree più calme svaniscono nello sfondo.

Transistor intelligenti che ricordano il movimento

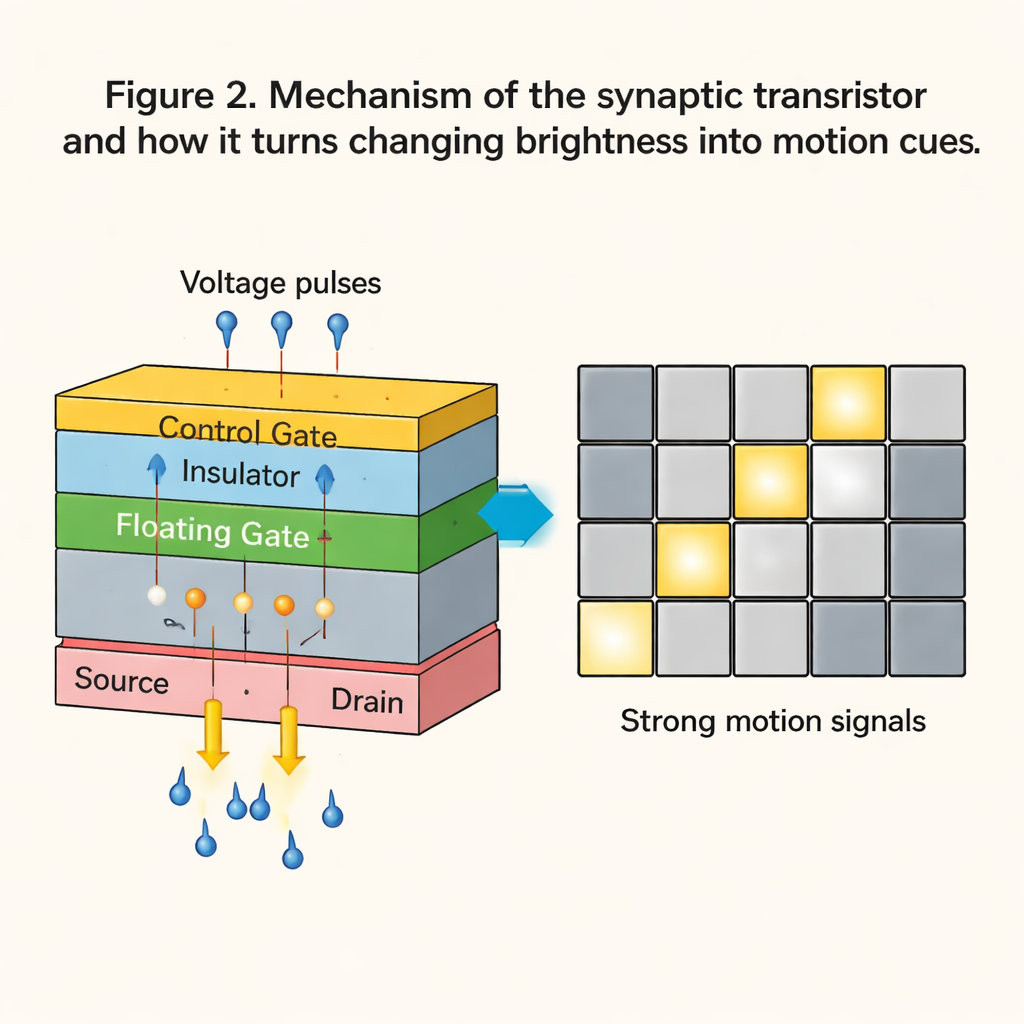

Al cuore del sistema c’è un transistor sinaptico a gate flottante appositamente progettato, realizzato con materiali stratificati di spessore atomico. Applicando brevi impulsi di tensione, si può regolare la conduttanza del dispositivo e mantenerla per ore, memorizzando di fatto l’attività visiva recente. I transistor rispondono in circa 100 microsecondi—abbastanza rapidi per video ad alta velocità—e resistono a migliaia di cicli di aggiornamento senza degradarsi. Il team ha scalato un singolo dispositivo in una matrice 4×4 e ha mostrato come le variazioni di luminosità della fotocamera vengano convertite in impulsi di tensione che spingono selettivamente alcune celle in stati di alta conduttanza «di movimento» mentre sopprimono fenomeni di flicker e rumore minori.

Concentrare i calcoli pesanti solo dove conta

L’output della matrice viene trasformato in una grossolana «mappa di calore» del movimento che segna regioni compatte di interesse. Invece di eseguire il costoso codice di flusso ottico sull’intera immagine, il sistema analizza solo queste aree evidenziate, con un piccolo margine attorno a esse. Gli autori dimostrano che questo approccio si integra direttamente con diversi metodi di flusso ottico popolari, da algoritmi classici come Farneback a modelli di deep learning moderni come RAFT e GMFlow. Nei test su auto, droni, bracci robotici e sport veloci come il ping-pong, il front end neuromorfico riduce abitualmente il tempo speso per la stima del movimento e i compiti successivi—come prevedere dove si sposterà un oggetto, segmentare gli oggetti in movimento dallo sfondo o tracciare un bersaglio—di circa un fattore quattro.

Superare la reazione umana senza perdere accuratezza

Fondamentalmente, questo aumento di velocità non avviene a scapito dell’affidabilità. Fornendo informazioni aggiuntive su dove è probabile che si verifichi movimento, gli indizi temporali spesso migliorano l’accuratezza, in particolare per il tracking degli oggetti e la segmentazione in scene affollate. In scenari con veicoli e piccoli droni, le metriche di performance del compito sono più che raddoppiate rispetto alle pipeline convenzionali, mentre i tempi di elaborazione totali sono scesi nell’ordine delle decine di millisecondi—alla pari o migliori dei tempi di reazione umani tipici di circa 150 millisecondi. Gli autori sostengono che questo front end neuromorfico per il movimento possa essere abbinato a molti algoritmi visivi esistenti, e persino a rivelatori di oggetti oltre il flusso ottico, per offrire a robot, veicoli e macchine interattive un modo molto più rapido e mirato di comprendere ambienti dinamici.

Citazione: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Parole chiave: visione neuromorfica, flusso ottico, transistor sinaptici, percezione robotica, guida autonoma