Clear Sky Science · it

Calcolo analogico in memoria per la fattorizzazione di matrici non negative

Perché scomporre i big data in parti è importante

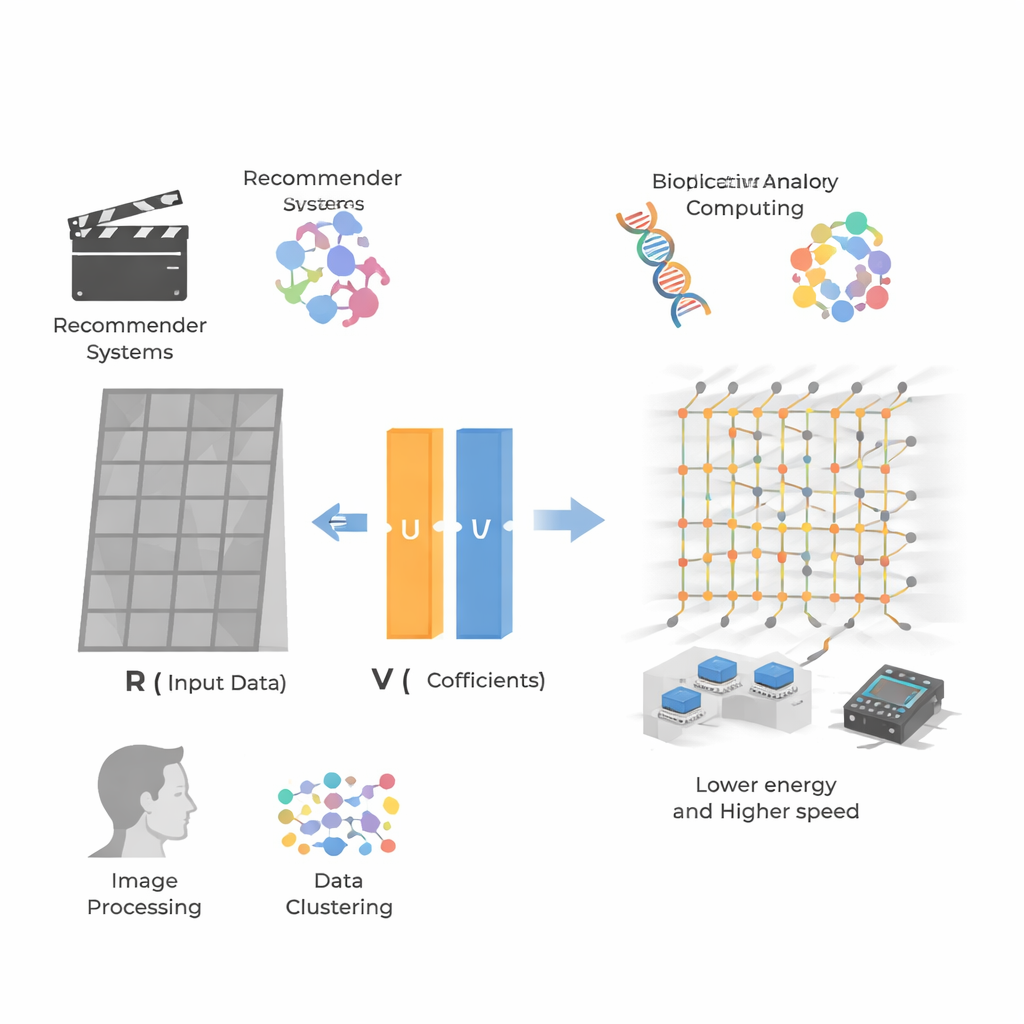

Servizi quotidiani come i suggerimenti di film, le app fotografiche e l’analisi genetica si basano tutti sulla ricerca di pattern nascosti all’interno di enormi tabelle di numeri. Un metodo diffuso per farlo è la fattorizzazione di matrici non negative (NMF), che scompone una grande tabella di dati in blocchi più semplici e più interpretabili. Ma quando i set di dati raggiungono milioni di utenti, elementi o pixel, i chip digitali attuali possono faticare a garantire risultati in tempo reale. Questo articolo mostra come un approccio analogico in memoria possa eseguire questi pesanti calcoli matematici molto più velocemente e con consumi energetici molto ridotti, aprendo la strada a servizi guidati dall’IA più reattivi ed efficienti.

Estrarre pattern da tabelle giganti

Al centro del lavoro c’è la fattorizzazione di matrici non negative (NMF), un metodo che prende una grande griglia di numeri non negativi—come valutazioni utente‑film o valori di pixel di un’immagine—e la riscrive come prodotto di due griglie più piccole. Una griglia rappresenta “caratteristiche” nascoste (per esempio, il gusto di un utente per l’azione rispetto al romanticismo) e l’altra indica quanto intensamente ogni elemento o pixel esprime quelle caratteristiche. Poiché tutti i valori restano non negativi, queste caratteristiche tendono ad apparire come parti intuitive: componenti facciali nelle immagini o profili di preferenza nei dati di raccomandazione. Questo rende la NMF popolare nei sistemi di raccomandazione, nella bioinformatica, nell’elaborazione delle immagini e nel clustering, ma la rende anche computazionalmente impegnativa per set di dati molto grandi e sparsi.

Perché i chip digitali incontrano un limite

I processori tradizionali—CPU, GPU e persino FPGA—trattano le operazioni sulle matrici come lunghe sequenze di semplici passaggi, spostando i dati avanti e indietro tra memoria e unità di calcolo. Per problemi modesti questo funziona bene, ma per set di dati moderni con milioni di righe e colonne il costo in tempo ed energia diventa enorme. Il rallentamento della legge di Moore e il cosiddetto collo di bottiglia di von Neumann, dove l’accesso alla memoria domina consumo e ritardo, rendono sempre più difficile scalare la NMF per applicazioni in tempo reale come raccomandazioni live o analisi rapide delle immagini. Anche gli algoritmi digitali più astuti affrontano complessità in tempo polinomiale e un intenso traffico di memoria ogni volta che le matrici devono essere aggiornate ripetutamente.

Calcolare dentro la memoria con segnali analogici

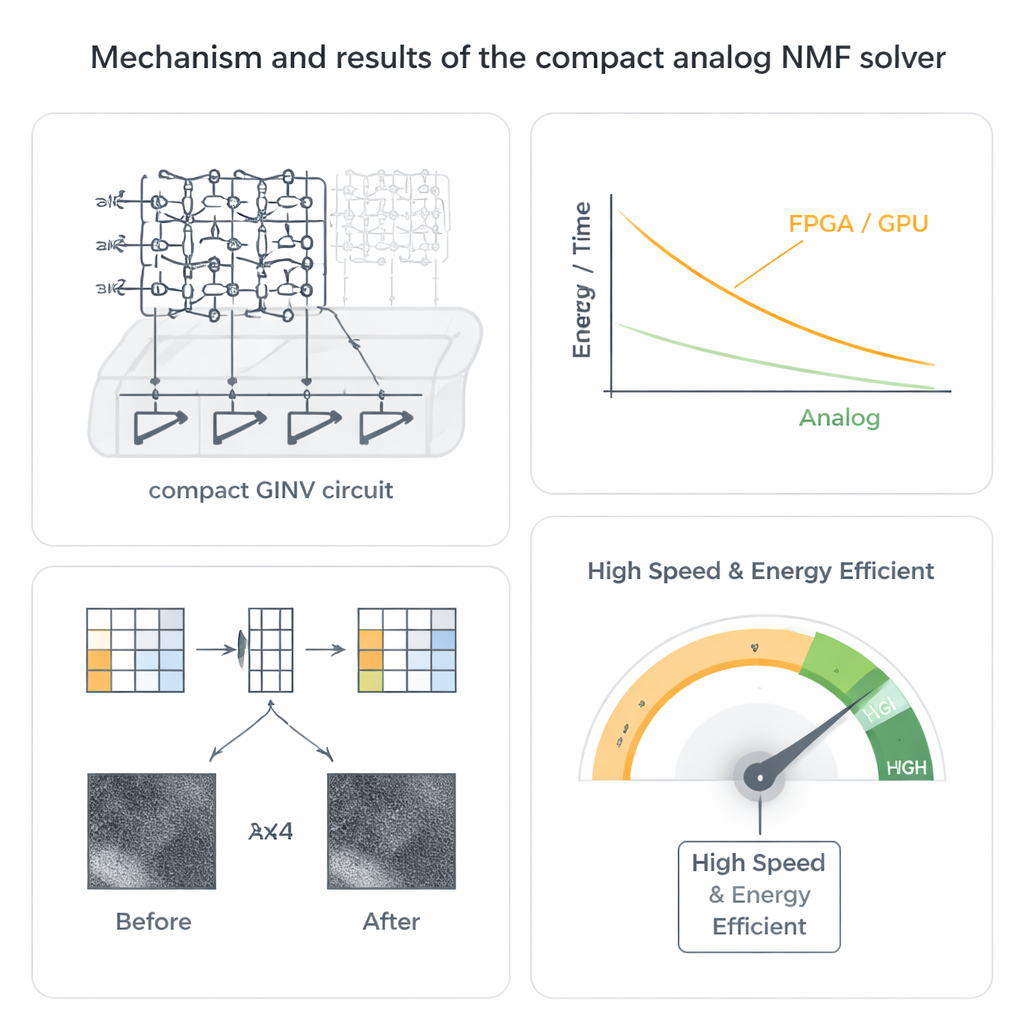

Gli autori seguono una strada diversa usando il calcolo matriciale analogico basato su dispositivi di memoria resistiva noti come memristori. Questi dispositivi possono essere disposti in dense matrici a incrocio (crossbar) dove ogni giunzione memorizza un valore di conduttanza. Quando si applicano tensioni su un lato della matrice, le correnti che scorrono dall’altro lato eseguono in modo naturale molte operazioni di moltiplicazione e somma in parallelo. Collegando queste matrici in un loop chiuso con un piccolo numero di amplificatori operazionali, il team costruisce un circuito compatto di inverso generalizzato (GINV) che risolve interi problemi di regressione sostanzialmente in un singolo passo analogico, invece che in molte iterazioni digitali. Affinano il progetto con uno schema di compensazione della conduttanza che mantiene il circuito stabile riducendo drasticamente il numero di amplificatori, risparmiando area sul chip e potenza.

Dal trucco matematico all’hardware funzionante

Per rendere questo pratico per la NMF, i ricercatori abbinano il loro circuito GINV compatto con una strategia ben nota chiamata alternate non‑negative least squares. Invece di cercare di risolvere entrambe le matrici fattore contemporaneamente—un problema non convesso e difficile—il metodo migliora alternativamente una matrice mantenendo l’altra fissa, spezzando il compito in una catena di problemi di regressione non negativa più semplici che il circuito analogico può risolvere. Fabricano array di memristori in ossido di hafnio e costruiscono una piattaforma su circuito stampato, quindi dimostrano due applicazioni chiave. Per la compressione delle immagini, una fotografia di una nebulosa viene divisa in piccole patch che vengono fattorizzate, dimezzando l’archiviazione pur riproducendo l’immagine con una perdita visiva minima. Per i sistemi di raccomandazione, fattorizzano dati di valutazione utente‑elemento come il set MovieLens 100k, predicendo con precisione le valutazioni mancanti nonostante la matrice sia estremamente sparsa.

Velocità, efficienza e robustezza nel mondo reale

Oltre alla correttezza di base, il risolutore analogico mostra vantaggi notevoli in termini di velocità ed energia. Poiché la corrente attraverso la crossbar rappresenta molte operazioni eseguite contemporaneamente, il tempo per risolvere un problema di regressione diventa quasi indipendente dalla dimensione della matrice, in netto contrasto con i metodi digitali. Stime a livello di sistema suggeriscono accelerazioni che vanno da centinaia a migliaia di volte rispetto a implementazioni avanzate su FPGA e GPU, insieme a miglioramenti di diversi ordini di grandezza nell’efficienza energetica. Forse sorprendentemente, la natura analogica dell’hardware non è una debolezza ma un punto di forza: l’algoritmo NMF tollera naturalmente il rumore dei dispositivi e gli errori di programmazione, e nelle simulazioni la qualità finale dell’immagine e delle raccomandazioni rimane elevata anche quando i valori dei memristori sottostanti sono piuttosto imprecisi o tendono a variare con la temperatura.

Cosa significa per la tecnologia di tutti i giorni

In termini semplici, lo studio mostra che un nuovo tipo di “calcolatore in memoria” può gestire uno degli strumenti fondamentali della moderna data science molto più velocemente e in modo più efficiente rispetto ai chip digitali odierni. Integrando la fattorizzazione matriciale direttamente in circuiti analogici compatti, servizi come raccomandazioni in streaming, classifiche di contenuti personalizzate e l’elaborazione delle immagini direttamente sul dispositivo potrebbero infine funzionare in tempo reale consumando molto meno energia. Il lavoro fornisce sia un progetto di circuito sia una prova sperimentale che un tale calcolo analogico in memoria può affrontare set di dati realistici con accuratezza vicina al software a precisione completa, indicando verso hardware futuri in grado di setacciare masse di dati con la stessa facilità con cui la luce attraversa il vetro.

Citazione: Wang, S., Luo, Y., Zuo, P. et al. In-memory analog computing for non-negative matrix factorization. Nat Commun 17, 1881 (2026). https://doi.org/10.1038/s41467-026-68609-8

Parole chiave: calcolo analogico in memoria, fattorizzazione di matrici non negative, crossbar a memristori, compressione delle immagini, sistemi di raccomandazione