Clear Sky Science · it

La memoria a mosaico dei grandi modelli linguistici

Perché contano le copie quasi identiche

I grandi modelli linguistici come ChatGPT apprendono da oceani di testo e talvolta memorizzano parti di quel testo. Questo solleva preoccupazioni sulla privacy, sul copyright e sulla correttezza con cui possiamo valutare ciò che questi sistemi sanno davvero. Questo lavoro mostra che la memorizzazione non riguarda solo il copia‑incolla esatto. Invece, i modelli possono ricostruire passaggi partendo da molte versioni leggermente diverse, un po’ come assemblare un mosaico. Comprendere questo tipo nascosto di memoria è cruciale per chiunque si occupi di un’IA sicura e affidabile.

Un nuovo modo di pensare alla memoria delle macchine

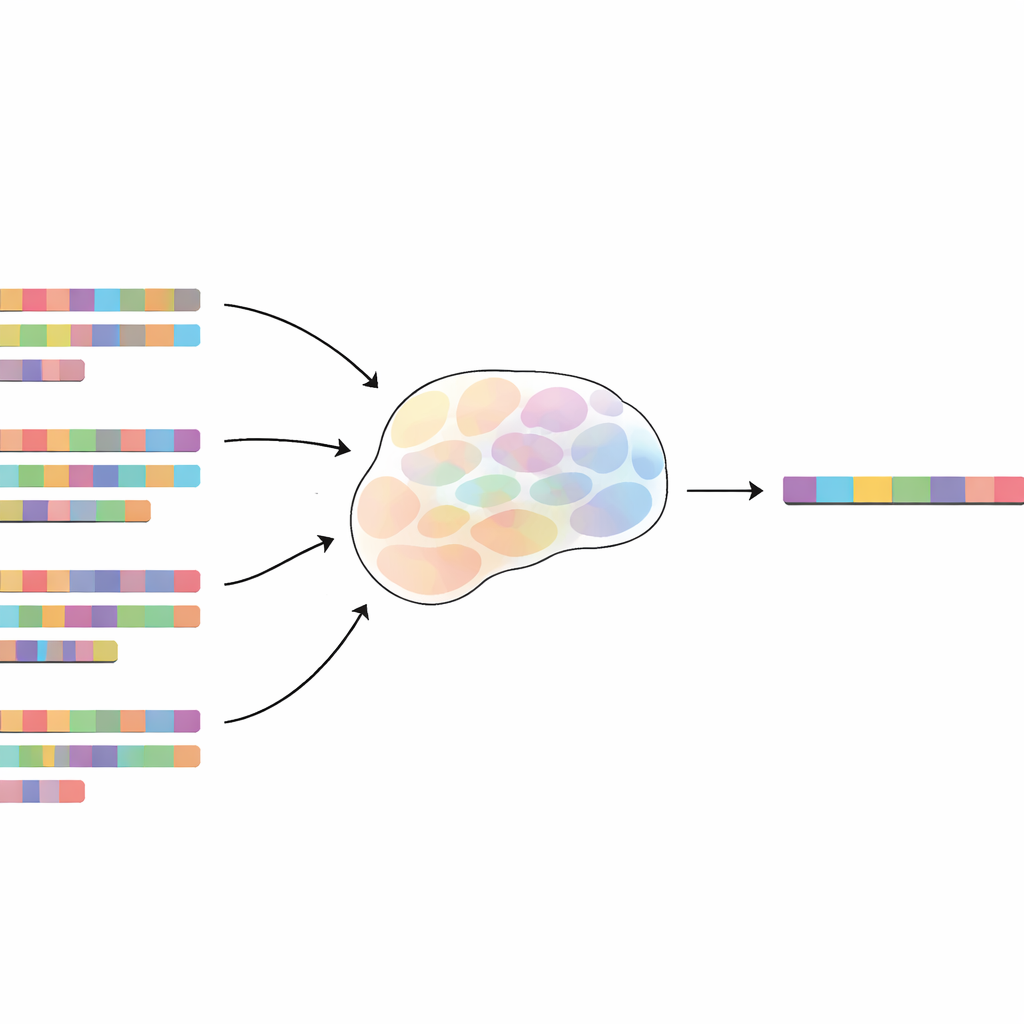

La maggior parte delle persone presume che un modello linguistico memorizzi qualcosa solo se vede la stessa frase esatta più volte. Gli autori mettono in discussione questa visione introducendo la “memoria a mosaico”. In questo quadro, un modello può memorizzare un passaggio di 100 parole non solo grazie a ripetizioni esatte, ma anche grazie a molte duplicazioni sfumate: versioni in cui alcune parole sono mancanti, modificate o rimescolate. Per studiare questo fenomeno in modo rigoroso, inseriscono nella data di addestramento frasi di prova artificiali, chiamate cannarini, insieme a molte versioni alterate. Dopo l’addestramento, misurano quanto sia facile stabilire se un dato cannarino faceva parte del set di addestramento, usando una specie di test di privacy chiamato attacco di inferenza di appartenenza.

Come le copie sfumate lasciano comunque una traccia chiara

Confrontando i duplicati sfumati con le ripetizioni esatte, i ricercatori definiscono un “equivalente di duplicato esatto”: quanto una copia sfumata contribuisce alla memorizzazione rispetto a una copia perfetta. Scoprono che anche modifiche molto lievi indeboliscono a malapena la memorizzazione. Se solo circa il 10% delle parole in ogni duplicato viene sostituito a caso, una singola copia sfumata contribuisce ancora per circa il 60–65% rispetto a una duplicazione esatta. Anche quando metà delle parole viene cambiata, ogni versione alterata conta ancora per circa il 15–20% di una copia completa. L’effetto è robusto: aggiungere parole riempitive casuali tra frasi chiave o rimescolare blocchi della frase riduce la memorizzazione, ma non la elimina. Il modello sembra in grado di ignorare il rumore, concentrarsi sui frammenti sovrapposti e ricomporli.

La forma più del significato in ciò che i modelli conservano

Dato che i modelli moderni possono risolvere problemi matematici, seguire istruzioni e tradurre tra lingue, si potrebbe pensare che le loro memorie riguardino il significato. Sorprendentemente, lo studio trova il contrario. Quando gli autori sostituiscono parole con alternative che mantengono il significato della frase, la memorizzazione migliora solo leggermente rispetto alla sostituzione con parole casuali. Le parafrasi generate da altri sistemi di IA — che preservano l’idea ma cambiano molti dettagli superficiali — contribuiscono relativamente poco alla memorizzazione a meno che non condividano ancora molte brevi sequenze di parole con il passaggio originale. In una serie di test, ciò che guida davvero la memoria è la sovrapposizione negli stessi token (le unità base di parola del modello), non le idee condivise. In altre parole, la memoria a mosaico del modello riguarda principalmente la forma, non il significato.

Duplicati nascosti nei dati di addestramento reali

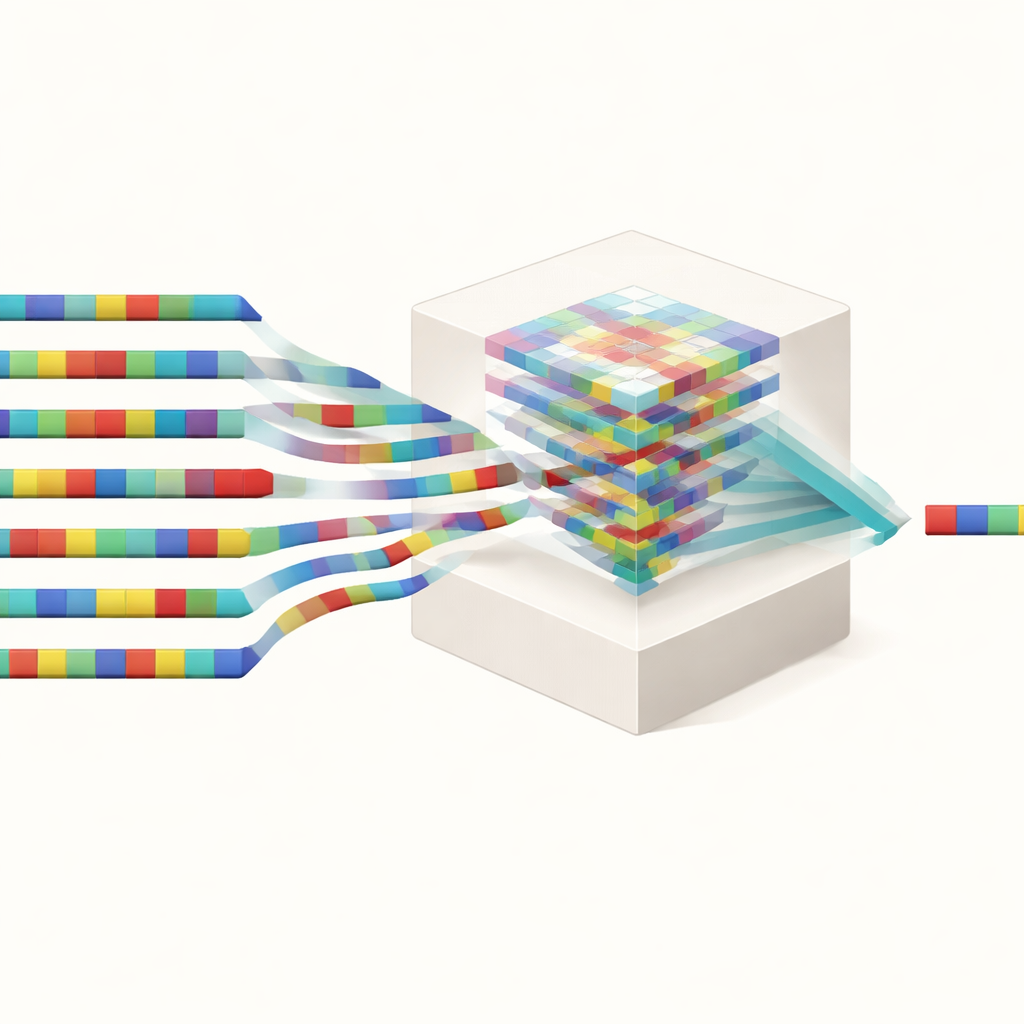

Gli autori si chiedono quindi quanto siano comuni i duplicati sfumati in un popolare dataset web ampiamente pulito usato per addestrare modelli linguistici, noto come SlimPajama. Anche se questo dataset ha già rimosso documenti quasi identici, il team scopre che molte sequenze di 100 token che appaiono esattamente 1.000 volte hanno anche migliaia di versioni quasi uguali. Per piccole distanze di editing — approssimativamente il 10% dei caratteri modificati — ci sono in media circa 4 volte più duplicati sfumati che esatti, e decine di migliaia in più a distanze maggiori ma ancora influenti. È importante notare che le tecniche standard di “deduplicazione” usate in industria, che in genere rimuovono solo lunghe sovrapposizioni esatte, lasciano intatte la maggior parte di queste copie sfumate. Ciò significa che i modelli possono ancora memorizzare materiale sensibile o protetto dal copyright ricomponendolo da molte fonti leggermente alterate.

Perché questo conta per privacy, equità e controllo

Questi risultati hanno implicazioni di ampia portata. Per la privacy, mostrano che eliminare semplicemente le ripetizioni esatte dai dati di addestramento non è sufficiente: informazioni personali o riservate possono essere memorizzate attraverso famiglie di passaggi simili. Per il copyright e i benchmark, i duplicati sfumati possono indurre i modelli a riprodurre testi protetti o a gonfiare artificialmente i punteggi in test che hanno effettivamente visto in forma mascherata. Per gli sforzi di “dimenticare” dati specifici, non basta cancellare un esempio offensivo se molte varianti restano. Nel complesso, il lavoro rivela che la memoria dei modelli linguistici è un mosaico complesso costruito da molte piccole sovrapposizioni, mettendo in discussione gli strumenti di sicurezza attuali e richiedendo modi più intelligenti e granulari per pulire e verificare i dati di addestramento.

Citazione: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Parole chiave: memorizzazione dei modelli linguistici, duplicati approssimativi, privacy dei dati, deduplicazione dei dati di addestramento, contaminazione dei benchmark