Clear Sky Science · it

Reti neurali fisiche addestrate con ottimizzazione sensibile alla curvatura

Perché questo conta per il futuro dell’hardware AI

Man mano che l’intelligenza artificiale diventa più potente, il suo limite non è più solo negli algoritmi intelligenti ma sempre più nei chip che li eseguono. Una via promettente è costruire reti neurali direttamente nell’hardware fisico usando luce, elettronica analogica o altri sistemi a onde. Questo articolo presenta un nuovo modo di addestrare tali “reti neurali fisiche” in modo che restino accurate anche quando il mondo reale è imperfetto—quando i dispositivi sono leggermente difettosi, il calore provoca deriva o i componenti si disallineano.

Dai cervelli digitali alle macchine fisiche

L’AI moderna generalmente gira su hardware digitale come le GPU, dove l’addestramento si basa sull’algoritmo di backpropagation per ottimizzare milioni di pesi numerici. Le reti neurali fisiche cercano di trasferire questo calcolo in materiali e dispositivi reali—come chip fotonici, mesh di interferometri o configurazioni ottiche diffrattive—il cui comportamento imita naturalmente la matematica delle reti neurali. Poiché questi sistemi elaborano l’informazione dove essa è memorizzata, possono essere molto più veloci ed efficienti dal punto di vista energetico rispetto ai chip convenzionali. Ma addestrarli è difficile: o si addestra un modello digitale e si spera che corrisponda all’hardware, oppure si addestra direttamente sul dispositivo. Entrambe le strade incontrano problemi quando i dispositivi reali divergono dai modelli ideali o subiscono derive nel tempo.

Due modi imperfetti per insegnare alle reti fisiche

Il primo approccio, chiamato addestramento in silico, apprende tutti i parametri su un modello al computer e poi li copia sull’hardware. Questo funziona bene solo se il modello matematico corrisponde quasi perfettamente al dispositivo fabbricato, il che è raramente vero una volta che si considerano variazioni di produzione, rumore elettrico ed effetti termici. Il secondo approccio, l’addestramento in situ, integra direttamente il dispositivo fisico nel processo di apprendimento, misurando ripetutamente le uscite mentre i parametri vengono regolati. Pur evitando errori di modellizzazione, questo crea altri problemi: ottenere informazioni sul gradiente è difficile e costoso, l’addestramento diventa specifico per il singolo dispositivo e i parametri risultanti solitamente non sono trasferibili a un altro chip nominalmente identico. In entrambi i casi, piccoli cambiamenti dopo il dispiegamento—come una lieve variazione di temperatura o un disallineamento—possono ridurre drasticamente l’accuratezza e obbligare a costosi riaddestramenti.

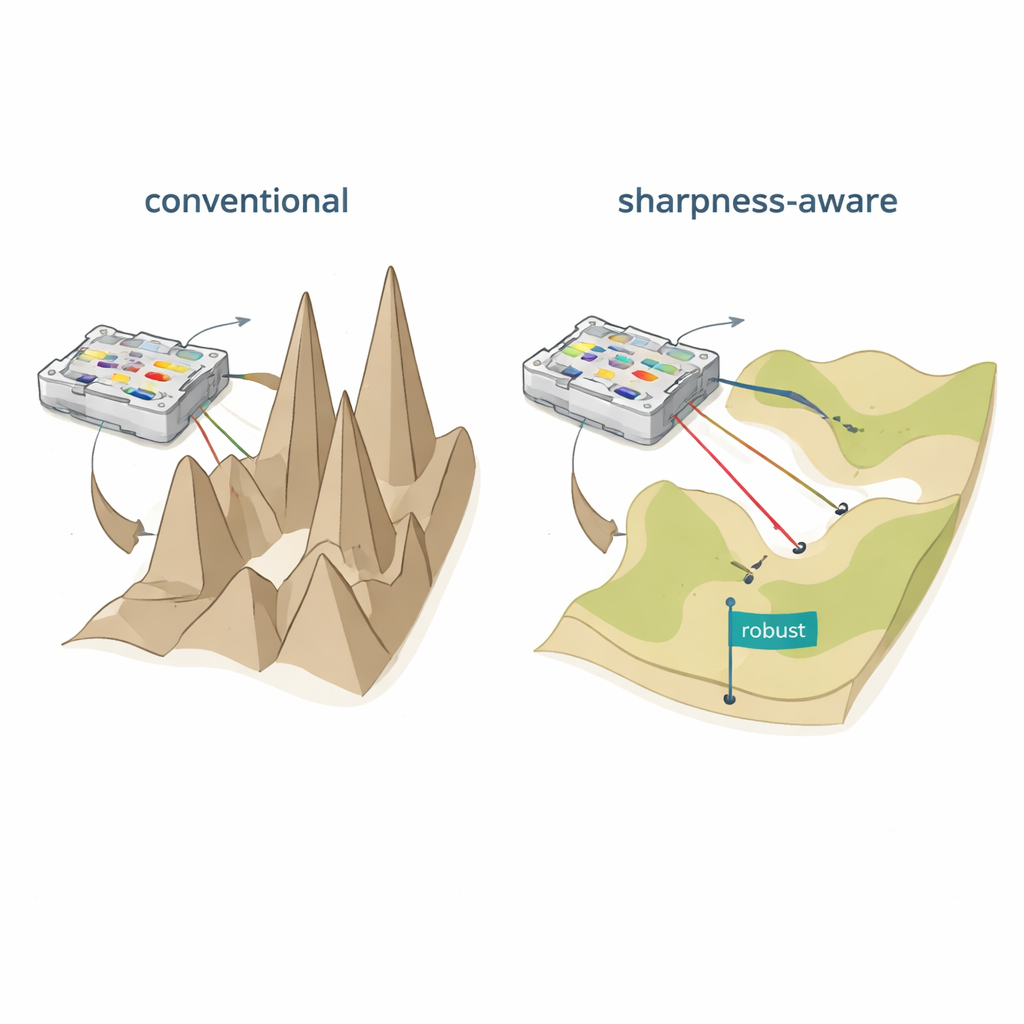

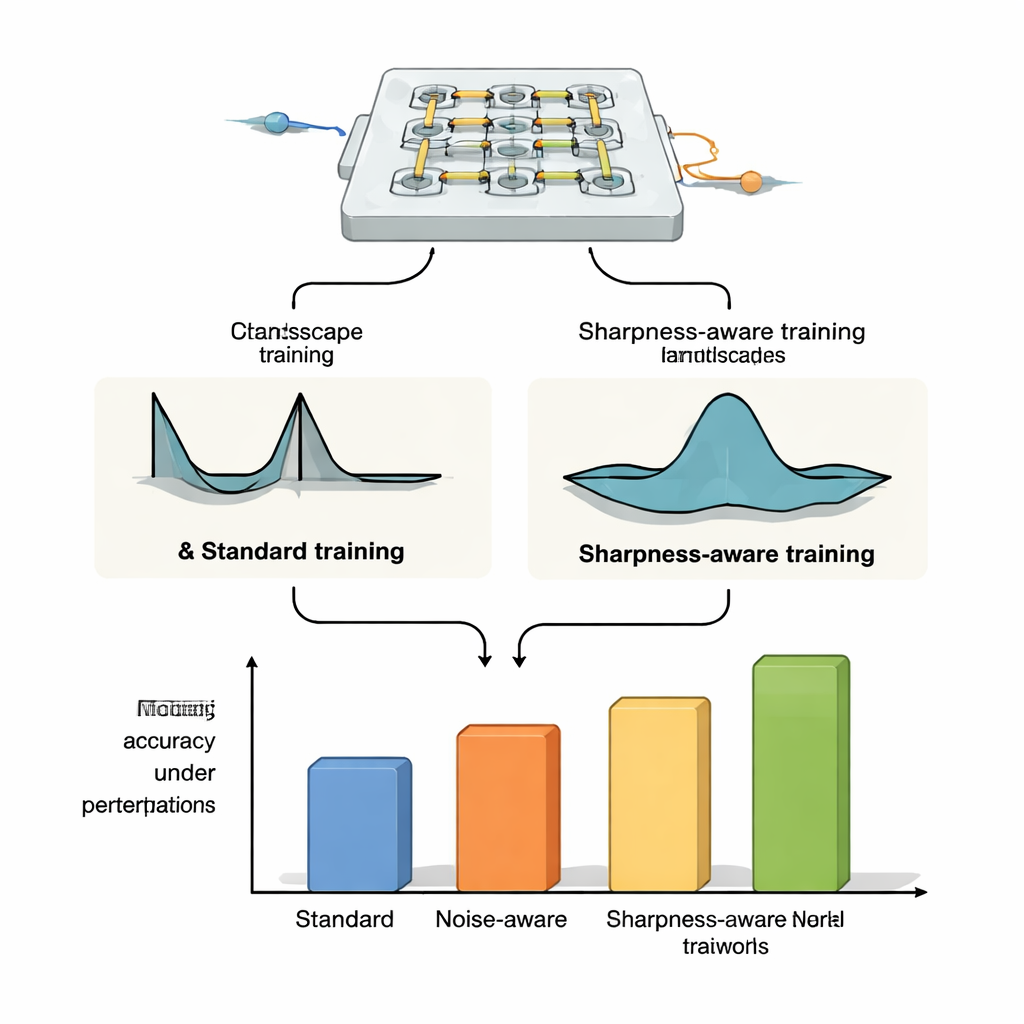

Appiattire il paesaggio dell’apprendimento

Gli autori propongono l’addestramento sensibile alla curvatura (SAT), ispirato a un’idea del machine learning chiamata sharpness-aware minimization. Invece di limitarsi a trovare configurazioni che danno bassa errore sui dati di addestramento, SAT cerca anche regioni in cui l’errore cambia lentamente quando i parametri fisici sottostanti vengono leggermente perturbati. In termini geometrici, l’addestramento tradizionale spesso trova una valle profonda ma stretta nel “paesaggio di perdita”, dove anche piccole variazioni di correnti, fasi o posizioni fanno crollare le prestazioni. SAT ricerca intenzionalmente valli ampie e piatte dove le prestazioni restano elevate di fronte a tali disturbi. Matematicamente aggiunge un termine all’obiettivo di addestramento che penalizza regioni acute e molto curvate nello spazio dei parametri, e approssima questa penalità in modo efficiente usando due passi di gradiente scelti con cura invece dei costosi calcoli di seconde derivate.

Dimostrare robustezza attraverso diverse piattaforme ottiche

Per mostrare che SAT non è vincolato a un singolo dispositivo, gli autori lo applicano a tre distinte piattaforme di reti neurali ottiche. Su banchi di pesi con microring-resonator—piccoli anelli di silicio che instradano la luce a diverse lunghezze d’onda—dimostrano che i sistemi addestrati con SAT mantengono alta l’accuratezza di classificazione anche quando la temperatura deriva di diversi gradi Celsius, mentre l’addestramento standard e i metodi di iniezione di rumore falliscono drasticamente. Estendono questo a compiti più impegnativi come la classificazione di immagini su CIFAR-10, la compressione e ricostruzione di immagini e la generazione di immagini, dove SAT mantiene stabile la prestazione mentre i metodi convenzionali si rompono sotto modeste variazioni termiche. Nelle simulazioni di mesh di interferometri Mach–Zehnder, i modelli addestrati con SAT sono molto più tolleranti a errori di fabbricazione realistici e, cosa cruciale, i parametri addestrati su un dispositivo possono essere trasferiti ad altri chip con imperfezioni diverse senza perdere accuratezza. Infine, in una configurazione ottica diffrattiva in spazio libero che usa un display OLED, lenti e un modulatore spaziale di luce, SAT migliora la tolleranza a disallineamenti fisici come rotazione, spostamenti di pixel e scala, anche se la relazione esatta tra questi disallineamenti e i parametri della rete non è modellata esplicitamente.

Una strada pratica verso un’AI fisica affidabile

In termini concreti, questo lavoro mostra come insegnare alle reti neurali hardware in modo che «perdono» i difetti inevitabili dei dispositivi reali. Orientando l’apprendimento verso regioni piatte e stabili del paesaggio di errore, l’addestramento sensibile alla curvatura rende le reti neurali fisiche sia più accurate sia più robuste alle variazioni di fabbricazione, ai cambiamenti di temperatura e ai disallineamenti meccanici. Poiché può essere usato con o senza modelli fisici dettagliati e funziona su diversi tipi di hardware ottico, SAT offre una ricetta pratica per scalare sistemi di AI fisica veloci ed energeticamente efficienti dalle dimostrazioni di laboratorio ad applicazioni reali.

Citazione: Xu, T., Luo, Z., Liu, S. et al. Physical neural networks using sharpness-aware training. Nat Commun 17, 1766 (2026). https://doi.org/10.1038/s41467-026-68470-9

Parole chiave: reti neurali fisiche, calcolo fotonico, addestramento robusto, ottimizzazione sensibile alla curvatura, hardware neuromorfico