Clear Sky Science · it

Apprendimento online a memoria lineare indipendente dal modello nelle reti neurali a impulsi

Perché è così difficile addestrare computer simili al cervello

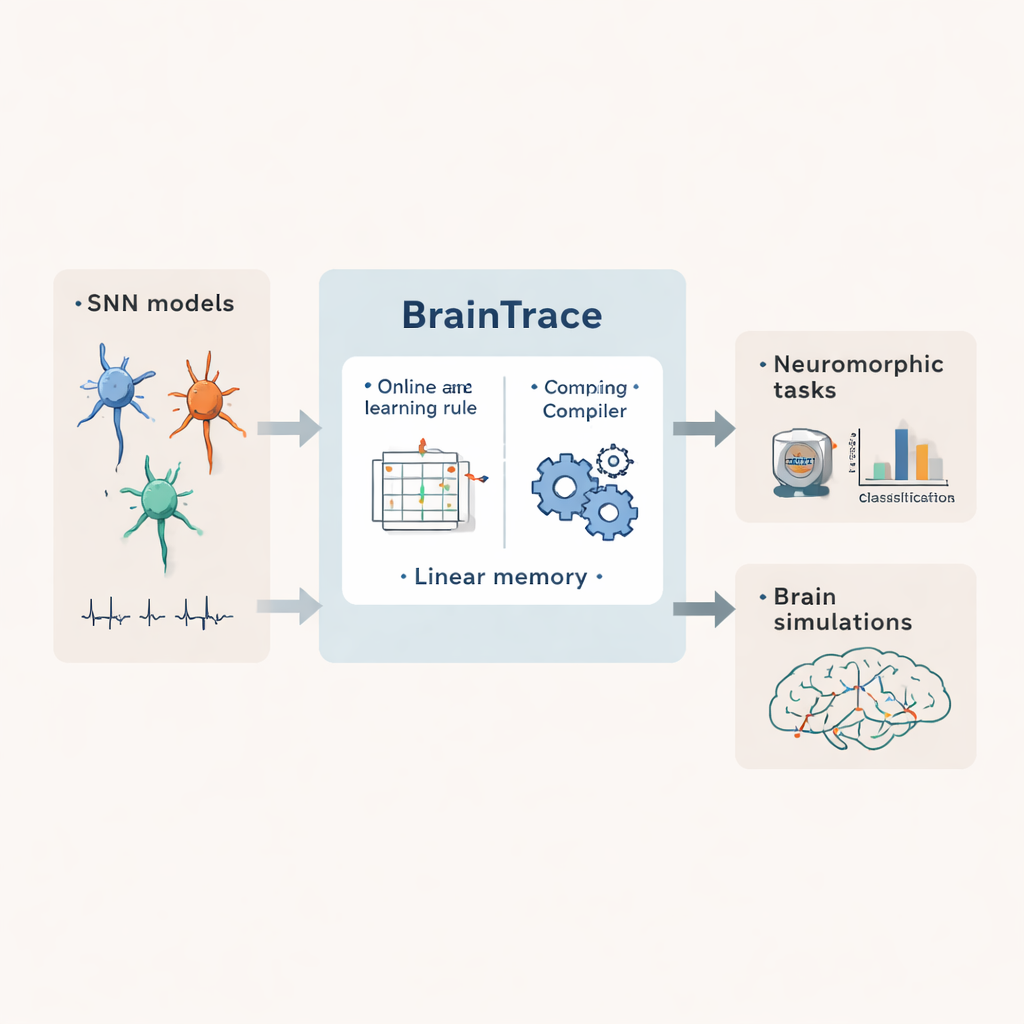

Le reti neurali a impulsi sono una classe di reti artificiali che comunicano tramite brevi scariche elettriche, proprio come le cellule cerebrali reali. Promettono un calcolo ultra‑efficiente ispirato al cervello e simulazioni più realistiche dei circuiti neurali. Ma insegnare a queste reti a svolgere compiti complessi, specialmente su lunghi intervalli temporali, richiede di solito enormi quantità di memoria e codice costruito a mano. Questo articolo presenta BrainTrace, un sistema pensato per rendere l’addestramento delle reti a impulsi pratico e ampiamente utilizzabile.

Insegnare a reti che apprendono in tempo reale

La maggior parte dei metodi di addestramento più potenti per reti simili al cervello funziona riproducendo l’intera sequenza di attività e retropropagando i segnali di errore attraverso ogni istante temporale. Questo approccio, noto come backpropagation through time, può essere molto accurato ma diventa rapidamente problematico quando le sequenze sono lunghe o le reti sono vaste: ogni stato intermedio deve essere memorizzato, con una crescita della memoria che scala sia con il tempo sia con la dimensione della rete. Metodi “online” alternativi aggiornano le connessioni passo dopo passo mentre i dati scorrono, riducendo notevolmente i requisiti di memoria. Tuttavia, le regole online esistenti o funzionano solo per modelli di neuroni molto semplificati, o richiedono ancora memoria che cresce quadraticamente con la dimensione della rete, rendendole difficili da applicare a sistemi di scala cerebrale realistici.

Una ricetta generale per molti tipi di reti a impulsi

BrainTrace affronta il problema descrivendo prima le reti a impulsi in modo unificato. Gli autori mostrano che molti tipi di neuroni e sinapsi possono essere espressi come due parti interagenti: dinamiche interne che descrivono come lo stato di ciascun neurone cambia nel tempo, e dinamiche di interazione che trasformano gli impulsi in correnti che scorrono tra le cellule. Introducono inoltre due punti di vista modellistici, chiamati AlignPre e AlignPost, che organizzano le sinapsi attorno al neurone mittente o al neurone ricevente. Questa astrazione permette di gestire un’ampia varietà di modelli biologici e ingegneristici con la stessa macchina matematica, dai semplici neuroni leaky a cellule più ricche con soglie adattive e sinapsi complesse.

Un modo parsimonioso di seguire causa ed effetto

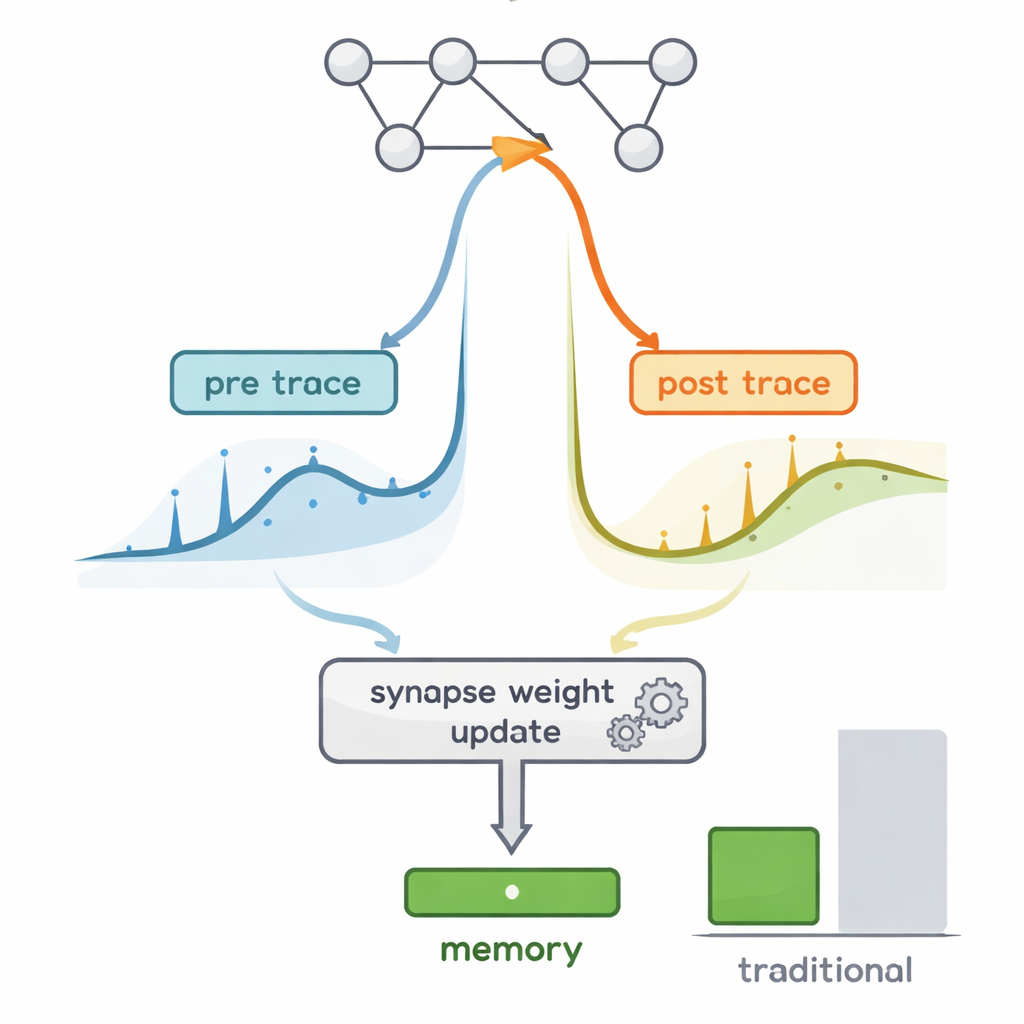

La sfida centrale nell’apprendimento online è tracciare come piccole modifiche in ciascuna connessione influenzerebbero in seguito il comportamento della rete, una quantità catturata dalle cosiddette “tracce di eleggibilità”. In principio, mantenere informazioni di eleggibilità complete richiede di tracciare matrici immense che scalano con il cubo del numero di neuroni. BrainTrace sfrutta tre proprietà chiave delle reti a impulsi: la maggior parte dei neuroni è silenziosa per la maggior parte del tempo; la perdita (leak) e il reset propri di ogni neurone dominano come il suo stato cambia; e gli impulsi e le conduttanze sinaptiche sono sempre positivi. Usando questi fatti, gli autori mostrano che le pesanti matrici di eleggibilità possono essere approssimate in modo accurato dal prodotto di sole due tracce compatte per sinapsi, una che riassume l’attività presinaptica e una che riassume l’attività postsinaptica. Questa regola di propagazione pre‑post, denominata pp‑prop, usa memoria che cresce solo linearmente con la dimensione della rete, pur producendo gradienti ben allineati a quelli della retropropagazione completa.

Strumenti automatici che nascondono la matematica

Oltre alla regola di apprendimento in sé, BrainTrace fornisce un compilatore che svolge un ruolo simile alle librerie di differenziazione automatica nel deep learning. Un utente descrive le dinamiche del proprio modello a impulsi in un linguaggio di alto livello. Il compilatore BrainTrace analizza quindi come stati e parametri sono connessi, costruisce le tracce di eleggibilità necessarie ed emette codice ottimizzato che esegue pp‑prop o un algoritmo correlato in modo efficiente su CPU, GPU o acceleratori specializzati. Ciò significa che i modellatori possono concentrarsi su domande scientifiche invece di scrivere a mano codice di gradiente delicato, pur beneficiando di un apprendimento online e parsimonioso nella memoria.

Dai sensori minuscoli a un intero cervello di mosca

Gli autori testano BrainTrace su benchmark neuromorfici standard, in cui le reti a impulsi classificano versioni basate su eventi di immagini, suoni e gesti. Su più dataset e architetture, pp‑prop eguaglia l’accuratezza della retropropagazione completa usando ordini di grandezza di memoria in meno e risultando più veloce di altri metodi online. Fondamentale, il sistema scala anche a problemi impegnativi di neuroscienza. In un esempio, una rete a impulsi biologicamente dettagliata con popolazioni eccitatorie e inibitrici separate impara un compito di accumulo di evidenze e sviluppa pattern di attività simili a quelli registrati nella corteccia del topo. In un altro, un modello a impulsi con oltre 125.000 neuroni, cablato secondo il connettoma della mosca della frutta, viene addestrato a riprodurre l’attività a riposo registrata su tutto il cervello della mosca — un’impresa che supera la capacità di memoria dell’addestramento convenzionale su una singola scheda grafica.

Cosa significa per il futuro del calcolo ispirato al cervello

Per i non esperti, il messaggio principale è che BrainTrace trasforma un sogno un tempo impraticabile — addestrare reti a impulsi ricche e su scala cerebrale in tempo reale — in una possibilità realistica. Trovando un modo intelligente per tracciare causa ed effetto con una piccola quantità di memoria e racchiudendo questo in strumenti automatizzati, il lavoro avvicina il calcolo ispirato al cervello all’uso quotidiano sia nell’intelligenza artificiale sia nella neuroscienza di base. Suggerisce una strada verso macchine che apprendono e si adattano con l’efficienza e la precisione temporale dei sistemi nervosi reali, senza richiedere risorse al livello dei supercomputer.

Citazione: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Parole chiave: reti neurali a impulsi, apprendimento online, calcolo neuromorfico, simulazione cerebrale, addestramento basato sul gradiente