Clear Sky Science · it

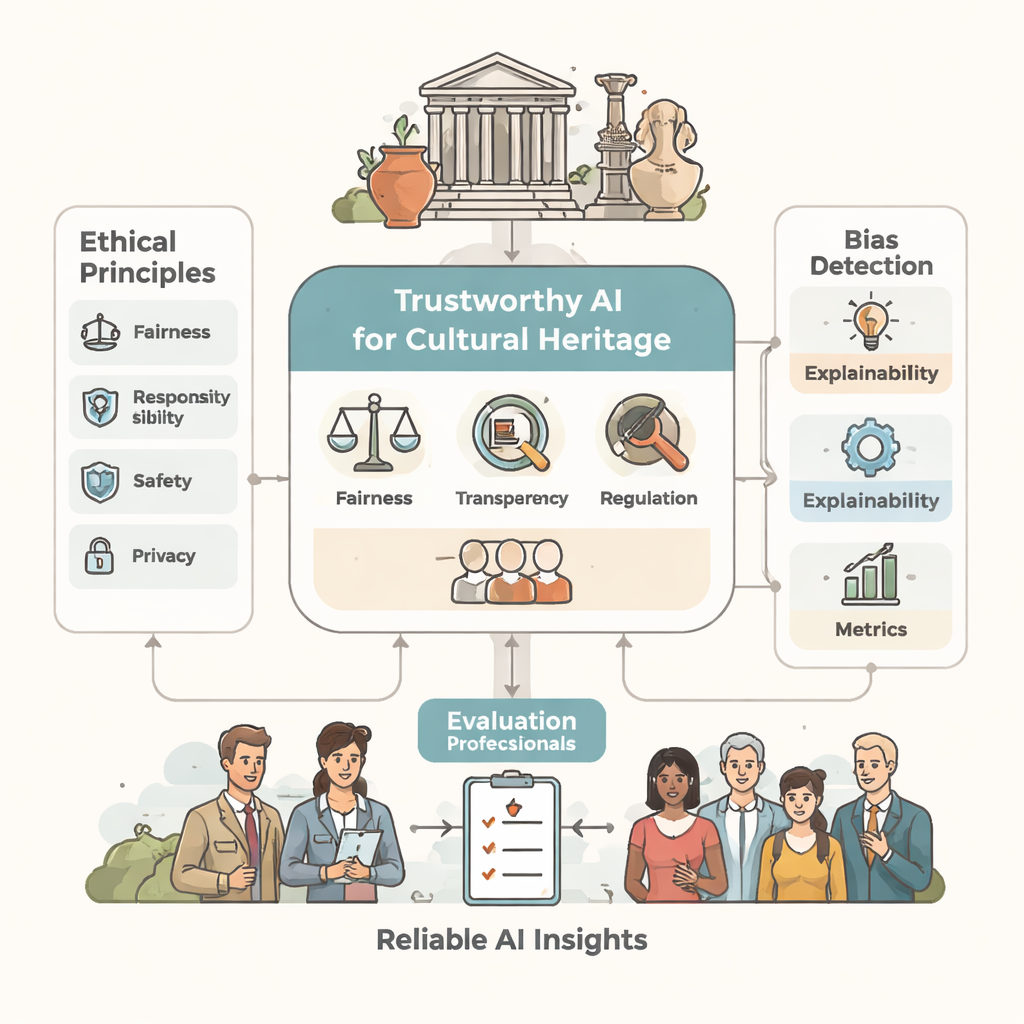

Verso un'IA affidabile nel patrimonio culturale

Perché strumenti più intelligenti sono importanti per il nostro passato

Dai templi in rovina ai pergameni fragili, oggi gli esperti del patrimonio si affidano a strumenti digitali per comprendere e proteggere i segni della storia umana. L’intelligenza artificiale (IA) può setacciare enormi volumi di immagini, scansioni e registri molto più rapidamente di una persona, ma può anche fraintendere o distorcere le storie che questi oggetti raccontano. Questo articolo esplora come rendere l’IA non solo potente, ma anche equa, trasparente e degna di fiducia quando viene utilizzata per studiare e salvaguardare il patrimonio culturale.

Nuovi aiuti per tesori antichi

Musei, archeologi e conservatori si stanno rivolgendo all’IA per classificare foto, mappare i danni agli edifici e ricostruire dettagli perduti di oggetti danneggiati. Tecniche concepite originariamente per auto a guida autonoma o per lo shopping online aiutano ora a interpretare mosaici antichi, sculture e strade storiche. Tuttavia i dati sul patrimonio culturale sono insolitamente disordinati e disomogenei: alcune regioni ed epoche sono riccamente documentate, mentre altre compaiono solo in registri sparsi. Se l’IA impara principalmente da monumenti noti e collezioni occidentali, può ignorare o interpretare male il patrimonio di gruppi minoritari o luoghi meno celebrati. L’articolo sostiene che, poiché il patrimonio culturale plasma identità e memorie, gli errori non sono soltanto inconvenienti tecnici ma problemi etici.

Dove gli algoritmi possono sbagliare

Gli autori mappano i molteplici modi in cui il bias può insinuarsi nell’IA usata per il patrimonio. Alcuni pregiudizi derivano da lacune nei dati: per esempio, mosaici danneggiati in cui le tessere mancanti confondono i sistemi di riconoscimento dei pattern, o archivi storici che omettono intere comunità. Altri nascono dalla rappresentazione: i dataset popolari tendono a includere monete, icone ed edifici europei, lasciando sotto-rappresentati gli oggetti non occidentali. Anche quando il materiale esiste, le etichette possono differire tra esperti, e le foto sui social media di siti famosi possono riflettere scatti turistici più che prospettive locali. L’articolo raggruppa questi problemi in categorie come dati mancanti, sotto-rappresentazione delle minoranze, differenze contestuali tra regioni e visioni obsolete congelate in vecchie scansioni o archivi. Per ciascun tipo propone contromisure pratiche, dall’ampliare le collezioni per includere narrazioni minoritarie all’aggiornare routinariamente i modelli digitali man mano che i siti cambiano.

Rendere comprensibili le decisioni delle macchine

La fiducia, sostengono gli autori, dipende non solo da dati migliori ma anche da spiegazioni più chiare. Molti sistemi IA moderni funzionano come “scatole nere”: etichettano un arco come gotico o un muro come danneggiato senza mostrare il perché. L’articolo propone un approccio stratificato all’esplicabilità. Uno strato esamina la meccanica interna del modello, un altro come la storia locale e il contesto influenzano le sue decisioni, e altri si concentrano su cosa significhi il risultato nella pratica e su quanto il sistema sia sicuro delle sue ipotesi. Le spiegazioni possono essere globali, descrivendo il comportamento complessivo del sistema, o locali, focalizzandosi su una singola previsione riguardo a un edificio o a un reperto specifico. Per valutare se queste spiegazioni siano davvero utili, gli autori definiscono metriche semplici e incentrate sull’umano come soddisfazione dell’utente, curiosità, fiducia e l’effetto sulla qualità delle decisioni.

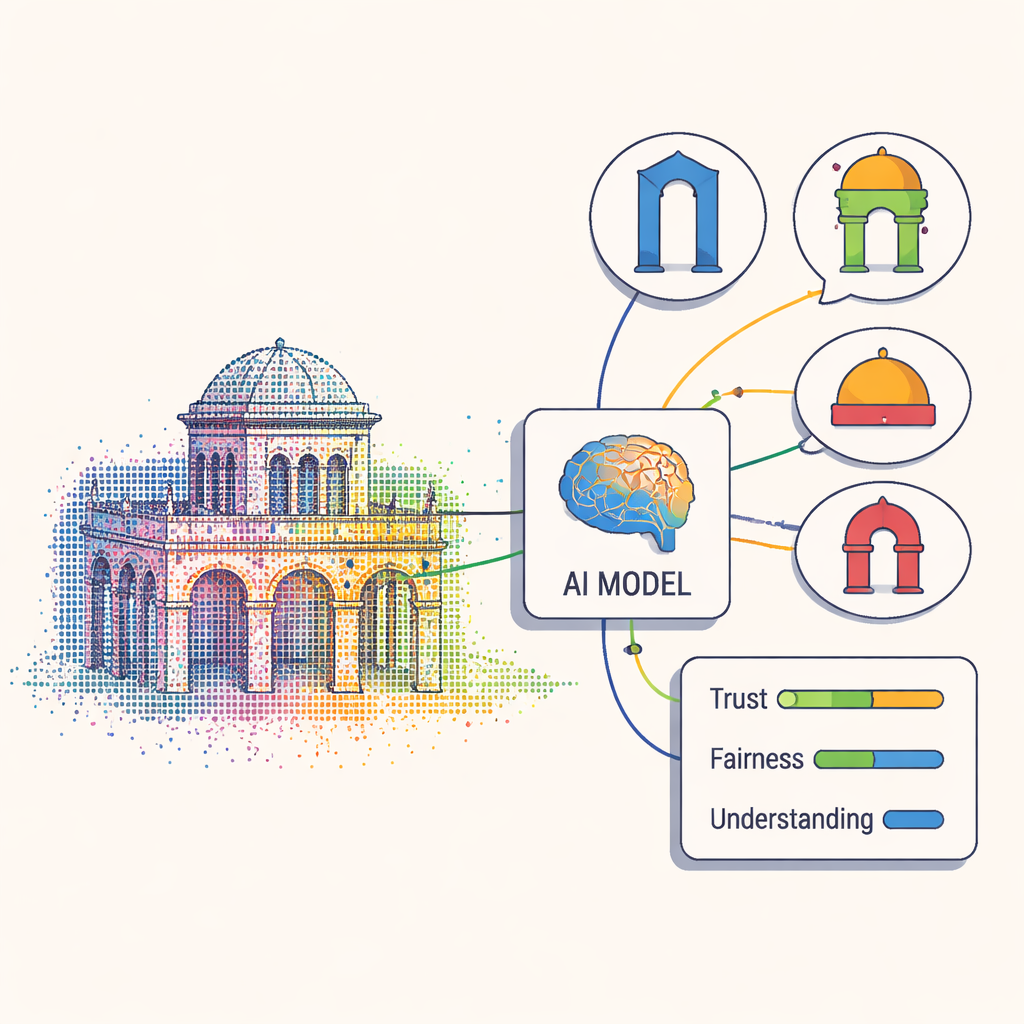

Testare il quadro su dati reali del patrimonio

Per vedere come le loro idee funzionano nella pratica, i ricercatori rivedono un precedente sistema di IA che analizza dense nuvole di punti 3D di edifici storici. Quel sistema è molto bravo ad assegnare automaticamente ogni cluster di punti a elementi architettonici come archi, finestre o colonne, ma non era stato progettato tenendo conto di equità o trasparenza. Quando è stato valutato con le nuove metriche etiche, gli esperti hanno rilevato di aver capito solo in parte come arrivasse alle sue conclusioni, e che il sistema spiegava poco le interpretazioni alternative. Gli autori propongono l’uso di modelli più recenti che integrano l’esplicazione nel loro design. Questi modelli confrontano parti di un edificio con “prototipi” appresi e evidenziano quali esempi hanno guidato una data etichetta, così che gli specialisti del patrimonio possano vedere e discutere il ragionamento invece di accettare semplicemente una risposta opaca.

Costruire custodi della cultura a prova di futuro

In termini semplici, l’articolo sostiene che l’IA dovrebbe assistere il giudizio umano nel lavoro sul patrimonio, non sostituirlo silenziosamente. Cercando sistematicamente i bias e insistendo che i sistemi spieghino le loro scelte con linguaggio e supporti visivi comprensibili agli esperti, il quadro proposto mira a mantenere l’IA allineata ai valori di inclusione, accuratezza e rispetto della diversità culturale. Gli autori suggeriscono che progetti etici simili potrebbero beneficiare anche settori sensibili come salute, istruzione e ambiente. Per il patrimonio culturale il messaggio è chiaro: solo un’IA trasparente, equa e aperta al confronto può essere considerata affidabile per aiutare a raccontare le storie del nostro passato condiviso.

Citazione: Paolanti, M., Frontoni, E. & Pierdicca, R. Towards trustworthy AI in cultural heritage. npj Herit. Sci. 14, 131 (2026). https://doi.org/10.1038/s40494-026-02403-z

Parole chiave: patrimonio culturale, IA affidabile, pregiudizi algoritmici, IA spiegabile, conservazione del patrimonio