Clear Sky Science · he

שיפור זיהוי ישויות מיודעות בנסיבות מעטות עבור מודלים שפה גדולים באמצעות שיקוף דינמי מובנה עם יצירה משופרת על ידי השלמה חוזרת

מדוע קריאה חכמה יותר של טקסט רפואי חשובה

הרפואה המודרנית מייצרת ים של טקסט — מתיעודים במחלקות טיפול נמרץ ועד שיחות מקוונות על צריכת תרופות. בתוך המילים האלה חבויים רמזים חשובים על מחלות, טיפולים ותופעות לוואי. מציאת קטעי מידע אלה וסימון שלהם באופן אוטומטי, מטלה המכונה “זיהוי ישויות מיודעות”, יכולה לסייע לחוקרים לעקוב אחרי התפרצויות, לזהות בעיות תרופתיות מוקדם יותר ולתמוך ברופאים בזמן אמת. אך מערכות מסורתיות זקוקות למאגרי נתונים רבים המסומנים ידנית, שעלות בנייתם גבוהה ולעתים לא קיימים עבור בעיות בריאות נדירות או חדשות. המאמר בוחן כיצד ניתן להנחות מודלי שפה גדולים, כמו אלה שמאחורי צ'אטבוטים עכשוויים, באמצעות פרומפטים מתוכננים היטב ושיחזור חכם של דוגמאות, כך שהם יבצעו את משימת הסימון היטב גם כאשר זמינים רק מספר מועט של דוגמאות מתוייגות.

להדריך מכונות לזהות מילים חשובות

המחברים מתמקדים בזיהוי ישויות ביורפואיות — מציאת אזכורים של מחלות, תרופות, תסמינים והשפעות חברתיות בטקסט. זה קשה כי השפה הרפואית מאד מתמחה, משתנה בין בתי חולים ותת-תחומים, ולעיתים עוסקת במצבים נדירים המופיעים רק פעמים ספורות בכל מאגר נתונים. מודלי למידה מכונה קיימים יכולים להגיע לביצועים דמויי-אנוש אך בדרך כלל דורשים קורפוסים גדולים ומסומנים היטב, יקרים ליצירה ולשיתוף, במיוחד תחת כללי פרטיות מחמירים. למידה במעט דוגמאות, שבה המודל לומד ממספר מועט בלבד של דוגמאות מתוייגות, מציעה דרך לעקוף צוואר הבקבוק הזה. מודלי שפה גדולים מבטיחים במיוחד כאן כי הם יכולים ללמוד דפוסים ישירות מההנחיות והדוגמאות בפרומפט, בלי צורך לאמן מחדש את משקלי הפנימיים שלהם.

בניית הוראות טובות יותר למודלי שפה

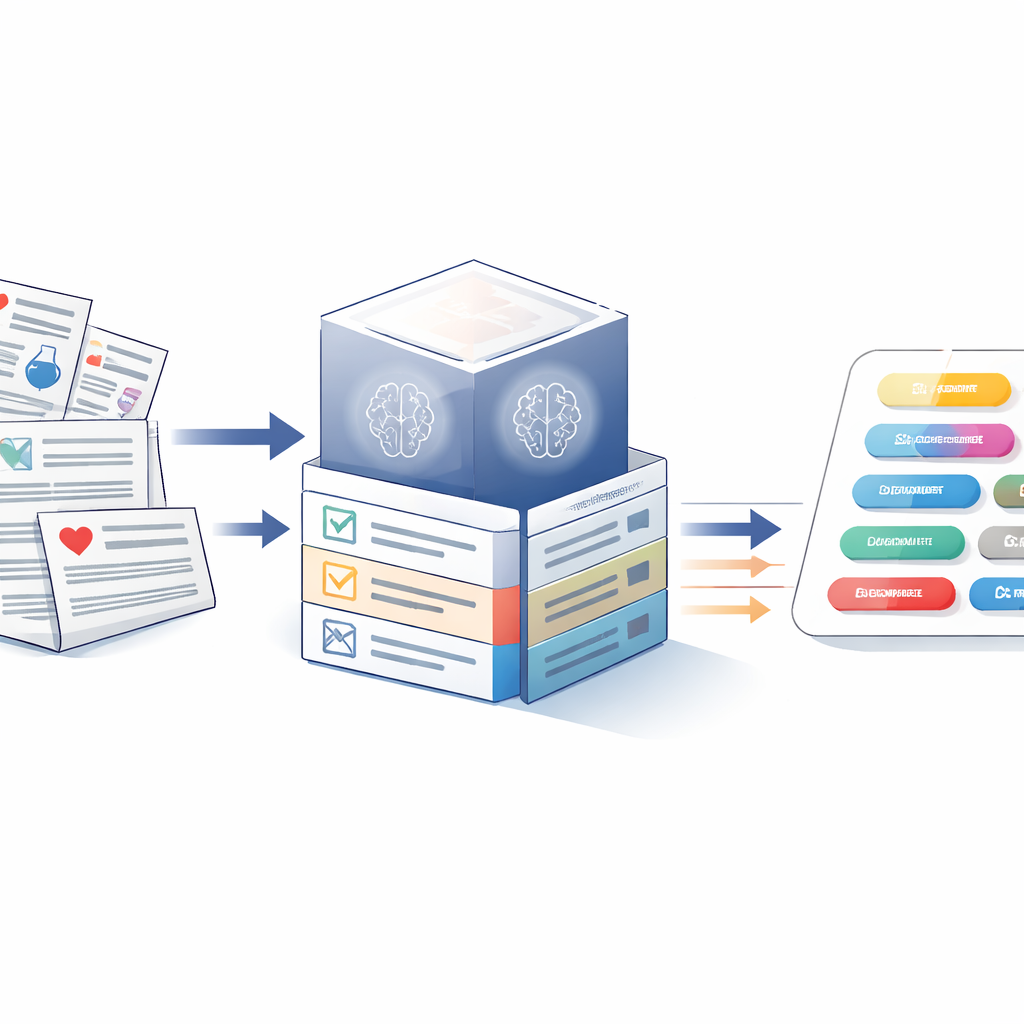

החלק הראשון של העבודה מעצב פרומפט "סטטי" מובנה מאוד — בלוק הנחיות ודוגמאות שניתן להשתמש בו עבור כל משפט שהמודל צריך לסמן. במקום פשוט לבקש מהמודל לתייג ישויות, הפרומפט מחולק לשישה אלמנטים: תיאור מטלה ברור והגדרות סוגי הישויות; תיאור קצר של מקור ומוטיב הנתונים; מילים שכיחות אופייניות לכל ישות; ידע רפואי רקע אופציונלי; סיכום משוב משגיאות קודמות של המודל; וכמה משפטים מדוגמים עם סימון מלא. הצוות בדק מסגרת זו עם שלושה מודלי שפה גדולים — GPT-3.5, GPT-4 ו-LLaMA 3-70B — על חמישה מאגרי נתונים ביורפואיים שנעו מתיקים קליניים, תקצירי מאמרים מדעיים ופוסטים ברדיט על שימוש באופיואידים. הצבת רכיבים אלה בשכבות בקפידה שיפרה את ציוני F1 (איזון בין דיוק לזכירה) בכ-11–12 נקודות אחוז מעל פרומפט בסיסי, כאשר GPT-4 השיג את הביצועים הטובים ביותר בכלל.

לאפשר למודל לאתר דוגמאות טובות יותר בזמן אמת

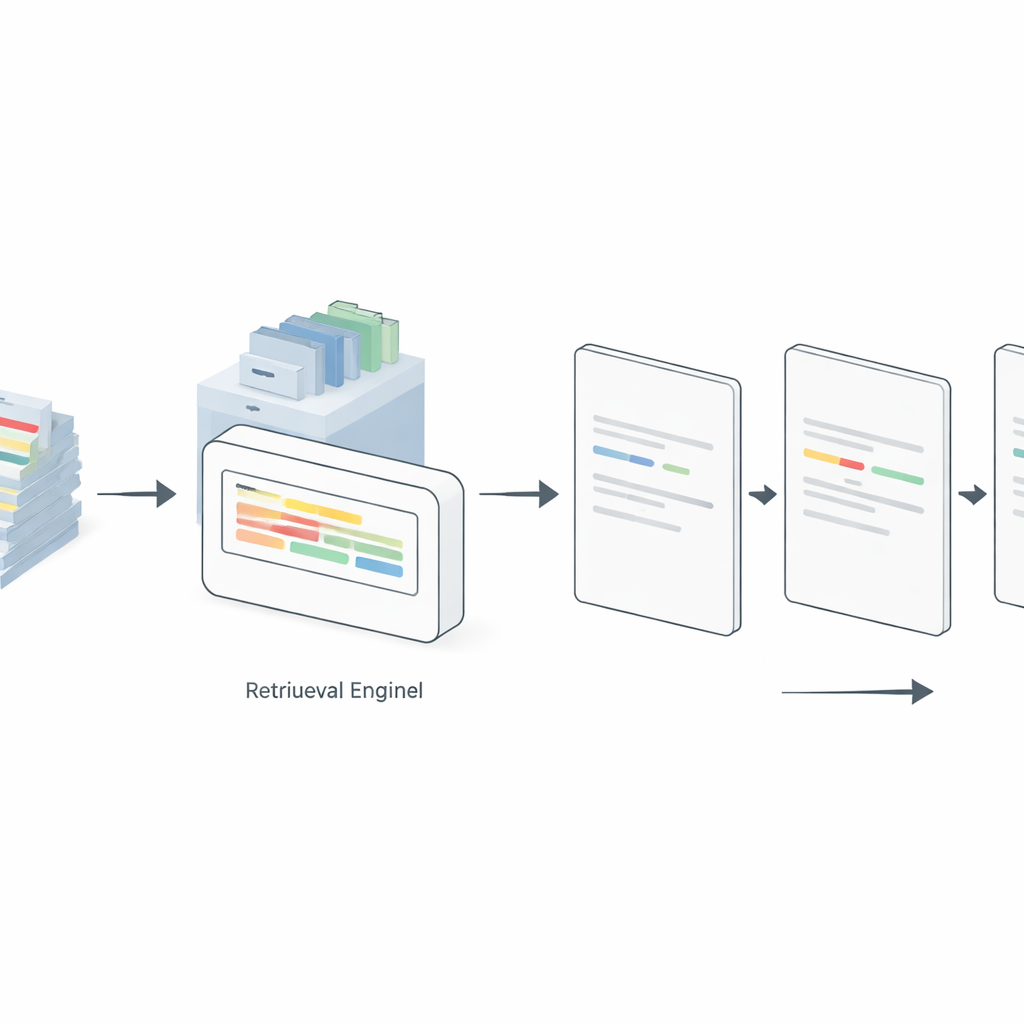

עם זאת, פרומפטים סטטיים מציגים תמיד את אותן דוגמאות, גם כשהן לא מתאימות למשפט החדש שצריך לסמן. כדי לענות על כך, המחברים מציגים אסטרטגיית פרומפטינג "דינמית" המונעת על ידי יצירה מועשרת בהשבה. כאן, מנוע השבה נפרד מאינדקס את כל הדוגמאות המתויגות הזמינות. עבור כל משפט קלט חדש, המערכת מחפשת בבסיס זה את המשפטים המתויגים הדומים ביותר ומכניסה רק אותם לפרומפט. המחקר משווה מספר שיטות השבה, מתכנית תדירות מונחים פשוטה (TF–IDF) ועד מודלים של הטמעות נוירליות כגון Sentence-BERT (SBERT), ColBERT ו-Dense Passage Retrieval. על פני GPT-4, LLaMA 3 ומודל בקוד פתוח הנקרא GPT-OSS-120B, בחירה דינמית של דוגמאות רלוונטיות עקבית עלתה על פרומפטינג סטטי בהגדרות של 5, 10 ו-20 דוגמאות. מפתיע שאופן הפשטני של TF–IDF לעיתים תאם או אף עלה על גישות מורכבות יותר, במיוחד במאגרים נקיים וממוינים יותר, בעוד SBERT בלט בטקסט רועש יותר מהרשתות החברתיות.

להפיק יותר ממעט דוגמאות מתוייגות

מכיוון שסימון טקסט רפואי יקר, המחברים גם בדקו כמה דוגמאות מתויגות מנוע ההשבה חייב לאנדקס כדי להיות שימושי. באמצעות LLaMA 3-70B, הם שינו את מאגר ההשבה מ-50 דוגמאות ועד כל סט האימון. הביצועים השתפרו ככל שהמאגר גדל, אך התועלות שטו במהירות: מאגרים של כ-100–200 דוגמאות השיגו כמעט את אותה דיוק כאינדוקס כל הנתונים הזמינים, לעתים בתוך תחום השגיאה הסטטיסטי. במקרים מסוימים, מאגרים עצומים מעט פגעו בביצועים, כנראה כי הם הציגו דוגמאות לא רלוונטיות או מבלבלות והאריכו את הפרומפט. ממצאים אלה מרמזים כי, בשילוב עם מודל שפה חזק ופרומפטים מתוכננים היטב, גם מאמצי סימון צנועים יכולים להניב זיהוי ישויות ביורפואיות יציב, מה שהופך את הגישה לישימה עבור מחלות נדירות, מושגים קליניים חדשים או מוסדות עם משאבים מוגבלים.

מה זה אומר לרפואה במציאות

בסך הכל, המחקר מראה שמודלי שפה גדולים יכולים לזהות באופן אמין מושגים רפואיים חשובים מתוך טקסט תוך שימוש במספר מועט בלבד של דוגמאות מתוייגות, בתנאי שמנחים אותם עם פרומפטים מובנים ומערכת השבה שמעלה את המקרים הקודמים הרלוונטיים ביותר. GPT-4 מספקת את הביצועים הכלליים החזקים ביותר, בעוד שמודלים פתוחים וקטנים יותר עדיין נהנים באופן משמעותי מאותה מתכון של פרומפטינג והשבה. עבור מיישמים, המשמעות היא שאין צורך לבנות מאגרי נתונים ענקיים בכל פעם שמופיע סוג ישות חדש או דאגה בריאותית — סט קומפקטי ומוקפד של דוגמאות יחד עם פרומפט חכם עשוי להספיק. ככל שמערכות הבריאות ממשיכות לתעד דוחות ודוחות החולים מציינים את חוויותיהם ברשת, כלים יעילים וגמישים כאלה יכולים להקל על חילוץ ידע קליני שימושי מהעולם העצום והבלגן של הטקסט הרפואי.

ציטוט: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

מילות מפתח: זיהוי ישויות ביורפואיות, למידה במעט דוגמאות, מודלי שפה גדולים, יצירה מועשרת בהשבה, כריית טקסט קליני