Clear Sky Science · he

ניתוח הוגנות של תחזיות למידת מכונה לגבי אלימות בבתי חולים פסיכיאטריים בטיפול אקוטי

מדוע זה חשוב עבור אנשים אמיתיים

בתי חולים נוקטים בשימוש בבינה מלאכותית כדי לזהות אילו מטופלים עלולים להפוך לאגרסיביים, בתקווה למנוע נזק מבלי להסתמך על אמצעי כפייה טראומטיים. אבל אם כלי התחזית האלה אינם הוגנים, הם עלולים להחריף את חוסר השוויון שכבר משפיע על מי נחשב "מסוכן". המחקר הזה שואל שאלה דחופה: כאשר מכונה מסייעת להחליט מי נמצא בסיכון גבוה ביחידה פסיכיאטרית, האם היא מתייחסת לכל המטופלים באופן שווה?

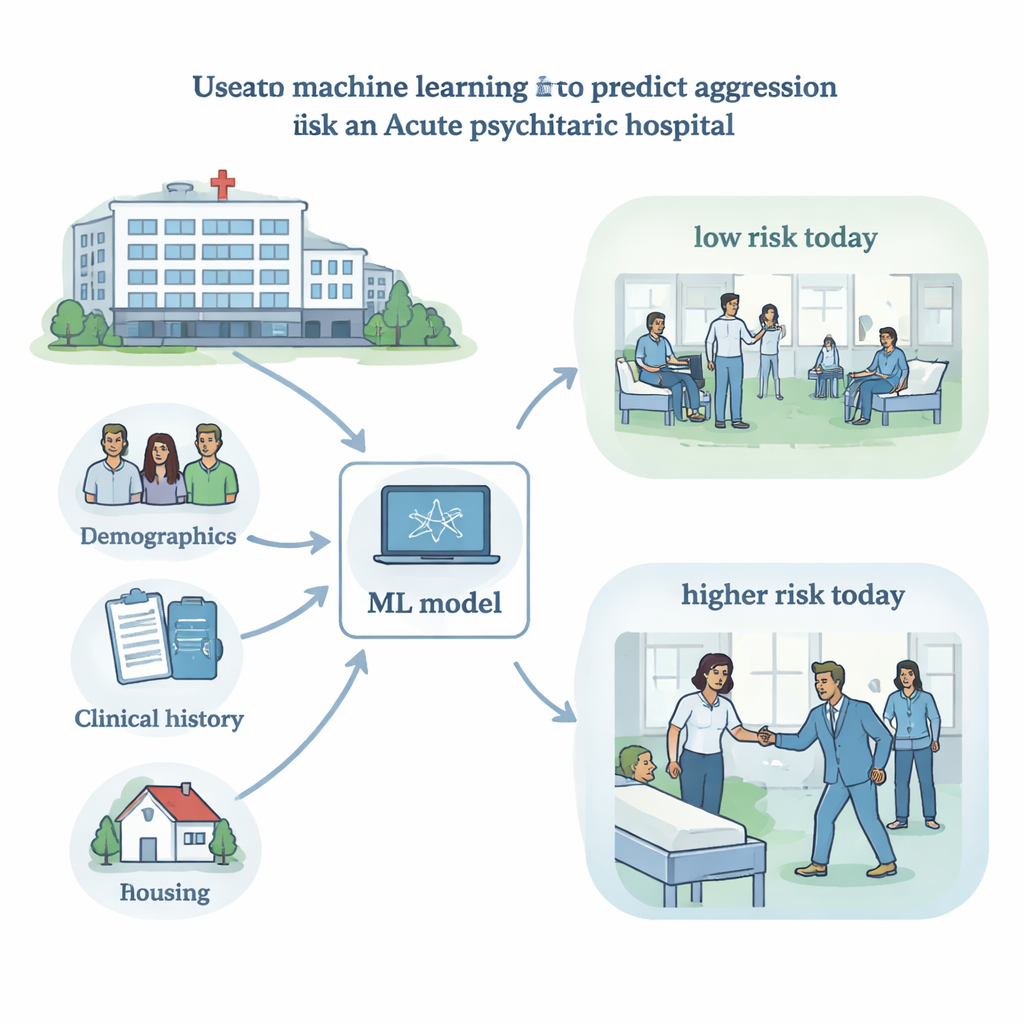

שימוש בנתוני בית חולים לזיהוי סיכון לטווח הקצר

החוקרים ניתחו רשומות של יותר מ-17,000 מטופלים שטופלו ביחידות פסיכיאטריות אקוטיות בבית חולים גדול בתחום בריאות הנפש בקנדה בין השנים 2016 ל-2022. עבור עד שלושה ימים במהלך אשפוז, הצוות רשם רשימות בדיקה סטנדרטיות ליד המיטה בשם Dynamic Appraisal of Situational Aggression (DASA), שמדרג התנהגויות כמו עצבנות או איומי מילוליים שעשויים להצביע על אלימות קרובה. הצוות שילב ציונים אלה עם מידע שנאסף בקבלה, כגון אבחנה, גיל, מין, גזע או אתניות, מצב דיור ואופן הגעת האדם לבית החולים, כדי לאמן מודל למידת מכונה שחזה האם המטופל יהיה מעורב באירוע אלים (כולל שימוש בכוח או בידוד) ב-24 השעות הבאות.

כיצד הכלי התחזיתי ביצע באופן כללי

המערכת שהניבה את הביצועים הטובים ביותר השתמשה בשיטת למידת מכונה פופולרית בשם random forest. על נתוני מבחן שהושארו מחוץ לאימון היא דרגה נכונה לעתים רבות ימים בסיכון גבוה יותר, והשיגה "שטח תחת העקומה" של כ-0.81, בדומה לכלים דומים בפסיכיאטריה. עם זאת, אלימות הייתה נדירה — היו בערך 33 ימים ללא אירועים עבור כל יום עם אירוע — כך שהמודל עדיין החמיץ הרבה אירועים אמיתיים וייצר כמה אזעקות שווא. מדדי חשיבות הראו כי גורמים קליניים רגעיים, במיוחד פריטי DASA כמו עצבנות ואירועים קודמים אחרונים, תרמו הכי הרבה לניבוי, יותר מאשר דמוגרפיה בלבד. משמעות הדבר היא שהמודל זיהה סימנים קליניים מהותיים, אך מדדי הביצועים לבדם לא גילו האם ניתן לבטוח בו באופן שווה עבור כולם.

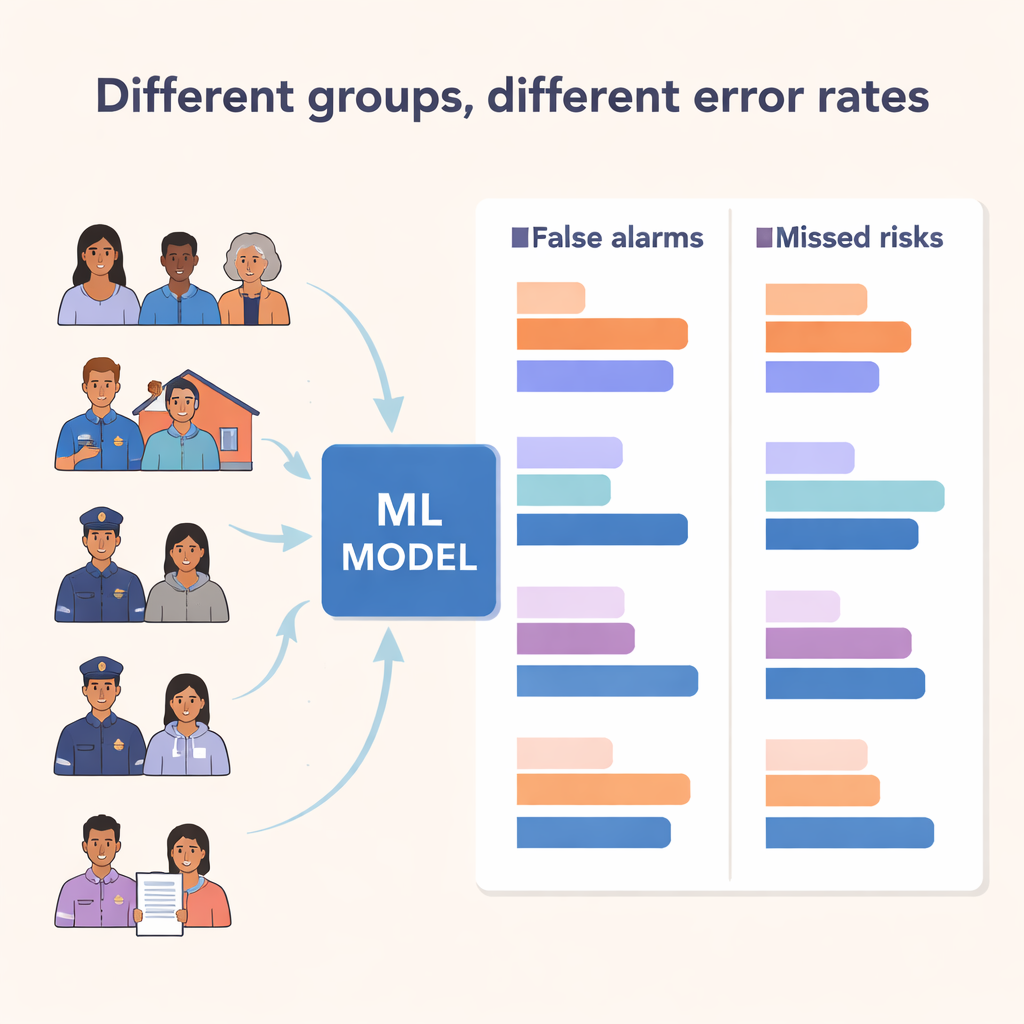

טעויות לא שוות בין קבוצות שונות

הליבה של המחקר הייתה בדיקת הוגנות. הצוות התמקד בשני סוגי שגיאות: אזעקות שווא, שבהן המודל מסמן סיכון אך לא קורה דבר, וחיוביים אמיתיים, שבהם הוא צופה כהלכה אירוע. מודל הוגן, לפי סטנדרט נפוץ הנקרא "הסתברויות שוות" (equalized odds), אמור להציג שיעורי אזעקות שווא ושיעורי זיהוי אמיתיים דומים בין הקבוצות. במקום זאת, החוקרים מצאו הבדלים גדולים. שיעורי אזעקות שווא היו גבוהים יותר עבור מטופלים ממוצא מזרח תיכוני ושחורים, גברים, אנשים שהובאו לבית החולים על ידי המשטרה, וכן אלה שהיו חסרי דיור או במגורי תמיכה. בחלק מהקבוצות — כגון מטופלים שהובאו על ידי המשטרה או אנשים עם דיור בלתי יציב — נצפו גם שיעורי גילוי גבוהים וגם שיעורי אזעקות שווא גבוהים, דבר המרמז שהמודל הוגדר להיות רגיש יותר עבורם. אחרות, כגון מטופלים שחורים, חוו שילוב מדאיג: יותר אזעקות שווא ויכולת נמוכה יותר לזהות סיכון אמיתי.

כשהזהויות חופפות, הפערים מתרחבים

מאחר שחוויות של אנשים מעוצבות על ידי יותר מתכונה אחת בו-זמנית, החוקרים בחנו גם זהויות חופפות, ובעיקר את השילוב של גזע או אתניות ומין. כאן, הדגל האדום הגדול ביותר הופיע אצל גברים ממוצא מזרח תיכוני, שהציגו את שיעור האזעקות השווא הגבוה ביותר מכל קבוצה, בעוד שנשים ממוצא מזרח תיכוני לא הראו זאת. גברים שחורים ואינדיג'ניים גם הם התמודדו עם שיעורי אזעקות שווא מוגברים בהשוואה לנשים מהרקע עצמו. דפוסים אלה מהדהדים אי-שוויונות מתועדים היטב בטיפול בבריאות הנפש, כגון שיעורים גבוהים יותר של מעורבות משטרה, אשפוז כפוי ואבחנות שגויות בקרב קבוצות מסוימות וגברים. מערכת למידת המכונה לא יצרה את אי-השוויונות האלה, אך למדה מנתונים שטבולים בהם — וסיכנה להעצים אותם בהחלטות קליניות.

מה משמעות הדבר לעתיד הבינה המלאכותית בפסיכיאטריה

המחברים טוענים כי ניתוח הוגנות חייב להיחשב לבדיקת בטיחות מרכזית, לא כבונוס אופציונלי, לפני שמכניסים כלי חיזוי לשימוש. הם מציינים ששיטות טכניות ל"הפחתת הטיה" — כמו התאמת נתוני אימון או קביעת ספי אזעקה שונים לקבוצות שונות — יכולות לעזור, אך מוגבלות אם הרשומות הבסיסיות כבר משקפות טיפול בלתי שוויוני ופרקטיקות כפייה. בסופו של דבר, ההחלטה מה נחשב "מודל הוגן" אינה רק בעיית מתמטיקה; זו שאלה חברתית ואתית שדורשת שיתוף מטופלים, קלינאים וקהילות. המחקר מראה כי בעוד שלמידת מכונה יכולה לסייע בזיהוי סיכון להתפרצות אלימות בטווח הקצר, היא עלולה גם לשכפל בצורה שקטה גזענות מבנית, סקסיזם וחוסר שוויון בדיור — אלא אם נמדדת, נדונה ומטופלת ההוגנות בקפדנות.

ציטוט: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

מילות מפתח: הוגנות אלגוריתמית, אלימות בפסיכיאטריה, למידת מכונה במערכת הבריאות, אי-שוויון בבריאות, מודלים לחיזוי סיכון