Clear Sky Science · he

הגדרת בטיחות תפעולית במערכות בינה מלאכותית קליניות

מדוע חשוב שהבינה המלאכותית תהיה בטוחה ברפואה

בתי חולים מאמצים במהירות בינה מלאכותית לקריאת סריקות ולסימון מחלות, אך יש שאלה שמדדי הדיוק הרגילים אינם יכולים לענות עליה: מתי באמת בטוח לאפשר למערכת להכריע? המאמר מציג שיטה מעשית להחליט מתי רופאים יכולים להסתמך בביטחון על מערכת בינה מלאכותית, מתי עליהם להתעלם ממנה ומתי עליהם לבחון את המקרה בעצמם. המטרה אינה רק לבנות אלגוריתמים חכמים יותר, אלא לשלבם בטיפול היומיומי באופן שמגן על חולים, מצמצם בדיקות מיותרות ומקל על העומס על הקלינאים במקום להחמיר אותו.

מחטיבת ציונים אחת לשלוש אזורי פעולה ברורים

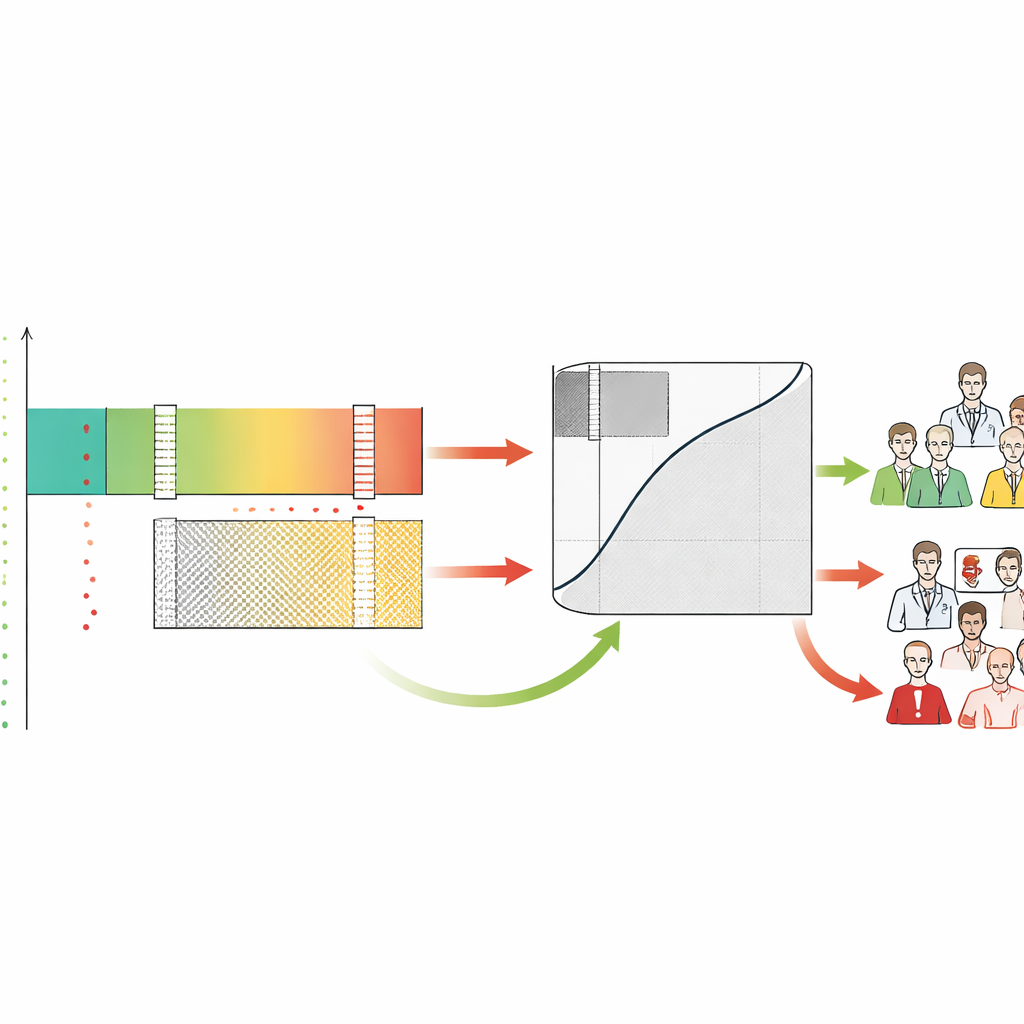

רוב כלי ה-AI הרפואיים מפיקים ציון סיכון יחיד, כמו ההסתברות שממוגרפיה מצביעה על סרטן. באופן מסורתי מפתחים שופטים כלים אלה באמצעות עקומה המסכמת עד כמה הם מבחינים בין חולים לבריאים בכלל. המחברים טוענים שזה לא מספיק. הם מציעים את מסגרת ה-Safety-Aware ROC (SA-ROC), שמתחילה מאותם ציוני סיכון אך מעצבת אותם מחדש לשלושה אזורים פרקטיים. אזור "כלל-בשביל" בציון גבוה מכיל חולים שהתוצאות שלהם אמינות דיו כדי להצדיק פעולה, כגון מעקב דחוף. אזור "כלל-מחוץ" בציון נמוך מכיל חולים שהתוצאות שלהם אמינות דיו כדי להוריד עדיפות בבטחה. ביניהם נמצא "אזור האפור" של אי־וודאות, שבו ה-AI אינו אמין דיו ויש לבקש סקירה של מומחה אנושי.

מתן לרופאים לקבוע את סף הבטיחות

בעיקרו של דבר, SA-ROC מאפשרת לרופאים ולמוסדות להגדיר מראש את היעדי הבטיחות שלהם. הם בוחרים כמה בטוחים הם רוצים להיות לפני שיפעלו על תוצאה חיובית (הסיכוי המינימלי המקובל שממצא שסומן הוא אכן חריג) וכמה בטוחים הם רוצים להיות לפני שירגיעו בעקבות תוצאה שלילית (הסיכוי המינימלי המקובל שמקרה ששוחרר הוא אכן תקין). בהתחשב ביעדים אלה, המסגרת מחפשת בציוני המודל כדי למצוא את הגבולות המדויקים שעומדים בדרישות. ציונים מעל הגבול העליון יוצרים את אזור ה"כלל-בשביל" הבטוח, ציונים מתחת לגבול התחתון יוצרים את אזור ה"כלל-מחוץ" הבטוח, וכל השאר ביניהם הופכים לאזור האפור. לאחר מכן המסגרת כמותית מראה כמה חולים נופלים בכל אזור וכמה עומס לא-פתור של אי־וודאות—מקרים שנשלחים חזרה לבני אדם—ה-AI משאיר.

חשיפת הבדלים נסתרים בין AIs דומים

המחברים מראים ששתי מערכות AI עם דיוק מסורתי כמעט זהה יכולות להתנהג באופן שונה מאוד כאשר מסתכלים עליהן דרך עדשת הבטיחות הזו. בסימולציות, מודלים עם ביצוע כולל זהה ייצרו גדלים שונים מאוד של אזורי כלל-בשביל, כלל-מחוץ ואזור אפור בהתאם לאופן שבו ציוניהם התפלגו. אחד יכול להצטיין באימות מחלה בביטחון גבוה, בעוד אחר עשוי להצטיין בשחרור בטוח של מספר גדול של חולים בסיכון נמוך. במחקר מקרה מהעולם האמיתי של שני כלים שאושרו על ידי ה-FDA לבדיקת סרטן השד בארה"ב, המערכת עם ציון הדיוק הסטנדרטי הגבוה יותר היתה למעשה גרועה יותר לסינון בביטחון גבוה. בהגדרת הבטיחות המחמירה ביותר—שלא מתירה החמצת סרטן בקבוצת הסיכון הנמוך—המערכת הנתפסת כחלשה יותר הסירה בבטחה כמעט פי שניים נשים מתור הרדיולוג. לפיכך SA-ROC חושפת סוג של "היפוך ביצועים" שמדדים קונבנציונליים מסתירים.

הבנת המתחים והעומס בין אדם ל-AI

על ידי תיוג כל מקרה כ"כלל-בשביל", "כלל-מחוץ" או "אזור אפור", המסגרת גם חושפת כיצד רופאים אנושיים מתנהגים באזורים אלה. המחברים מצאו שרדיולוגים לעיתים קרובות קוראים יתר על המידה מקרים שה-AI קבע כבעלי סיכון נמוך בבטחה, ויוצרים הרבה אזעקות שווא בדיוק באזור שבו המכונה הייתה האמינה ביותר. לעומת זאת, גם בני אדם וגם ה-AI התקשו באזור האפור, מה שמאמת שהוא באמת האזור שצריך תשומת לב מומחים. SA-ROC תופסת את גודל אזור האפור במספר יחיד, המייצג את עלות היסוס. אזור אפור קטן משמעותו אוטומציה בטוחה יותר ופחות עומס אנושי; אזור אפור גדול משמעותו שרבים מהמקרים עדיין דורשים בדיקה מסוימת ידנית ושהמערכת עלולה להגביר שחיקה במקום להקל עליה.

הפיכת כללי בטיחות לפרקטיקה יומיומית

מעבר למדידה, המסגרת עוצבה ככלי מינהלי שהופך מדיניות להתנהגות AI קונקרטית. בתי חולים יכולים להשתמש בה בשתי דרכים. ראשית, הם יכולים להגדיר ישירות דרישות בטיחות או מגבלות לגבי כמה מקרים הם מוכנים לשלוח לאזור האפור ולתת למסגרת לחשב את הספים המתאימים. שנית, הם יכולים להקצות ערכים ועונשים לתוצאות שונות—ללכידת סרטן, להחמצתו, להזמנת בדיקה מיותרת או לדחייה לביקורת אנושית—ולבקש מהמסגרת לחפש את המדיניות שממקסמת את התועלת הכוללת. אסטרטגיות אלה ניתנות לכוונון למטרות שונות מאוד, כגון תוכניות סקר המוניות, הפניות למומחים או קבוצות מחקר, כל אלה תוך שימוש במודל הבסיסי הזהה.

מה זה אומר עבור חולים ורופאים

במילים פשוטות, עבודה זו מציעה דרך לומר לא רק "ה-AI הזה מדויק", אלא "הנה בדיוק מתי וכיצד ניתן לסמוך עליו במרפאה". על ידי חיתוך תפוקות ה-AI לאזורים בטוחים, לא בטוחים ובלתי ודאיים הקשורים להבטחות בטיחות מפורשות, SA-ROC מסייע למערכות בריאות להחליט מתי מכונות יכולות לפעול בעצמן ומתי בני אדם חייבים להישאר בשליטה. היא מדגישה שמדדי דיוק מסורתיים יכולים להטעות ושהבטיחות האמיתית תלויה בהתנהגות המודל בקצוות שבהם טעויות יקרות ביותר. אם יאומץ באופן נרחב ויותאם לאימותים גדולים יותר בסביבות אמיתיות, מסגרת זו עשויה לתמוך באוטומציה אמינה יותר, לצמצם אזעקות ובדיקות מיותרות ולהפוך את המקרים הקשים ביותר ל-AI—אזור האפור—למוקד ממוקד של למידה ושיפור הן לאלגוריתמים והן לרפואה עצמה.

ציטוט: Kim, YT., Kim, H., Bahl, M. et al. Defining operational safety in clinical artificial intelligence systems. npj Digit. Med. 9, 281 (2026). https://doi.org/10.1038/s41746-026-02450-7

מילות מפתח: בינה מלאכותית קלינית, בטיחות תפעולית, דימות רפואי, תמיכה בהחלטה, סיווג סיכונים