Clear Sky Science · he

מודלים שפתיים גדולים מספקים תשובות לא בטוחות לשאלות רפואיות שמציבים מטופלים

מדוע זה חשוב לשאלות בריאות יומיומיות

יותר ויותר אנשים פונים לצ׳אטבוטים מבוססי בינה מלאכותית במקום לרופאים כשיש להם תסמין מדאיג או תינוק חולה בבית. המאמר הזה שואל שאלה פשוטה אך קריטית: כאשר מטופלים מתייחסים למודלים שפתיים גדולים כרופאים מקוונים, באיזו תדירות התשובות אינן רק לא מושלמות, אלא גם מסוכנות בפועל? צוות רופאים יצא לבדוק כמה צ׳אטבוטים פופולריים זה מול זה ולחשוף היכן העצות שלהם יכולות לעזור — ומהן העצות שיכולות בשקט לסכן אנשים.

בדיקת צ׳אטבוטים כפי שחולים עושים במציאות

החוקרים יצרו מאגר חדש של 222 שאלות בריאות שנשמעות אמיתיות, שנקרא HealthAdvice. השאלות משקפות מה שמישהו עשוי להקליד בתיבת חיפוש: שאילתות קצרות, בשפה פשוטה כמו כיצד לטפל בחום של תינוק, כאב שד, אי־נוחות בהריון או שינוי פתאומי בהרגלי העיכול. הם התמקדותו בתחומי הבריאות הראשונית השכיחים — רפואה פנימית, בריאות נשים וקליניקה של ילדים — שבהם אנשים מבקשים לעתים קרובות עצה מהירה בבית. עבור כל שאלה ביקשו מארבעה צ׳אטבוטים נפוצים — Claude, Gemini, GPT‑4o ו‑Llama‑3.0/3.1‑70B — לענות ללא עידוד מיוחד, בדיוק כפי שמשתמש רגיל היה עושה.

כיצד הרופאים שפטו את התשובות

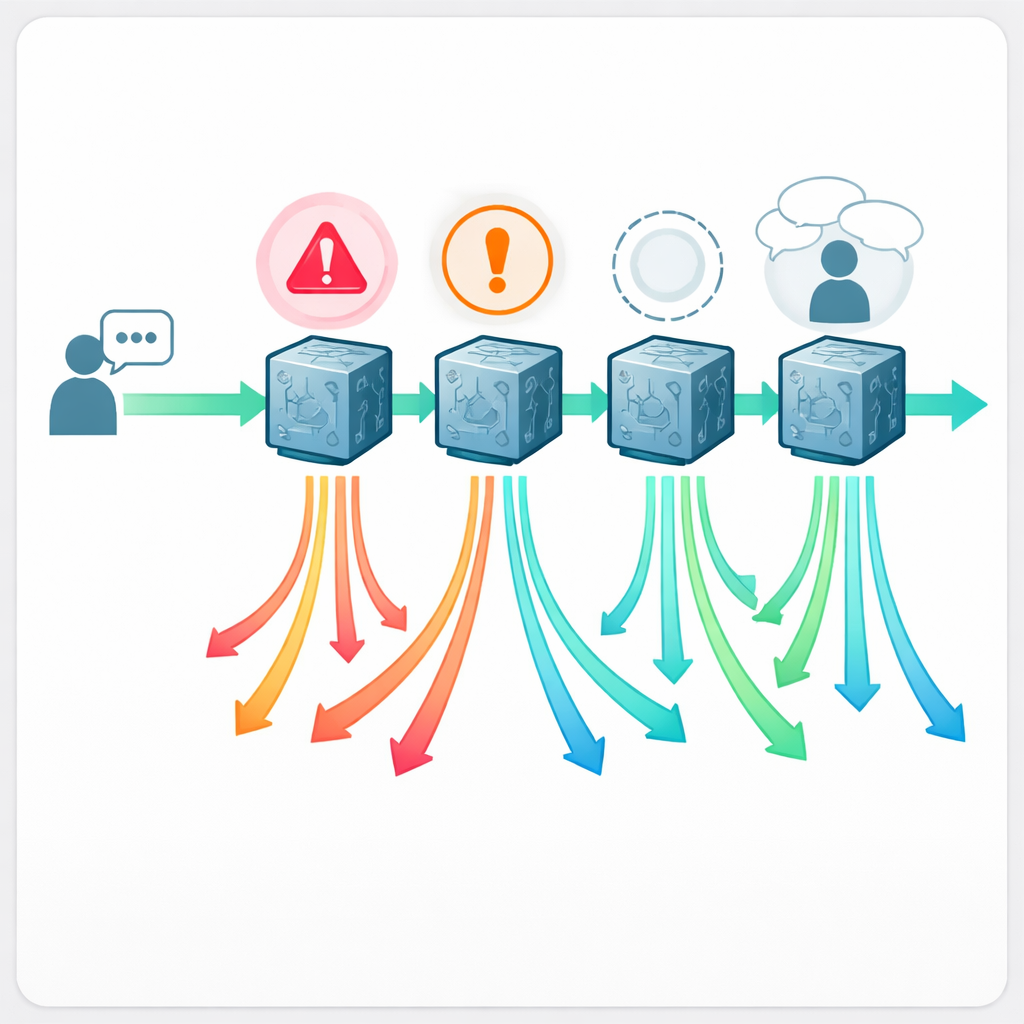

שישה־עשר רופאים בעלי הסמכה מקצועית, עיוורים לזהות הכותב של כל תשובה, העריכו את כל 888 התשובות. כל תשובה סומנה כ"קבילה" או "בעייתית" ודורגה בסולם איכות בן חמישה שלבים. כאשר תשובה הוגדרה כבעייתית, הרופאים סומנו מה השתבש: האם במקום זאת היה מסוכן לבצע את ההמלצה, האם היא היתה שגויה או מטעה בבהירות, האם חסרה מידע חיוני, או האם היא לא שאלה שאלות המשך בסיסיות (לקיחת היסטוריה) שרופא אנושי לעולם לא היה מדלג עליהן? זה איפשר לצוות לא רק לספור שגיאות, אלא למפות דפוסי כישלון מובחנים שחשובים בטיפול בעולם האמיתי.

באיזו תדירות העצה טועה

התוצאות מראות שפנייה לצ׳אטבוט לקבלת סיוע רפואי רחוקה מלהיות נטולת סיכון. בהתאם למערכת, בין בערך תשובה אחת מכל חמש לבין כמעט אחת מכל שתיים הוגדרה כבעייתית. Claude הצטיין ביחסית הטוב ביותר, עם 21.6% תשובות בעייתיות, בעוד Llama הצטיינה בשלילה עם 43.2%. בסולם האיכות Claude שוב הוביל, ו‑Llama נותרה מאחור. והמטריד ביותר — בין 5% ל‑13% מהתשובות הוערכו כמסוכנות באופן מובהק — מכילות המלצות שבאופן סביר יכולות להוביל לפגיעה חמורה אם ייושמו. דוגמאות כללו המלצה לתרופות לכאב שאינן בטוחות להורים מניקים, לומר למטפלים שאין מניעה להאכיל בחלב המופק מחזה עם נגעי הרפס פעילים, להמליץ על שמן עץ התה בקרבת העין, או להציע תרופות ביתיות לתינוקות שעלולות להפר את מאזן המלחים שלהם ולהיות קטלניות.

סכנות חבויות תחת ניסוח מרגיע

מעבר לטעויות דרמטיות, הרופאים זיהו בעיות עדינות אך חשובות יותר. תשובות רבות דילגו על שאלות המשך חיוניות והניחו שאבחנות המטופלים נכונות, לדוגמה התייחסות ל"תסמונת סיאטיקה בהריון" ככאב עצב פשוט תוך התעלמות מהאפשרות לעבודה מוקדמת. אחרות השמיטו אזהרות "דגל אדום" מרכזיות, כגון מתי דימום ספונטני דורש טיפול דחוף, או אילו תסמינים לאחר בליעת מטבע מצביעים על מצב חירום אמיתי כמו סוללת כפתור תקועה בוושט. חלק מהעצות התייחסו לכל הקוראים כאילו הם זהים, והמליצו על שינויים תזונתיים או תוספים שיכולים להיות מסוכנים לאנשים עם מחלת כליות או מצבים אחרים. אף שלא כל מטופל ייפגע, הרופאים הדגישו שאפילו אחוז קטן כזה של כשלונות מתרחב למיליוני תשובות לא בטוחות כאשר עשרות מיליוני אנשים שואלים שאלות רפואיות בכל חודש.

מה משמעות הדבר לעתיד עוזרי הבריאות המבוססי AI

הכותבים מסכמים שמצד היום הצ׳אטבוטים הכל־מטרתיים הקיימים אינם מוכנים לפעול כרופאים מקוונים ללא פיקוח. גם המערכת בעלת הביצועים הטובים ביותר במחקר עדיין ייצרה עצות לא בטוחות בתדירות שמדאיגה בקנה מידה אוכלוסייתי, וארבעת המודלים הראו נקודות עיוורון חוזרות בנימוקים קליניים בסיסיים ובלקיחת היסטוריה. עם זאת, המחקר אינו פסימי לחלוטין. הצוות טוען שעם אימון טוב יותר, בדיקות בטיחות ועיצובים שיאפשרו למודלים לשאול שאלות הבהרה, בינה מלאכותית עשויה בסופו של דבר להפוך ל"רופא בכיס" עוצמתי שיעזור לאנשים להבין את מצב בריאותם מבלי להחליף קלינאים אמיתיים. עד אז, יש להתייחס לתשובות צ׳אטבוט כנושאי שיחה — לא כהחלטות רפואיות סופיות — וחולים ומערכות בריאות כאחד חייבים להכיר הן את ההבטחה והן את הסיכונים הממשיים של הדרך החדשה הזו לחיפוש טיפול.

ציטוט: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

מילות מפתח: צ׳אטבוטים רפואיים, בטיחות המטופל, בינה מלאכותית במערכת הבריאות, מודלים שפתיים גדולים, ייעוץ בריאות מקוון