Clear Sky Science · he

GWKNN: אלגוריתם k-הקרובים המשודרג עם שיחזור מטריקה G ומממטי זאבי האפור

זיהוי דפוסים חכם יותר בעידן שיטפון הנתונים

מסריקות רפואיות ועד עסקאות בנקאיות — החיים המודרניים מייצרים ים של נתונים. הרבה מהמידע הזה צריך להיות ממוין אוטומטית לקטגוריות: בריא או חולה, הונאה או תקין, דואר זבל או אמיתי. עבודת סוס קלאסית למשימה כזו היא אלגוריתם k-הקרובים ביותר (KNN), שמסווג דוגמה חדשה על־ידי בחינת הדוגמאות ההיסטוריות הדומות ביותר. אך ככל שהמאגרי נתונים גדלים, מסתבכים ומאוזנים פחות, הרעיון הפשוט הזה מתחיל לסבול. המאמר מציג את GWKNN, גרסה משודרגת של KNN שנועדה להשתמש חכם יותר במרחקים בין נקודות ולטפל במקרים נדירים אך חשובים בהוגנות רבה יותר.

מדוע הדמיון הפשוט לא מספיק

KNN המקובל מניח שכל התכונות של נקודת הנתונים תורמות באותה מידה ומודד דמיון באמצעות מרחק ישיר רגיל. זה יכול לעבוד היטב כאשר הנתונים ממדיים נמוכים ומופרדים באופן נקי, אבל בעולם האמיתי הנתונים לעתים קרובות בעלי מימדים גבוהים, רועשים ותערובת של סוגי מידע שונים. במקרים כאלה המרחק הרגיל עלול להטעות ולגרום לאלגוריתם לבחור שכנים שאינם מועילים. במקביל, רבים ממאגרי הנתונים לא מאוזנים: קטגוריות נפוצות שולטות, בעוד קטגוריות נדירות אך קריטיות, כמו מחלה בשלבים מוקדמים, מיוצגות פחות. כאשר KNN מצביע בין הדוגמאות הקרובות, מחלקת הרוב נוטה לטבוע אותן, מה שמוביל להטיות ולפעמים להחלטות מסוכנות.

ללמד את האלגוריתם להבחין מרחק טוב יותר

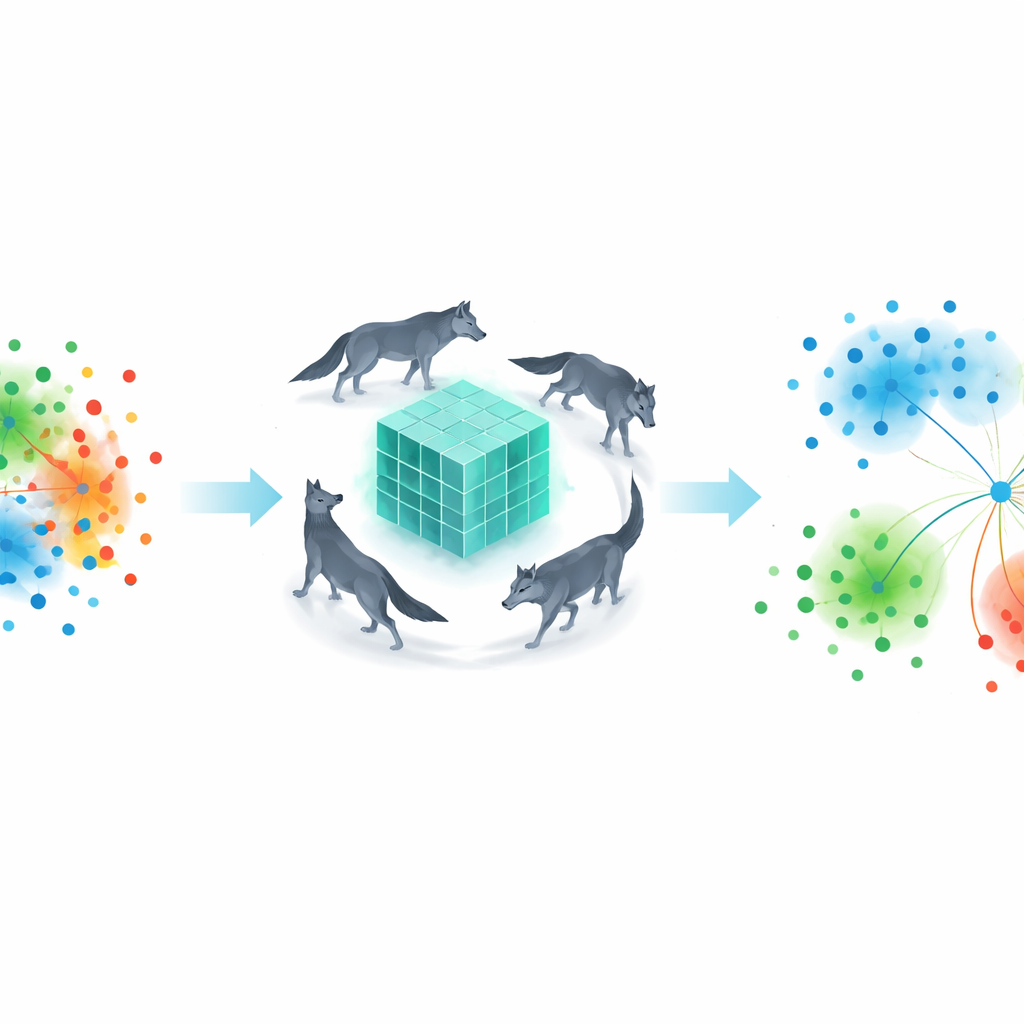

החידוש המרכזי הראשון ב-GWKNN הוא מדד מרחק שנלמד. במקום לקבע את כלל המרחק הישיר הרגיל, המחברים מאפשרים לאלגוריתם לגלות כיצד יש למדוד מרחק בין נקודות באופן שמפריד את המחלקות בצורה מיטבית. הם מקודדים זאת במטריקה גמישה בשם "מטריקת G" שמעצבנת את המרחב כך שתכונות אינפורמטיביות יקבלו משקל גדול יותר ותכונות מיותרות יקבלו משקל נמוך יותר. כדי לכוונן מטריקה זו שואבים מהמחברים השראה מהתנהגות הציד של זאבי האפור. הליך אינטליגנציה קבוצתית, הקרוי אופטימיזר זאבי האפור, חוקר דרכים רבות למתוח ולדחוס את מרחב הנתונים, ושומר את אלה שמקטינות את שגיאות הסיווג תוך שמירה על יציבות מתמטית. על פני איטרציות רבות, ה"זאבים" הווירטואליים מתכנסים לכלל מרחק שהופך נקודות דומות לצבור יחד באופן אמין יותר, גם במאגרי נתונים בעלי מימדים גבוהים ומסובכים.

לתת מקרים נדירים קול חזק יותר

השיפור השני מכוון להטיית ההצבעה. KNN הרגיל סופר פשוט כמה משכני ה-k שייכים לכל מחלקה ובוחר את הרוב. GWKNN, במקום זאת, שוקל כל קול לפי תדירות המחלקה בנתוני האימון הכוללים. למחלקות שמופיעות פחות תדיר מוענקים משקלים חזקים יותר; למחלקות תכופות מאוד מוענקים משקלים חלשים יותר. ערך החלקה קטן מונע שמחלקות נדירות באופן קיצוני ישפיעו יתר על המידה על ההחלטה. כך, אם נקודת נתונים חדשה קרובה לכמה דוגמאות ממחלקת המיעוט ולרבים ממחלקת הרוב, האותות של המיעוט אינם נחסמים אוטומטית. הסכימה פשוטה לחישוב אך בעלת אפקט עוצמתי: היא דוחפת את הממיין לשים לב יותר לדפוסים נדירים אך משמעותיים, ומשפרת הוגנות וזכירה (recall) למחלקות המיעוט.

בחינת השיטה החדשה

כדי לבדוק האם GWKNN באמת מסייע במציאות, המחברים העריכו אותו על 12 מאגרי נתונים תקניים ממאגר UCI המוכר. אוספים אלה כוללים נתונים פיננסיים, מדידות רפואיות, כתב יד, זרעי צמחים ומספר מאגרי נתונים בעלי מימדים גבוהים מתחומי סרטן וביטוי גנים, עם בעיות בינאריות ורבות-מחלקות. הם השוו ארבע גרסאות של KNN: הבסיסית הפשוטה, גרסה עם מטריקת המרחק החדשה בלבד, גרסה עם משקלי ההצבעה החדשים בלבד, ו-GWKNN המלא שמשלב את שתי הרעיונות. הם גם השוו את GWKNN לשבעה ממיינים נפוצים, כולל מכונת וקטורים תומכת, עצי החלטה, יער אקראי, רגרסיה לוגיסטית, נאיב בייז ורשת עצבית. על פני חלוקות אימון–בדיקה חוזרות, הם עקבו לא רק אחרי דיוק ממוצע אלא גם עד כמה התוצאות התנודדו.

תוצאות: מדויק יותר ועקבי יותר

הגישה המשולבת של GWKNN יצאה במקום הראשון או שותפה למקום הראשון ברבות מהערכות, במיוחד במאגרי נתונים בעלי הרבה תכונות וגדלים לא-זהים של מחלקות. במשימות יחסית פשוטות כל השיטות עבדו טוב והרווחים היו צנועים, אבל GWKNN עדיין נטה לשפר במעט את הדיוק ולהפחית את הווריאביליות. במאגרים קשים יותר של ביטוי גנים עם אלפי תכונות, היתרונות בלטו יותר: מטריקת המרחק שנלמדה סייעה לאלגוריתם ליצור שכונות משמעותיות יותר, ומשקלי ההצבעה שיפרו את הזיהוי של מחלקות מיוצגות פחות. בדיקות סטטיסטיות על כל המאגרי נתונים אישרו כי הדירוגים של GWKNN היו טובים משמעותית מאלו של KNN הסטנדרטי וכמה מודלים קלאסיים, מה שמעיד שהשיפורים אינם רק תנודות מקריות אלא חזקים בתנאי נתונים שונים.

מה זה אומר עבור החלטות יומיומיות בנתונים

לקורא שאינו מומחה, המסקנה היא ש-GWKNN משכלל רעיון אינטואיטיבי מאוד—"להסתכל על מקרים דומים מהעבר"—כדי להתאים טוב יותר למציאות המבולגנת של נתונים מודרניים. על ידי למידה של אופן מדידת הדמיון באופן מונחה-נתונים ובהגברת השפעתן של קטגוריות נדירות בזמן ההצבעה, השיטה שואפת להיות גם מדויקת יותר וגם הוגנת יותר. אמנם המורכבות הנוספת מביאה עימה עלות חישובית גבוהה יותר, במיוחד עבור מאגרי נתונים מאוד גדולים ובעלי מימדים גבוהים, אך GWKNN מראה פוטנציאל חזק למשימות שבהן סיווג נכון של מקרים מהקצה באמת חשוב, כמו גילוי מוקדם של מחלות או זיהוי הונאות. העבודה ממחישה כיצד ניתן לשדרג אלגוריתמים קלאסיים בתובנות מאופטימיזציה והוגנות כדי לעמוד בקצב הסקלת והמורכבות של המידע היום-יומי.

ציטוט: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

מילות מפתח: k-הקרובים ביותר, למידת מטריקות מרחק, אי-איזון במחלקות, אינטליגנציה קבוצתית, סיווג נתונים