Clear Sky Science · he

מסגרת משולבת למניעת deepfake יזומה באמצעות סימון מים מונחה־תשומת לב ואימות אותנטיות מבוסס־בלוקצ’יין

למה סרטונים מזויפים הם בעיה של כולנו

כיום אפשר לזייף סרטונים שנראים ונשמעים אמיתיים באמצעות תוכנות מסחריות, מה שמטשטש את הגבול בין אמת לבדיה באינטרנט. מה שמכונה deepfakes כבר משמש להונאות, הטרדות ותכסיסים פוליטיים. במקום לנסות לזהות זיופים אחרי שכבר התפשטו, המחקר הזה שואל שאלה אחרת: מה אם נוכל להגן בשקט על סרטונים מקוריים ברגע שנוצרים, כך שכל שינוי מאוחר יוכר מיד?

ממרדף אחרי זיופים להגנה על המקור

מחקרים רבים כיום מנסים לתפוס deepfakes בדיעבד, על‑ידי אימון אלגוריתמים לזהות כשלים זעירים שמשאירים אחריהם מודלים יוצרים. ככל שמודלים אלה משתפרים, המשחק של חתול ועכבר נהיה קשה יותר. המחברים טוענים לגישה יזומה: להגן על חומר מקורי בעת ההקלטה, כדי שלצופים ולפלטפורמות יהיה אפשר לבדוק מאוחר יותר אם מה שהם רואים הוא המקור הבלתי מעובד. המסגרת שלהם משלבת שלוש שכבות: מנתח וידאו חכם שמחליט היכן ההגנה חשובה ביותר, אָפָּן דיגיטלי בלתי נראה המשולב בכל פריים, ורישום בלוקצ’יין שנועל את זהות הקובץ בכללותו.

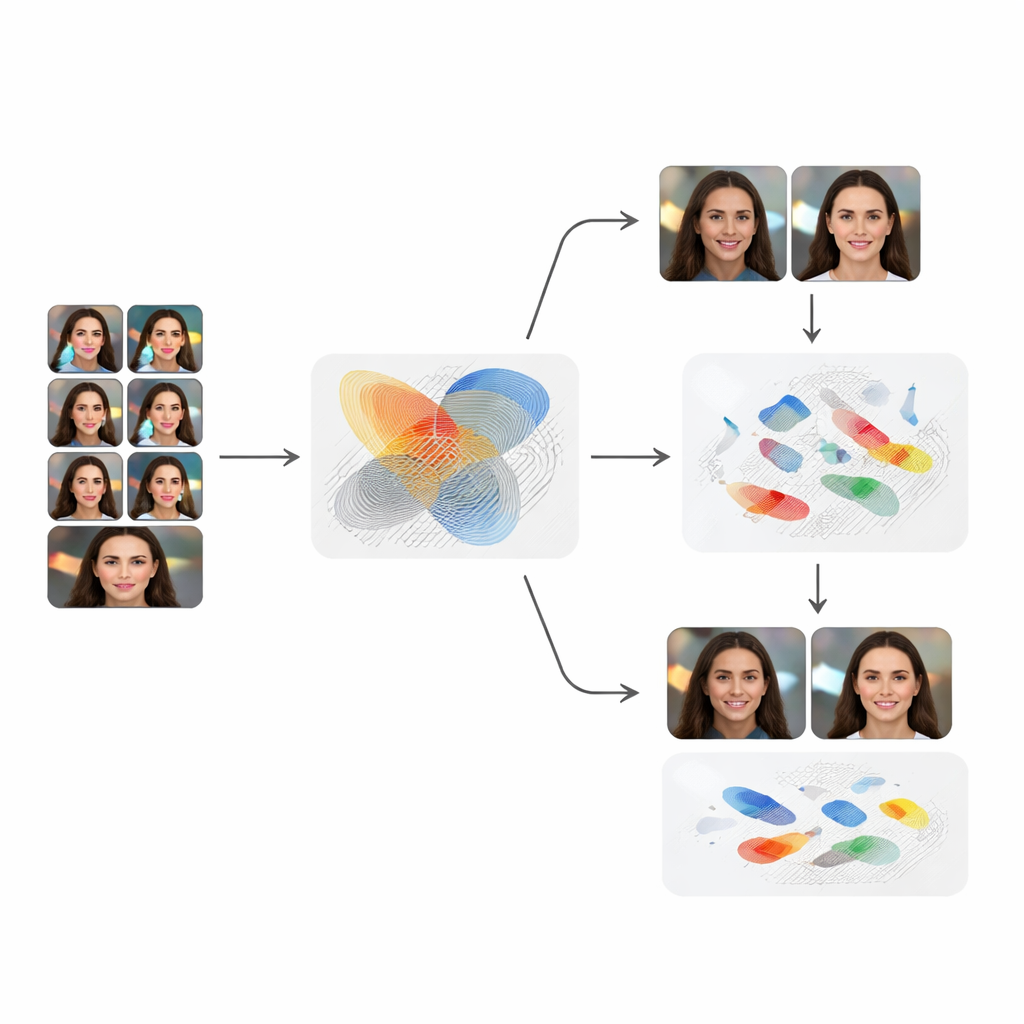

ללמד את המערכת מה באמת חשוב בווידאו

השכבה הראשונה היא מודל תשומת לב שלומד אילו חלקים בווידאו נושאים את התנועה והפרטים המשמעותיים ביותר לאורך זמן. הצוות מאמן רשת קומפקטית אך עוצמתית על אלפי קטעים יומיומיים שמציגים אנשים מבצעים פעולות. חלק מהרשת בוחן כל פריים כתמונה סטילס, בעוד חלק אחר מסתכל על אופן התנועה בחתיכות של 16 פריימים. יחד הם משיגים יותר מ־97% דיוק במבחן תקן לזיהוי פעולות, מה שמראה שהמערכת למדה דפוסים עשירים של שינויי אנשים וסצנות לאורך זמן. דפוסים אלה מומרצים למפות תשומת לב שמדגישות אזורים שבהם כל התערבות תשנה בצורה המשמעותית ביותר את הסיפור שהווידאו מספר.

להחביא סימן סודי במקום שבו המזייפים יגרמו לנזק הגדול ביותר

בהמשך, סימן דיגיטלי בלתי נראה — סימון מים — מוטמע בכל פריים, אך לא בצורה פשוטה ואחידה. רשת יוצרת משנה (generative network) מייצרת תבנית עדינה הדומה לרעש, שמוטמעת בחוזקה רבה יותר באזורים שמודל התשומת לב מסמן כחשובים, כגון פנים או ידיים בתנועה, וחלש יותר במקום אחר כדי לשמור על איכות הוויזואלית. הצופים אינם שמים לב לשינוי, וצייני איכות מאשרים שהפריימים המסומנים כמעט בלתי ניתנים להבחנה מהמקוריים. עם זאת, התבנית חזקה ומורכבת מספיק כך שרשת מותאמת שבאופן מעין מפענח יכולה בשלב מאוחר יותר לשחזר את החתימה הסמויה מהחומר המקורי, פריים אחר פריים.

לבחון את הוגי ה‑deepfake והעיוותים היומיומיים

כדי לבדוק האם ההגנה נשמרת בעולם האמיתי, המחברים מריצים סדרת מבחנים קשים. תחילה הם מסמנים מים על מערך מגוון של קליפים קצרים מספקי מדיה ואז מזינים אותם ל־DeepFaceLab, אחד מכלי החלפת הפנים הנפוצים ביותר, כדי ליצור deepfakes משכנעים. בכל אחד מ־50 הקליפים המופעלים, הסימון הנסתר נהרס או נבלבל קשות, והמערכת מצביעה נכון על כך שהווידאו תוקן. השיטה עומדת גם בפני שלבי עיבוד נפוצים כגון דחיסה חזקה, שינוי גודל וטשטוש שמתרחשים לעתים קרובות כאשר קליפים משותפים ברשת, אם כי רעש אקראי חזק מאוד בסופו של דבר עלול להציף את האות הנסתר. ניסויים מדוקדקים מראים כי גם הנחיית התשומת לב וגם השימוש בתנועה לאורך זמן הם חיוניים; הסרת אחד המרכיבים מחלישה משמעותית את ההגנה.

לנעול אמון עם טביעת אצבע קבועה

השכבה הסופית חורגת מתוכן הפריימים ומאבטחת את קובץ הווידאו עצמו. לאחר סימון המים, הקובץ המלא עובר פונקציה קריפטוגרפית שמייצרת טביעת אצבע דיגיטלית קצרה. טביעת האצבע הזו, יחד עם מידע בסיסי על הקליפ, נכתבת לבלוקצ’יין, שם אי‑אפשר לשנותה מבלי להשאיר עקבות. מאוחר יותר, כל אחד יכול להעלות עותק של הווידאו: המערכת מנסה לשחזר את סימון המים ומחשבת מחדש את טביעת האצבע הקריפטוגרפית. אם גם הסימון הסמוי וגם טביעת האצבע תואמים לרשומות המקוריות, ניתן להתייחס לווידאו כאותנטי בביטחון גבוה; אם אחד מהם נכשל, הצופים יודעים שהחומר שונה.

מה זה אומר לגבי הסרטונים שאתם רואים

במילים פשוטות, עבודה זו מראה שניתן לעבור מניחוש האם וידאו מזויף להוכחה שמדובר בווידאו אמיתי. על‑ידי הטמעת סימן חכם וקשה לזייף בחלקים המשמעותיים ביותר של כל פריים וגיבוי ברישום חסין־הטלאות, המסגרת תופסת את כל התקפות החלפת הפנים שנבדקו ושורדת עיוותים יומיומיים רבים. למרות שהיא עדיין מתקשה לרעש חזותי קיצוני ודורשת בדיקות רחבות יותר, היא מצביעה על עתיד שבו מצלמות, פלטפורמות וחדרי חדשות יוכלו לספק סרטונים עם הוכחת אותנטיות מובנית — מה שיוקשה על deepfakes להעמיד פנים כאמת.

ציטוט: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

מילות מפתח: הגנה מפני deepfake, אותנטיות וידאו, סימון מים דיגיטלי, אימות בלוקצ’יין, אבטחת מדיה