Clear Sky Science · he

מסגרת גמישה לאופטימיזציה של היפרפרמטרים באמצעות הומוטופי ומודלים חלופיים

מדוע כיוון המיפעילים של ה-AI חשוב

מערכות בינה מלאכותית מודרניות תלויות לא רק באלגוריתמים חכמים ובכמויות גדולות של נתונים, אלא גם בשכבה בלתי צפויה של הגדרות שנקראות "היפרפרמטרים". אלו הם המתגים שמחליטים עד כמה גדול יהיה המודל, כמה מהר ילמד וכיצד יתמודד עם נתונים עם רעש. קביעתן בצורה לא נכונה עלולה להפוך מערכת מבטיחה לכושלת. מאמר זה מציג את HomOpt, שיטה חדשה לכוונון ההיפרפרמטרים בצורה יעילה ואמינה יותר, במיוחד כאשר מרחב החיפוש עצום ומפותל — מה שהופך אותה לאטרקטיבית לכל מי שרוצה לשפר ביצועי AI עם פחות ניסוי וטעייה.

דרך חדשה להנחות את החיפוש

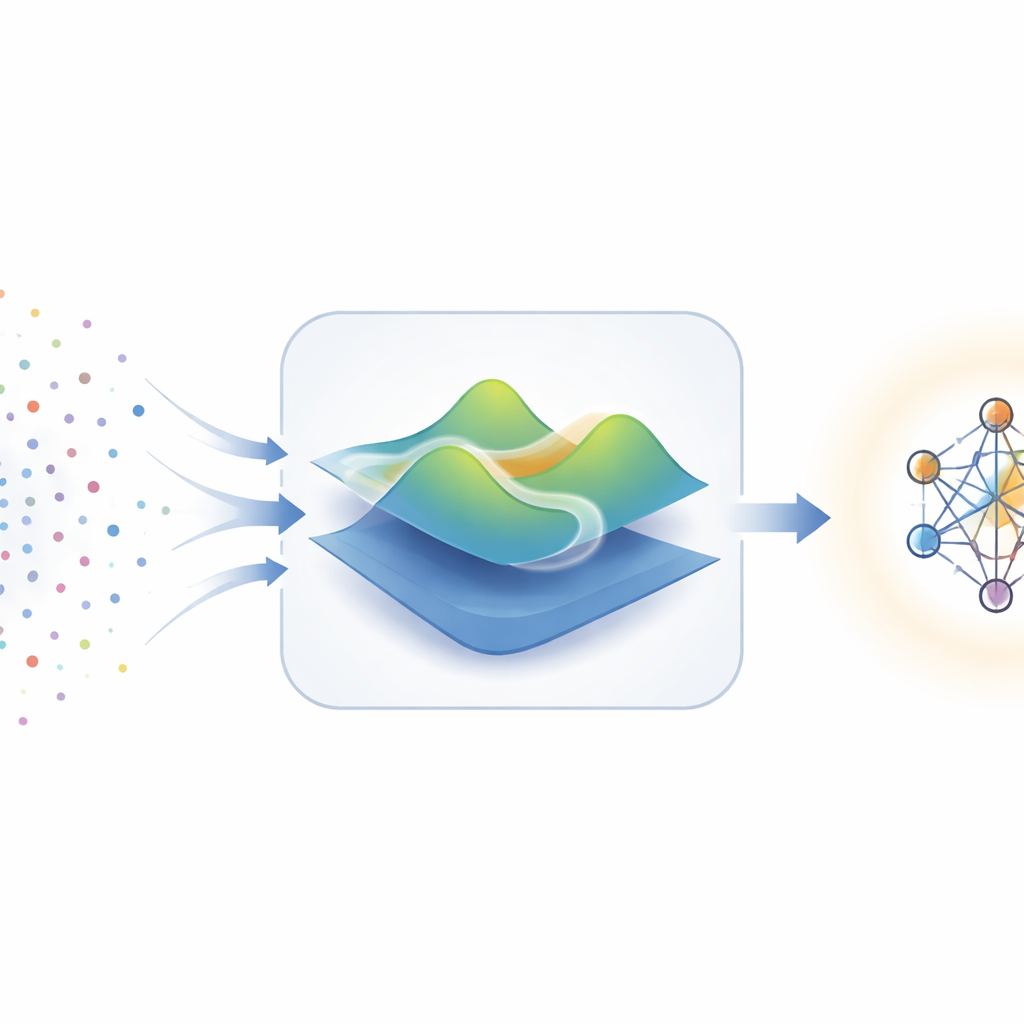

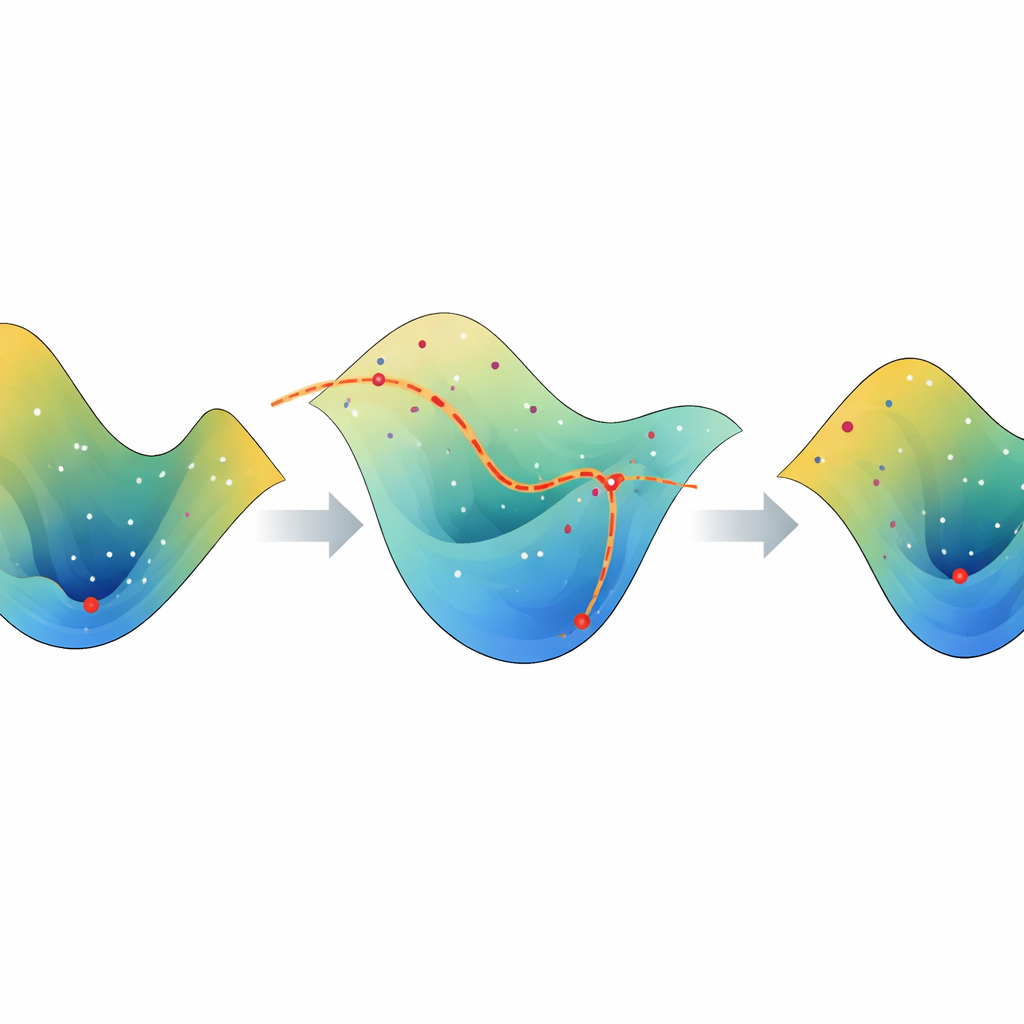

גישות מסורתיות לכוונון היפרפרמטרים, כמו חיפוש ברשת או חיפוש אקראי, הן קצת כמו ניסיון מתכונים שבו משליכים מרכיבים ומקווים שמשהו ייצא טעים. שיטות מתקדמות יותר, כגון אופטימיזציה בייסיאנית, מנסות לפעול בחוכמה על ידי בניית מודל מקביל שמעריך כיצד ההגדרות משפיעות על הביצועים, ואז משתמשות בו כדי לבחור את הצירוף הבא לנסות. אבל שיטות אלה מניחות ש"נוף" הביצועים חלק ומתנהג יפה — הנחה שלא תמיד מתקיימת בבעיות אמיתיות מלאות קיצוניות, רעש וקפיצות בלתי צפויות. HomOpt מתמודדת עם האתגר הזה על ידי בנייה חוזרת של תחליפים מקורבים לנוף האמיתי — שנקראים מודלים חלופיים — ואז שינוי הדרגתי ממודל חלופי אחד לשני ככל שמצטברים נתונים חדשים, תוך מעקב אחר התזוזה של הפתרון הטוב ביותר במהלך ההמרה.

להעביר מודלים בעדינות במקום להתחיל מחדש

הרעיון המרכזי מאחורי HomOpt נובע ממושג מתמטי הנקרא הומוטופי, שמשמעותו בפשטות היא עיצוב הדרגתי של צורה אחת לצורה אחרת ללא קריעה או קפיצה. במסגרת זו, כל מודל חלופי הוא תמונה מעומעמת של האופן שבו הגדרות היפרפרמטר שונות משפיעות על ביצועי המודל. כאשר נאספים תוצאות ניסוי חדשות, HomOpt בונה מודל חלופי מעודכן ומגדירה המרה רציפה בין הגרסה הישנה לחדשה. במקום לזרוק את העבודה הקודמת ולהתחיל את החיפוש מהתחלה, השיטה עוקבת איך הנקודה הטובה ביותר על המשטח הישן מחליקה על פני הנוף המתהווה כדי לנחות בנקודה טובה על המשטח החדש. תנועה מונחית זו הופכת את החיפוש ליותר מכוון ופחות אקראי, ומשפרת את הסיכוי למצוא הגדרות טובות במספר צעדים קטן יותר.

כלים גמישים לסוגי נתונים שונים

כדי להראות שהרעיון עובד בפועל, המחברים מתחברים לשתי קבוצות מאוד שונות של מודלים חלופיים בתוך HomOpt. ראשית, הם משתמשים במודלים היטלים מוכללים (Generalized Additive Models), חלקים ומעטים יותר לפרשנות, מה שהופך אותם שימושיים כאשר הקשרים בין ההגדרות והביצועים משתנים בעדינות. שנית, הם משתמשים ב-CatBoost, שיטה אנסמבל חזקה המתאימה היטב לבעיות מסובכות ורב־ממדיות כמו זיהוי תמונה. HomOpt אינה נדרשת למודל חלופי יחיד; במקום זאת, היא מתייחסת לבחירת המודל החלופי כרכיב שניתן להחלפה כדי להתאים לקושי ולמבנה המשימה. המסגרת יכולה להתמודד עם הגדרות רציפות, בדירותיות וקטגוריאליות, ויכולה לשבת מעל אסטרטגיות חיפוש נפוצות כגון חיפוש אקראי, אופטימיזציה בייסיאנית או שיטות מבוססות עצים, ופועלת כשכבת שיפור במקום תחליף מוחלט.

בחינת השיטה במבחן

החוקרים מעריכים את HomOpt על סט מגוון של מבחנים. במשימות קלאסיות של למידת מכונה המחולצות ממערכי נתונים טבלאיים ציבוריים, הם מכווננים מודלים כמו מכונות וקטורים תומכות (SVM), יערות אקראיים, רגרסיה לוגיסטית, רב־שכבתיות ועצים ממוצי גרדיאנט. הם גם בוחנים בעיות קשות של הכרה פתוחה (open-set recognition), שבהן המערכת נאלצת להתמודד עם קטגוריות שלא נראו קודם, באמצעות מסווג מיוחד הנקרא Extreme Value Machine. לבסוף, הם בודקים את HomOpt על טבלאות חיפוש ארכיטקטורת נוירונים למשימות תמונה ידועות כמו CIFAR-10 ומאגרי דמויית ImageNet, שבהן מרחב העיצובים האפשריים גדול ומלוכד במיוחד. במספר רב של הגדרות אלה, HomOpt מאיצה את הירידה לכיוון פתרונות טובים או משפרת את הביצועים הסופיים בהשוואה לשיטות הבסיס, ולעיתים קרובות עושה זאת תוך שימוש בפחות הערכות מודל יקרות.

מה משמעות הדבר לפרקטיקה היומיומית של AI

לפרקטיקנים, המסר העיקרי הוא ש־HomOpt מציעה דרך מובנית להכשיר את כוונון ההיפרפרמטרים להיות חכם יותר במקום רק יסודי יותר. על ידי השבחה מתמשכת של תמונה מקורבת של נוף הביצועים ומעקב חלק אחרי שינוי מיקומה של הנקודה הטובה ביותר ככל שהתמונה משתפרת, השיטה מצמצמת חיפושים מבוזבזים ומנצלת טוב יותר כל הרצה של מודל. מכיוון שהיא עובדת עם טווח רחב של מדדי איבוד, סוגי מודלים ואסטרטגיות חיפוש, ניתן להתייחס ל‑HomOpt כתוסף כללי לכלי האופטימיזציה הקיימים. במילים פשוטות, היא מבטיחה להפיק מערכות AI מדויקות וחסינות יותר מאותו תקציב חישובי — ובצורה שמדרגת מקטנות בעיות טבלאיות ועד למשימות חזון גדולות ומורכבות.

ציטוט: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

מילות מפתח: אופטימיזציה של היפרפרמטרים, מודלים חלופיים, שיטות הומוטופי, למידה מכונה אוטומטית, חיפוש ארכיטקטורת רשתות עצביות