Clear Sky Science · he

AsynDBT: כוונון דו‑שכבתי מבוזר וא-סינכרוני ללמידה בהקשר יעילה עם מודלים לשוניים גדולים

מדוע פרומפטים חכמים חשובים ל‑AI יום‑יומי

מודלים לשוניים גדולים מפעילים כיום צ׳אטבוטים, מנועי חיפוש ועוזרי כתיבה שמשמשים רבים ביומיום. עם זאת, קבלת תשובות מועילות תלויה במידה רבה בניסוח השאלה ובדוגמאות שמציגים למודל. מאמר זה מציע דרך חדשה לשכלל אוטומטית את הפרומפטים והדוגמאות על פני מכשירים רבים, תוך שמירה על פרטיות הנתונים של כל משתמש. התוצאה היא מערכת AI שלומדת להגיב בדיוק וביעילות גבוהים יותר, במיוחד במשימות ייעודיות כמו תחזוקת רשתות תקשורת.

ללמד את ה‑AI בהצגה במקום באימון מחדש

במקום לאמן שוב ושוב מודלים ענקיים, מגמה מתרחבת היא ללמד אותם "ברגע" על‑ידי אספקת כמה דוגמאות נבחרות בפרומפט — תהליך הידוע כלמידה בהקשר. לדוגמה, כדי לסווג ביקורות סרטים כחיוביות או שליליות, אפשר להראות למודל סט קטן של דוגמאות מסומנות ואז לבקש שיסווג ביקורת חדשה. הבעיה היא שבחירת הדוגמאות וניסוח ההנחיות יכולים לשנות באופן דרמטי את ביצועי המודל. מציאת צירופי דוגמאות וניסוחים ידנית איטית ויקרה, ושיתוף נתונים גולמיים בין ארגונים לעיתים בלתי אפשרי בגלל כללי פרטיות.

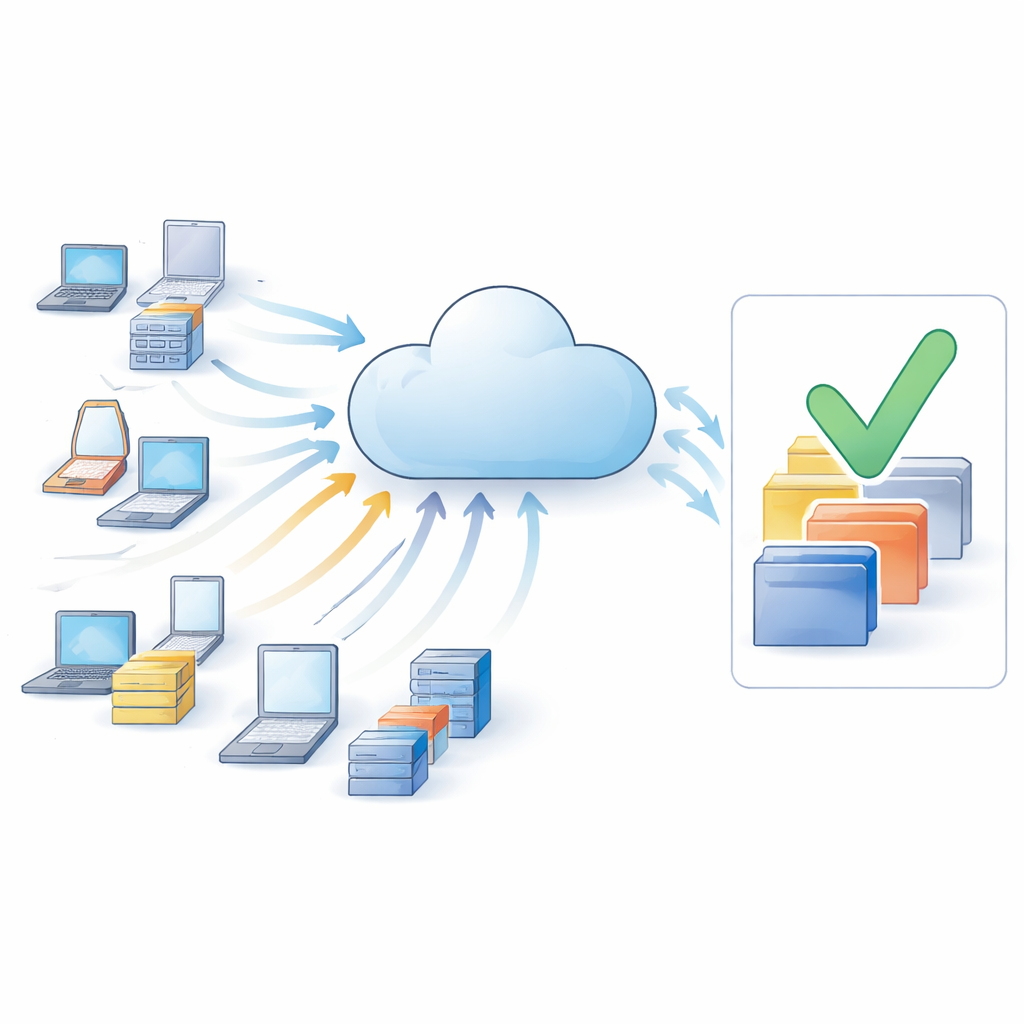

שיתוף פעולה ללא שיתוף נתונים פרטיים

כדי לעקוף מחסומי שיתוף נתונים, המחברים בונים על למידה פדרטיבית — תצורה שבה מכשירים או ארגונים רבים שומרים על הנתונים באופן מקומי אך משתפים פעולה דרך שרת מרכזי. כל עובד — למשל תחנת בסיס תקשורת או שרת חברה — מתקשר עם אותו מודל לשוני בענן, אך לעולם לא מעלה את הטקסט הגולמי שלו. במקום זאת, הוא מחזיר רק אותות משוב לגבי עד כמה פרומפטים ובחירות דוגמאות מסוימות עובדים. אלגוריתם חדש בשם AsynDBT (כוונון דו‑שכבתי מבוזר וא‑סינכרוני) מתאם את העובדים הללו כך שהם יחד ישפרו אסטרטגיית פרומפט משותפת, תוך כיבוד פרטיות והתמודדות עם קישורים איטיים או לא אמינים.

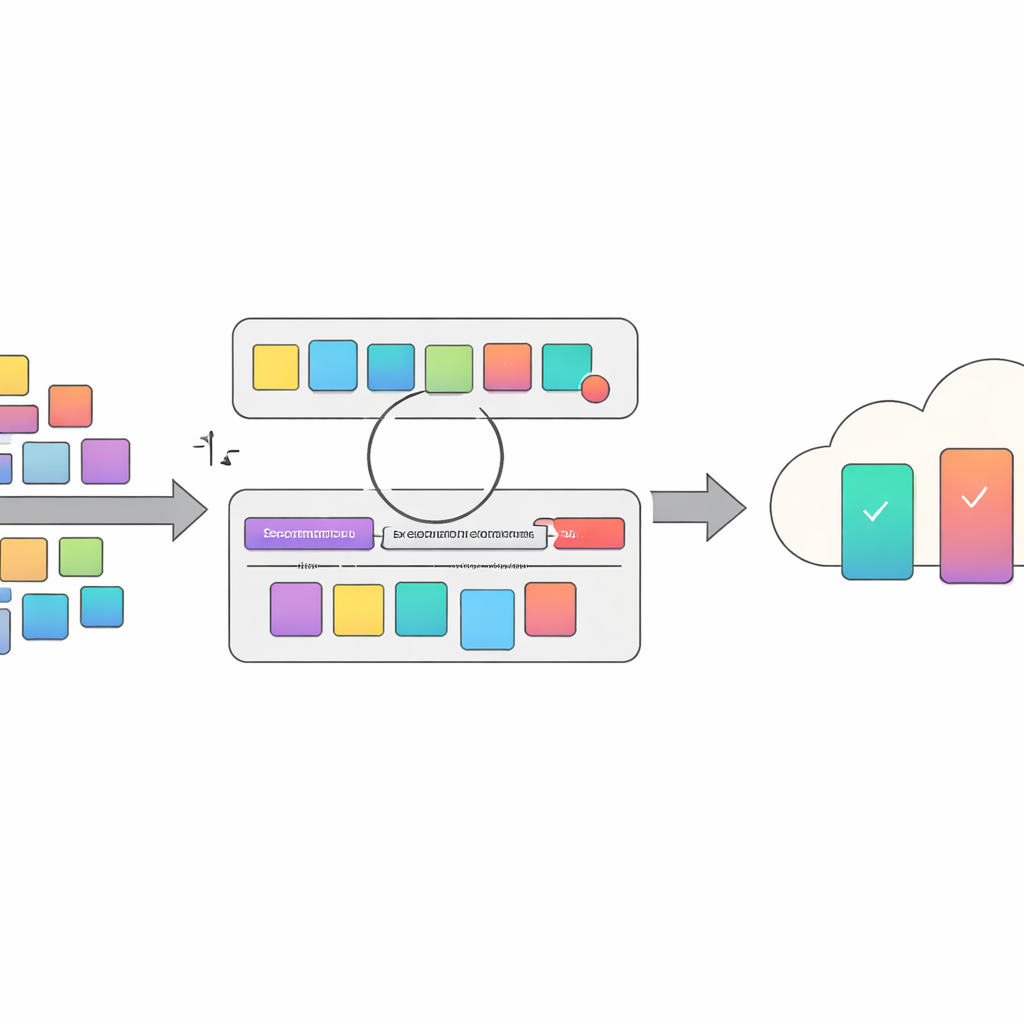

אופטימיזציה של השאלה והדוגמאות גם יחד

רעיון מרכזי במאמר הוא להתייחס לעיצוב הפרומפט כבעיה אופטימיזציה דו‑שכבתית. בשכבה התחתונה המערכת מלטשת קטעים קצרים שמתווספים להנחיית המשימה — שינויי ניסוח זעירים שיכולים לדחוף את המודל להסקת מסקנות טובה יותר. בשכבה העליונה היא מחליטה אילו דוגמאות מסומנות לכלול כהדגמות. שתי השכבות הללו אינן עצמאיות: סטים שונים של דוגמאות דורשים שינויים שונים בפרומפט, ולהפך. AsynDBT פורמליזציה את הקשר הזה מתמטית ומשתמש בשיטת קירוב יעילה כך שכל עובד יכול לעדכן בהדרגה את הבחירות המקומיות שלו בעוד שרת מרכזי שומר תמונה גלובלית עקבית של ההחלטות בשכבה התחתונה.

התמודדות עם מכשירים איטיים ומשתתפים זדוניים

ברשתות אמיתיות, חלק מהמכשירים מגיבים באיחור או נוחתים, וכך נוצרות "מכשילות" שיכולות להאט אימון מסונכרן רגיל. AsynDBT פועל במקומות זאת באופן א־סינכרוני: השרת מעדכן את המשתנים שלו בכל פעם שמSubset של עובדים מדווחים, מבלי לחכות לכולם. השיטה גם מגנה מפני עובדים שעשויים לשלוח עדכונים מטעהים, בכוונה או בטעות. על‑ידי שילוב טכניקות רגולריזציה עם כללי אגירה חסינים, האלגוריתם מצמצם את השפעת בחירות דוגמאות מורעלות או באיכות ירודה על האסטרטגיה הגלובלית, ועוזר למערכת להישאר יציבה ואמינה גם תחת מתקפה.

שיפורים מוכחים במשימות לשוניות ותקשורת

החוקרים בחנו את AsynDBT על שישה בעיות סיווג טקסט, כולל מערך נתונים תובעני של רשת 5G שבו המודל נדרש לשפוט האם מונחים טכניים ממוקדים קשורים, תוך שימוש רק בקטעי תקנים של תקשורת להקשר. בהשוואה למגוון שיטות פרומפטינג ובחירת דוגמאות קיימות, הגישה החדשה השיגה את הדיוק הטוב או השני‑בטוב ביותר כמעט בכל המשימות. במשימת 5G בפרט, היא שיפרה את הדיוק בכ‑כעשר נקודות אחוז על פני הקו הבסיס החזק ביותר. במקביל, העיצוב הא־סינכרוני קיצר את זמן האימון בכ‑40% בקירוב ביחס לשיטה מרכזית דומה שאיני מחלקת את העבודה.

מה זה אומר לכלי AI עתידיים

עבור לא מומחים, המסקנה היא שפרומפטים טובים יותר ובחירות דוגמאות חכמות יכולות לשפר בצורה בולטת את התנהגות מערכות ה‑AI — מבלי לשנות את המודל עצמו. AsynDBT מציע דרך אוטומטית ושומרת פרטיות לעשות זאת על פני מכשירים רבים שמשתפים פעולה, ומניב כלים לשוניים מדויקים ויעילים יותר עבור תחומים כמו תפעול תקשורת, תמיכת לקוחות ושדות ייעודיים נוספים. בהמשך, המחברים מתכננים לשלב את המסגרת שלהם עם אחזור ידע מבוסס גרפים כך שהפרומפטים יוכלו גם לשאוב מידע עובדתי מעודכן, להפחית עוד יותר הלצות ולהפוך את העוזרים ה‑AI לאמינים יותר בסביבות בעלות סיכון גבוה.

ציטוט: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

מילות מפתח: למידה בהקשר, אופטימיזציית פרומפט, למידה פדרטיבית, מודלים לשוניים גדולים, בינה מלאכותית שומרת פרטיות