Clear Sky Science · he

ביקורת פרטיות הדוקה יותר של ירידת מדרון אקראית פרטית בהנחת האיום של מצב מצפן מוחבא

מדוע זה חשוב לטכנולוגיה של היום-יום

אפליקציות מודרניות לומדות כל הזמן מהנתונים שלנו — מתמונות והודעות ועד רשומות רפואיות. שיטה מובילה לשמירה על אימון בטוח נקראת פרטיות דיפרנציאלית, שמוסיפה רעש מכוייל כך שלא ניתן לזהות בקלות נתון של אדם בודד. אבל איך נדע שההגנות הללו אכן עובדות בפועל, במיוחד עבור הרשתות העמוקות שמשמשות היום? מאמר זה חוקר את השאלה ומראה מתי הסתרת "סרט האימון" של המודל אכן מעשית לפרטיות — ומתי לא.

איך אמורה לעבוד למידה פרטית

ירידת מדרון אקראית פרטית (DP-SGD) היא האלגוריתם המרכזי עבור למידת מכונה שמכבדת פרטיות. הוא מאמן מודלים בשלבים על אצוות קטנות של נתונים, חותך (clipping) את הגרדיאנט בכל שלב ומוסיף רעש אקראי לפני עדכון המודל. התיאוריה נותנת גבולות עליונים לכמה נתון של כל אדם יכול להשפיע על המודל הסופי, המאוכזבים במספר פרטיות שלובו באלפא שנקרא אפסילון. במקביל, "בדיקת פרטיות" מנסה לתקוף את המודל המאומן ולמדוד כמה מידע ניתן לחלץ בפועל. אם התיאוריה והבדיקה מתאימות — אפשר לסמוך על חשבונות הפרטיות; אם לא — משהו מהותי נותר לא מובא בחשבון.

מה משתנה כאשר נשוחרר רק המודל הסופי

רוב הבדיקות הקודמות הניחו יריב חזק שיכול לראות כל נקודת ביקורת ביניים במהלך האימון. במציאות, ארגונים רבים מפרסמים רק את המודל הסופי, ולא היסטוריית האימון המלאה. הגדרה ריאליסטית זו נקראת מודל האיום של המצב המוחבא (hidden state). עבודות תיאורטיות אחרונות הציעו שלפחות עבור בעיות קמורות פשוטות, הסתרת המודלים הביניים עשויה להגביר פרטיות לאורך זמן: מידע שנעשה שימוש בו מוקדם באימון "נשטף" בעדכונים רעשיים מאוחרים יותר. עם זאת, למידה עמוקה מודרנית נשענת על מודלים לא-קמורים מאוד, שבהם משטח האובדן ריפתי ומסובך. לא היה ברור אם ההגברה הזו אכן מתקיימת שם — או שמא התקפות קיימות היו פשוט רפות מדי כדי לחשוף את אובדן הפרטיות המלא.

דרך חדשה ליריבים לדחוף את המודל

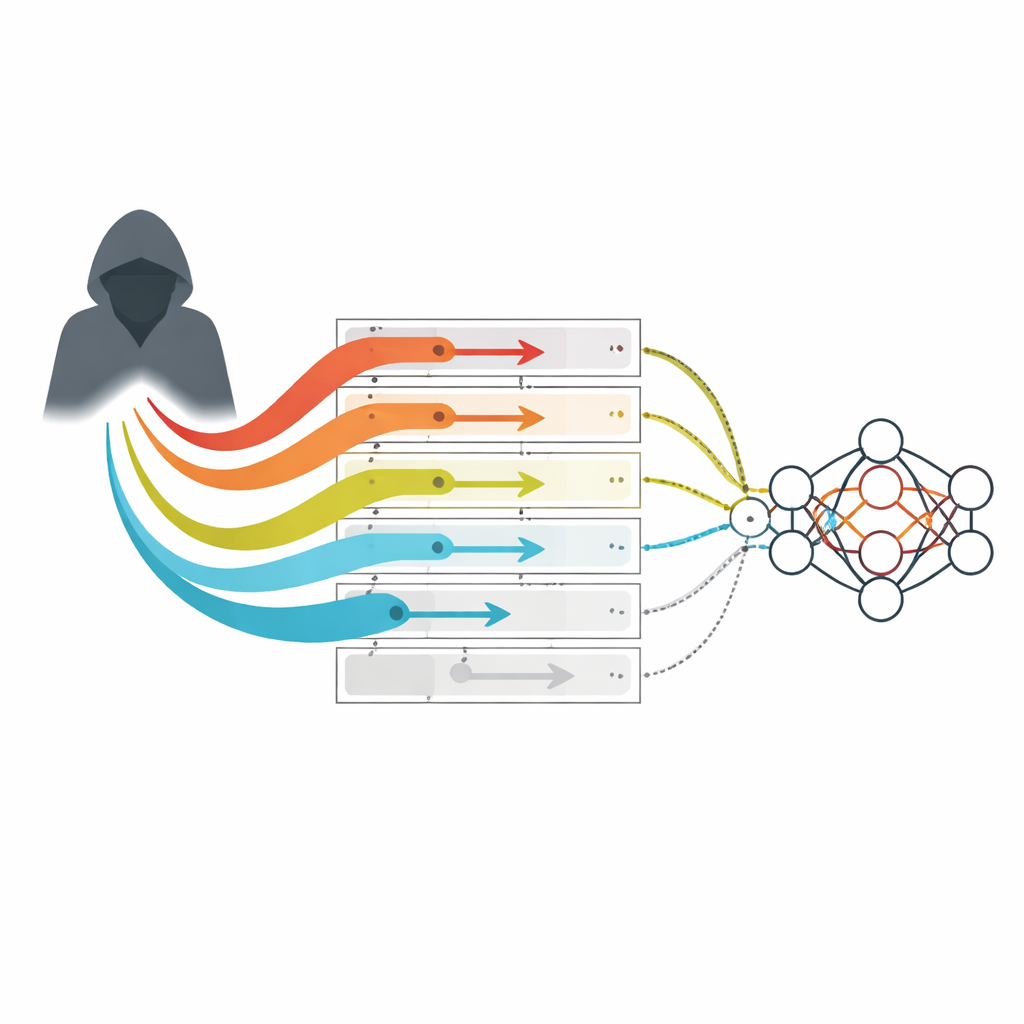

המחבר מציג משפחה חדשה של יריבים "מייצרי-גרדיאנט" (gradient-crafting) המותאמים למודל המצב המוחבא. במקום לנסות לתכנן דוגמת נתונים מיוחדת ואז לעקוב איך האובדן שלה משתנה במהלך האימון (כמו בהתקפות מבוססות-אובדן), יריבים אלה קובעים ישירות את רצף הגרדיאנטים שהיו מוחלים אם דוגמת נתונים גורלית הייתה קיימת. הם בוחרים גרדיאנטים שתמיד נגעו בסף החיתוך ומתיישרים עם כיווני פרמטרים שנמצאים בשימוש נדיר, מה שמקל על זיהוי השפעתם גם בלי צפייה במודלים ביניים. נחקרים שני וריאנטים פשוטים: אחד שבוחר כיוון פרמטר אקראי, ואחר המדמה את תהליך האימון כדי למצוא את הכיוון שפחות עודכן לפני הזרקת גרדיאנטים חזקים וחוזרים לאורך אותו כיוון.

מה הניסויים מגלים על הסיכון הפרטי במציאות

באמצעות מסגרת זו, המאמר בודק את DP-SGD על אוספי תמונות וטבלאים עם ארכיטקטורות שכיחות כמו רשתות קונבולוציה ושאריות (ResNet), וכן מודל פשוט מחובר במלואו. כאשר הגרדיאנט המיוצר משמש בכל שלב אימון, היריבים החדשים משיגים את גבולות הפרטיות התיאורטיים המחמירים — אף על פי שהם רואים רק את המודל הסופי. משמעות הדבר היא שבמקרה הקיצוני הזה, הסתרת נקודות הביקורת הביניים אינה מספקת שום פרטיות נוספת. כאשר הגרדיאנט המיוצר מוכנס בתדירות נמוכה יותר, התמונה משתנה: עבור אצוות גדולות יחסית לרמת הרעש, הבדיקות נשארות קרובות לתיאוריה (ולכן נראה מעט הגברה אמיתית), אך עבור אצוות קטנות ורעש גבוה נוצר פער שמצביע על הגברה קיימת, אם כי מתונה, בהגנה במצבים לא-קמורים.

מציצים לגבול המקרה הגרוע ביותר

כדי להבין את הגבולות המוחלטים של פרטיות במודל המצב המוחבא, המאמר גם בוחן יריב תיאורטי קיצוני יותר שלא רק מייצר גרדיאנטים אלא גם מתכנן משטח אובדן שלם כדי לשמור על השפעת דוגמת נתונים מיוחדת לאורך האיטרציות. בסביבה מבוקרת זו, התוצאות מפרידות בבירור שני משטרים: עם גדלי אצווה גדולים, חשבונאות הפרטיות המבוססת על התיאוריה הסטנדרטית היא למעשה הדוקה, אך עם אצוות קטנות ורעש משמעותי, המידע המוקדם על דוגמת נתונים נשכח חלקית לאורך הזמן. באופן מכריע, ההגברה הזו חלשה יותר מאשר הידוע עבור בעיות קמורות פשוטות ולעולם אינה מוחקת לחלוטין את סיכון הפרטיות.

מה משמעות הדבר למשתמשים ולמועסקים בתחום

לא-מומחים — המסקנה היא שהסתרת היסטוריית האימון של מודל למידה עמוקה אינה מבטיחה באופן קסום פרטיות חזקה הרבה יותר. כאשר נתוניו של אדם משולבים בהדרגה ונעשה בהם שימוש בתדירות גבוהה במהלך האימון, הסיכון שלו קרוב למה שתיאוריה שמרנית כיום כבר חוזה. הגנה נוספת מופיעה במסגרות נוחות יותר — אצוות קטנות עם רעש משמעותי — אך היא מתונה ואינה מורידה את הסיכון לאפס. ממצאים אלה מאמתים חלקים של חשבונות הפרטיות הקיימים ומדגישים את מגבלותיהם, ומספקים תמונה ברורה וריאליסטית של כמה הגנה DP-SGD יכול להציע כאשר משחררים רק את המודל הסופי.

ציטוט: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

מילות מפתח: פרטיות דיפרנציאלית, DP-SGD, בדיקת פרטיות, ביטחון בלמידת מכונה, מודל מצב מוחבא