Clear Sky Science · he

התקפה עוינת מבוססת החלטה יעילה בשאילתות עם תקציב שאילתות נמוך

מדוע תקלות זעירות בתמונות יכולות להוליך שולל מכונות חכמות

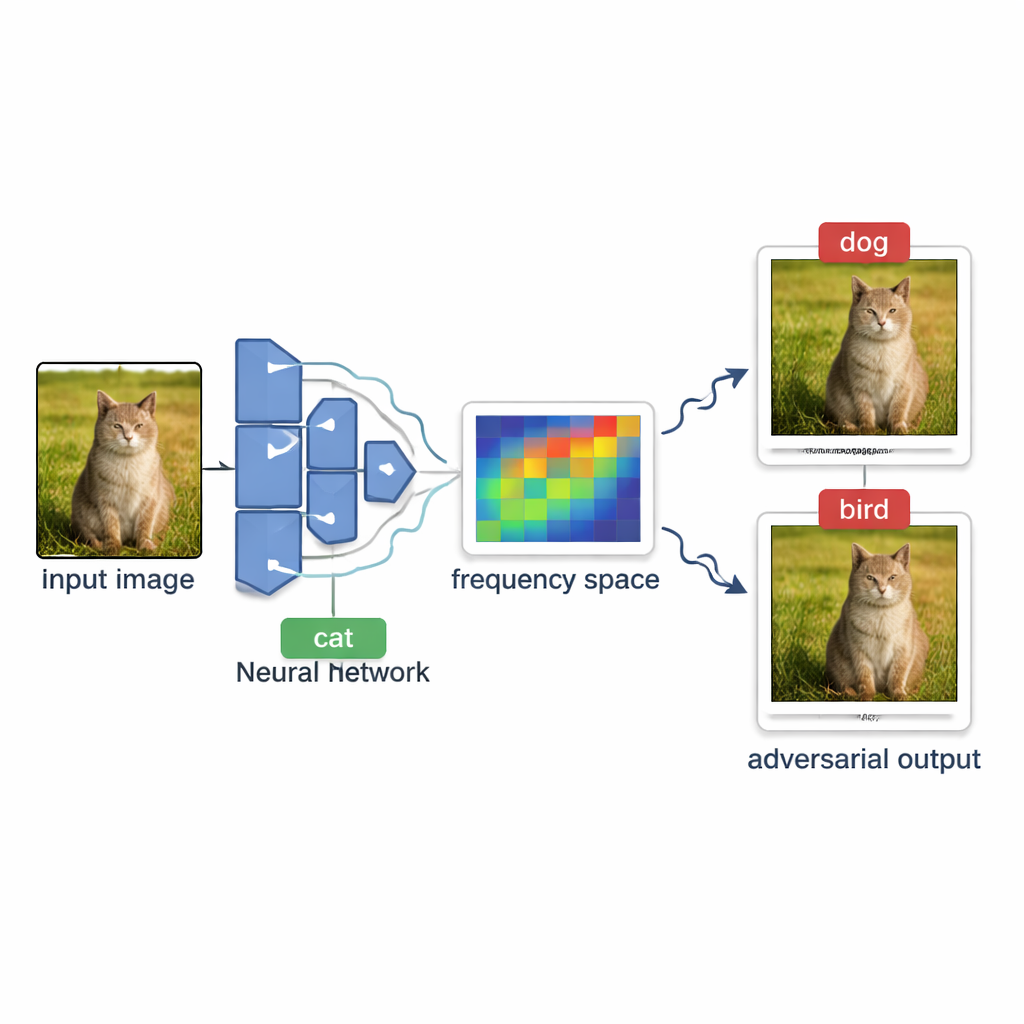

בינה מלאכותית מודרנית יכולה לזהות פנים, בעלי חיים וחפצים יומיומיים בדיוק מרשים. עם זאת, אותן מערכות ניתנות להנחיה באמצעות שינויים בתמונה כל כך זערוריים שאדם בקושי שמים לב אליהם. המאמר הזה חוקר דרך חדשה לייצר תמונות "מטעות" כאלה תוך שהוא שואל את המודל כמה שפחות שאלות, וחושף הן עד כמה הדגמים של היום פגיעים והן כיצד תוקפים עשויים לנצל זאת במציאות.

כיצד תוקפים בודקים מערכות בינה מבחוץ

בשירותים רבים במציאות — כמו תיוג תמונות מקוון או מסנני תוכן — המודל מתנהג כמו תיבת-שחורה. גורמים חיצוניים יכולים להעלות תמונה ולראות רק את התווית הסופית, כגון "כלב" או "שלט עצור", אך לא את ציוני הביטחון הפנימיים או את מבנה המודל. יצירת תמונה מטעה בתנאים אלה נקראת התקפת תיבת-שחורה מבוססת החלטה. האתגר הוא לדחוף בעדינות תמונה רגילה עד שהמודל יסווג אותה באופן שגוי, בלי יכולת לראות כמה היא "קרובה" לשינוי החלטתו ובלי לשלוח מספר גדול כל כך של תמונות נסיון שהמערכת תשים לב אליו או שהשאילתות יהפכו ליקרות מדי.

דרך חדשה לחיפוש עם מעט מאד שאילתות

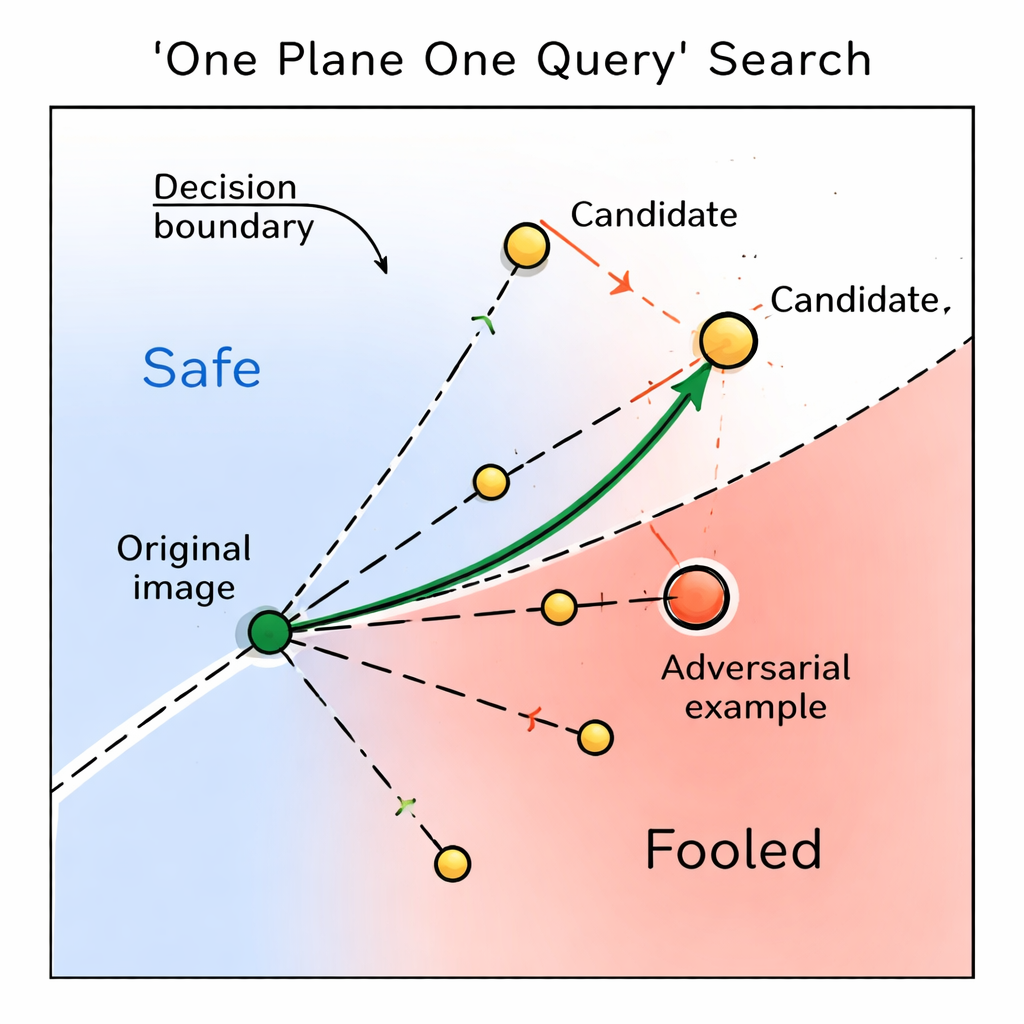

המחברים מציגים את OPOQA (One Plane One Query Attack), שיטה שנועדה לחסוך בשאילתות ועדיין ליצור תמונות עוינות באיכות גבוהה. במקום לחפור שוב ושוב לאורך כיוון משוער יחיד, OPOQA פועלת בסבבים. בכל סבב היא מתחילה מתמונה שכבר מטעה ועל ידי התמונה הנקייה המקורית, ואז מציעה מספר תמ候יות חדשות שנמצאות בכיוונים שנבחרו בקפידה. מהותי הוא שכל כיוון נבחן לכל היותר פעם אחת, מה שמשחרר את תקציב השאילתות המוגבל לחקור הרבה יותר אפשרויות במקום לחדד יתר על המידה השערה בודדת.

לרכוב על גלים חלקים בתמונה

כדי לבחור כיוונים מבטיחים, OPOQA נשענת על הרעיון שהשינויים היעילים ביותר וקשים להבחנה הם לעתים קרובות חלקים ורחבים יותר מאשר רעש פיקסלי חד. השיטה משתמשת בכלי מתמטי הנקרא המרת קוסינוס בדידה (DCT) כדי להעביר את התמונה ל"מישור תדרים", שבו וריאציות איטיות ועדינות מרוכזות באזור קומפקטי. היא מדגמת באקראי כמה מהרכיבים בתדר נמוך אלה, מחזירה אותם לשינויים רגילים בפיקסלים ומשתמשת בהם ככיוונים בסיסיים לחקירה. כל כיוון שנדגם מסייע להגדיר משטח שטוח דו-ממדי שמחבר את התמונה המקורית, התמונה העוינת הנוכחית והמועמדת החדשה. על כל אחד מהמישורים האלה OPOQA בוחרת נקודה בודדת לבדיקה, מאזנת בין שני מטרות: להתקרב יותר לתמונה המקורית ובכל זאת בדחיפה סבירה לגרום למודל לקבל החלטה שגויה.

בחירת המועמד הטוב והתאמה בזמן אמת

לאחר ש-OPOQA ייצרה קבוצת מועמדות קטנה של תמונות, היא מודדת עד כמה כל אחת מהן רחוקה מהתמונה המקורית וממיינת אותן מהפחות לשינוי עד לשינוי הרב ביותר. לאחר מכן היא שואלת את המודל לפי סדר זה. ברגע שהיא מוצאת מועמד שהמודל מסווג בצורה שגויה, היא עוצרת ומתייחסת לתמונה זו כנקודת ההתחלה החדשה לסבב הבא. אם אף אחד מהמועמדים לא מצליח להטעות את המודל, OPOQA שומרת על התמונה העוינת הטובה הקודמת אך מתאימה ידית פנימית השולטת כמה השורות הבאות יהיו שמרניות או אגרסיביות. אסטרטגיה "חמדנית" זו — לקבל תמיד את התמונה המסווגת שגויה הטובה ביותר הזמינה ולהתאים באופן דינמי את גודל הצעד — מאפשרת להתקפה למקד שיבושים עדינים ויעילים מבלי לבזבז שאילתות על כיוונים לא מבטיחים.

מה הניסוים חושפים על נקודות התורפה של ה-AI

החוקרים בדקו את OPOQA על 200 תמונות ממדד ImageNet רחב-היקף ושש רשתות נוירוניות נפוצות, כולל Inception-v3, ResNet, VGG, DenseNet וטרנספורמרים לראייה. תחת מגבלת מחמירה של 1,000 שאילתות למודל לכל תמונה, OPOQA התאמה או עלתה על מספר שיטות התקפה מובילות. לדוגמה, על Inception-v3 היא הטעתה בהצלחה את המודל ב-94 אחוז מהתמונות בעוד השינויים נשארו כה קלים שהם כמעט בלתי נראים לעין אנושית — שיפור של כמה נקודות אחוז על השיטה הטובה הקודמת. בין המודלים OPOQA נטתה להגיע לשיעורי הצלחה גבוהים מוקדם יותר — תוך שימוש בפחות שאילתות — אף שגישות מתחרות מסוימות השוו או עברו אותה כאשר ניתנו להן תקציבי שאילתות גדולים מאוד וזמן לכיוון עדין.

מה משמעות הדבר לבטיחות היומיומית של ה-AI

המחקר מראה שמערכות ראייה של היום ניתנות להטעה גם כאשר התוקפים רואים רק החלטות סופיות ויש להם אפשרויות מוגבלות לבדוק את המודל. באמצעות חקירה חכמה של שינויים עדינים בתדר נמוך וניוון זהיר של כל שאילתה, OPOQA יכולה ליצור תמונות שנראות אותו הדבר לאנשים אך מובילות את המכונות לטעויות חמורות. עבור קהל שאינו מומחה, המסקנה היא ש"הראייה" של ה-AI עדיין שבירה: ניתן להוציא אותה מסלולה בדרכים עדינות שקשה להבחין בהן. הכרה ולימוד התקפות יעילות כאלה הם צעד מרכזי בחיזוק מערכות בעולם האמיתי — כגון מצלמות אבטחה, כלים לניתוח תמונות רפואיות ורכבים אוטונומיים — מפני מניפולציה שעלולה להישאר בלתי מזוהה אחרת.

ציטוט: Tuo, Y., Yin, M. & Che, S. Query-efficient decision-based adversarial attack with low query budget. Sci Rep 16, 6886 (2026). https://doi.org/10.1038/s41598-026-38428-4

מילות מפתח: דוגמאות עוינות, התקפות תיבת-שחורה, אבטחת למידה עמוקה, סיווג תמונות, התקפה יעילה בשאילתות