Clear Sky Science · he

RiemannInfer: שיפור אינפרנס של טרנספורמרים באמצעות גאומטריה רימנית

מדוע זה חשוב למשתמשי AI יומיומיים

צ׳אטבוטים ועוזרי AI מודרניים יכולים לפתור בעיות מתמטיקה, לכתוב חיבורים ואף להסביר נושאים רפואיים, ובכל זאת אנחנו עדיין לא מבינים באמת איך הם מגיעים למסקנותיהם — או כיצד לגרום להם להסיק בצורה אמינה יותר. המאמר מציג את "RiemannInfer", דרך חדשה להציץ בתוך מודלים לשוניים גדולים (LLMs) על-ידי התייחסות לפעילות הפנימית שלהם כתנועה על פני משטח גאומטרי מעוקל. פרספקטיבה זו לא רק נותנת תמונה אינטואיטיבית יותר של אופן החשיבה של המערכות, אלא גם הופכת את הטיעון שלהן למהיר ומדויק יותר.

להפוך את חשיבת ה‑AI למסע גאומטרי

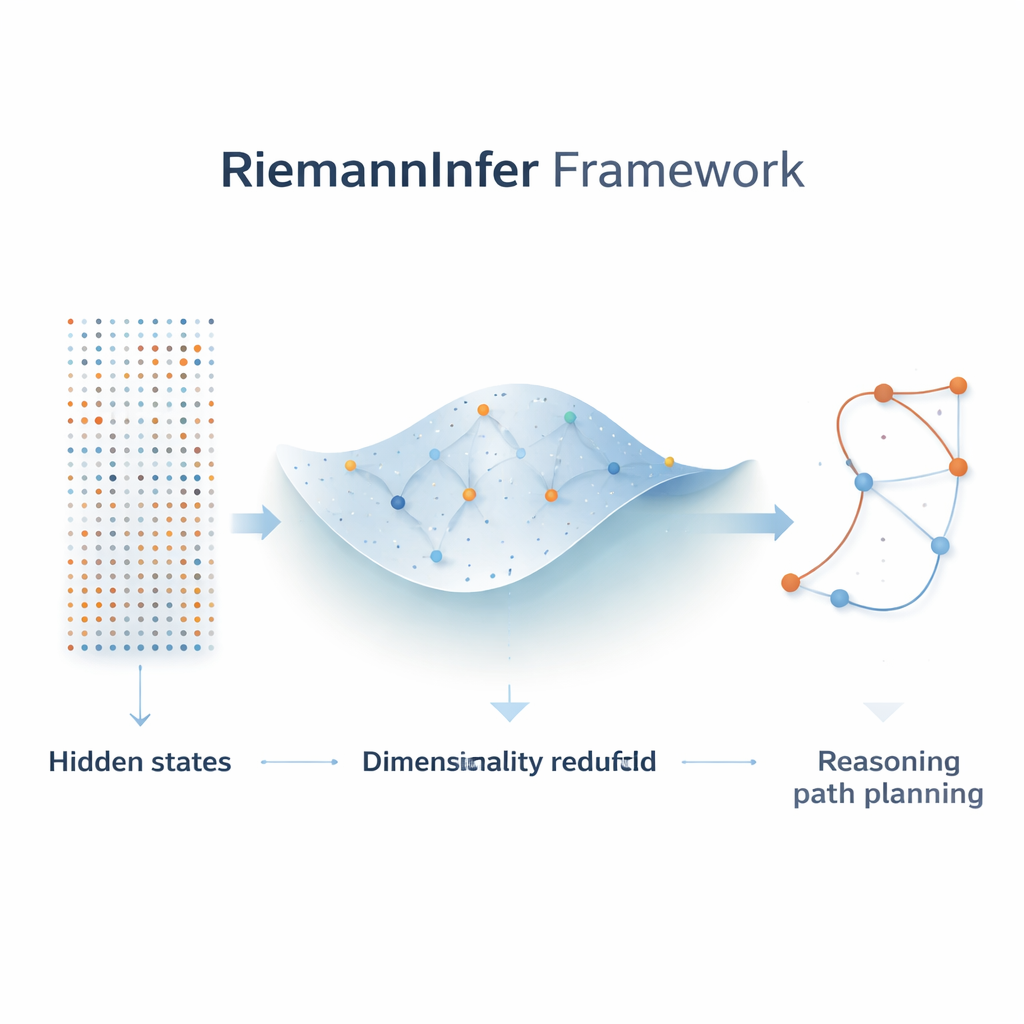

בתוך LLM כמו GPT‑4 או Llama כל מילה במשפט מייצגת כווקטור בממד גבוה, ושכבות של "תשומת לב" מחליטות עד כמה המילים משפיעות זו על זו. החוקרים מציינים שהמצבים הנסתרים האלה ניתנים לצפייה כנקודות בחלל עצום שהצורה הכוללת שלו מקודדת את הבנת השפה של המודל. במקום לתאר את הטיעון כסדרת חישובי הסתברות על טקסטים, הם מפרשים אותו כבעיית מציאת מסלול: המודל נע ממצב התחלתי (השאלה) אל מצב סופי (הउत्तर) לאורך נתיב בחלל הזה. באמצעות כלים מהגאומטריה הרימנית — המתמטיקה של משטחים מעוקלים — הם בונים מניפה מעוקלת שתופסת כיצד תבניות התשומת לב מכופפות ומתארכות את הנוף הפנימי הזה.

להצמצם את המורכבות בלי לאבד את התמונה הגדולה

מכיוון שהחלל הפנימי הגולמי של LLM ענקי, הצעד הראשון ב‑RiemannInfer הוא לכווץ אותו תוך שמירה על המבנה החיוני שלו. המחברים משלבים טכניקות מתורת הטופולוגיה, העוסקת בקישוריות נקודות, עם אלגוריתם הפחתת ממדים פופולרי בשם UMAP. לפני הקטנת מימדים הם מנתחים את "הצורה" של ענן המצבים הנסתרים כדי לוודא שתבניות הקישוריות המרכזיות שורדות את הלחיצה. התוצאה היא מרחב ממדי נמוך שבו מערכות יחסים חשובות בין טוקנים — למשל אילו מילים מעניקות תשומת לב חזקה זו לזו — נשמרות ברובן. המפה הגאומטרית הקומפקטית הזו מאפשרת לבצע חישובים מדויקים על מרחקים, מסלולים קצרים ועקמומיות.

לבנות מפה מעוקלת מתוך תשומת לב

החידוש המרכזי הוא לתרגם משקלי תשומת לב למדד גאומטרי של מרחק. כאשר המודל ממקד תשומת לב חזקה בין שני טוקנים, RiemannInfer מתייחס אליהם כקרובים זה לזה על המניפה; תשומת לב חלשה ממקמת אותם רחוק יותר. מתוך יחסיות אלה מגדירים המחברים מטריקה — כלל מתמטי שקובע אורכים וזוויות — ומשתמשים בה לחישוב גאודזיות, המקבילות המעוקלות לקווים ישרים, וכן עקמומיות, המודדת עד כמה החלל מתעקם בחדות. תשומת לב רב‑ראשית משתלבת באופן טבעי כשילוב של מספר מטריקות, כל אחת תופסת היבט שונה של מבנה לשוני, כמו דקדוק או משמעות. באמצעות בנייה זו אפשר לפרש החלטות המודל כבחירת מסלולים מסוימים בנוף שבו פסגות ושקעים משקפים אזורים שבהם המידע צפוף או דליל.

לתכנן מסלולי טיעון בעלי מאמץ נמוך

לאחר בניית המניפה, המחברים ממסגרים מחדש את הטיעון כמציאת נתיב "קל" מהשאלה לתשובה — כזה שממזער את העבודה הכוללת שנעשית לאורך הדרך. הם שואבים אנלוגיה מטיפוס הרים: לטפס בדרך תלולה ומשוננת דורש יותר אנרגיה מאשר ללכת לאורך רכס חלק אל אותו פסגה. בהקשר ה‑LLM, העקמומיות ממלאת את תפקיד התלול, ועבודת הטיעון של המודל מתאימה לכמה אי־ודאות פנימית מצטמצמת לאורך נתיב. באמצעות נוסחאות מקורבות לגאודזיות ולעקמומיות, בשילוב אלגוריתם חיפוש גרפי יעיל (אלגוריתם דייקסטרה), RiemannInfer מזהה במהירות נתיבים שממזערים עבודה זו ומנחים את המודל לשרשרות חשיבה יעילות יותר.

מה הניסויים מראים על מודלים אמיתיים

המחברים בודקים את RiemannInfer על מספר LLMs מתקדמים, כולל GPT‑4o, Llama‑3‑405B ו‑DeepSeek‑V2‑400B, על פני מבחני מתמטיקה וטיעון תובעניים כמו GSM8K, MATH500, StrategyQA ו‑AGIEval. בכל המקרים, עטיפת המודלים במסגרת RiemannInfer מגבירה את הדיוק בכמה נקודות אחוז — מספרים קטנים אך משמעותיים בקדמת הביצועים — תוך שמירה על מהירות זהה או שיפור קל. השוואה לשיטה פשוטה וליניארית בלבד מראה כי התעלמות מהגאומטריה המעוקלת של המצבים הנסתרים פוגעת ביכולות באופן דרמטי, ומדגישה את חשיבות נקודת המניפה.

התמונה הרחבה: לתת לטיעון של ה‑AI תחושה פיזית

לקורא לא מקצועי, המסקנה המרכזית היא שהמחברים הפכו את תהליכי הליבה העמומים של מודלים לשוניים גדולים למשהו מוחשי יותר: מסע על פני נוף מעוקל שבו חשיבה טובה תואמת הליכה על שבילים חלקים וברי־מאמץ. על‑ידי עיגון תבניות תשומת הלב ושלבי הטיעון במושגים גאומטריים ופיזיקליים — מרחק, עקמומיות ועבודה — RiemannInfer מציע גם דרך מעשית לשפר תוצאות וגם גשר רעיוני בין AI לפיזיקה של מרחבים רציפים. אף שהשיטות הנוכחיות הן מקורבות ועדיין נדרשים שיפורים רבים, המסגרת הזו מצביעה על עתיד שבו תהליכי המחשבה של מערכות AI ניתנים לניתוח, לאופטימיזציה ואולי אפילו לתכנון באמצעות שפת הגיאומטריה והפיזיקה.

ציטוט: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

מילות מפתח: מודלים לשוניים גדולים, למידה עמוקה גאומטרית, מניפה רימנית, מנגנוני תשומת לב, יעילות הטיעון