Clear Sky Science · he

הסטת פרשנות ב-AI מנסבר תחת רעש בתוויות

למה ההסברים של ה-AI יכולים להשתבש בשקט

רבים מסתמכים היום על בינה מלאכותית לא רק לקבלת תשובות, אלא גם על הסברים: מדוע סירבו הלוואה? מדוע מערכת סימנה מטופל כבעל סיכון גבוה? המחקר הזה מראה שאפילו כאשר דיוק המודל נראה יציב ומספק, הסיפור שהוא מספר על מדוע קיבל החלטה יכול להשתנות באופן דרמטי אם בנתוני האימון יש טעויות. השינוי החבוי הזה בהסברים — מה שהמחברים קוראים לו "הסטת פרשנות" — עלול להטעות אנשי מקצוע שתלויים ב-AI להצדיק החלטות חשובות.

כשנתונים נקיים נתקלים בתוויות מבולגנות

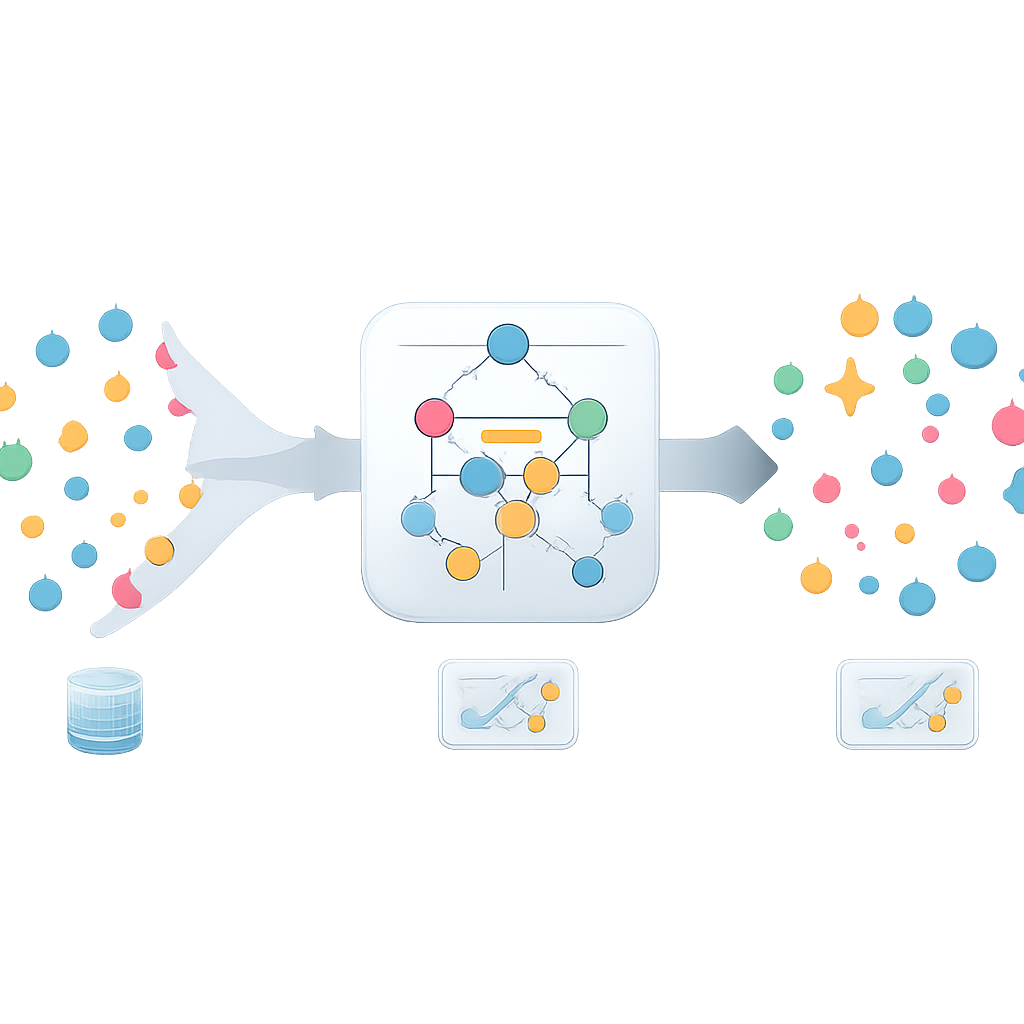

רוב מערכות ה-AI המודרניות הן "קופסאות שחורות", נותנות תחזיות בלי הסברים ברורים. כדי להפוך את ה-AI לשקוף יותר, יישומים רבים פונים למודלים מבוססי-כללים שמזכירים חשיבה אנושית של אם–אז: למשל, "אם לחץ הדם גבוה וגיל מעל 60 — אז הסיכון גבוה." קבוצות כללים אלו מושכות במיוחד בתחומים רגישים כמו בריאות, משפט וכספים, שבהם משתמשים צריכים לבדוק ולהאמין בלוגיקה. אבל נתוני אמת נדירים מושלמים. בעיה נפוצה היא רעש בתוויות — מקרים שבהם ה"תשובה הנכונה" בנתוני האימון שגויה, כמו אבחנה שרשומה בטעות או תוצאה של לקוח שסומנה שלא נכונה. בעוד שרעש בתוויות ידוע כפוגע באיכות התחזיות, השפעתו על יציבות ההסברים של ה-AI לא נחקרה שיטתית עד כה.

בדיקה של חוסן ההסברים תחת רעש

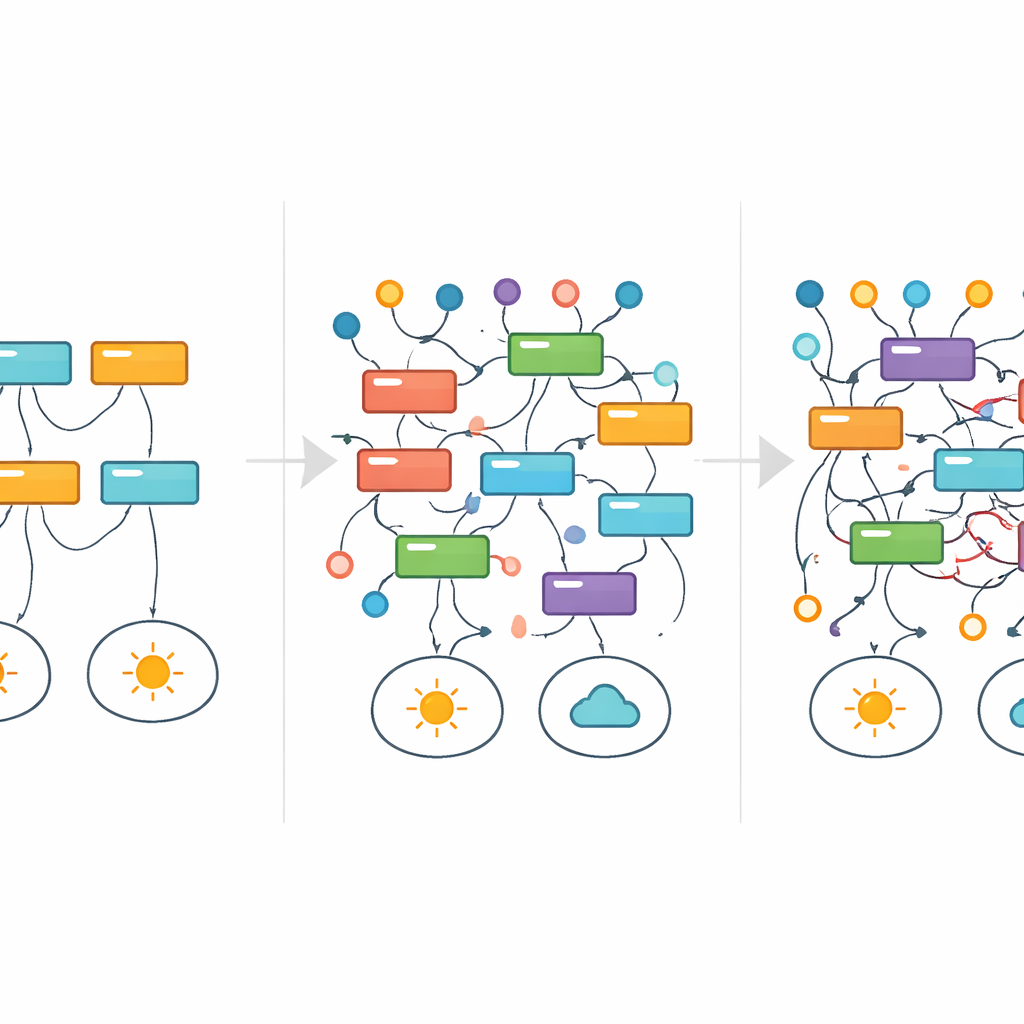

המחברים בחנו עד כמה הסברים מבוססי-כללים נשארים חזקים כאשר התוויות מושחתות בהדרגה. הם השתמשו בארבעה מאגרי נתונים שונים מתחום הבריאות, הבנקאות, מחלות כבד ואפילו תורת המספרים, כולם כמשימות חיזוי כן–לא. הושוו שלוש שיטות ללימוד כללים: שני אלגוריתמים פופולריים ומהירים (IREP ו-RIPPER) ושיטה חישובית יותר שנקראת Human Knowledge Models (HKM), שמטרתה במפורש להפיק קבוצות כללים פשוטות ודמויות-אנוש. לכל שיטה האמנים חזרו ואימנו מודלים תוך החלפת באופן אקראי חלק גדל של תוויות האימון — מתוויות כמעט נקיות ועד לכמעט שטויות מוחלטות. הם עקבו במקביל אחרי שני דברים: עד כמה המודלים עדיין חוזים על סט מבחן נקי, ועד כמה הכללים שנלמדו השתנו בהשוואה לאלה שנלמדו בנתונים ללא רעש.

דיוק יציב, לוגיקה בתזוזה

בחזית, התוצאות עלולות להרגיע משתמשים בצורה מוטעית. ברמות רעש מתונות, במיוחד עם שיטת HKM, ביצועי החיזוי נראו יחסית יציבים לפי מדד F1 המקובל. אבל הסתכלות קרובה יותר על קבוצות הכללים סיפרה סיפור אחר. בעזרת מדד דמיון שמשווה אוספי כללים, המחברים גילו שאפילו כמות מתונה של רעש בתוויות שוחקת במהירות את החפיפה בין ההסברים המקוריים לאלה עם רעש. במילים אחרות, המודל עשוי עדיין להיות צודק לגבי מקרים רבים, אבל מסיבות שמתרחקות יותר ויותר. קבוצות כללים מורכבות היו פגיעות במיוחד: ככל שמספר התנאים בכל כלל גדל, שינויים קטנים בנתונים שברו או החליפו את הכללים ביתר קלות, והאיצו את איבוד היציבות של הפרשנות.

לעקוב אחרי כללים שמופיעים ונעלמים

כדי להמחיש כיצד הסברים בודדים שורדים או נכשלים כשהרעש עולה, החוקרים שאבו כלי מהרפואה: ניתוח הישרדות. במקום לעקוב אחרי הישרדות מטופלים לאורך זמן, הם עקבו כמה זמן כלל מסוים המשיך להופיע בין המודלים הטובים ביותר ככל שרעש התוויות עלה. במקום לדעוך לאט, הרבה כללים הבהבו פנימה והחוצה — סימן לכך שהסברים שונים לחלוטין יכולים להשתלט ברמות רעש שונות, אפילו לאותה משימה בסיסית. במאגר נתונים פשוט על חילוקיות מספרים, למשל, כללים נקיים ומתמטית נכונים הוחלפו בהדרגה בקירובים רחבים ובסופו של דבר בדפוסים מסובכים לכאורה ואף אקראיים שעדיין התאימו לתוויות המושחתות. לאורך מרבית תהליך זה, מדדי ביצועים ראשיים לא איתרו בבירור שמשהו לא כשורה.

מה זה אומר לאנשים התלויים ב-AI

המסר המרכזי הוא ש"AI אמין" אינו ניתן להערכה לפי דיוק בלבד. אפילו מודלים המציגים את הלוגיקה שלהם בכללים קריאים לבני-אדם יכולים להשתנות בשקט את ההיגיון שלהם כאשר התוויות מהן הם לומדים אינן מושלמות — וזהו המצב ברוב מסדי הנתונים בעולם האמיתי. המחברים טוענים שמפתחים והרשויות צריכות להתייחס ליציבות ההסברים כדרישה ברמה ראשונה, לצד דיוק והגינות. מדדים חדשים שמודדים ישירות כמה עיקביות נשארת בהסברים של מודל תחת רעש, וכלים שמתריעים בפני משתמשים על הסטת פרשנות, יהיו חיוניים אם אנו רוצים שמערכות AI שסיפורי העולם שהן מספרות יהיו אמינים כמו תחזיותיהן.

ציטוט: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

מילות מפתח: AI מובן, רעש בתוויות, פרשנות המודל, מודלים מבוססי-כללים, הסטת פרשנות