Clear Sky Science · he

ממכנע משופר של התפלגות נורמלית מוכללת עם שיטת תיקון בהתפלגות גאוסית ולמידת הפוכה קושית לבחירת תכונות

למה בחירת הנתונים הנכונים חשובה

החיים המודרניים פועלים על-ידי נתונים, מפרסומי סריקות רפואיות ורשומות בנקאיות ועד פידים של מדיה חברתית. אך יותר נתונים אינם תמיד טובים יותר. כאשר מבקשים ממחשבים ללמוד ממאות או אלפי מדידות גלומות בבת אחת, הם עלולים להפוך לאיטיים יותר, יקרים יותר לתפעול, ולהיות באופן מפתיע פחות מדויקים. מאמר זה מציג דרך חכמה יותר לנפות את כל אותן מדידות ולשמור רק את אלה שבאמת חשובות, באמצעות אלגוריתם חדש בשם Binary Adaptive Generalized Normal Distribution Optimizer, או BAGNDO.

הבעיה של יותר מדי רמזים

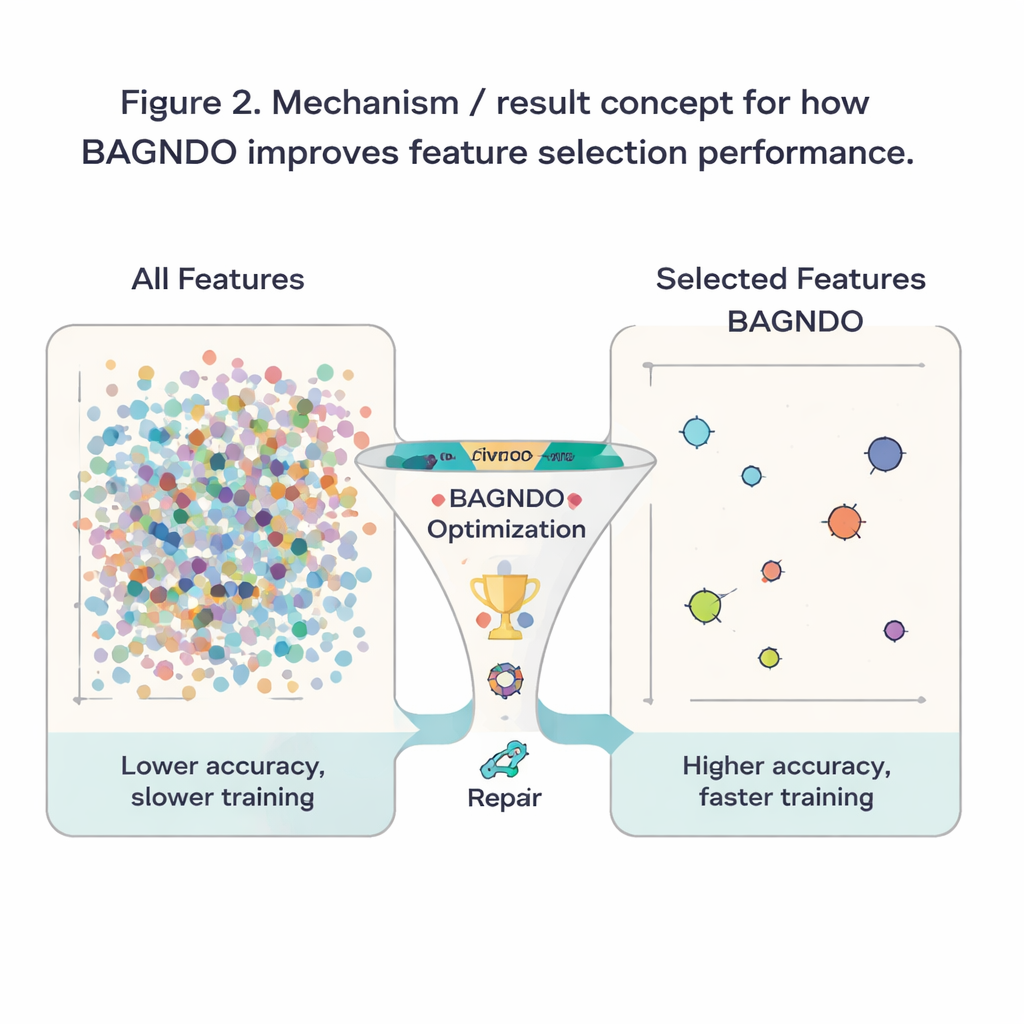

דמיינו אבחון מחלה עם מאות בדיקות מעבדה, סריקות ותשובות בסקרים. רבות מה"תכונות" הללו עלולות להיות רועשות, חוזרות, או פשוט לא רלוונטיות, והזנתן כולן לממיין עלולה לבלבל במקום לעזור. בחירת תכונות שואפת לבחור תת-קבוצה קטנה ואינפורמטיבית יותר של קלטים כך שמודלי למידת המכונה יהיו מהירים יותר, זולים יותר ואמינים יותר. מסננים סטטיסטיים פשוטים יכולים להסיר תכונות שבירות באופן ברור, אך הם לא מתאימים את בחירתם למודל הספציפי ולעתים מפספסים שילובים עדינים של משתנים. שיטות מתקדמות יותר מסוג "עטיפה" מעריכות מערכי תכונות על-ידי בדיקה ישירה של ביצועי הממיין, אך זה יוצר בעיית חיפוש ענקית: מספר תת-הקבוצות האפשריות מתפוצץ ככל שמספר התכונות גדל.

לחפש בחוכמה במקום בעיוורון

כדי להתמודד עם ההתפוצצות הזו, חוקרים נשענים על אלגוריתמים מטא-היוריסטיים — אסטרטגיות חיפוש בהשראת תהליכים טבעיים או פיזיקליים שמאזנות בין חיפוש רחב לבין התאמה מדוקדקת. אחת מהשיטות הללו, Generalized Normal Distribution Optimizer (GNDO), מתייחסת לפתרונות מועמדים כאילו נמשכים מעקומת פעמון גמישה ומטה בהדרגה כלפי תשובות טובות יותר. GNDO עבד היטב ביישומי הנדסה ואנרגיה, אך הוא נוטה להיתקע מוקדם על פתרונות בינוניים ולתקשה לאזן בין נדידה גלובלית לבין כוונון מקומי בזמן יישום לבחירת תכונות. המחברים מזהים זאת כחסר קריטי: המתמטיקה האלגנטית של GNDO לא מתרגמת אוטומטית לביצועים חזקים בהכרעות גבוהות-ממדיות של כן/לא לגבי אילו תכונות לשמור.

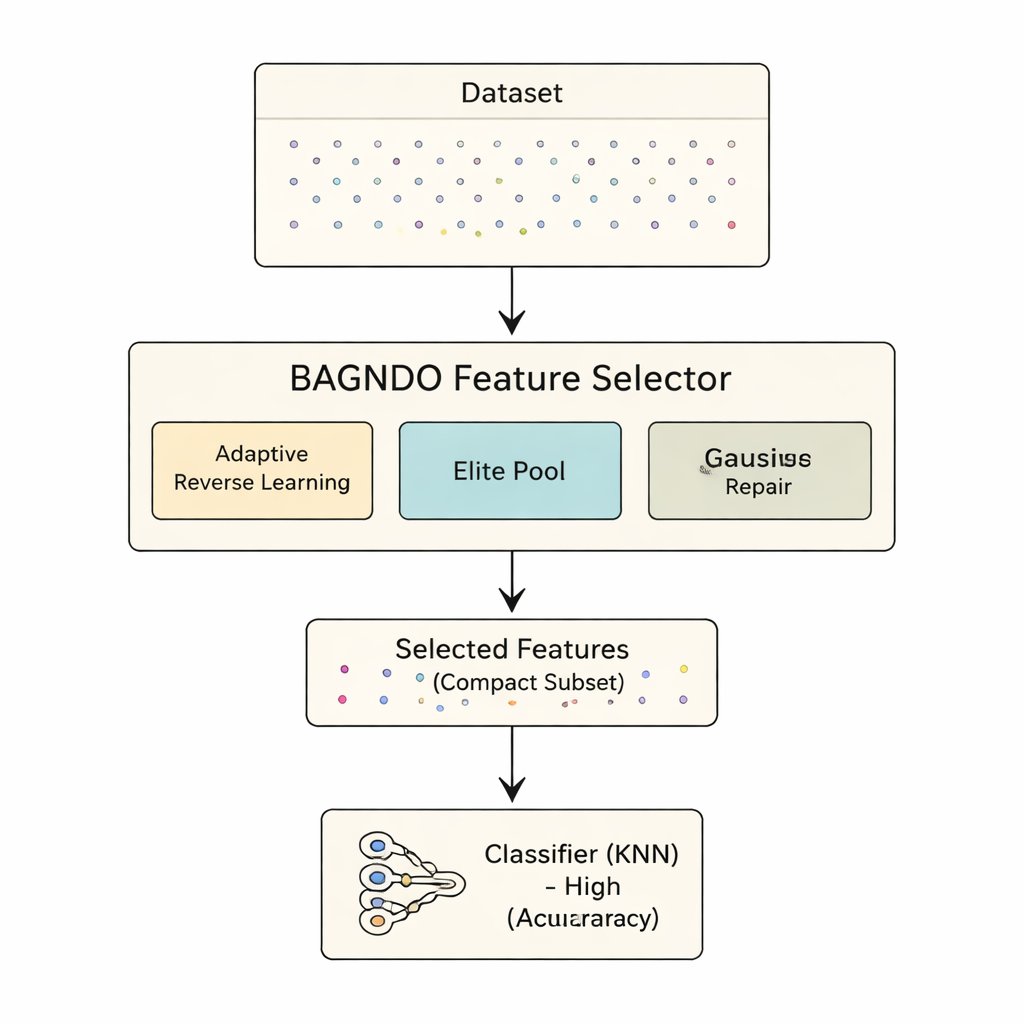

שדרוג בשלושה חלקים למנוע קלאסי

מסגרת BAGNDO המוצעת משדרגת את GNDO באמצעות שלוש רעיונות מתואמים. ראשית, אסטרטגיית למידה הפוכה קושית אדפטיבית מייצרת באופן קבוע גרסאות "מראה" של פתרונות נוכחיים באמצעות התפלגות הסתברות כבדה-זנב. זה מעודד קפיצות נועזות לאזורים בלתי-מחוברים בחלל החיפוש ומונע מהאלגוריתם להיתקע בביצועים מקומיים. שנית, אסטרטגיית בריכת אליטה שומרת לא רק על פתרון יחיד הטוב ביותר, אלא על קבוצה קטנה של מבצעים מובילים בתוספת מועמד "מנחה" מעורב. קבוצת הנהגה עשירה זו מסייעת לשמר גיוון תוך הובלת החיפוש לאזורים מבטיחים. שלישית, שיטת תיקון לפתרונות הגרועים המבוססת על התפלגות גאוסית בוחנת את המועמדים החלשים ומדרבנת אותם לעבר דפוסים שנלמדו מקבוצת האליטה, ובכך ממחזרת פתרונות רעים לטובים יותר במקום להשליכם לחלוטין.

בדיקת השיטה בשטח

כדי לבדוק האם הרעיונות הללו עוזרים בפועל, המחברים השתמשו ב-BAGNDO על 18 מערכי נתונים מוכרים מאגר UCI, שכוללים אבחון רפואי, משחקים, אותות ועוד. בכל מקרה חיפש האלגוריתם תת-קבוצה של תכונות שאפשרה לממיין k-nearest neighbors סטנדרטי לבצע תחזיות מדויקות. BAGNDO הושווה נגד תשעה מתחרים חזקים, כולל אופטימיזציית זרם חלקיקים, שיטות בסגנון גנטי וכמה אלגוריתמים מודרניים בהשראת פלגים. בכל המבחנים הללו, BAGNDO מצא בעקביות קבוצות תכונות קטנות יותר תוך שמירה ולעתים שיפור של דיוק התחזיות. הוא השיג את הדיוק הטוב ביותר עם תת-קבוצות התכונות הקומפקטיות ביותר ב-14 מתוך 18 מערכי הנתונים, ומבחנים סטטיסטיים אישרו כי השיפורים הללו אינם תוצאה של מקריות.

מה זה אומר עבור למידת מכונה יומיומית

למי שאינו מומחה, התוצאה ניתנת לסיכום בפשטות: המחברים בנו "בוחר תכונות" ממושמע יותר שעוזר לאלגוריתמי למידה להתמקד במה שבאמת חשוב במערך הנתונים. באמצעות איזון טוב יותר בין חיפוש רחב, הדרכת אליטה ותיקון מועמדים חלשים, BAGNDO מוריד קלטים מיותרים תוך שמירה או שיפור הדיוק. המשמעות היא מודלים מהירים יותר, חיסכון באחסון וחישוב, ולעתים תובנות ברורות יותר אילו מדידות או שאלות הן המפורות ביותר. למרות שהשיטה דורשת משאבי חישוב יותר מאשר כמה חלופות פשוטות, היא מציעה כלי חזק לבעיות שבהן דיוק ונראות הם בראש סדר העדיפויות — מתמיכה בהחלטות רפואיות ועד ניטור תעשייתי ועוד.

ציטוט: Ghetas, M., Elaziz, M.A. & Issa, M. Enhanced generalized normal distribution optimizer with Gaussian distribution repair method and cauchy reverse learning for features selection. Sci Rep 16, 4794 (2026). https://doi.org/10.1038/s41598-026-35804-y

מילות מפתח: בחירת תכונות, אופטימיזציה מטא-היוריסטית, למידת מכונה, הפחתת ממדים, דיוק סיווג