Clear Sky Science · he

שילוב פירוק פרמטרים וערבוב קבוצות כהגנה מפני שרת לא אמין בלמידה ממוחשבת פדרטיבית

מדוע הגנה על מודלים משותפים חשובה

הטלפונים, בתי החולים והבנקים שלנו מופעלים יותר ויותר על ידי בינה מלאכותית. לעתים קרובות ארגונים רבים מעוניינים לאמן מודל משותף יחד, אך חוקים והגיון פשוט אוסרים עליהם לאחד את הנתונים הגולמיים שלהם במקום אחד. למידה פדרטיבית הומצאה כדי לפתור את המתיחות הזו: כל משתתף מאמן על המכשיר שלו ומשתף רק עדכוני מודל. אך המאמר הזה מראה שגם עדכונים אלה עלולים לדלוף מידע פרטי אם השרת המרכזי סקרן או לא ישר — ואחר כך מציג שיטה חדשה לשמירה טובה יותר על הנתונים והזהויות שלנו.

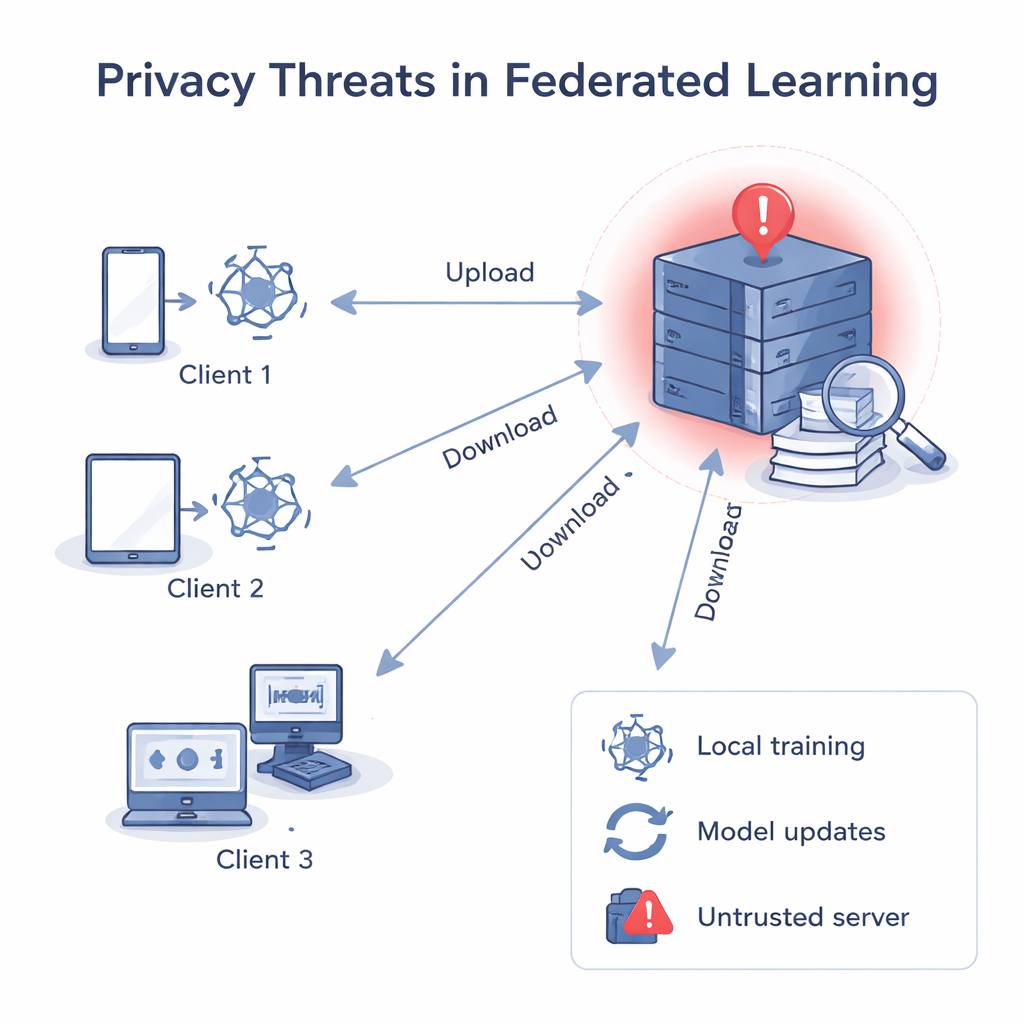

מתי לא צריך לסמוך על השרת

בלמידה פדרטיבית קלאסית, שרת מרכזי שולח מודל משותף, כל לקוח משפר אותו באמצעות הנתונים שלו ושולח חזרה את העדכון. השרת ממוצע את העדכונים האלו למודל גלובלי טוב יותר. אף על פי שנתונים גולמיים אינם עוזבים את המכשירים, מחקרים קודמים הראו שניתן "להריץ לאחור" גרדיאנטים ומשקלים — המספרים שבתוך המודל — כדי לשחזר נתונים פרטיים, כמו תמונות או טקסט, או לנחש האם רשומה מסוימת שימשה לאימון. אם השרת המרכזי אינו מהימן, הוא יכול לנתח כל עדכון לקוח בנפרד, ללמוד על הנתונים המקומיים של אותו לקוח, ואפילו לקשר עדכון לאדם או לארגון מסוים.

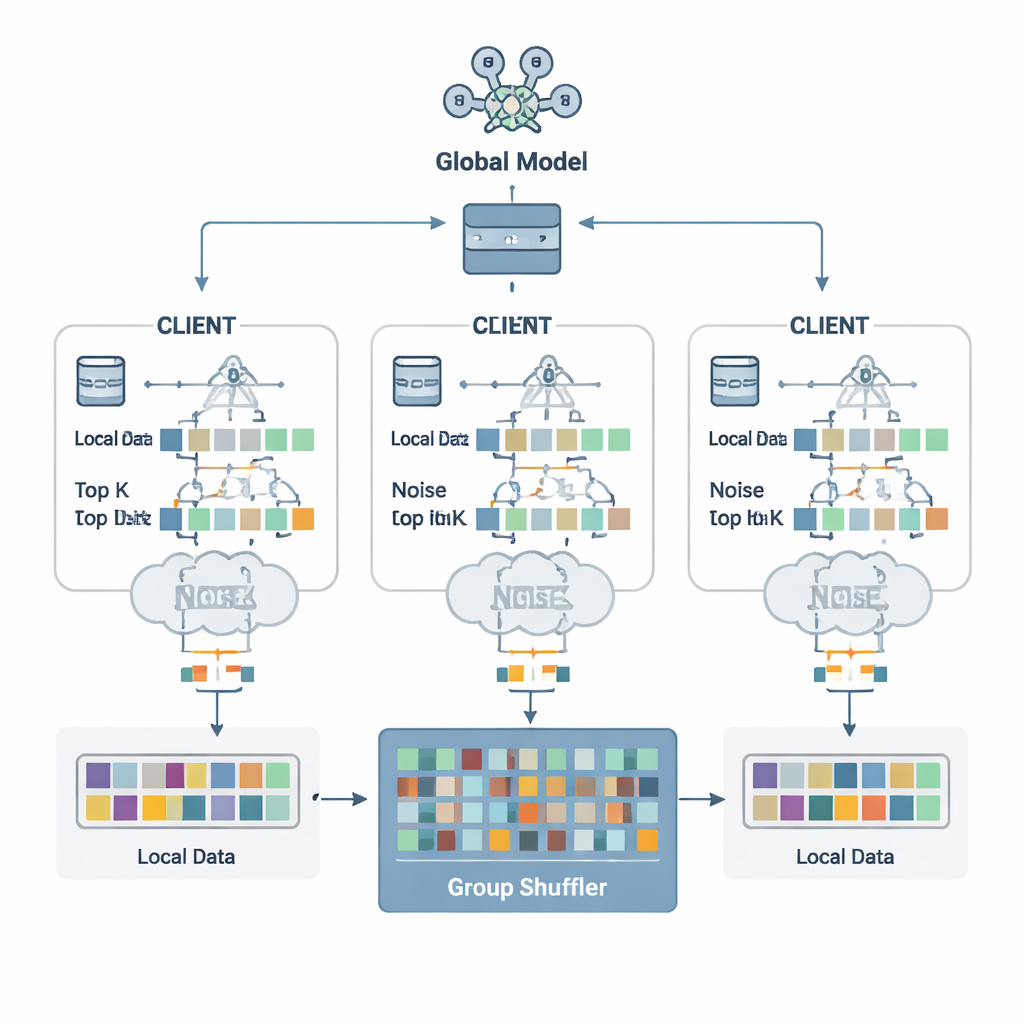

פירוק עדכונים לחלקים לא מזיקים

המחברים מציעים סכמה הגנתית שנקראת Security Defense based on Parameter Fragmentation Group Shuffling (SDPFGS). הרעיון הראשון שלה פשוט אך חזק: לעולם לא לשלוח עדכון שלם. במקום זאת, כל לקוח מחלק את עדכון המודל שלו למספר "פרגמנטים" מלאכותיים. רובם מלאים במספרים אקראיים, ורק האחרון מותאם כך שכל הפרגמנטים יחד עדיין מסתכמים לעדכון האמיתי. כל פרגמנט יחיד, או אפילו כמה מהם, נראים כּרעש וחושפים כמעט ולא מידע על הנתונים המקוריים. הטריק המתמטי הזה דומה לשיתוף סודי: רק על ידי חיבור כל החלקים ניתן לשחזר את הכול.

הוספת רעש ו"ערבוב הסיר"

שליחת פרגמנטים רבים עלולה עדיין להיות בזבזנית ואם תיבדק יחד עשויה לאפשר לתוקף להסיק יותר. כדי להימנע מכך, כל לקוח בוחר רק את ערכי הפרגמנט החשובים ביותר — הערכים Top-K המשמעותיים ביותר ללמידה — ומוסיף להם רעש אקראי מכויל בקפידה לפי עקרונות הפרטיות הדיפרנציאלית. רעש זה מקשה סטטיסטית לקבוע האם נתוני אדם מסוים השפיעו על ערך נתון. לאחר מכן מגיע המרכיב השני החשוב: ערבוב קבוצות. במקום לשלוח פרגמנטים ישירות לשרת, הלקוחות מעבירים אותם למ"מיין" מהימן שמערבב פרגמנטים ממספר לקוחות לקבוצות לפני שישלחו הלאה. לאחר ערבוב זה, השרת כבר אינו יכול לדעת מאיזה לקוח הגיע כל פרגמנט, ובכך נקטע הקשר בין עדכונים לזהויות.

שמירה על דיוק תוך צמצום דליפות

הצוות בדק את SDPFGS על מטריצות תמונה וטקסט סטנדרטיות, כולל ספרות כתובות יד (MNIST), תמונות בגדי־ים (Fashion-MNIST) ותמונות צבעוניות (CIFAR-10 ו-CIFAR-100), וכן משימת סיווג חדשות. הם השוו את השיטה שלהם עם כמה טכניקות פרטיות מתקדמות שמשתמשות רק ברעש, רק בערבוב, או בדחיסת גרדיאנטים פשוטה. בכל הניסויים האלה SDPFGS השתוותה או הייתה טובה יותר בדיוק לעומת שיטות מתחרות, תוך שימוש בתקשורת וזמן אימון פחותים ממספר מהן. בולט במיוחד, בניסיונות התקפת היפוך מודל — שבה תוקף מנסה לשחזר דוגמאות אימון — ל-SDPFGS היה שיעור הצלחה נמוך ביותר, כלומר היא דלפה הכי מעט מידע על הנתונים הבסיסיים.

מה המשמעות עבור משתמשים ביום‑יום

למשתמש מן השורה, המסר הוא ש"הסתרת הנתונים" אינה מספיקה; חייבים גם להסתיר את מה שמכשירינו שולחים במהלך האימון. SDPFGS עושה זאת על ידי הפיכת כל עדכון מודל לפרגמנטים רעשיים ומעורבבים שאין בהם תועלת בפני עצמם אך יחדיו עדיין יוצרים מודל גלובלי איכותי. התוצאה היא מגן חזק יותר מפני שרת סקרן או פגום, בעלות מינורית בלבד על הדיוק והיעילות. ככל שלמידה פדרטיבית מתפשטת בתרופות, פיננסים ומכשירים חכמים, טכניקות כמו SDPFGS יכולות לעזור להבטיח שאנשים ייהנו ממודלים משותפים עוצמתיים מבלי למסור את מפתחות חייהם הפרטיים.

ציטוט: Guo, H., Chen, W., Li, J. et al. Combining parameter fragmentation and group shuffling to defend against the untrustworthy server in federated learning. Sci Rep 16, 5097 (2026). https://doi.org/10.1038/s41598-026-35420-w

מילות מפתח: למידה פדרטיבית, פרטיות נתונים, פרטיות דיפרנציאלית, התקפות היפוך מודל, אגרגציה מאובטחת