Clear Sky Science · he

בחינת התלות של בני אדם בבינה מלאכותית בקבלת החלטות

מדוע האמון שלנו במכונות חכמות חשוב

מהמלצות על סרטים ועד סינון מועמדים לעבודה ומערכת המשפט, בינה מלאכותית (AI) עוזרת יותר ויותר לאנשים לקבל החלטות. רבים מאיתנו מניחים שמחשבים הם פחות מוטים ומדויקים יותר מבני אדם. אבל מה קורה בפועל כשהאנשים מקבלים המלצה ממערכת בינה מלאכותית — האם הם משתמשים בה בתבונה, או נשענים עליה יתר על המידה? המחקר בוחן כיצד אנשים מגיבים להנחיה של AI בהשוואה להנחיה מבני אדם ומה משמעות הדבר לתפקיד הגובר של AI בהחלטות היומיומיות.

בדיקה של אנשים אמיתיים עם פנים אמיתיות ומזויפות

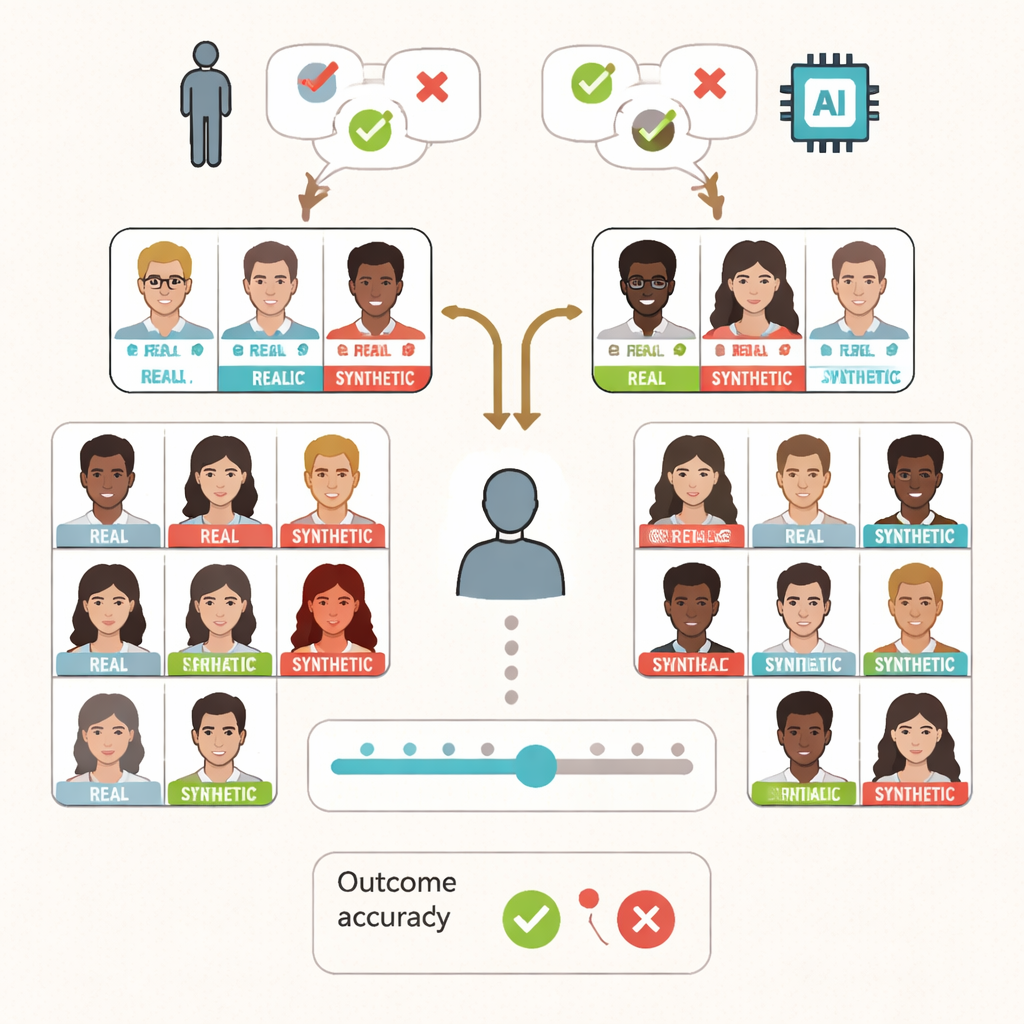

החוקרים ביקשו מ-295 מבוגרים לבצע מטלה שנראית פשוטה: להחליט האם הפנים על המסך הן צילום של אדם אמיתי או תמונה שנוצרה על ידי AI. כל משתתף ראה 80 פנים — חצי אמיתיות וחצי סינתטיות — שנבחרו בקפידה מעבודות קודמות כך שרוב האנשים יוכלו לזהות אותן ברוב המקרים, אך לא באופן מושלם. לצד כל פנים המשתתפים קיבלו הנחיה קצרה שאמרה אם הפנים "אמיתיות" או "סינתטיות". נאמר להם שהעצה הגיעה או מקבוצה של מומחים אנושיים או ממערכת AI, אף שבפועל כל ההנחיות תוכנתו מראש והיו נכונות רק בחצי מהמקרים.

שימוש בעצה, אבל לא בעיוורון

השאלה המרכזית הייתה האם אנשים פשוט יעקבו אחרי ההנחיה או יחשבו בעצמם. התוצאות מראות שהמשתתפים לא פעלו כמו לוחצים על כפתור פסיביים. הם עקבו אחר העצה הרבה יותר כשהיא הייתה נכונה והיו נוטים להתעלם ממנה כשהיא הייתה שגויה, ללא קשר לכך שהעזורה כביכול הגיעה מבני אדם או מ-AI. הדיוק הכולל בזיהוי פנים אמיתיות מול סינתטיות נשאר סביב שני שלישים נכונות — דומה מאוד לקבוצה נפרדת מעבודות קודמות שביצעה את אותה המוטלה ללא כל הנחיה. במילים אחרות, נוכחות "עוזר" מבוסס AI לא שיפרה ולא הרסה באופן דרמטי את הביצועים בממוצע.

כאשר גישות חיוביות כלפי AI חוזרות כבומרנג

מתחת לממוצעים הללו צצה דפוס עדין יותר. המשתתפים גם מילאו שאלונים על עד כמה הם בדרך כלל סומכים על אנשים אחרים וכיצד הם מרגישים לגבי AI. אלה שהחזיקו בעמדות חיוביות יותר כלפי AI למעשה הורע יכולתם להבחין בין אמיתי למזויף כאשר קיבלו הנחיה מ-AI. הם היו פחות מסוגלים להבדיל בין פנים אמיתיות לסינתטיות בהשוואה למשתתפים עם דעות זהירות או שליליות יותר כלפי AI. אפקט זה לא הופיע כאשר אנשים האמינו שההנחיה הגיעה מבני אדם, מה שמעיד שהעצה מ-AI עלולה לעצב ולעיתים לעוות את קבלת ההחלטות שלנו באופן ייחודי. המחקר גם מצא שאנשים שטענו שהם תמיד סומכים על ההנחיה ביצעו גרוע יותר מאלו שאמרו שהם משתמשים בה רק לפעמים או לא בכלל.

אנשים עדיין משחקים את תפקיד המחליטים

החוקרים חפרו עמוק יותר כיצד אנשים מאזנים בין שיקול דעתם לבין ההנחיה. בממוצע, המשתתפים הראו הטיה לסווג פנים כאמיתיות, וההטיה הזו גדלה במקצת אצל אלה שדיווחו על נטייה גדולה יותר לסמוך על בני אדם אחרים. עם זאת, האופן שבו אנשים השתמשו בהנחיה נראה "אסטרטגי": הם נטו לפנות אליה במיוחד כשהיו פחות בטוחים. דירוגי הביטחון התאימו די טוב לביצועים — כשהאנשים הרגישו יותר בטוחים הם היו בדרך כלל מדויקים יותר — מה שמעיד שהמשתתפים הבינו באופן סביר מתי הם צודקים או טועים, גם כאשר AI היה בתמונה.

מה משמעות הדבר לכלי AI שבשימוש יומיומי

לקורא כללי, המסר המרכזי הוא ש-AI לא מסיר באופן קסום הטיה אנושית, וגם לא משתלט אוטומטית על שיפוטנו. אנשים לעתים קרובות מתייחסים להנחיות של AI באופן דומה להנחיות אנושיות ויכולים להתעלם מהן כשהן נראות לא מועילות. אבל כאשר מישהו כבר חושב בחיוב מובהק על AI, ייתכן שהוא נוטה להישען עליה באופן שמפחית את דיוקו. ככל שמערכות AI מתפשטות לתחומים קריטיים כמו בריאות, אבטחה וצדק, מעצבים ומחוקקים צריכים להבין את הנטיות האנושיות הללו. המחקר מציע ששימוש יעיל ב-AI תלוי לא רק באלגוריתמים טובים יותר, אלא גם באנשים-informed שיודעים מתי לסמוך על המכונה — ומתי לסמוך על עצמם.

ציטוט: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

מילות מפתח: בינה מלאכותית, קבלת החלטות אנושית, אמון בבינה מלאכותית, הטיית אוטומציה, פני דיפפייק