Clear Sky Science · he

הזיכרון המוזאיקי של מודלים לשוניים גדולים

מדוע עותקים קרובים חשובים

מודלים לשוניים גדולים כמו ChatGPT לומדים מאוקיינוסים של טקסט, ולפעמים הם מזכירים חלקים מאותו טקסט. זה מעלה חששות לגבי פרטיות, זכויות יוצרים, ואיך ניתן לשפוט בהגינות מה המערכות האלה באמת יודעות. מאמר זה מראה שזכירה אינה רק עניין של העתקה‑הדבק מדויקת. במקום זאת, מודלים יכולים לשחזר קטעים מתוך גרסאות רבות המעט שונות, בדומה להרכבת מוזאיקה. הבנת סוג הזיכרון הנסתר הזה חשובה לכל מי שאכפת לו מבטיחות ובטיחות ה‑AI.

דרך חדשה לחשוב על זיכרון מכונה

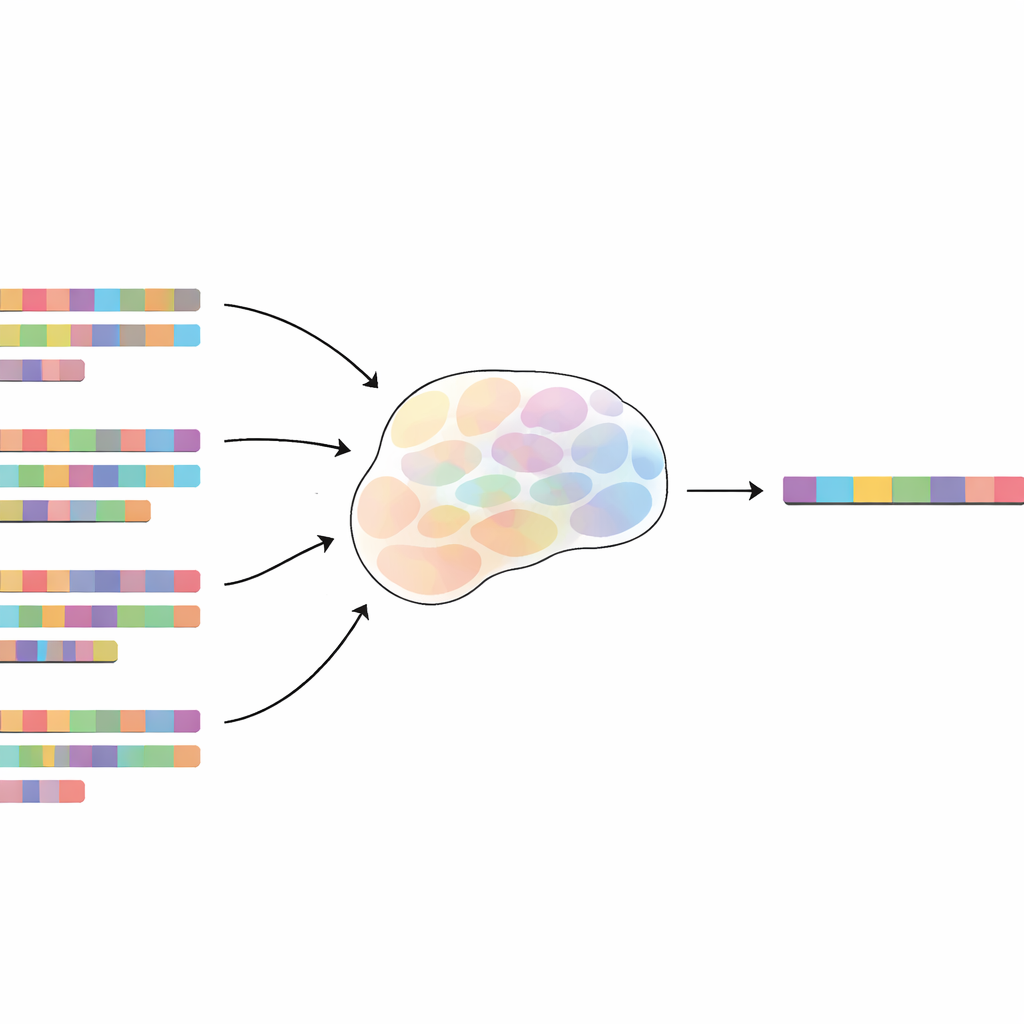

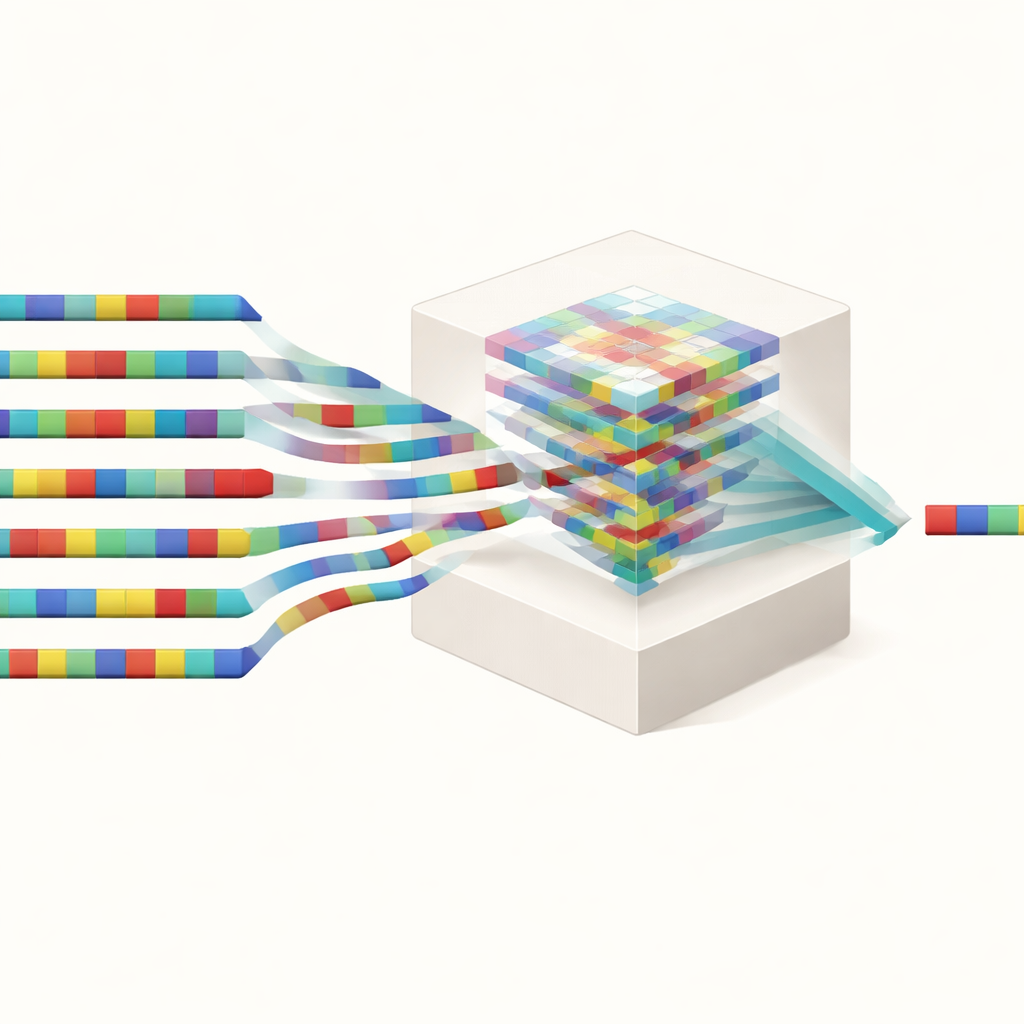

רוב האנשים מניחים שמודל שפה מזכיר משהו רק אם הוא רואה את המשפט המדויק שוב ושוב. המחברים מערערים על נקודת מבט זו כשהם מציגים את רעיון ה"זיכרון המוזאיקי". לפי גישה זו, מודל יכול לזכור קטע של 100 מילים לא רק מתוך חזרות מדויקות, אלא גם מתוך המון עותקים מעורפלים — גרסאות שבהן מילים נמחקו, שונו או הוסטו. כדי לחקור זאת בצורה שיטתית, הם משתילים ביטויים מבחן מלאכותיים, שנקראים קנריות, בנתוני האימון של המודל יחד עם גרסאות רבות ששונו. לאחר האימון הם מודדים עד כמה קל להכריע האם קנריה מסוימת היתה בערכת האימון, באמצעות סוג של מבחן פרטיות שנקרא מתקפת היסק חברות (membership inference attack).

איך עותקים מעורפלים משאירים עדיין עקבה ברורה

בהשוואה בין עותקים מעורפלים לחזרות מדויקות, החוקרים מגדירים "שווה ערך לעותק מדויק": עד כמה עותק מעורפל תורם לזכירה בהשוואה לעותק מושלם. הם מגלים ששינויים קלים מאוד כמעט ולא מחלישים את הזכירה. אם רק כ־10% מהמילים בכל עותק מוחלפות באקראי, עותק מעורפל בודד עדיין תורם בערך 60–65% ממה שעושה עותק מדויק. אפילו כאשר מחצית מהמילים משתנות, כל גרסה שעובדה עדיין שווה בערך 15–20% מעותק מלא. ההשפעה יציבה: הוספת מילים אקראיות בין ביטויים מרכזיים או עירבוב גושי המשפט מפחיתה את הזכירה, אך לא מבטלת אותה. נראה שהמודל מסוגל לדלג על רעשים, להתמקד בחתיכות החופפות ולחבר אותן חזרה יחד.

צורה על פני משמעות במה שהמודלים מאחסנים

בהינתן שמודלים מודרניים יכולים לפתור בעיות מתמטיות, לבצע הוראות ולתרגם בין שפות, אפשר לצפות שזיכרונותיהם יהיו קשורים למשמעות. באופן מפתיע, המחקר מוצא את ההפך. כאשר המחברים מחליפים מילים באלטרנטיבות ששומרות על משמעות המשפט, הזכירה משתפרת רק במעט בהשוואה להחלפתן במילים אקראיות. פרפרזות שמיוצרות על־ידי מערכות AI אחרות — שמקיימות את אותו רעיון אבל משנות פרטים שטחיים רבים — תורמות יחסית מעט לזכירה אלא אם כן הן עדיין חולקות רצפי מילים קצרים רבים עם הקטע המקורי. במגוון מבחנים, מה שמניע באמת את הזיכרון הוא חפיפה בטוקנים המדויקים (יחידות המילים הבסיסיות של המודל), לא רעיונות משותפים. במילים אחרות, הזיכרון המוזאיקי של המודל הוא בעיקר על הצורה, לא על המשמעות.

שכפולים מוסתרים בנתוני אימון מעשיים

המחברים שואלים אז כמה נפוצים עותקים מעורפלים במאגר ווב פופולרי שעבר ניקוי מרובה ושימש לאימון מודלים, המכונה SlimPajama. למרות שמאגר זה כבר הסיר מסמכים כמעט זהים, הצוות מגלה שרבים מהרצפים באורך 100 טוקנים שמופיעים בדיוק 1,000 פעמים גם יש להם אלפי גרסאות קרובות. למרחקי עריכה קטנים — כ־10% מהתווים משתנים — יש בממוצע בערך פי 4 יותר עותקים מעורפלים מאשר עותקים מדויקים, ועשרות אלפי נוספים במרחקים גדולים יותר אך עדיין משפיעים. חשובה מכך, טכניקות "הסרת שכפולים" סטנדרטיות בתעשייה, שמסירות בדרך כלל רק חפיפות ארוכות ומדויקות, משאירות את רוב העותקים המעורפלים הללו ללא שינוי. משמעות הדבר היא שמודלים עדיין יכולים לזכור חומר רגיש או מוגן בזכויות יוצרים על‑ידי הרכבתו ממקורות רבים שעברו שינויים קלים.

מדוע זה חשוב לפרטיות, הוגנות ושליטה

ממצאים אלה נושאים משמעויות רחבות. מבחינת פרטיות, הם מראים שניקוי של חזרות מדויקות מנתוני האימון אינו מספיק: מידע אישי או סודי יכול להיות מוזכר דרך משפחות של קטעים דומים. מבחינת זכויות יוצרים ובדיקות תקן, עותקים מעורפלים עלולים לגרום למודלים לשחזר טקסט מוגן או להנפיק ציונים מנופחים במבחנים שהם למעשה ראו בגרסה ממוסווית. בניסיונות "להתנתק" מנתונים ספציפיים, לא מספיק למחוק דוגמה פוגעת אחת אם נותרו גרסאות רבות שלה. בסך הכל, העבודה חושפת שזיכרון מודלי השפה הוא מוזאיקה מורכבת שבנויה מהרבה חפיפות קטנות, דבר שמאתגר את כלי הבטיחות הנוכחיים ודורש דרכים חכמות ומפורטות יותר לנקות ולבדוק את נתוני האימון.

ציטוט: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

מילות מפתח: זכירת מודל שפה, עותקים מעורפלים, פרטיות נתונים, הסרת שכפולים מטרינינג, זיהום מבחנים תקניים