Clear Sky Science · fr

Copilote chirurgical RARP : un modèle vision-langage pour la prostatectomie radicale assistée par robot

Une aide plus intelligente en salle d’opération

La chirurgie moderne du cancer de la prostate se pratique à l’aide de robots et de caméras sophistiqués, mais les chirurgiens doivent toujours jongler avec des décisions complexes, des vues qui changent rapidement et des questions constantes des stagiaires et du personnel. Cet article présente un « copilote » d’intelligence artificielle capable de regarder la vidéo chirurgicale en direct et de répondre oralement aux questions sur le moment, un peu comme un assistant extrêmement renseigné. Pour les patients, cela ouvre la voie à des opérations plus sûres et plus homogènes ; pour les chirurgiens, cela laisse entrevoir un avenir où des conseils d’experts et un soutien pédagogique sont disponibles dans chaque bloc opératoire.

Un assistant numérique qui voit et parle

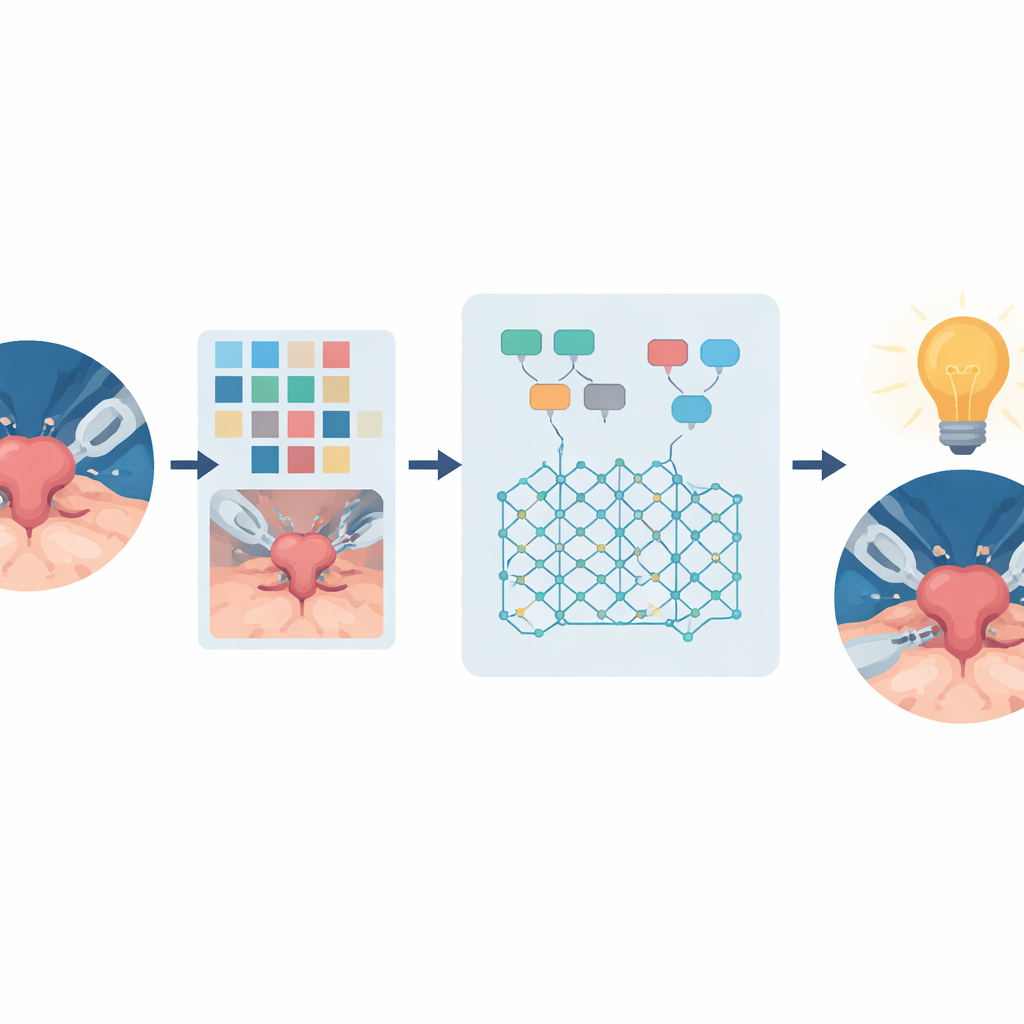

Les chercheurs ont conçu le Copilote Surgical RARP pour une intervention spécifique : la prostatectomie radicale assistée par robot, l’intervention standard pour de nombreux hommes atteints d’un cancer localisé de la prostate. Dans cette procédure, un système robotique contrôlé par le chirurgien retire la prostate par de petites incisions, guidé par une caméra haute définition dans la cavité corporelle. Les systèmes d’IA traditionnels basés sur le texte ne peuvent pas interpréter ce que montre la caméra chirurgicale. Le Copilote, lui, combine vision par ordinateur et grand modèle de langage, ce qui lui permet de « voir » le champ opératoire et de générer des réponses en langage naturel sur ce qui se passe, quels instruments sont en vue ou quelles devraient être les prochaines étapes de l’intervention.

Apprendre le savoir-faire chirurgical au Copilote

Pour doter le Copilote d’une expertise chirurgicale pertinente, l’équipe a assemblé un jeu de données d’entraînement spécialisé au lieu de s’appuyer sur des images générales d’internet. Ils ont collecté près de 20 000 images annotées issues d’opérations de la prostate enregistrées, indiquant les positions des instruments, des organes et l’étape courante de la procédure. Ils ont également ajouté des informations de profondeur approximatives, afin que le système puisse déduire quels objets sont au premier plan ou en contact les uns avec les autres. À l’aide de règles conçues par des experts, ces annotations ont été converties en légendes détaillées décrivant ce que chaque image montrait et à quel moment de l’intervention elle correspondait. Des grands modèles de langage ont ensuite été sollicités, dans la voix de différentes « personas » allant de chirurgiens seniors à des enfants curieux, pour générer plus d’un million de paires question–réponse basées sur ces légendes. Un modèle séparé a vérifié la cohérence logique de ces paires et les exemples défectueux ont été filtrés avant l’entraînement.

Qualité des performances du Copilote

Une fois entraîné, le Copilote a été évalué de plusieurs manières. Sur un ensemble tenu à l’écart de paires question–réponse synthétiques, l’ajustement fin (fine-tuning) a augmenté la capacité du modèle à fournir des réponses partiellement correctes d’environ 61 % à 83 %, et des réponses entièrement correctes de 0 % à 59 %. Des évaluateurs humains ont ensuite posé 650 questions sur des images chirurgicales préenregistrées ; près de sept réponses sur dix ont été jugées totalement correctes. Le système a aussi relevé des tâches classiques de vision par ordinateur sans réentraînement supplémentaire : il a identifié l’étape de la prostatectomie à partir d’une seule image vidéo avec 82 % de précision et reconnu les instruments chirurgicaux avec un score F1 de 94 %, tout en estimant le temps restant de l’intervention. Ces résultats suggèrent qu’un modèle unique et unifié peut égaler des outils spécialisés sur plusieurs tâches tout en restant capable de converser de façon ouverte.

Intégrer l’IA dans une intervention en direct

La démonstration la plus marquante a eu lieu en salle d’opération réelle. Le Copilote a été déployé sur un ordinateur de bord puissant connecté directement au flux vidéo du robot chirurgical. Lors d’une prostatectomie en direct, réalisée sur une plateforme robotique différente de celle utilisée pour l’entraînement, un public de chirurgiens et d’ingénieurs a soumis 276 questions via leurs smartphones. Après filtrage des requêtes non pertinentes et des doublons, les experts ont estimé que le Copilote a répondu correctement à environ 77 % des questions restantes — un niveau comparable à sa performance hors ligne. Le système a mis environ une demi-seconde avant de commencer sa réponse et a produit du texte suffisamment rapidement pour paraître interactif, tout en appliquant des filtres de sécurité et un comportement prudent en cas d’incertitude.

Ce que cela signifie pour la chirurgie future

Pour le grand public, le message principal est qu’un système d’IA peut désormais observer en temps réel une intervention délicate contre le cancer et fournir des réponses utiles et contextualisées sur ce qui se passe et sur ce qui devrait se passer ensuite. Bien que le Copilote actuel soit limité à un type d’intervention, qu’il s’appuie sur des instantanés plutôt que sur une mémoire vidéo complète et qu’il n’ait pas encore accès aux dossiers médicaux complets, il démontre que l’IA multimodale peut être intégrée en toute sécurité au bloc opératoire. À mesure que des systèmes similaires seront étendus à d’autres procédures, connectés à des données patients plus riches et testés rigoureusement pour leur impact clinique, ils pourraient soutenir la formation, améliorer la communication d’équipe et, en fin de compte, aider à rendre la chirurgie complexe plus sûre et plus transparente.

Citation: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Mots-clés: chirurgie robotique, cancer de la prostate, IA chirurgicale, modèle vision-langage, assistance en salle d’opération