Clear Sky Science · fr

Détection du comportement des bovins à partir de vidéos pour le développement de jumeaux numériques dans les systèmes laitiers de précision

Pourquoi observer les vaches compte

Dans les élevages laitiers modernes, connaître en continu ce que fait chaque vache — manger, se reposer, boire ou ruminer — est directement lié à la production de lait, à la santé et au bien‑être. Pourtant, les éleveurs n’ont généralement pas le temps d’observer tous les animaux en permanence. Cette étude montre comment des caméras classiques de bâtiment, associées à des techniques avancées de vision par ordinateur, peuvent suivre automatiquement la vie quotidienne des vaches et alimenter un « jumeau virtuel » du troupeau. De tels systèmes pourraient aider les éleveurs à affiner la nutrition, détecter les maladies plus tôt et gérer le troupeau plus efficacement, le tout sans équiper les animaux de capteurs portés.

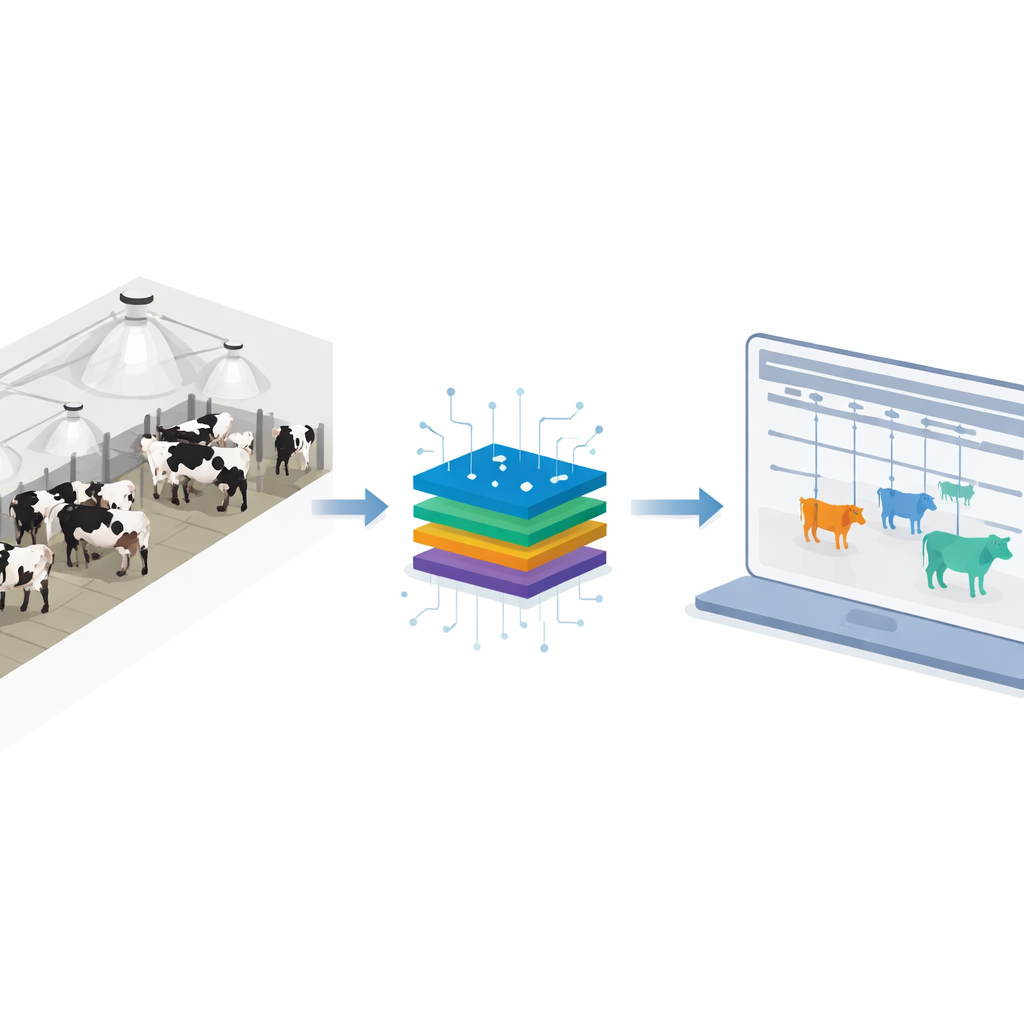

Du bâtiment réel au troupeau virtuel

Les chercheurs ont cherché à construire les « yeux et oreilles » comportementaux d’un jumeau numérique laitier — un modèle virtuel du bâtiment et de ses vaches qui se met à jour en quasi‑temps réel. Ils se sont concentrés sur sept activités quotidiennes cruciales pour la santé et la production : rester debout, être couché, s’alimenter en position debout, s’alimenter en position couchée, boire, et ruminer (mâcher le bol alimentaire) en position debout ou couchée. Plutôt que de s’appuyer sur des capteurs portés, ils ont utilisé des caméras de surveillance en plafonnier et inclinées dans une stabulation à entraves de type commercial hébergeant environ 80 vaches Holstein. Les vidéos continues ont été découpées en courtes séquences de 10 secondes centrées sur des vaches individuelles, constituant la matière première pour apprendre aux ordinateurs à reconnaître l’activité de chaque animal.

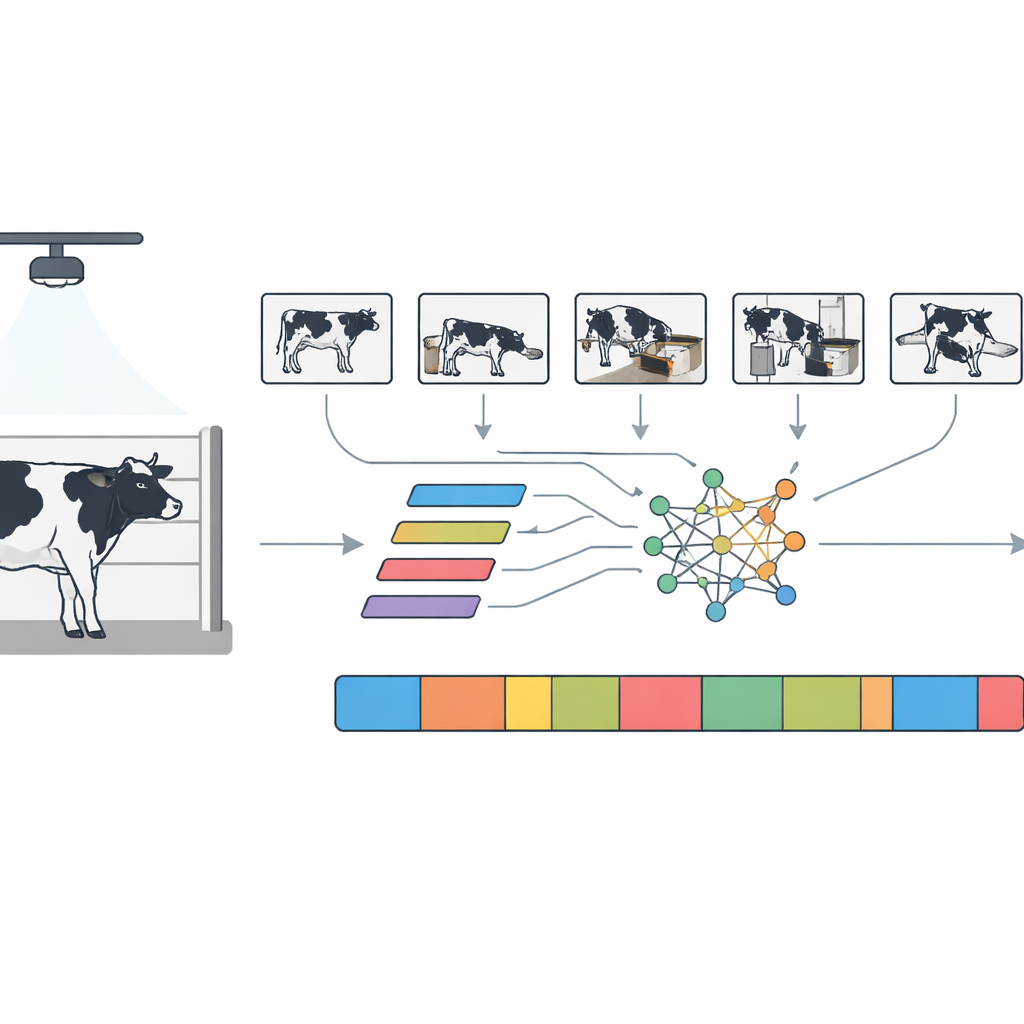

Apprendre aux ordinateurs à reconnaître le comportement des vaches

Transformer les images brutes en données exploitables a nécessité plusieurs étapes. D’abord, un système de détection d’objets localisait automatiquement les vaches dans chaque image, et un algorithme de suivi conservait l’identité de chaque animal au fil du mouvement, même en cas de dissimulation partielle. Le programme recadravait ensuite chaque vache et redimensionnait les séquences pour les standardiser. Des experts humains ont annoté près de 5 000 de ces clips avec le comportement correct, en suivant des règles visuelles claires et en se contrôlant mutuellement pour garantir la cohérence. Comme les vaches passent naturellement plus de temps couchées ou debout que à boire ou à ruminer, l’équipe a élargi les comportements rares par « augmentation » numérique — petites rotations, recadrages, variations de luminosité et ajustements temporels — pour obtenir un jeu d’entraînement plus équilibré d’environ 9 600 clips.

Comment le système repère les motifs dans le temps

Pour détecter les comportements, l’équipe a comparé deux grandes familles de modèles d’analyse vidéo. L’un, appelé SlowFast, imite deux vitesses de vision simultanées : une voie « lente » qui capte la posture sur des périodes plus longues, et une voie « rapide » qui se concentre sur les mouvements rapides de la tête. L’autre, TimeSformer, utilise des mécanismes d’attention initialement développés pour les modèles de langage afin d’examiner l’espace et le temps, en décidant quelles parties de chaque image et quels instants d’un clip sont les plus importants. Entraîné sur les vidéos de la stabulation, TimeSformer a légèrement surpassé SlowFast, classant correctement les comportements dans environ 85 % des cas et assez rapidement pour une utilisation en temps réel sur un processeur graphique moderne. Les visualisations ont montré que le modèle se focalisait naturellement sur la tête et le museau de la vache lors de l’alimentation et de la prise d’eau, et sur le torse et les pattes pour la position couchée ou debout, en accord avec le jugement d’un observateur humain.

Des flux de comportements aux décisions agricoles

Une fois que le système a su reconnaître les comportements clip par clip, les chercheurs ont construit une chaîne complète s’exécutant en continu sur les vidéos du bâtiment. Le programme suit chaque vache dans le temps, applique une fenêtre glissante aux séquences vidéo et lisse les erreurs momentanées afin que de courts instants erratiques n’apparaissent pas comme des changements d’état rapides. Le résultat est une chronologie propre pour chaque animal : quand elle s’est alimentée, couchée, tenue debout, a bu ou a ruminé, ainsi que la durée de chaque épisode et le niveau de confiance du système. Ces journaux structurés peuvent être lus directement par des modèles de nutrition qui estiment l’ingestion à partir du temps d’alimentation, et ils peuvent piloter un jumeau numérique 3D dans un environnement de type jeu qui montre des vaches virtuelles reproduisant les actions de leurs homologues réelles. Dans une étude de cas de 24 heures sur une vache, le système a reconstruit sa journée complète d’activités et a utilisé la durée d’alimentation plus des informations animales de base pour estimer la quantité d’aliment sec qu’elle aurait probablement consommée.

Ce que cela signifie pour les fermes laitières de demain

L’étude montre que des caméras peu coûteuses et des modèles vidéo bien conçus peuvent fournir des enregistrements comportementaux continus par vache suffisamment précis pour constituer la couche sensorielle d’un jumeau numérique laitier. Bien que le travail n’automatise pas encore les décisions — comme le changement de ration ou l’alerte du personnel en cas de maladie — il fournit le flux d’entrée crucial dont dépendent ces outils de niveau supérieur. À mesure que l’approche sera étendue à des bâtiments plus ouverts et combinée à d’autres capteurs, les éleveurs pourraient obtenir une vue détaillée et permanente des rythmes quotidiens de leurs animaux, permettant une gestion plus douce et plus précise bénéfique à la fois pour les vaches et pour l’environnement.

Citation: Rao, S., Garcia, E. & Neethirajan, S. Video-based cattle behaviour detection for digital twin development in precision dairy systems. npj Vet. Sci. 1, 3 (2026). https://doi.org/10.1038/s44433-026-00004-x

Mots-clés: élevage de précision, vision par ordinateur, comportement des bovins laitiers, jumeau numérique, surveillance du bien‑être animal