Clear Sky Science · fr

Démêler l’émergence du comportement collectif dans des réseaux d’agents cognitifs

Pourquoi les essaims pensants comptent

Des collectifs de robots aux communautés en ligne, des groupes d’unités simples peuvent afficher des comportements étonnamment riches. Mais que se passe-t-il quand chaque unité n’est pas du tout simple et possède au contraire un raisonnement puissant fondé sur le langage, comme les grands modèles d’IA d’aujourd’hui ? Cette étude explore comment des essaims de tels « agents cognitifs » se comportent par rapport aux particules classiques qui suivent des règles, et ce que cela implique pour des tâches comme la résolution de problèmes et la simulation de sociétés.

Des particules simples aux agents parlants

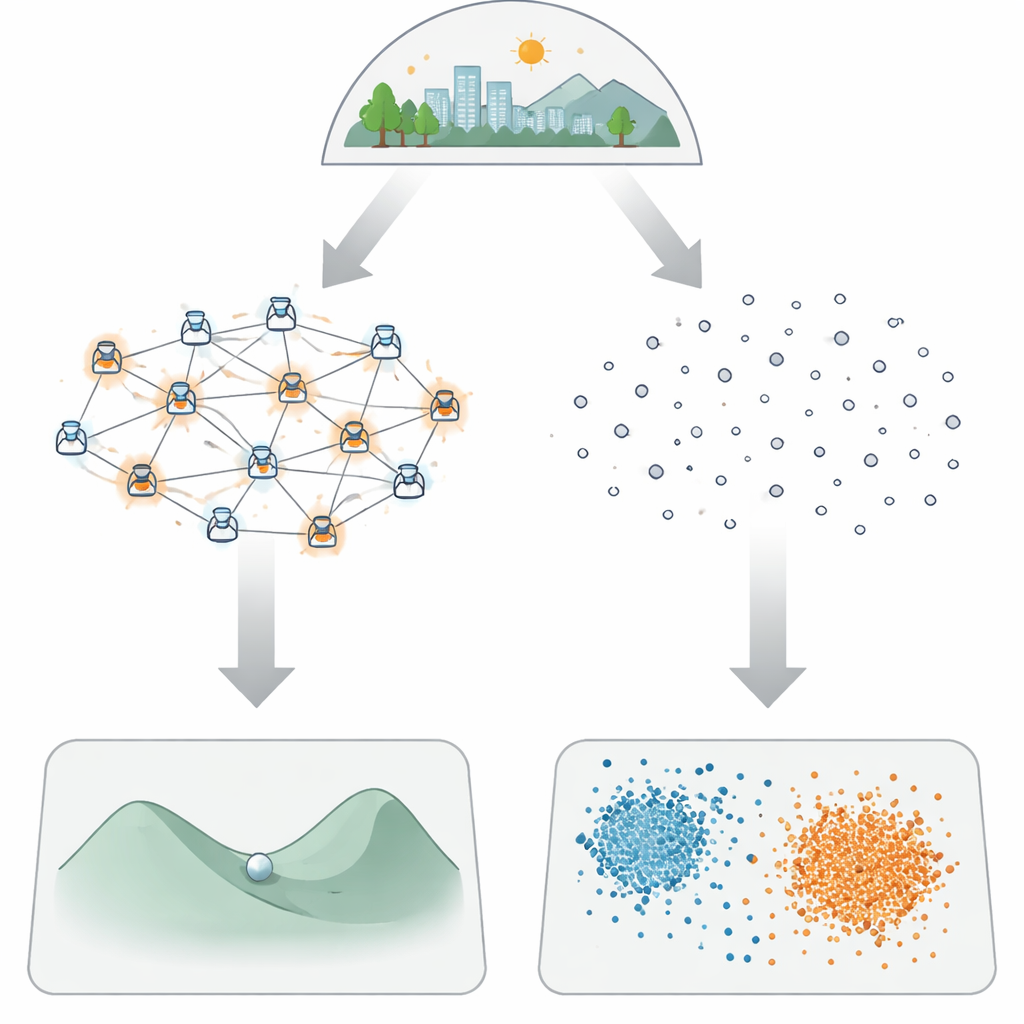

Les modèles traditionnels de foules, de vols ou d’essaims considèrent les individus comme des particules basiques qui suivent des règles fixes : se diriger vers un voisin, éviter les collisions, préférer des voisins semblables, etc. En revanche, les agents étudiés ici sont propulsés par des grands modèles de langage (LLM). Ils perçoivent leur environnement en mots, raisonnent sur la suite des actions, se remémorent des expériences passées et communiquent entre eux. Les auteurs posent une question centrale : quand chaque unité dispose de cette « intelligence » intégrée, les motifs globaux qui émergent au niveau du groupe changent-ils, et si oui, comment ?

Tester les essaims sur des problèmes difficiles

Pour sonder cette question, les chercheurs comparent les agents cognitifs aux particules classiques sur deux défis très différents. Le premier est l’optimisation de fonctions, un substitut aux problèmes de recherche difficiles où l’objectif est de trouver la meilleure solution dans un paysage bosselé rempli de nombreux pièges locaux. Ils introduisent LLM Agent Swarm Optimization (llmASO), où un réseau d’agents LLM propose et partage des solutions candidates en langage naturel. Cela est comparé à une méthode bien connue basée sur des particules, la Particle Swarm Optimization, ainsi qu’à un optimiseur LLM unique travaillant seul. Dans des paysages plus simples, des agents LLM isolés trouvent rapidement de bonnes réponses en repérant des motifs dans les tentatives passées. Mais sur des terrains plus rugueux avec de nombreux creux locaux, les agents solitaires ont tendance à se fixer trop vite sur des points « assez bons » à proximité. Les essaims d’agents parlants, en revanche, découvrent de manière fiable la véritable meilleure région — bien qu’ils le fassent plus lentement et soient sensibles à la manière dont l’information circule dans leur réseau de communication.

Comment la parole change les dynamiques sociales

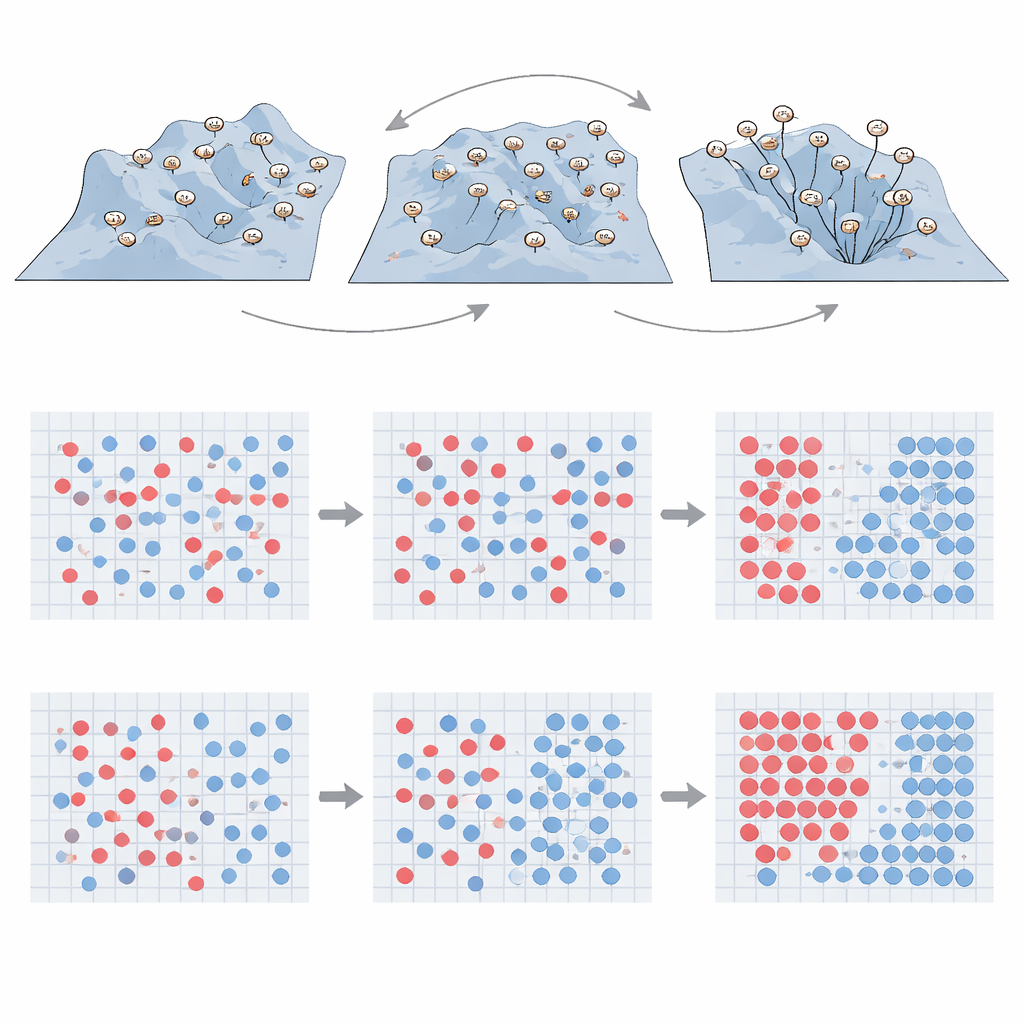

Le second test revisite le modèle classique de ségrégation de Schelling, qui montre comment de légères préférences pour des voisins similaires peuvent conduire à une séparation marquée entre groupes. Ici, les agents se déplacent sur une grille et appartiennent à l’un des deux types ; ils sont « satisfaits » si trop peu de voisins leur sont différents. Pour des particules standard qui suivent de simples règles de relocalisation, trois phases familières apparaissent lorsque la tolérance change : un état mixte avec remaniements constants, un état ségrégué avec des grappes distinctes, et un état figé où le mouvement s’arrête en grande partie. Les agents cognitifs obéissent à la même règle de satisfaction de base mais décident où se déplacer après avoir échangé des messages avec d’autres agents. Lorsque chaque agent peut parler à tous les autres, le résultat d’ensemble ressemble étonnamment au cas des particules, ce qui suggère que l’ajout simple du langage et du raisonnement ne bouleverse pas automatiquement les schémas de ségrégation bien connus.

Réseaux et effets de « qui se ressemble s’assemble »

L’histoire change dès que la structure des conversations devient plus réaliste. Les auteurs reconfigurent le réseau de communication pour que les agents parlent principalement à des pairs proches, ou pour que les connexions suivent des motifs observés dans de nombreux systèmes sociaux réels avec quelques nœuds très connectés. Ils expérimentent également l’homophilie (préférence pour converser avec le même type) et l’hétérophilie (préférence pour l’autre type). Ces ajustements ont de fortes conséquences : lorsque les agents conversent surtout avec des pairs similaires, ils se coordonnent rapidement, forment efficacement des grappes et peuvent même éviter la phase constamment mixte. Quand ils parlent principalement entre types, le chemin vers la satisfaction est plus lent et plus complexe, mais une forte ségrégation peut tout de même surgir — même si chaque conversation traverse les lignes de groupe. Dans l’ensemble, les conversations locales et les tendances de « qui se ressemble s’assemble » remodèlent l’émergence de la ségrégation, d’une manière inaccessible aux particules non pensantes.

Ce que cela signifie pour les futurs essaims d’IA et les simulations sociales

Les auteurs concluent que doter chaque agent de capacités avancées fondées sur le langage ne rend pas simplement les groupes universellement meilleurs. Ces capacités introduisent au contraire de nouvelles forces — comme le consensus rapide et l’exploitation de motifs — qui peuvent être bénéfiques ou néfastes selon la manière dont les agents sont interconnectés. Pour les tâches d’optimisation, des réseaux mal conçus peuvent pousser des agents intelligents à s’accorder trop vite sur des solutions médiocres ; limiter soigneusement le flux d’information les aide à explorer plus largement, au prix de la vitesse. Dans les simulations sociales, des schémas de communication réalistes et l’homophilie peuvent générer des comportements différents des modèles classiques et mieux refléter les sociétés humaines. À mesure que des essaims de robots pilotés par l’IA et des réseaux d’agents virtuels deviennent plus courants, comprendre et ajuster ces effets collectifs sera crucial pour concevoir des systèmes sûrs et efficaces.

Citation: Zomer, N., De Domenico, M. Unraveling the emergence of collective behavior in networks of cognitive agents. npj Artif. Intell. 2, 36 (2026). https://doi.org/10.1038/s44387-026-00091-5

Mots-clés: agents cognitifs, grands modèles de langage, optimisation par essaim, dynamique de ségrégation, topologie de réseau