Clear Sky Science · fr

DeepKoopFormer : une architecture à base de Transformer enrichie par Koopman pour la prévision de séries temporelles

Pourquoi des prévisions plus intelligentes comptent

Des prévisions météorologiques et de planification énergétique aux marchés financiers, beaucoup de nos décisions majeures reposent sur l’anticipation de l’évolution des phénomènes dans le temps. Ces « séries temporelles » — flux de mesures comme la vitesse du vent, la production d’électricité ou le cours d’une cryptomonnaie — deviennent de plus en plus longues, bruitées et complexes. Les outils d’IA modernes appelés Transformers peuvent traiter ces données, mais ils fonctionnent souvent comme des boîtes noires et peuvent devenir instables lorsqu’on les pousse à prévoir loin dans le futur. Cet article présente DeepKoopFormer, une méthode de prévision qui conserve la puissance prédictive des Transformers tout en ajoutant une structure mathématique pour rendre leur comportement plus stable, interprétable et fiable sur de longues horizons.

Une nouvelle façon d’assagir des modèles puissants

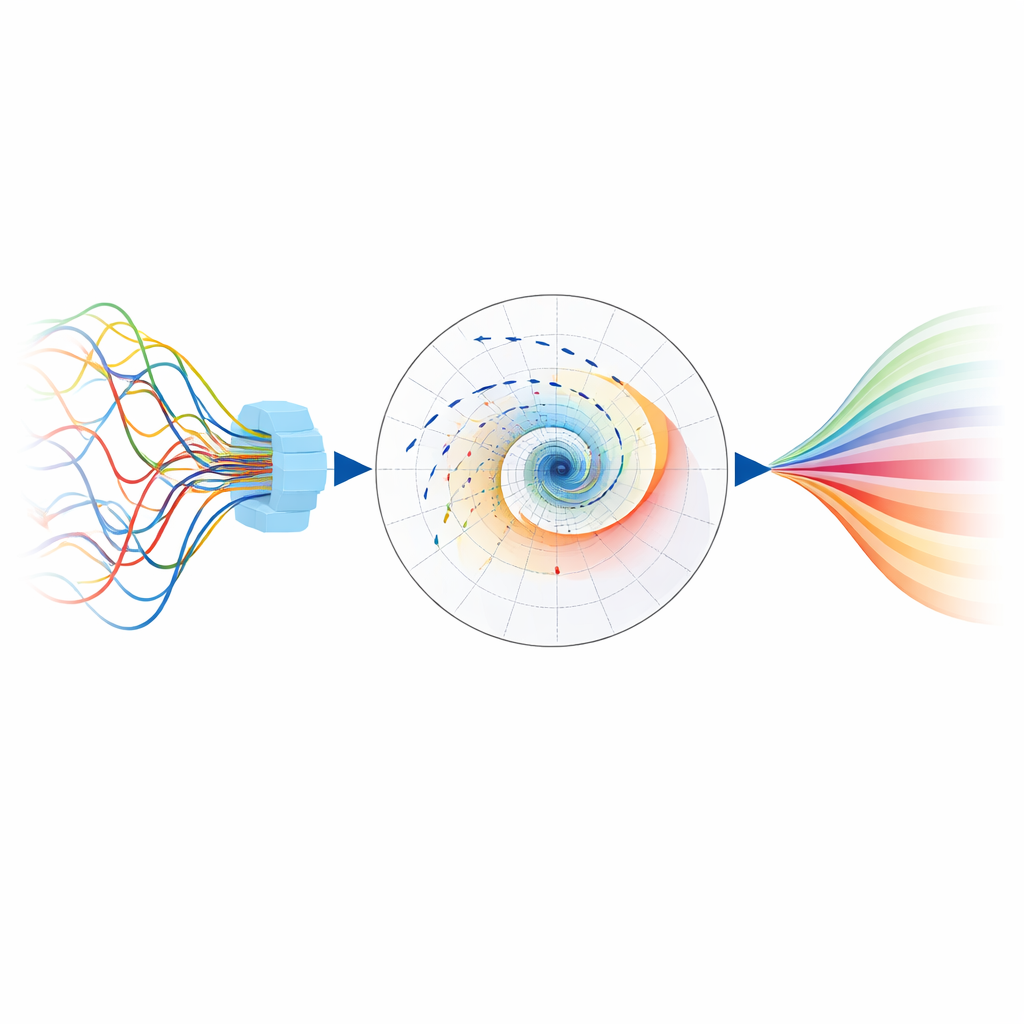

Les auteurs partent d’une idée familière dans l’IA contemporaine : utiliser un Transformer pour digérer les séries temporelles brutes en une représentation interne riche. DeepKoopFormer insère ensuite une couche intermédiaire soigneusement conçue, inspirée d’un concept des systèmes dynamiques connu sous le nom d’opérateur de Koopman. Plutôt que de laisser le modèle évoluer de manière entièrement non linéaire et complexe, cette couche intermédiaire fait progresser l’état interne via une simple transformation linéaire dans un espace caché. Crucialement, cette transformation est construite pour que son influence s’amenuise progressivement au fil du temps plutôt que de s’amplifier de façon incontrôlée, ce qui garantit mathématiquement que les prévisions à long terme ne divergeront pas ni ne se mettront à osciller de manière incontrôlée.

Comment le modèle garde son équilibre

Pour imposer cette stabilité, DeepKoopFormer contraint l’étape linéaire de plusieurs façons. La transformation est factorisée en trois éléments : deux matrices orthogonales (qui préservent les longueurs et les angles) encadrant une matrice diagonale de facteurs d’échelle tous contraints à être inférieurs à un. Cela signifie que l’état caché est doucement contracté plutôt qu’amplifié à chaque mise à jour. Un second ingrédient, appelé régularisation de Lyapunov, ajoute une pénalité d’entraînement chaque fois que l’énergie de l’état caché augmente d’un pas à l’autre. Ensemble, ces mécanismes assurent que la dynamique interne reste calme et bien contrôlée, tandis que le Transformer en amont et le décodeur linéaire en aval restent libres d’être expressifs. La capacité du modèle à apprendre des motifs riches et sa stabilité sont contrôlées par des réglages séparés, de sorte que l’utilisateur peut ajuster l’un sans compromettre l’autre.

Mettre la méthode à l’épreuve

Les chercheurs évaluent DeepKoopFormer sur des problèmes contrôlés et des problèmes réels. Ils le testent d’abord sur des systèmes chaotiques classiques tels que l’attracteur de Lorenz, où de petites variations peuvent conduire à des futurs très différents, en ajoutant du bruit aléatoire pour imiter des mesures réelles. Sur différents cœurs Transformer, les versions enrichies par Koopman suivent de près les trajectoires réelles tout en maintenant un comportement interne stable sur de nombreux pas de prévision à courte portée. Les auteurs passent ensuite à des jeux de données réels exigeants : projections climatiques et réanalyses pour l’Allemagne (vitesse du vent et pression de surface), prix de cryptomonnaies et production d’électricité à partir de sources multiples en Espagne. Dans ces cas, les variantes de DeepKoopFormer sont comparées à un réseau récurrent long short-term memory (LSTM) standard et à des baselines linéaires plus simples, selon de nombreux choix de longueur de fenêtre d’entrée, d’horizon de prévision et de taille de modèle.

Ce que révèlent les expériences

Sur les tâches climatiques, financières et énergétiques, les Transformers augmentés par Koopman atteignent généralement des erreurs de prédiction plus faibles et un comportement plus stable que la baseline LSTM, en particulier pour des prévisions à de nombreux pas ou avec des données de forte dimension. Pour le vent et la pression en Allemagne, ainsi que pour la production d’électricité, les versions PatchTST et Informer de DeepKoopFormer ont tendance à donner les meilleures performances, capturant de manière fiable à la fois les tendances lentes et les fluctuations rapides. Dans certains cas particuliers où les motifs sous-jacents sont presque entièrement linéaires, une méthode linéaire très simple l’emporte encore en précision de test, ce qui souligne qu’aucun modèle n’est universellement optimal. Cependant, les architectures basées sur Koopman montrent de manière constante des profils d’erreur plus lisses à mesure que l’horizon de prévision augmente, indiquant un meilleur contrôle de l’incertitude à long terme et une moindre tendance à surajuster les détails atypiques des données d’entraînement.

Pourquoi cette approche est prometteuse

En fin de compte, DeepKoopFormer montre qu’il est possible de combiner la flexibilité de l’apprentissage profond avec les garanties de la théorie classique des systèmes dynamiques. En insérant une étape linéaire structurée et stable dans une pipeline Transformer par ailleurs standard, les auteurs obtiennent des prévisions qui sont précises, robustes au bruit et mathématiquement plus faciles à analyser. Pour les praticiens qui dépendent de prévisions à longue portée en science du climat, dans les systèmes énergétiques ou en finance — où la stabilité et l’interprétabilité sont aussi importantes que la précision brute — ce cadre offre un moyen de faire davantage confiance aux modèles neuronaux puissants, et de comprendre comment et pourquoi leurs prédictions évoluent dans le temps.

Citation: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Mots-clés: prévision de séries temporelles, modèles Transformer, opérateur de Koopman, dynamiques stables, données climatiques et énergétiques