Clear Sky Science · fr

Un cadre variationnel pour l’adaptativité basée sur le résidu dans les solveurs de PDE par réseaux neuronaux et l’apprentissage d’opérateurs

Une IA plus intelligente pour des équations difficiles

De nombreuses avancées scientifiques actuelles — de la modélisation du climat à la conception de nouveaux matériaux — reposent sur la résolution d’équations complexes décrivant l’écoulement des fluides, la propagation des ondes ou le déplacement de fronts chimiques. Les réseaux neuronaux sont récemment devenus des outils puissants pour s’attaquer à ces équations, mais ils peinent souvent lorsque la physique devient délicate : chocs nets, structures de petite taille et prédictions à long terme peuvent les faire échouer. Cet article introduit une manière systématique d’amener ces solveurs IA à concentrer leurs efforts exactement là où ils rencontrent le plus de difficultés, afin d’être à la fois plus rapides et plus précis.

Pourquoi les réseaux neuronaux ont besoin d’un guide

En apprentissage scientifique, les réseaux neuronaux sont entraînés soit pour reproduire la solution d’une équation unique (comme dans les réseaux neuronaux informés par la physique, ou PINN), soit pour apprendre une application entière des entrées vers les solutions (appelée apprentissage d’opérateurs). Dans les deux cas, le réseau est évalué par un « résidu », une mesure de la violation de l’équation sous-jacente en chaque point de l’espace et du temps. L’entraînement standard traite tous les points de la même manière, en minimisant l’erreur moyenne. Cela fonctionne pour des problèmes simples, mais pour des équations avec des gradients raides, des fronts mobiles ou des structures localisées, une faible moyenne peut masquer des erreurs graves dans des régions critiques. Les chercheurs ont répondu par des règles empiriques qui placent plus de points d’entraînement là où le résidu est grand, mais jusqu’à présent ces règles sont restées heuristiques et peu justifiées.

Une recette unifiée pour une attention adaptative

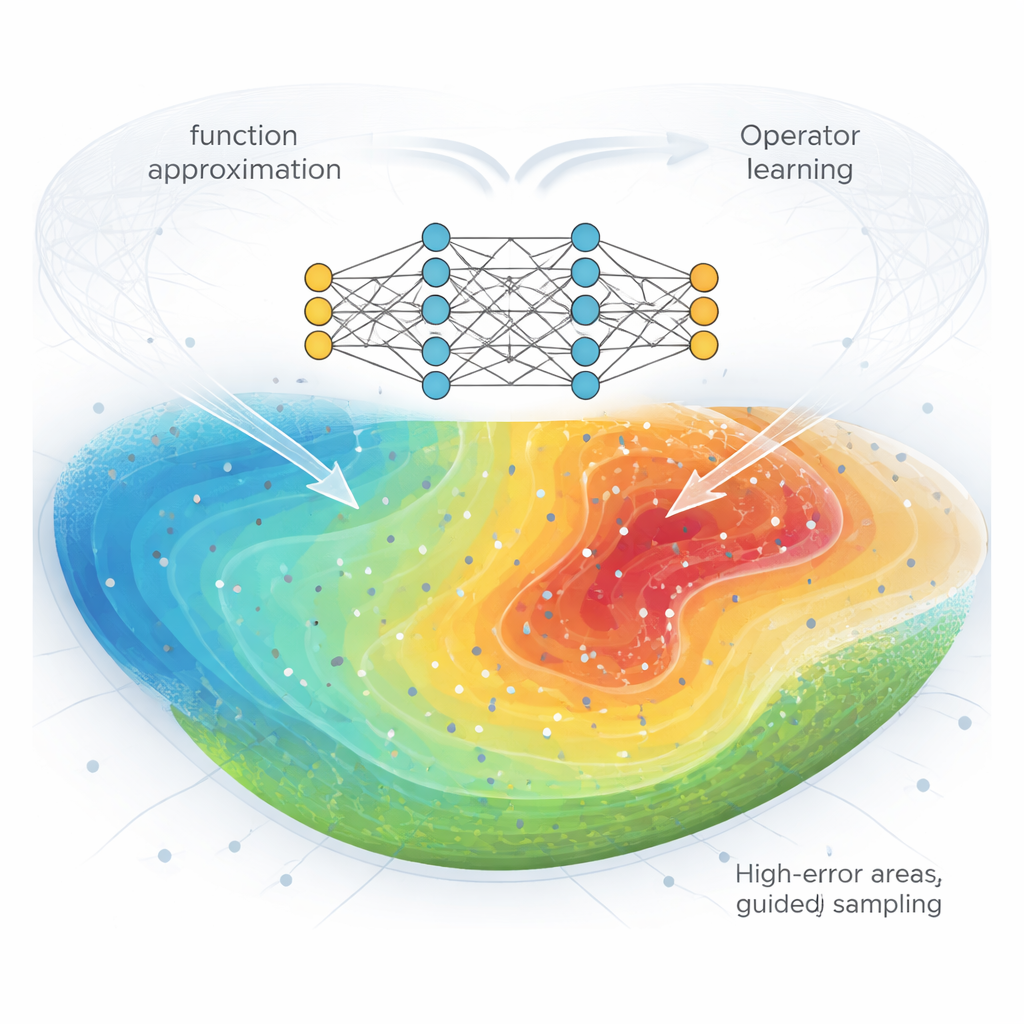

Les auteurs développent un cadre variationnel qui transforme ces heuristiques en une recette de principe. L’idée clé est de considérer l’échantillonnage et la pondération comme des choix de la distribution de probabilité sur l’espace (et sur les exemples d’entraînement) à laquelle le réseau doit accorder le plus d’attention. Ils introduisent une famille de fonctions « potentiels » qui transforment le résidu en un nouvel objectif. Différents potentiels correspondent à différentes priorités : un potentiel exponentiel pousse le réseau à réduire sa pire erreur unique, tandis qu’un potentiel quadratique met l’accent sur la réduction de la dispersion, ou de la variance, de l’erreur sur le domaine. Mathématiquement, l’optimisation de ces objectifs transformés conduit naturellement à échantillonner plus souvent les régions où le résidu actuel est élevé. La méthode résultante, appelée attention variationnelle basée sur le résidu (vRBA), englobe de nombreux schémas adaptatifs existants et fournit une voie claire pour en inventer de nouveaux.

Extension à l’apprentissage d’applications physiques complètes

Les solveurs IA modernes visent de plus en plus à apprendre non pas une seule solution mais un opérateur entier : une application des entrées telles que les conditions initiales ou les forçages vers des champs espace‑temps complets. C’est l’objectif d’architectures d’opérateurs neuronaux comme DeepONet, les Fourier Neural Operators (FNO) et les U‑Nets conditionnés dans le temps. Ici, le défi est double : il y a une variation entre différentes fonctions d’entrée et une variation dans l’espace‑temps au sein de chaque exemple. Les auteurs adaptent leur cadre à ce produit en combinant deux niveaux d’adaptivité. D’abord, ils repondèrent les points spatiaux au sein de chaque exemple pour que les zones à fort résidu comptent davantage. Ensuite, ils utilisent les résidus accumulés pour rééchantillonner préférentiellement les exemples d’entraînement les plus difficiles à apprendre. Ce schéma hybride peut être intégré directement aux modèles d’apprentissage d’opérateurs populaires sans redessiner leur architecture.

Des détails plus nets, une croissance d’erreur plus lente

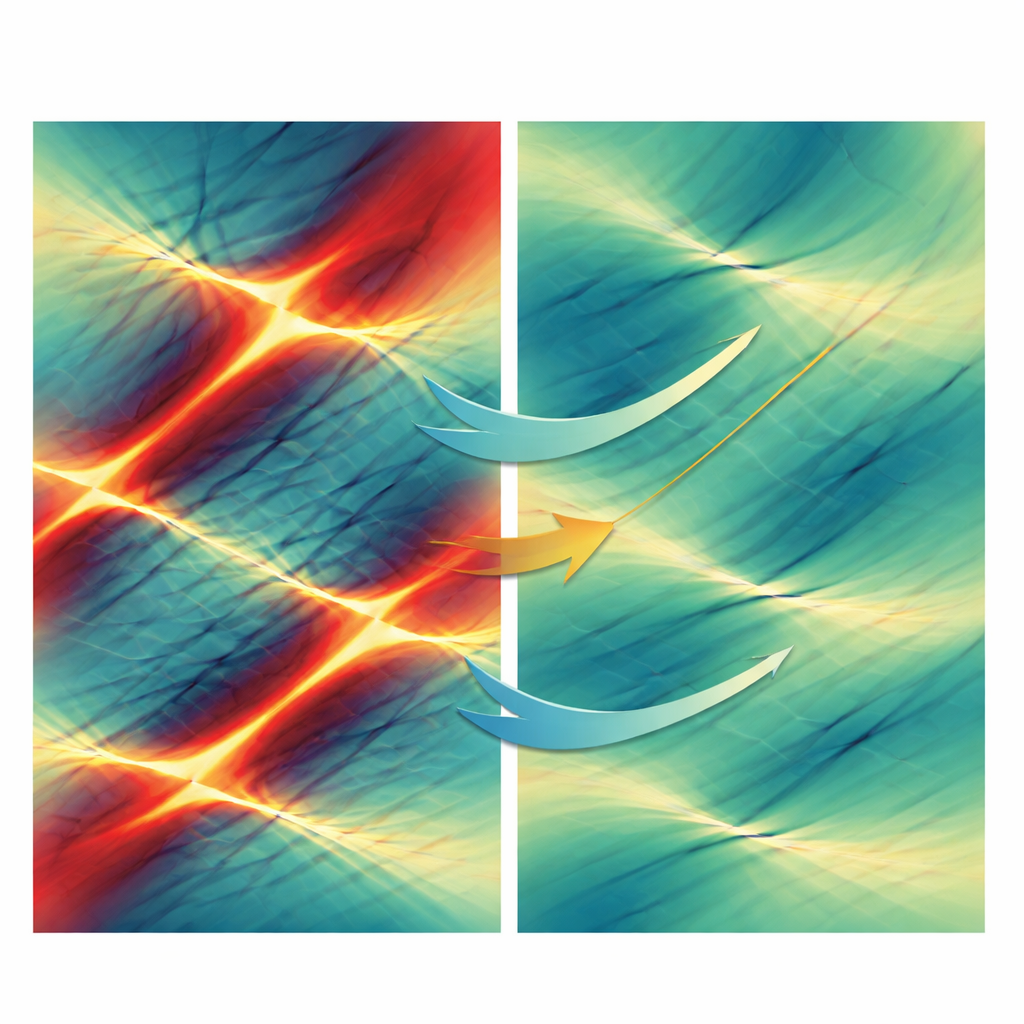

Sur un large ensemble de références, l’approche vRBA surpasse systématiquement l’entraînement traditionnel. Pour les PINN, l’équipe teste des équations non linéaires classiques telles que Allen–Cahn, Burgers et Korteweg–De Vries. Certains de ces problèmes sont connus pour mettre en échec les PINN standard, soit à cause de couches internes nettes, soit à cause d’impulsions d’ondes en interaction. Avec vRBA, les mêmes réseaux convergent plus rapidement et atteignent des erreurs significativement plus faibles, et dans les cas difficiles où la méthode de base échoue pratiquement, les méthodes adaptatives retrouvent des solutions précises. Pour l’apprentissage d’opérateurs, ils appliquent vRBA à la croissance de bulles dans des liquides, aux écoulements dans des tubes à choc haute pression, à la turbulence bidimensionnelle et à la propagation d’ondes. Ici, le principal bénéfice n’est pas seulement une meilleure erreur finale, mais une accumulation d’erreurs beaucoup plus lente dans le temps, ce qui est crucial lorsque la sortie d’un modèle est réinjectée comme entrée.

Épurer le bruit dans le signal d’apprentissage

Les auteurs attribuent ces gains à deux effets principaux. Premièrement, en modifiant la façon dont les points d’entraînement sont échantillonnés ou pondérés, vRBA réduit le bruit statistique dans la perte estimée : des lots aléatoires de points donnent une image plus fiable de la performance globale du réseau. Cela réduit directement l’erreur de discrétisation, l’écart entre l’objectif continu idéal et l’ensemble fini de points utilisé en pratique. Deuxièmement, la méthode améliore le rapport signal sur bruit des gradients qui mènent l’apprentissage, de sorte que différentes régions du domaine « s’accordent » davantage sur la direction dans laquelle doivent évoluer les paramètres. En conséquence, les réseaux sortent beaucoup plus tôt des phases d’entraînement lentes et indécises et entrent dans un régime où l’erreur décroît rapidement. Le cadre clarifie aussi quand les stratégies agressives — celles qui punissent fortement les plus grands résidus — peuvent aider et quand elles risquent de déstabiliser l’entraînement.

Ce que cela signifie pour l’IA scientifique à venir

Pour les non‑experts, le message est que porter une attention plus intelligente aux endroits où un solveur IA se trompe peut en faire un outil bien plus fiable pour la science et l’ingénierie. Plutôt que de s’appuyer sur des règles par essais‑et‑erreurs, ce travail propose une feuille de route mathématique pour orienter les réseaux neuronaux vers les parties les plus informatives d’un problème, qu’il s’agisse de fronts de choc, de fines oscillations ou de comportements à long terme. À mesure que les modèles scientifiques deviennent plus grands et sont utilisés dans des contextes critiques pour la sécurité, de telles stratégies de principe pour réduire l’erreur et stabiliser l’apprentissage seront essentielles pour transformer des réseaux neuronaux puissants en instruments scientifiques fiables.

Citation: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Mots-clés: réseaux neuronaux informés par la physique, apprentissage d’opérateurs, échantillonnage adaptatif, apprentissage automatique scientifique, équations aux dérivées partielles