Clear Sky Science · fr

Agent IA en santé : applications, évaluations et orientations futures

Pourquoi les assistants numériques intelligents en médecine comptent

Les hôpitaux sont submergés de données, les médecins sont surchargés et les patients veulent des réponses plus claires sur leur santé. Un nouveau type d’intelligence artificielle, basé sur des grands modèles de langage capables de lire et d’écrire comme des humains, est désormais transformé en « agents IA » capables de raisonner sur des tâches à étapes multiples. Cet article de synthèse explique comment ces assistants numériques commencent à aider au diagnostic, aux décisions thérapeutiques, à la gestion administrative, aux conversations avec les patients et même à la formation médicale — tout en soulignant ce qu’il faut faire pour garantir leur exactitude, leur équité et leur sécurité.

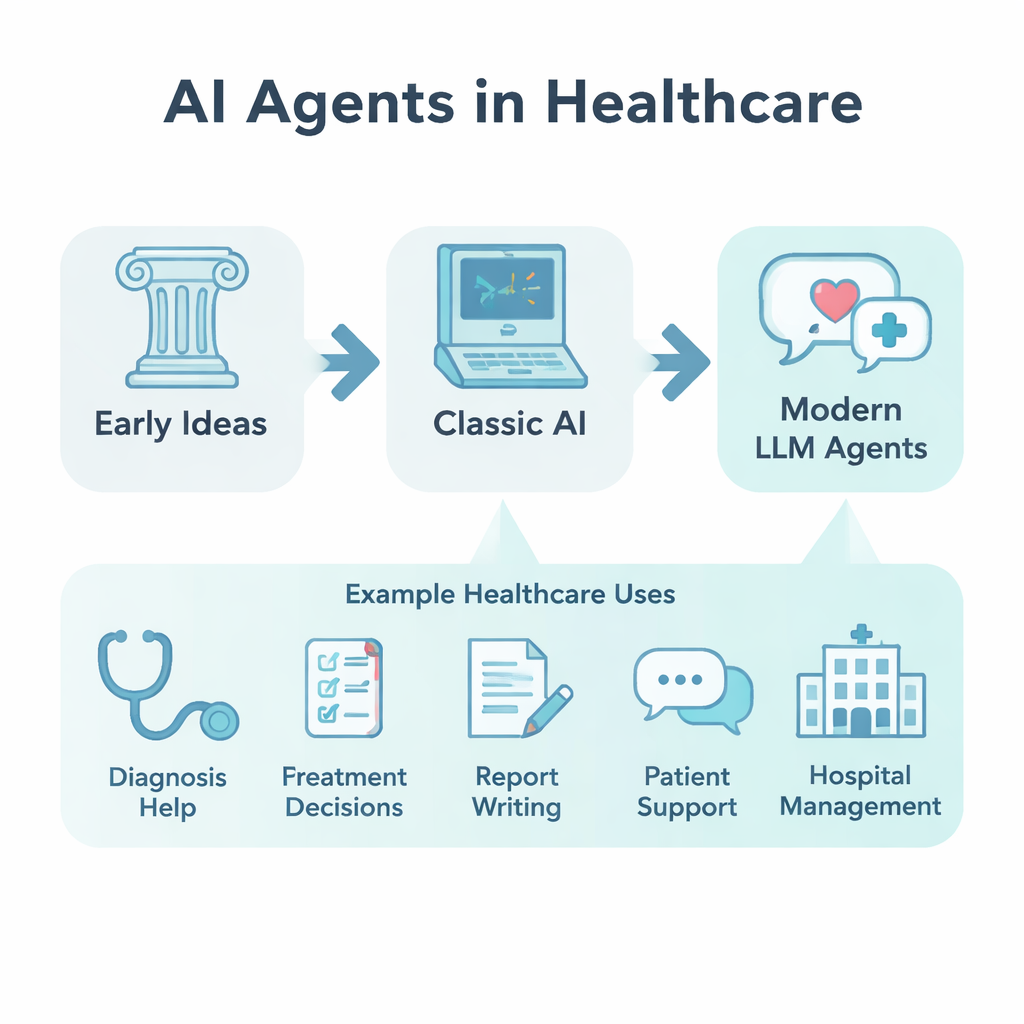

Des expériences de pensée aux collègues numériques pratiques

L’idée d’un « agent » pouvant agir avec des buts et des intentions remonte à la philosophie ancienne. Les versions modernes sont apparues avec l’intelligence artificielle initiale, les systèmes experts, puis l’apprentissage automatique et profond, qui ont permis aux ordinateurs d’apprendre des motifs à partir de données. La percée des grands modèles de langage (LLM) après 2022 a fait évoluer les choses : au lieu de se contenter de répondre à des questions, ces modèles peuvent désormais planifier, se souvenir d’étapes précédentes et appeler d’autres outils logiciels. En santé, cela signifie qu’un agent IA peut lire des dossiers médicaux, consulter des lignes directrices, rédiger des notes et proposer des actions suivantes, se comportant moins comme un moteur de recherche et davantage comme un collègue numérique junior.

Ce qui différencie ces agents de l’IA ordinaire

Selon la définition adoptée dans l’article, un agent IA en santé est plus qu’un modèle isolé. Il a un LLM en son cœur, entouré de quatre capacités clés : planification, mémoire, utilisation d’outils et autoréflexion. La planification lui permet de décomposer une tâche médicale complexe en étapes plus petites. La mémoire lui permet de suivre l’histoire d’un patient ou un long processus décisionnel. L’utilisation d’outils signifie qu’il peut, par exemple, extraire des résultats de laboratoire d’un dossier électronique ou interroger une base de données médicale. Les modules d’autoréflexion vérifient et révisent ses propres réponses. Associées à de solides compétences linguistiques et à une capacité croissante de raisonnement logique, ces aptitudes rendent les agents suffisamment flexibles pour passer d’une tâche ou d’une spécialité médicale à une autre.

Comment les agents IA sont testés dans le travail clinique réel

Les chercheurs construisent et simulent aujourd’hui de nombreux types d’agents pour déterminer où ils sont les plus utiles. Certains sont conçus pour soutenir le diagnostic en simulant des conversations entre médecins virtuels et patients, ou en faisant débattre plusieurs agents spécialistes d’un cas difficile. D’autres se concentrent sur les décisions thérapeutiques, en combinant les apports de généralistes virtuels, de spécialistes et de pharmaciens pour parvenir à un plan partagé. Il existe des agents qui rédigent des rapports de radiologie à partir de radiographies thoraciques, ou qui traduisent des résultats techniques en un langage simple et accessible aux patients. Des systèmes de type chatbot sont testés pour le soutien en santé mentale, le coaching pour la perte de poids et les rappels de médication. D’autres agents aident à gérer les prescriptions, repérer les effets indésirables, rationnaliser les dossiers électroniques ou former les étudiants en médecine avec des patients simulés réalistes.

Évaluer si ces systèmes sont prêts pour les patients

Parce que les erreurs en médecine peuvent être mortelles, la revue soutient que les agents IA doivent être évalués sur plus que leur ingéniosité. Les auteurs regroupent les tests en deux niveaux. Les vérifications de base posent ces questions : les réponses sont-elles factuellement correctes ? La formulation correspond-elle aux rapports d’experts ? L’agent accomplit-il de manière fiable la tâche, y compris en appelant les outils appropriés ? Les vérifications axées sur le développement examinent la rapidité, la clarté et la qualité de la communication avec les personnes, incluant le respect, l’empathie et l’équité entre différents groupes de patients. Les études comparent les agents tant avec d’autres modèles de langage de pointe qu’avec des médecins humains, et les régulateurs en Europe, au Royaume-Uni, en Chine et ailleurs commencent à concevoir des programmes officiels de « bac à sable » pour tester la sécurité, l’équité et le bénéfice clinique avant le déploiement.

Prochaines étapes : robots, règles et confiance humaine

Pour l’avenir, l’article met en avant sept priorités : connecter les agents à des robots physiques capables d’agir dans le monde réel ; combiner des modèles à usage général avec des modèles experts plus petits ; élargir l’évaluation pour inclure les coûts, les événements de sécurité et la satisfaction des patients ; renforcer les sauvegardes et la supervision ; intégrer des protections éthiques et de confidentialité ; concevoir pour la confiance des utilisateurs et un retour continu ; et aider le personnel médical à adapter leur carrière pour travailler aux côtés de l’IA plutôt que d’être remplacé. Les auteurs concluent que les agents IA pourraient devenir des partenaires puissants en santé, mais seulement s’ils sont développés, testés et gouvernés avec le même niveau de soin que celui que la société exige pour toute nouvelle technologie médicale.

Citation: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Mots-clés: Agents IA en santé, grands modèles de langage, soutien à la décision clinique, chatbots médicaux, santé numérique