Clear Sky Science · fr

Dans leurs propres mots : études de cas sur le langage des adolescents sur smartphone précédant des hospitalisations liées au suicide

Pourquoi les textos de votre ado peuvent compter plus que vous ne le pensez

À mesure que les smartphones deviennent des compagnons constants, ils enregistrent discrètement les mots, humeurs et préoccupations quotidiens des jeunes. Cette étude pose une question urgente : le langage que les adolescents tapent sur leur téléphone, dans les semaines et les jours qui précèdent une crise de santé mentale, peut‑il révéler quand ils sont en danger sérieux de tenter de se suicider ? En examinant des modèles réels de textos provenant d’adolescents à haut risque, les chercheurs évaluent si des outils d’intelligence artificielle peuvent aider les cliniciens à repérer des signes d’alerte à court terme — et où ces outils montrent encore leurs limites.

Suivre cinq adolescents pendant un mois dangereux

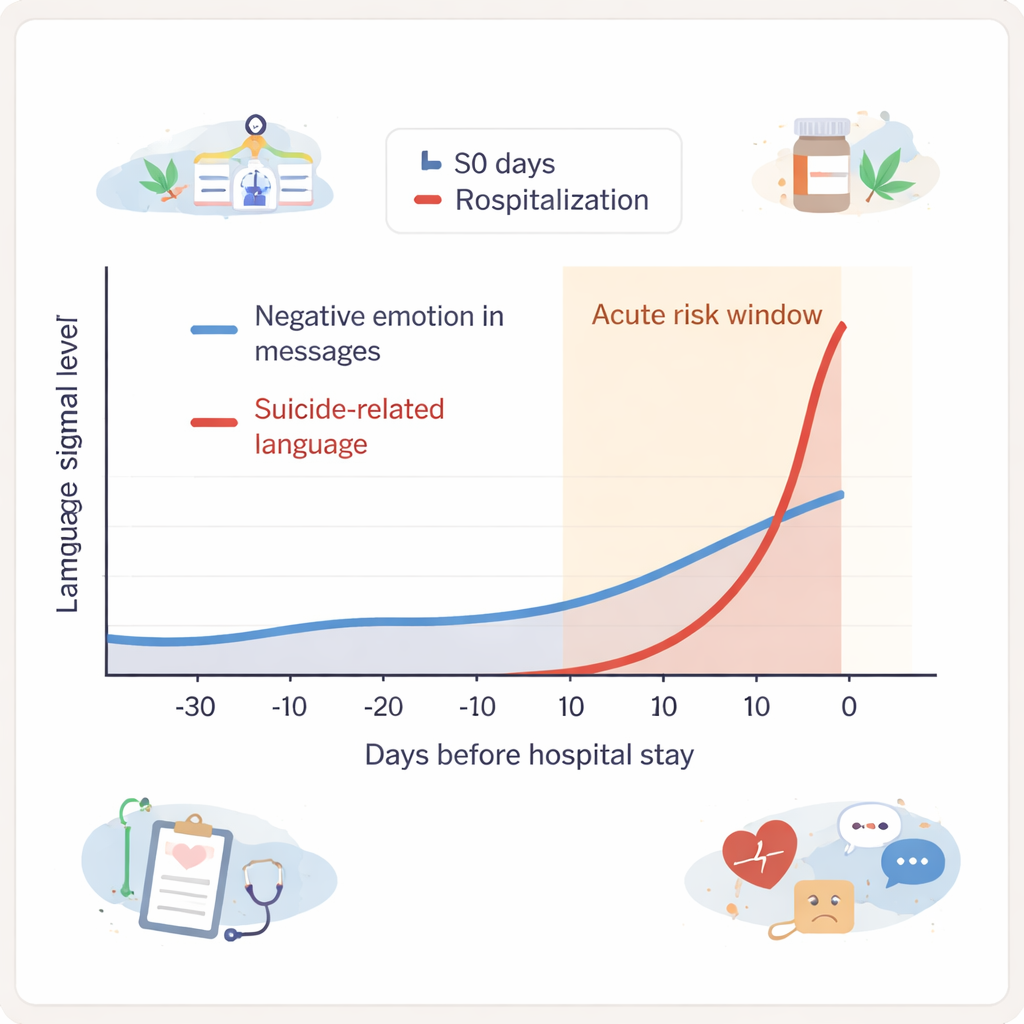

L’étude s’est concentrée sur cinq adolescents déjà considérés à haut risque de suicide et qui ont ensuite été hospitalisés pour des raisons liées au suicide. Pendant environ six mois, une application silencieuse installée sur leurs propres téléphones a enregistré tout ce qu’ils tapaient au clavier — messages, recherches, notes — en excluant ce que les autres leur envoyaient. En moyenne, plus de 21 000 entrées textuelles sortantes par adolescent ont été collectées et fortement dé‑identifiées pour protéger la vie privée. Les chercheurs ont ensuite zoomé sur les 30 jours précédant chaque hospitalisation, divisant cette période en une phase « de référence » de 20 jours et une phase de « risque aigu » de 10 jours juste avant l’hospitalisation.

Ce que les mots ont révélé avant la crise

En utilisant le traitement automatique du langage naturel (TALN), l’équipe a recherché plusieurs types de signaux dans les textes tapés. Un ensemble d’outils cherchait le langage lié au suicide, en s’appuyant sur un dictionnaire orienté jeunesse qui reconnaissait non seulement les expressions standard mais aussi l’argot et les emojis. Un autre outil, basé sur des modèles d’IA modernes, estimait si les messages exprimaient des émotions négatives. Une troisième méthode regroupait les messages en grands thèmes, tels que l’école, le traitement, le sommeil, la consommation de substances ou la mort. Pour quatre des cinq adolescents, le langage lié au suicide et l’émotion négative avaient augmenté dans les 10 jours précédant l’hospitalisation, par rapport au schéma moyen de chaque adolescent sur l’ensemble de l’étude. Le langage lié au suicide bondissait souvent de façon marquée dans les cinq derniers jours, tandis que l’émotion négative augmentait plus graduellement sur les 10 derniers jours.

Signaux de risque — et signaux de détresse

Les motifs étaient prometteurs mais complexes. Les mêmes signes d’alerte — langage suicidaire et tonalité sombre — apparaissaient aussi à d’autres moments en dehors de la fenêtre de crise immédiate. Cela suggère que ces signaux peuvent marquer des périodes de détresse importante, mais pas toujours des moments où une tentative de suicide est imminente. Lorsque des cliniciens ont examiné directement les historiques de texte, ils ont constaté que les pics de langage lié au suicide coïncidaient souvent avec des pensées suicidaires, des tentatives réelles ou des appels à l’aide urgents. Les modèles de sujet ont détecté des thèmes utiles comme la consommation de substances et les discussions sur le traitement, qui coïncidaient parfois avec des moments à risque.

Ce que les ordinateurs manquent et que les humains voient

Cependant, les outils d’IA ont fréquemment manqué des problèmes que les cliniciens jugeaient déclencheurs centraux, tels que des disputes avec des amis ou la famille, le harcèlement, des conflits amoureux ou des sentiments de rejet. Ces situations se déroulaient sur de nombreux messages courts, et les modèles traitaient majoritairement chaque entrée isolément, sans comprendre l’ensemble de l’histoire. En conséquence, les conflits interpersonnels, les changements dans la manière dont les adolescents percevaient des événements clés, ou les glissements subtils du ton — de plaisanteries sur le suicide à l’expression d’un désespoir authentique — échappaient souvent aux algorithmes. Les chercheurs soutiennent que les systèmes futurs doivent faire plus que lire des messages individuels : ils doivent relier les conversations dans le temps et, idéalement, combiner le texte avec d’autres données passives comme les habitudes de sommeil ou les mouvements pour améliorer la précision.

Perspectives : des promesses avec des limites importantes

Ce travail montre que le langage sur smartphone peut offrir une fenêtre riche et peu contraignante sur ce que vivent les adolescents entre deux rendez‑vous cliniques. Les méthodes automatisées identifient déjà assez bien les signaux d’alerte évidents — discours suicidaire direct et émotion fortement négative — surtout dans les jours précédant une crise. Mais elles sont beaucoup moins aptes à saisir le contexte personnel, social et situationnel que les cliniciens utilisent pour évaluer le risque. Pour les familles et les professionnels de santé, le message est double : les données linguistiques numériques pourraient un jour aider à fournir un soutien précoce et opportun aux jeunes en danger, mais elles doivent être développées avec beaucoup de précautions, de solides protections de la vie privée et en partenariat avec les cliniciens, et non pour les remplacer.

Citation: Treves, I.N., Bloom, P.A., Salem, S. et al. In their own words: case studies of adolescent smartphone language preceding suicide-related hospitalizations. NPP—Digit Psychiatry Neurosci 4, 5 (2026). https://doi.org/10.1038/s44277-026-00057-0

Mots-clés: risque de suicide chez l'adolescent, langage sur smartphone, phénotypage numérique, traitement automatique du langage naturel, surveillance de la santé mentale