Clear Sky Science · fr

Analyse de l’équité des prédictions par apprentissage automatique de l’agressivité en soins psychiatriques aigus

Pourquoi cela compte pour des personnes réelles

Les hôpitaux se tournent vers l’intelligence artificielle pour repérer quels patients pourraient devenir agressifs, dans l’espoir de prévenir les dommages sans recourir à des contraintes traumatisantes. Mais si ces outils prédictifs sont injustes, ils peuvent aggraver les inégalités qui déterminent déjà qui est perçu comme « dangereux ». Cette étude pose une question pressante : lorsqu’une machine aide à décider qui est à haut risque dans une unité psychiatrique, traite‑t‑elle tous les patients de la même façon ?

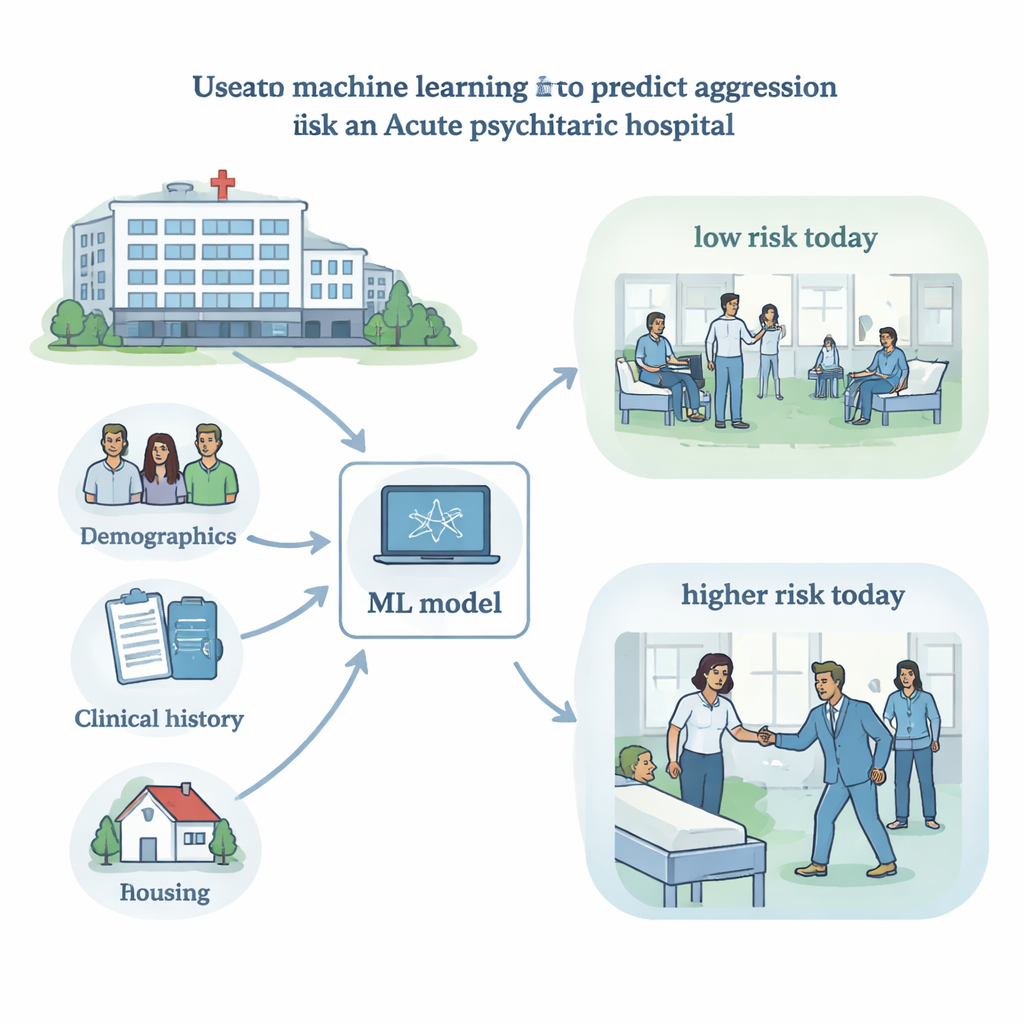

Utiliser les données hospitalières pour signaler le risque à court terme

Les chercheurs ont analysé les dossiers de plus de 17 000 patients pris en charge dans des unités psychiatriques aiguës d’un grand hôpital psychiatrique canadien entre 2016 et 2022. Pour chacun des jusqu’à trois jours d’un séjour, le personnel a rempli une liste de contrôle standard au chevet appelée Dynamic Appraisal of Situational Aggression (DASA), qui évalue des comportements comme l’irritabilité ou les menaces verbales pouvant annoncer une agressivité imminente. L’équipe a combiné ces scores avec des informations recueillies à l’admission — diagnostic, âge, sexe, race ou origine ethnique, situation de logement et mode d’arrivée à l’hôpital — pour entraîner un modèle d’apprentissage automatique visant à prédire si le patient serait impliqué dans un incident agressif (y compris l’utilisation de contraintes ou d’isolement) dans les 24 heures suivantes.

Performance globale de l’outil de prédiction

Le système le plus performant utilisait une méthode d’apprentissage populaire appelée forêt aléatoire (random forest). Sur des données de test tenues à l’écart, il a correctement classé les jours à plus haut risque la plupart du temps, atteignant une « aire sous la courbe » d’environ 0,81, comparable à des outils similaires en psychiatrie. Cependant, l’agressivité était rare : il y avait environ 33 jours sans incident pour chaque jour avec incident — le modèle manquait donc encore de nombreux événements réels et produisait quelques fausses alertes. Les mesures d’importance ont montré que les facteurs cliniques moment‑par‑moment, en particulier les items DASA comme l’irritabilité et les incidents récents, contribuaient le plus aux prédictions, plutôt que les seules variables démographiques. Cela signifie que le modèle détectait des signaux cliniquement pertinents, mais les métriques de performance seules ne révélaient pas s’il était également fiable pour tout le monde.

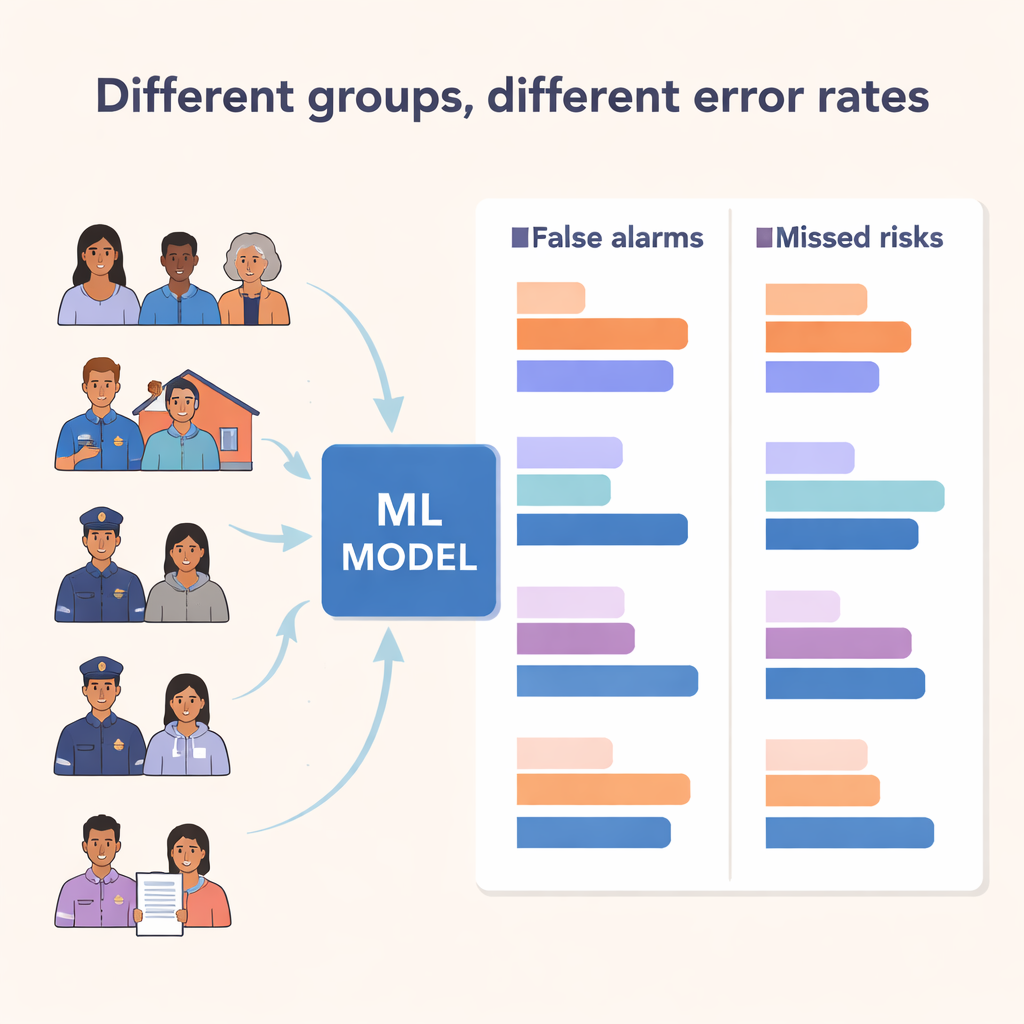

Erreurs inégales selon les groupes

Le cœur de l’étude était un contrôle d’équité. L’équipe s’est concentrée sur deux types d’erreurs : les faux positifs, lorsque le modèle signale un risque mais qu’il ne se passe rien, et les vrais positifs, lorsqu’il anticipe correctement un incident. Un modèle équitable, selon une norme couramment utilisée appelée « equalized odds », devrait avoir des taux de faux positifs et de vrais positifs similaires entre les groupes. Au lieu de cela, les chercheurs ont constaté de larges différences. Les faux positifs étaient plus fréquents pour les patients d’origine moyen‑orientale et noire, les hommes, les personnes amenées à l’hôpital par la police et celles sans logement ou en logement de soutien. Certains groupes — comme les patients admis par la police ou ceux en situation d’instabilité du logement — présentaient à la fois des taux de détection plus élevés et davantage de fausses alertes, ce qui suggère que le modèle était réglé pour être particulièrement sensible à leur égard. D’autres, comme les patients noirs, subissaient une combinaison préoccupante : plus de fausses alertes et une moindre capacité à identifier correctement le risque réel.

Quand les identités se croisent, les écarts se creusent

Parce que l’expérience des personnes est façonnée par plusieurs caractéristiques simultanément, les chercheurs ont aussi examiné les identités croisées, en particulier la combinaison de la race ou de l’origine ethnique et du sexe. Ici, le signal d’alarme le plus net est apparu pour les hommes d’origine moyen‑orientale, qui présentaient le taux de faux positifs le plus élevé de tous les groupes, alors que les femmes moyen‑orientales ne le faisaient pas. Les hommes noirs et autochtones faisaient également face à des faux positifs plus élevés que les femmes de la même origine. Ces schémas résonnent avec des inégalités bien documentées dans les soins de santé mentale, comme des taux plus élevés d’intervention policière, d’admission involontaire et de mauvais diagnostics chez certains groupes racialisés et chez les hommes. Le système d’apprentissage automatique n’a pas créé ces inégalités, mais il a appris à partir de données imprégnées de celles‑ci — et risquait de les amplifier dans les décisions cliniques.

Ce que cela signifie pour l’avenir de l’IA en psychiatrie

Les auteurs soutiennent que l’analyse d’équité doit être considérée comme un contrôle de sécurité essentiel, et non comme un supplément optionnel, avant de déployer tout outil prédictif. Ils notent que des méthodes techniques de « débiaisement » — comme ajuster les données d’entraînement ou fixer des seuils d’alerte différents selon les groupes — peuvent aider, mais restent limitées si les dossiers sous‑jacents reflètent déjà des traitements inégaux et des pratiques coercitives. En fin de compte, décider ce qu’est un modèle « équitable » n’est pas qu’un problème mathématique : c’est une question sociale et éthique qui nécessite la participation des patients, des cliniciens et des communautés. Cette étude montre que, si l’apprentissage automatique peut aider à identifier le risque d’agressivité à court terme, il peut aussi reproduire silencieusement le racisme structurel, le sexisme et les inégalités liées au logement, à moins que l’équité ne soit mesurée, débattue et traitée de manière rigoureuse.

Citation: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Mots-clés: équité algorithmique, agressivité psychiatrique, apprentissage automatique en santé, inéquités en santé, modèles de prédiction du risque