Clear Sky Science · fr

Tous les yeux, pas d’IMU : apprendre l’attitude de vol uniquement par la vision

Voir comme un insecte

Les petits robots volants s’appuient généralement sur de minuscules capteurs de mouvement pour rester droits, un peu comme un système vestibulaire pour les machines. Mais les insectes parviennent à des vols agiles avec du matériel beaucoup plus simple, en s’appuyant largement sur ce qu’ils voient. Cette étude montre qu’un drone peut faire quelque chose de similaire : voler de façon stable en n’utilisant qu’un type particulier de caméra et un petit cerveau artificiel, sans les capteurs de mouvement habituels. Ce changement pourrait rendre les futurs drones de la taille d’une paume ou d’un insecte plus légers, moins coûteux et plus robustes.

Pourquoi se passer des capteurs habituels ?

Le contrôle de l’attitude — maintenir un drone correctement incliné par rapport à la gravité — est normalement assuré par une unité embarquée qui mesure l’accélération et la rotation. Ces capteurs inertiels fonctionnent bien, mais ils ajoutent du poids, consomment de l’énergie et peuvent constituer un point de défaillance unique. En revanche, de nombreux insectes volants n’ont pas de capteur de gravité dédié et extraient plutôt des indices sur leur inclinaison à partir du mouvement du monde à travers leurs yeux. Si les robots pouvaient imiter cette astuce, les très petits appareils pourraient n’avoir besoin que de la vision pour voir et se stabiliser, simplifiant leur conception et facilitant leur miniaturisation jusqu’à l’échelle des insectes.

Une caméra qui ne voit que le changement

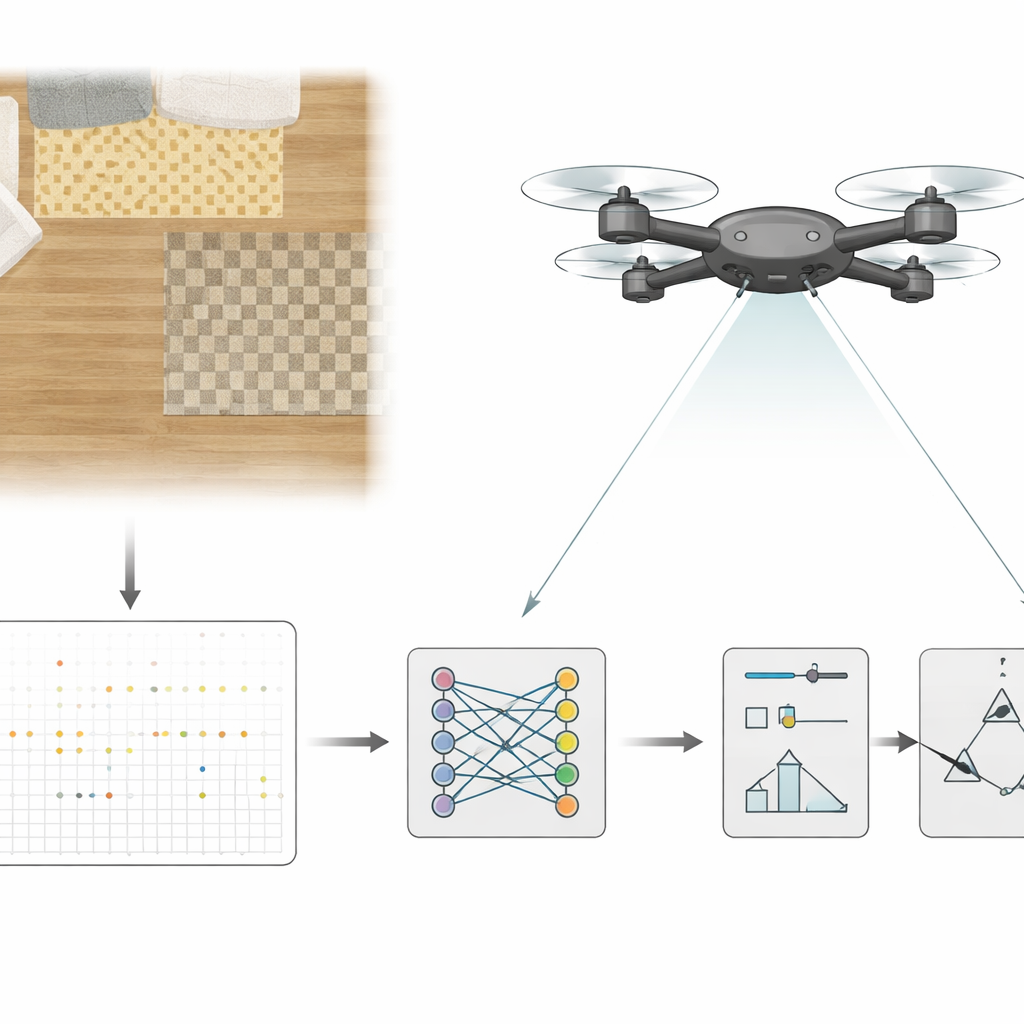

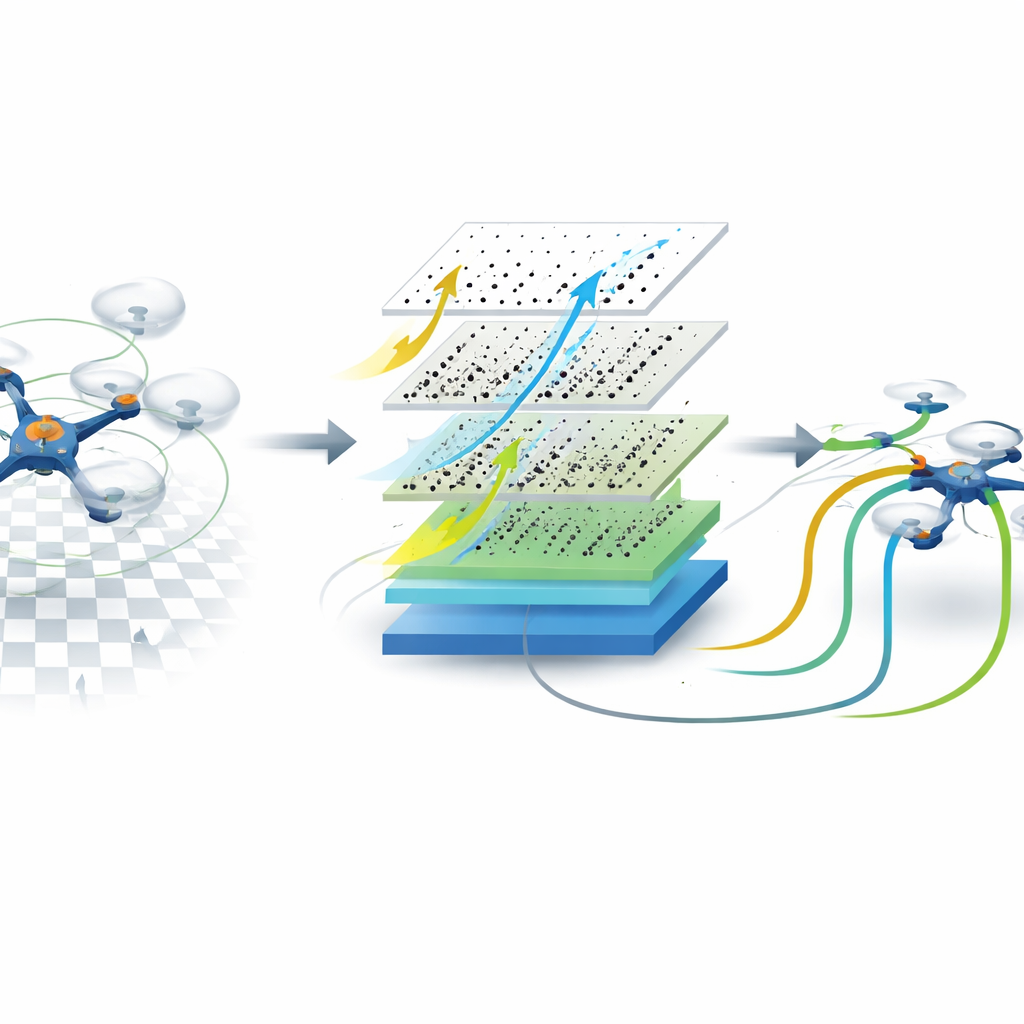

Plutôt qu’une caméra vidéo standard, les chercheurs utilisent une caméra événementielle orientée vers le sol depuis le drone. Au lieu d’envoyer des images complètes à intervalles fixes, ce capteur rapporte seulement de minuscules variations de luminosité à chaque pixel, et il le fait de façon extrêmement rapide. Le flux d’événements est regroupé en tranches brèves, chacune couvrant seulement cinq millièmes de seconde, et ces tranches sont fournies à un petit réseau neuronal convolutionnel récurrent exécuté sur une puce graphique embarquée. Au fil du temps, le réseau apprend à convertir des motifs de changement visuel en estimations de l’inclinaison du drone et de sa vitesse de rotation, remplaçant ainsi l’unité de mouvement traditionnelle dans la boucle de contrôle.

Apprendre à un drone à se stabiliser uniquement par la vision

Pour entraîner ce cerveau artificiel, l’équipe a d’abord fait voler son quadrirotor dans une arène intérieure tout en utilisant encore un ensemble de capteurs conventionnels. Pendant ces vols, ils ont enregistré le flux d’événements de la caméra ainsi que les valeurs d’inclinaison et de rotation estimées par le contrôleur standard. Ils ont ensuite entraîné le réseau, en supervision, pour reproduire ces valeurs à partir des seules données visuelles. Lors des tests ultérieurs, les rôles ont été inversés : le drone a volé avec les estimations du réseau bouclant la commande, tandis que des systèmes de capture de mouvement indépendants ou des mesures embarquées servaient uniquement à évaluer ses performances. Le système a maintenu le drone en stationnaire et a suivi des trajectoires commandées par le pilote pendant des minutes d’affilée, avec la plupart des erreurs d’inclinaison dans quelques degrés et des erreurs de rotation dans des limites modestes, suffisantes pour un vol stable.

Explorer la compétence visuelle apprise

Les chercheurs ont examiné ce qui rend ce contrôle uniquement visuel le plus efficace. Ils ont comparé différentes architectures de réseau, ajouté ou retiré des entrées supplémentaires telles que les vitesses des moteurs ou les signaux gyroscopiques, et varié la portion du champ de vision de la caméra utilisée. Les réseaux avec mémoire — capables d’intégrer l’information visuelle dans le temps — se sont révélés cruciaux pour suivre avec précision des rotations rapides, tandis que les versions sans mémoire ont peiné. Un large champ de vision, qui expose des indices d’horizon lointains aux bords de l’image, donnait les erreurs brutes les plus faibles dans des scènes familières. Fait surprenant, contraindre le réseau à ne regarder que la partie centrale de l’image, où ces indices statiques sont absents, l’a rendu plus dépendant des motifs de mouvement plutôt que de l’apparence de la scène. Bien que cela ait réduit la précision absolue, cela a amélioré la façon dont le système s’adaptait quand il était transféré vers des environnements très différents, suggérant qu’un sens interne du mouvement était en train d’être appris.

Vers de minuscules robots volants axés sur la vision

Globalement, ce travail montre qu’un drone peut se maintenir droit et rester contrôlable en n’utilisant que ce qu’il voit, sans capteur inertiel dans la boucle. En associant une caméra événementielle à un réseau neuronal compact, le système atteint la vitesse et la réactivité nécessaires au contrôle en temps réel tout en réduisant le poids et la complexité matérielle. Pour le lecteur non spécialiste, le message principal est que de futures essaims de petits robots volants, semblables à des insectes, pourraient s’équilibrer et se diriger en n’utilisant qu’un seul œil intelligent, comme le font les insectes, ouvrant la voie à des machines plus légères, plus économes en énergie et capables d’explorer en sécurité des espaces encombrés et imprévisibles.

Citation: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Mots-clés: commande de vol basée sur la vision, drones à caméra événementielle, robotique inspirée du vivant, contrôleurs par réseau de neurones, UAV à l’échelle des insectes