Clear Sky Science · fr

Piégeage acoustique en temps réel facilité par l’apprentissage automatique dans des environnements multi-milieux variables dans le temps en vue de la manipulation de microbulles guidée par imagerie par résonance magnétique

Guider de minuscules transporteurs de médicaments avec le son et l’imagerie

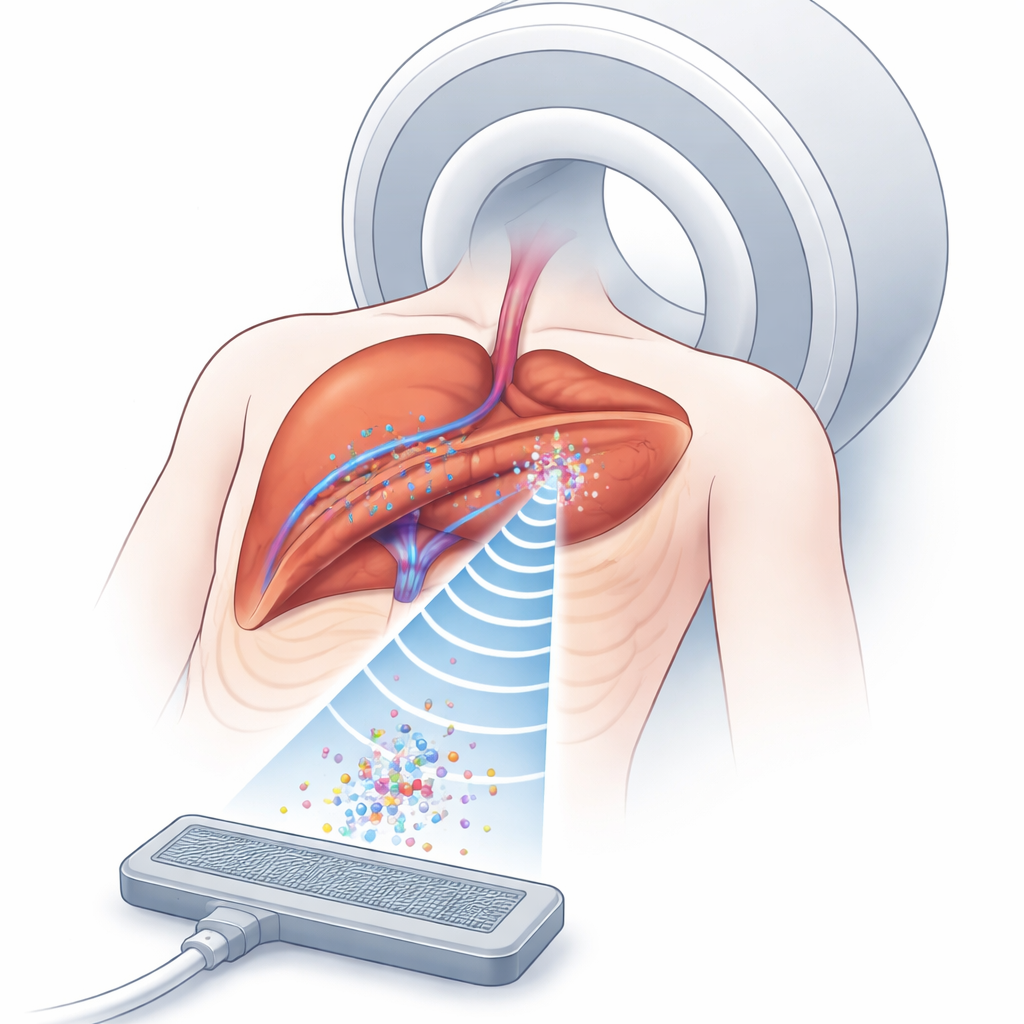

Les traitements anticancéreux modernes reposent de plus en plus sur des transporteurs intelligents capables d’apporter le médicament directement aux tumeurs tout en épargnant les tissus sains. Cette étude explore une méthode futuriste pour diriger ces transporteurs à l’intérieur du corps à l’aide de « pièges » ultrasonores guidés par l’imagerie par résonance magnétique (IRM). En combinant ondes sonores, imagerie médicale et apprentissage automatique, les auteurs cherchent à maintenir des bulles microscopiques chargées de médicament à proximité de tumeurs mobiles, même lorsque le corps se déplace à chaque respiration.

Pourquoi le piégeage de microbulles est important

Les microbulles transportant des médicaments circulent dans les vaisseaux sanguins et peuvent libérer leur charge lorsqu’elles sont déclenchées par des ultrasons. Le défi consiste à maintenir suffisamment de ces bulles au bon endroit, pendant suffisamment longtemps, en profondeur dans le corps. L’ultrason peut créer des poches invisibles de force — des pièges acoustiques — qui maintiennent de petits objets en suspension dans un fluide sans contact. L’IRM, quant à elle, peut visualiser à la fois les tissus et le profil des effets ultrasonores, même à l’intérieur des organes. Associer ces deux outils offre un moyen de concentrer les transporteurs de médicament autour des tumeurs avec une précision supérieure à celle des seuls agents pharmacologiques. Mais chez les personnes réelles, des tissus de types variés — graisse, muscle, organes et poumons en mouvement — réfractent et déforment les ondes sonores, rendant très difficile la création et le maintien d’un piège stable exactement au niveau de la tumeur.

Le problème d’un corps mobile et stratifié

Dans des milieux simples comme l’air ou l’eau, les ingénieurs savent déjà utiliser des réseaux d’émetteurs ultrasonores à phases commandées pour pousser, attirer ou faire tourner de petits objets. À l’intérieur du corps, toutefois, le son doit traverser plusieurs couches aux densités et vitesses différentes, et les interfaces entre elles causent réfraction et distorsion. Les méthodes de calcul traditionnelles peuvent, en principe, corriger cela en calculant le temps de trajet du son entre chaque émetteur et le point cible. Mais ces approches découpent le corps en millions de petits blocs et simulent la propagation d’ondes à travers chacun — un processus extrêmement long qui ne fonctionne que si les tissus restent presque parfaitement immobiles. La respiration seule peut déplacer les tissus abdominaux de plusieurs millimètres, rendant rapidement toute solution pré-calculée obsolète.

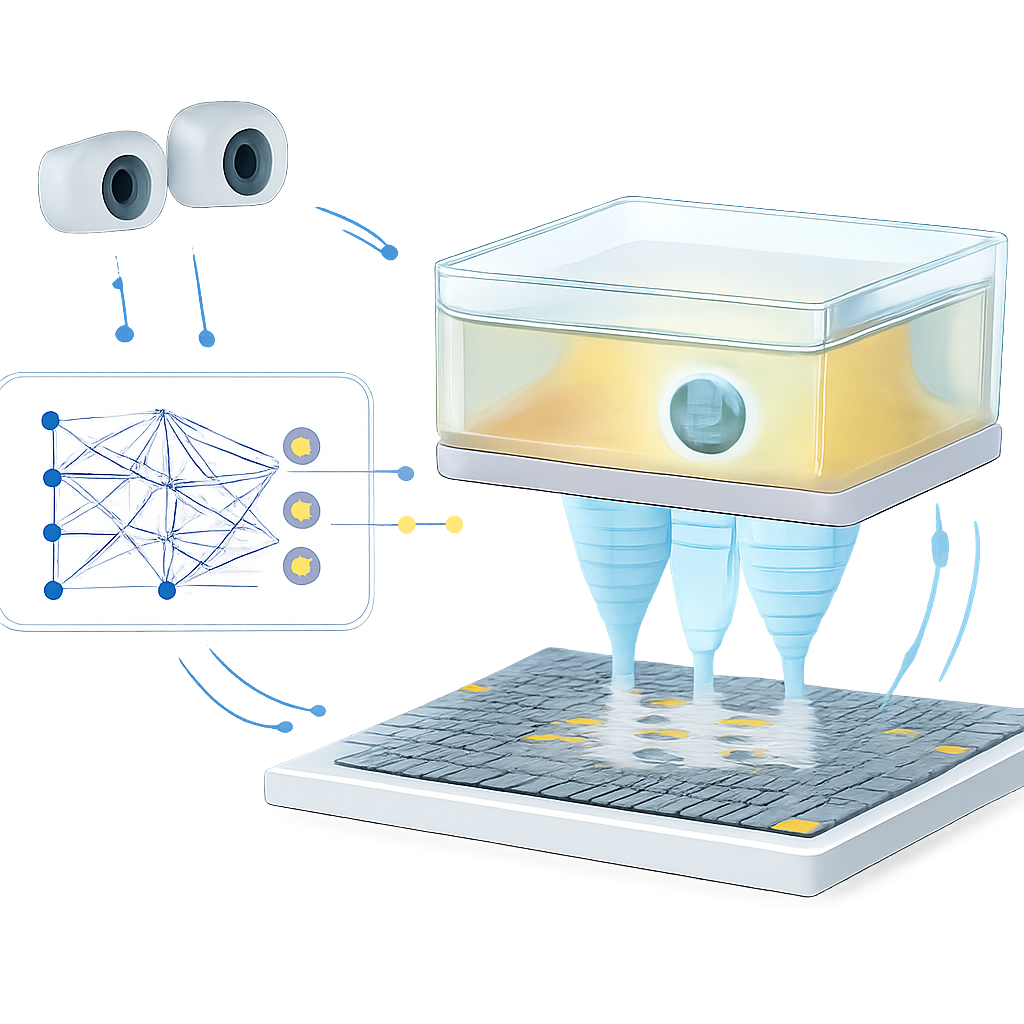

Apprendre à un modèle à prédire les trajectoires du son

Les auteurs s’attaquent à ce goulot d’étranglement en proposant un modèle basé sur l’apprentissage qui sert de raccourci rapide : au lieu de simuler les ondes sonores à chaque fois, ils entraînent un réseau de neurones à prédire combien de temps chaque impulsion ultrasonore mettra pour atteindre un point cible. Ils construisent d’abord un environnement virtuel détaillé utilisant une chambre remplie de gaz séparée de l’air par un film plastique fin, reproduisant la façon dont le son traverse différentes couches tissulaires. À l’aide d’un simulateur physique, ils génèrent un jeu d’entraînement de temps de trajet du son entre de nombreux points cibles et une matrice ultrasonore de 14 sur 14. Ils laissent aussi la chambre se déplacer dans deux directions pour imiter le mouvement, et décrivent sa position en suivant trois marqueurs visuels, de la même manière que de futurs marqueurs visibles à l’IRM suivraient la respiration d’un patient. Le réseau entraîné apprend à mapper directement la position de piégeage souhaitée et la pose de la chambre au motif temporel requis pour les 196 émetteurs, atteignant une précision à l’échelle de la microseconde en environ 26 millisecondes.

Fermer la boucle avec la vision et des mises à jour rapides

La vitesse seule ne suffit pas ; le piège doit aussi s’adapter lorsque l’environnement change de façon inattendue. Pour le démontrer, l’équipe construit un système de contrôle en boucle fermée. Des caméras stéréo surveillent une petite bille en polystyrène maintenue en suspension par le piège acoustique à l’intérieur de la chambre mobile. Quand la bille s’écarte de sa cible au-delà d’un seuil fixé, le système ajuste la position cible, transmet les coordonnées mises à jour et la pose de la chambre au modèle d’apprentissage, et rafraîchit rapidement le motif de phase pilotant la matrice. Dans les expériences, le système peut mettre à jour le motif de phase jusqu’à 15 fois par seconde, guidant la bille le long de trajectoires en H, K et U avec une erreur moyenne d’environ 1 millimètre — comparable à la précision de positionnement de certains systèmes cliniques d’ultrasons focalisés. Le même principe de rétroaction réduit également le temps durant lequel la bille s’éloigne de son emplacement souhaité lorsque la chambre bouge, montrant que la boucle de contrôle peut compenser le mouvement et les effets non modélisés du film plastique et de la structure de support.

Ce que cela signifie pour les traitements futurs

Pour un non-spécialiste, le message clé est que les chercheurs ont mis au point une sorte de « faisceau tracteur » télécommandé et sans contact qui pourrait, un jour, stationner des bulles chargées de médicaments près d’une tumeur et les y maintenir, même si le patient respire. Leur modèle d’apprentissage remplace des simulations lourdes par un prédicteur rapide, tandis que des caméras (et à terme des marqueurs IRM) informent le système des mouvements du corps afin que le piège puisse être réajusté en temps réel. Bien que le travail présent utilise de l’air, des gaz et du plastique plutôt que de vrais tissus, et qu’il lévite une bille en plastique au lieu de véritables microbulles, il démontre un contrôle en temps réel dans un milieu stratifié et mobile. Avec du matériel plus puissant, des fréquences ultrasonores plus élevées et un suivi de mouvement basé sur l’IRM, cette approche pourrait évoluer vers un outil clinique pour des thérapies ultrasonores assistées par robot et guidées par IRM, permettant d’administrer des médicaments de façon plus précise et plus sûre en profondeur dans le corps.

Citation: Wu, M., Li, X. & Tang, T. Machine learning-facilitated real-time acoustic trapping in time-varying multi-medium environments toward magnetic resonance imaging-guided microbubble manipulation. Commun Eng 5, 52 (2026). https://doi.org/10.1038/s44172-026-00600-z

Mots-clés: piégeage acoustique, thérapie guidée par IRM, libération de médicaments par microbulles, apprentissage automatique en échographie, manipulation robotisée non invasive