Clear Sky Science · fr

Inférence basée sur la simulation pour une physique des neutrinos de précision via l'ajustement Monte Carlo neuronal

Affiner le regard des télescopes à neutrinos

Les futures expériences sur les neutrinos visent à répondre à de grandes questions sur l’univers, comme l’ordre des masses des neutrinos et le mécanisme d’explosion des étoiles. Pour cela, leurs détecteurs gigantesques doivent mesurer l’énergie avec une précision remarquable — bien au-delà de ce que de simples formules de manuel permettent. Cet article montre comment des outils modernes d’apprentissage automatique peuvent aider à ajuster et valider les simulations complexes qui relient ce qui se passe à l’intérieur d’un détecteur aux éclairs de lumière que nous enregistrons réellement.

Pourquoi il est si difficile de comprendre la réponse du détecteur

Dans des expériences comme le Jiangmen Underground Neutrino Observatory (JUNO) en Chine, les neutrinos interagissent dans un vaste réservoir de liquide qui produit de la lumière lorsque des particules le traversent. Cette lumière est collectée par des milliers de photomultiplicateurs sous forme de minuscules impulsions électriques, comptées en « photo-électrons ». Le défi est de reconstituer à partir de ces comptes l’énergie initiale de la particule. En réalité, cette relation n’est pas une droite parfaite : elle dépend de la géométrie du détecteur, du comportement du liquide et de plusieurs effets physiques entremêlés. Les approches traditionnelles reposaient sur un réglage manuel des paramètres de la simulation jusqu’à obtenir des spectres simulés semblables aux données d’étalonnage, une méthode qui devient ingérable pour des expériences modernes à haute précision.

Apprendre aux réseaux neuronaux à émuler le simulateur

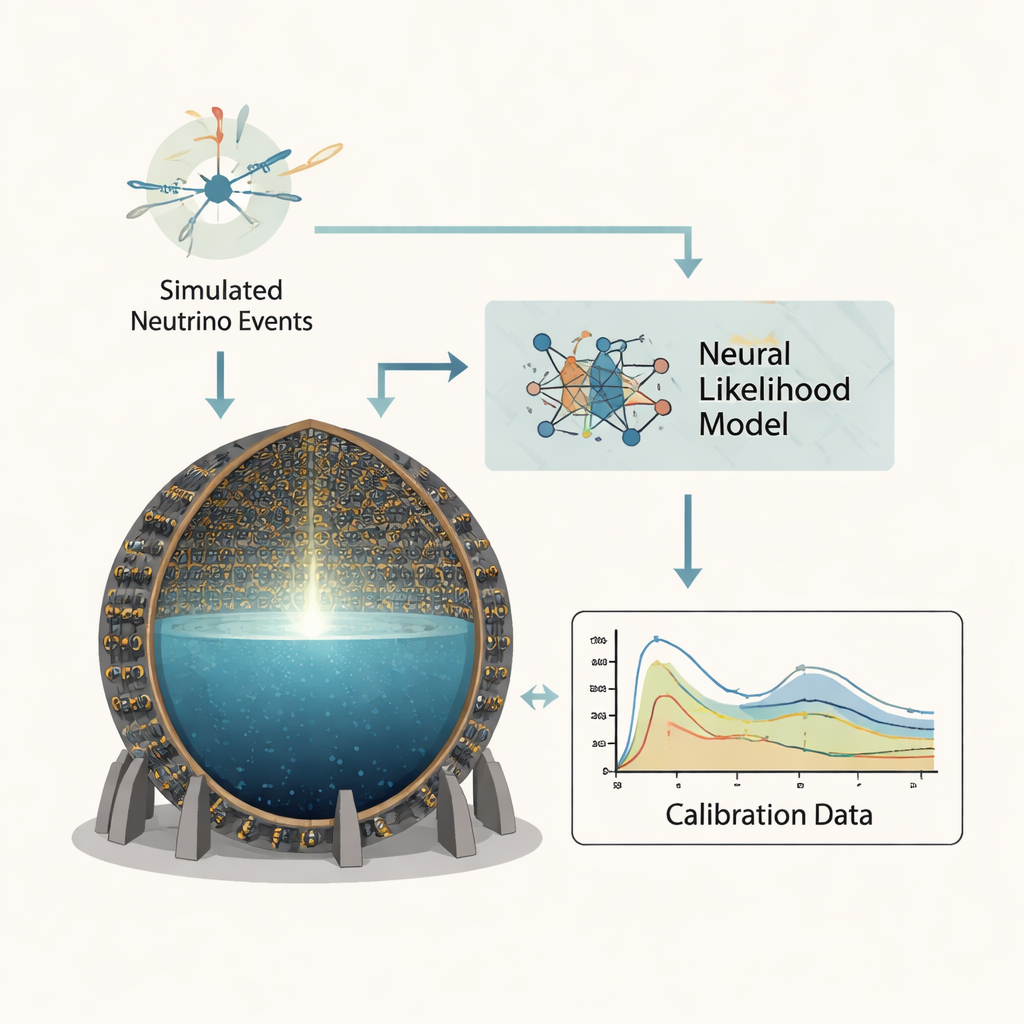

Les auteurs adoptent une stratégie connue sous le nom d’inférence basée sur la simulation : au lieu d’essayer d’écrire une formule mathématique exacte pour la réponse du détecteur, ils laissent les simulations et les réseaux neuronaux faire le travail lourd. Ils se concentrent sur trois paramètres clés qui gouvernent la conversion de l’énergie vraie en lumière détectée par JUNO : un coefficient décrivant la « quenching » (réduction) de la production de lumière à haute densité d’ionisation, un rendement lumineux global fixant la luminosité moyenne, et un facteur contrôlant la quantité de lumière de Cherenkov. En utilisant le logiciel Monte Carlo officiel de JUNO, ils génèrent environ un milliard d’événements d’étalonnage simulés provenant de cinq sources radioactives placées au centre du détecteur, chaque événement résumé par un seul nombre : la lumière totale collectée. Cela constitue le terrain d’entraînement pour des réseaux neuronaux qui apprennent la vraisemblance d’un signal lumineux donné pour n’importe quel choix des trois paramètres.

Deux lentilles d’apprentissage automatique complémentaires

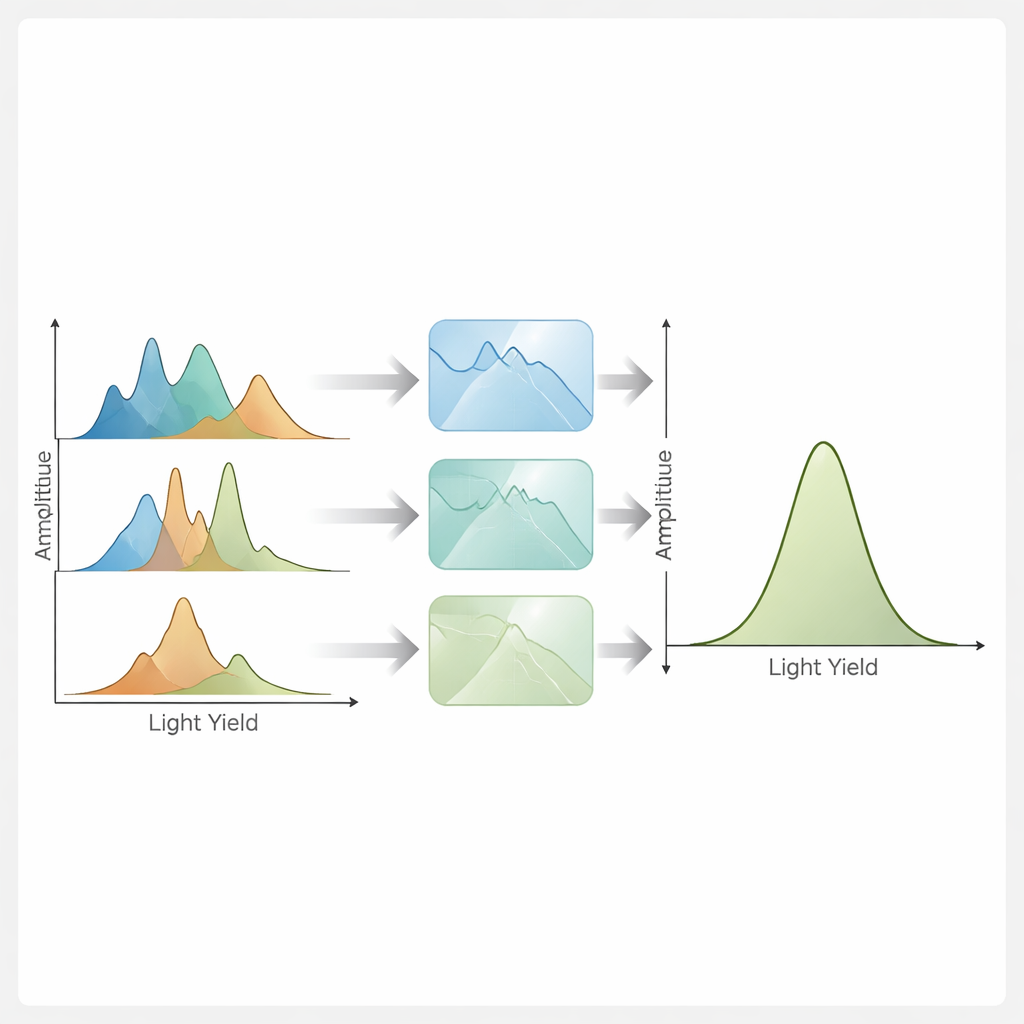

L’équipe développe deux « estimateurs de vraisemblance » neuronaux complémentaires qui approchent la probabilité d’observer un signal lumineux donné pour des réglages spécifiques du détecteur. Le premier, appelé Transformer Encoder Density Estimator, utilise une architecture de type transformer — la même famille de modèles derrière de nombreux outils linguistiques — pour prédire directement un histogramme finement binned du spectre lumineux pour chaque combinaison de paramètres et de source. Cela soutient naturellement les analyses statistiques traditionnelles en classes. Le second, appelé Normalizing Flows Density Estimator, utilise une chaîne de transformations inversibles pour cartographier les spectres compliqués à plusieurs pics en une distribution simple en cloche. Parce que ces transformations sont mathématiquement contrôlées, la méthode peut évaluer la probabilité exacte pour chaque événement non binned, permettant des analyses qui exploitent toute l’information contenue dans les données.

Vérifier exactitude, précision et robustesse

Pour démontrer la fiabilité de ces outils neuronaux, les auteurs les soumettent à des tests rigoureux. D’abord, ils vérifient si les modèles peuvent reproduire les spectres simulés sur des milliers de combinaisons des trois paramètres, en utilisant plusieurs distances statistiques qui comparent distributions prédites et « vraies ». Les deux méthodes suivent extrêmement bien les pics nets et les caractéristiques spectrales subtiles, avec des écarts à l’échelle de quelques pour mille. Ensuite, ils branchent les vraisemblances apprises dans des moteurs statistiques établis — échantillonnage nested bayésien, Monte Carlo par chaînes de Markov et minimisation classique — pour retrouver les paramètres originaux de la simulation à partir de jeux de données factices. Sur une large plage de valeurs de paramètres et de statistiques d’événements, les paramètres récupérés sont non biaisés et leurs incertitudes annoncées correspondent à la dispersion réelle des résultats. Les incertitudes diminuent avec plus de données exactement comme prévu par la statistique élémentaire des comptages, et les méthodes capturent fidèlement les fortes corrélations entre paramètres.

De mois de calcul à quelques secondes

Un résultat marquant est l’accélération informatique. Faire tourner des simulations complètes du détecteur avec suffisamment d’événements pour caractériser chaque point de paramètre peut prendre de nombreuses heures par réglage sur un processeur conventionnel. Une fois entraîné, toutefois, le modèle transformer peut générer un spectre prédit en quelques millisecondes, et le modèle par flots normalisants peut évaluer des probabilités pour des dizaines de milliers d’événements en bien moins d’un dixième de seconde. Cela rend réaliste l’exploration de grands espaces de paramètres et la quantification d’incertitudes systémiques qui seraient autrement prohibitivement coûteuses, ouvrant la voie à des calibrations de détecteurs plus détaillées et plus fiables.

Ce que cela signifie pour les futures expériences sur les neutrinos

Pour les non-spécialistes, le message central est que ce travail transforme des simulations de détecteur compliquées et lentes en substituts rapides et précis sans sacrifier le sens physique. Les trois paramètres ajustés correspondent toujours directement à des propriétés réelles du détecteur et de son liquide, de sorte que les résultats restent interprétables par les physiciens. L’étude montre que les deux approches neuronales peuvent déterminer ces paramètres avec des biais extrêmement faibles et des erreurs limitées principalement par la quantité de données disponible. Alors que des expériences à venir telles que JUNO, DUNE et Hyper-Kamiokande visent une précision subpourcent sur les mesures de neutrinos, des méthodes comme celles-ci seront essentielles pour garantir que ce que nous inférons sur l’univers ne soit pas limité par notre compréhension des détecteurs.

Citation: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Mots-clés: détecteurs de neutrinos, apprentissage automatique, ajustement Monte Carlo, flots normalisants, inférence basée sur la simulation