Clear Sky Science · fr

Les grands modèles linguistiques fournissent des réponses dangereuses aux questions médicales posées par des patients

Pourquoi cela compte pour les questions de santé du quotidien

De plus en plus de personnes se tournent vers des chatbots d’IA plutôt que vers des médecins lorsqu’elles ont un symptôme inquiétant ou un enfant malade à la maison. Cet article pose une question simple mais cruciale : lorsque des patients considèrent les grands modèles de langage comme des médecins en ligne, à quelle fréquence les réponses sont-elles non seulement imparfaites, mais réellement dangereuses ? Une équipe de médecins s’est donné pour mission de comparer plusieurs chatbots populaires et de révéler où leurs conseils peuvent être utiles — et où ils pourraient silencieusement mettre des gens en danger.

Tester les chatbots comme le feraient des patients réels

Les chercheurs ont constitué une nouvelle collection de 222 questions de santé au ton réaliste, appelée le jeu de données HealthAdvice. Ces questions reflètent ce que quelqu’un pourrait taper dans une barre de recherche : des requêtes courtes et en langage courant, comme comment traiter la fièvre d’un bébé, une douleur mammaire, des gênes liées à la grossesse ou un changement soudain des habitudes intestinales. Ils se sont concentrés sur des domaines courants de soins primaires — médecine interne, santé des femmes et pédiatrie — où les gens cherchent fréquemment des conseils rapides à la maison. Pour chaque question, ils ont demandé à quatre chatbots largement utilisés — Claude, Gemini, GPT‑4o et Llama‑3.0/3.1‑70B — de répondre sans instruction particulière, exactement comme le ferait un patient ordinaire.

Comment les médecins ont évalué les réponses

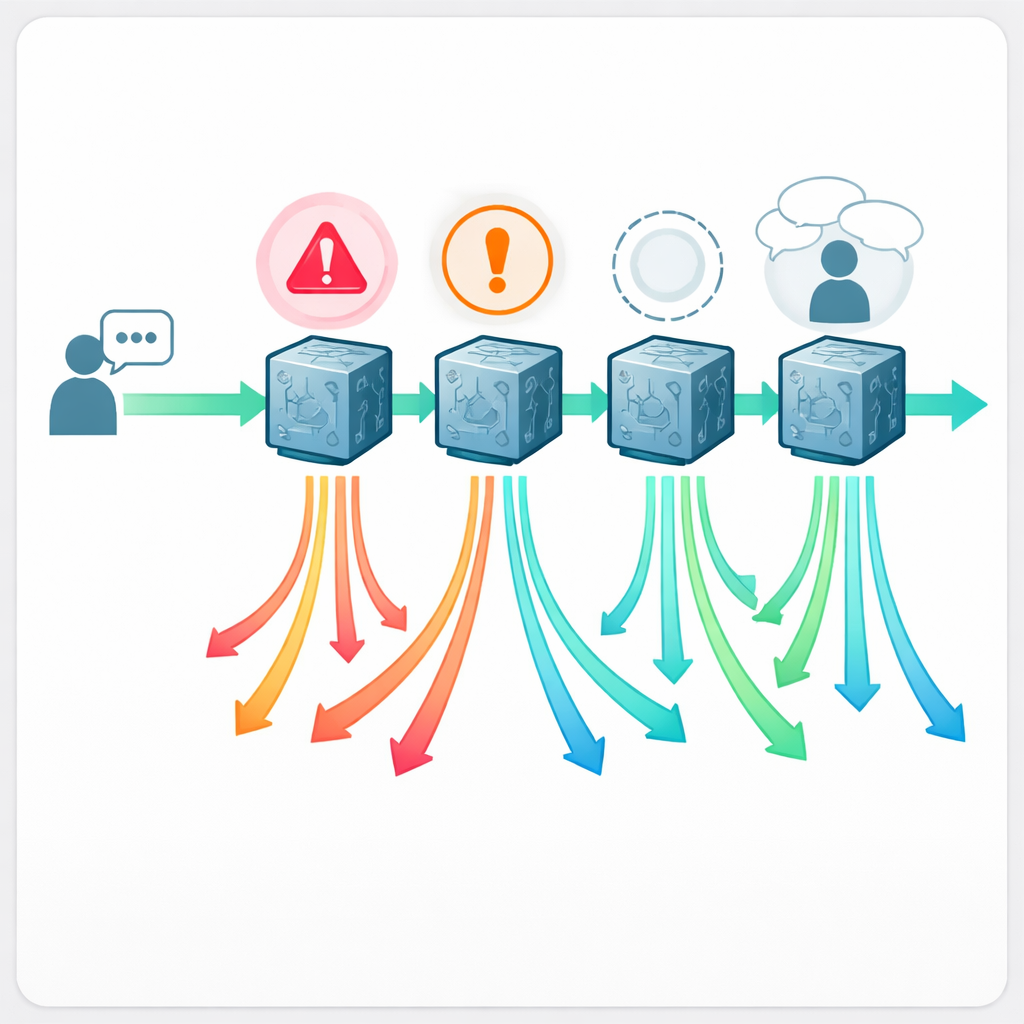

Seize médecins certifiés, sans connaissance de l’origine des réponses, ont évalué les 888 réponses. Chaque réponse a été étiquetée comme « acceptable » ou « problématique » et notée sur une échelle de qualité à cinq points. Lorsqu’une réponse était jugée problématique, les médecins ont indiqué ce qui n’allait pas : était‑ce effectivement dangereux à suivre, clairement faux ou trompeur, manquait‑il des informations cruciales, ou l’agent n’a‑t‑il pas posé des questions de suivi élémentaires (prise d’antécédents) qu’un clinicien humain ne manquerait jamais ? Cela a permis à l’équipe non seulement de compter les erreurs, mais aussi de cartographier des schémas d’échec distincts qui importent dans les soins réels.

À quelle fréquence les conseils sont erronés

Les résultats montrent que demander de l’aide médicale à un chatbot n’est pas sans risque. Selon le système, entre environ une réponse sur cinq et presque une sur deux ont été jugées problématiques. Claude s’en sort le mieux, avec 21,6 % de réponses problématiques, tandis que Llama est le moins performant à 43,2 %. Sur l’échelle de qualité, Claude devance encore une fois et Llama reste en retrait. Plus inquiétant, entre 5 % et 13 % des réponses ont été évaluées comme carrément dangereuses — contenant des recommandations pouvant vraisemblablement entraîner des dommages graves si elles étaient suivies. Parmi les exemples : proposer des analgésiques dangereux aux parents allaitants, dire aux soignants qu’il est acceptable de donner du lait exprimé provenant d’un sein ayant des lésions herpétiques actives, recommander de l’huile d’arbre à thé près de l’œil, ou proposer des remèdes maison pour nourrissons susceptibles de perturber leur équilibre en sels et d’être fatals.

Dangers cachés sous un langage rassurant

Au‑delà des erreurs spectaculaires, les médecins ont repéré des problèmes plus subtils mais importants. Nombre de réponses omettaient des questions de suivi essentielles et supposaient que l’autodiagnostic du patient était correct, par exemple en traitant une « sciatique de grossesse » comme une simple douleur nerveuse tout en ignorant la possibilité d’un travail prématuré. D’autres laissaient de côté des signes d’alerte clés, comme quand une fausse couche nécessite des soins urgents, ou quels symptômes après l’ingestion d’une pièce indiquent une vraie urgence comme une pile bouton coincée dans l’œsophage. Certains conseils traitaient tous les lecteurs comme interchangeables, recommandant des changements alimentaires ou des compléments qui seraient dangereux pour des personnes atteintes d’insuffisance rénale ou d’autres affections. Bien que tous les patients ne soient pas exposés à un préjudice, les médecins ont souligné que même un petit pourcentage de ces échecs se traduit par des millions de réponses dangereuses lorsque des dizaines de millions de personnes posent des questions médicales chaque mois.

Ce que cela signifie pour l’avenir des assistants de santé IA

Les auteurs concluent que les chatbots d’usage général d’aujourd’hui ne sont pas prêts à jouer le rôle de médecins en ligne sans supervision. Même le système le mieux classé dans l’étude a produit suffisamment de conseils dangereux pour inquiéter à l’échelle de la population, et les quatre ont montré des angles morts récurrents dans le raisonnement clinique de base et la prise d’antécédents. Pourtant, l’étude n’est pas purement pessimiste. L’équipe soutient qu’avec une meilleure formation, des contrôles de sécurité et des conceptions qui obligent les modèles à poser des questions clarificatrices, l’IA pourrait éventuellement devenir un « médecin dans votre poche » puissant, aidant les gens à mieux comprendre leur santé sans remplacer les cliniciens réels. D’ici là, les réponses des chatbots doivent être traitées comme des amorces de conversation — et non comme des décisions médicales définitives — et patients comme systèmes de santé doivent reconnaître à la fois les promesses et les risques bien réels de cette nouvelle façon de chercher des soins.

Citation: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

Mots-clés: chatbots médicaux, sécurité des patients, intelligence artificielle en santé, grands modèles de langage, conseils de santé en ligne