Clear Sky Science · fr

Réglage d’invite visuelle guidé par l’anatomie pour une compréhension multimodale du cancer du sein

Dépistage plus intelligent pour un cancer fréquent

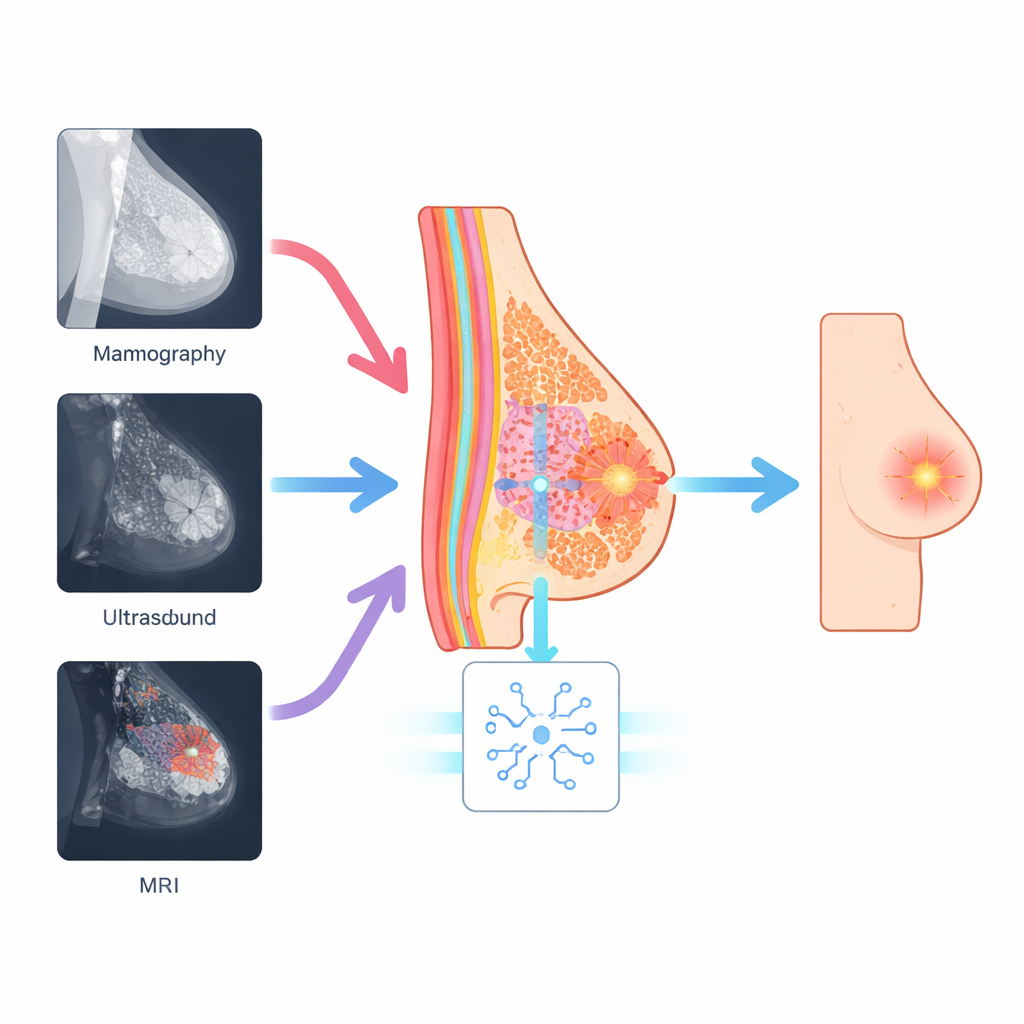

Le cancer du sein est l’une des principales causes de mortalité par cancer chez les femmes, et les médecins s’appuient de plus en plus sur des programmes informatiques pour aider à lire des images médicales complexes. Mais les mammographies, les échographies et les images par IRM présentent le sein de façons très différentes, ce qui rend difficile pour les systèmes d’intelligence artificielle actuels de rester fiables entre appareils et établissements. Cette étude présente une nouvelle approche d’IA qui « pense » l’anatomie sous-jacente du sein plutôt que de ne se fier qu’aux motifs de luminosité de chaque image, conduisant à une détection des zones suspectes à la fois plus précise et plus cohérente.

Pourquoi les différents examens embrouillent les ordinateurs

La mammographie, l’échographie et l’IRM s’appuient chacune sur des principes physiques distincts pour sonder l’intérieur du sein. Un cancer qui apparaît comme un point lumineux sur une image échographique peut se manifester comme une ombre subtile sur une mammographie ou comme une zone brillante en IRM. De nombreux systèmes d’IA modernes, y compris les puissants transformeurs visuels et modèles vision–langage, apprennent principalement à partir de l’apparence globale des images. Ils manquent souvent de détails minuscules mais importants, comme les microcalcifications ou les contours irréguliers, et leurs performances peuvent chuter fortement lorsqu’on les déplace d’un type d’appareil ou d’un hôpital à un autre. Cet écart entre les conditions d’entraînement et la clinique réelle limite la confiance que les médecins peuvent accorder à ces outils.

Utiliser le sein lui‑même comme guide

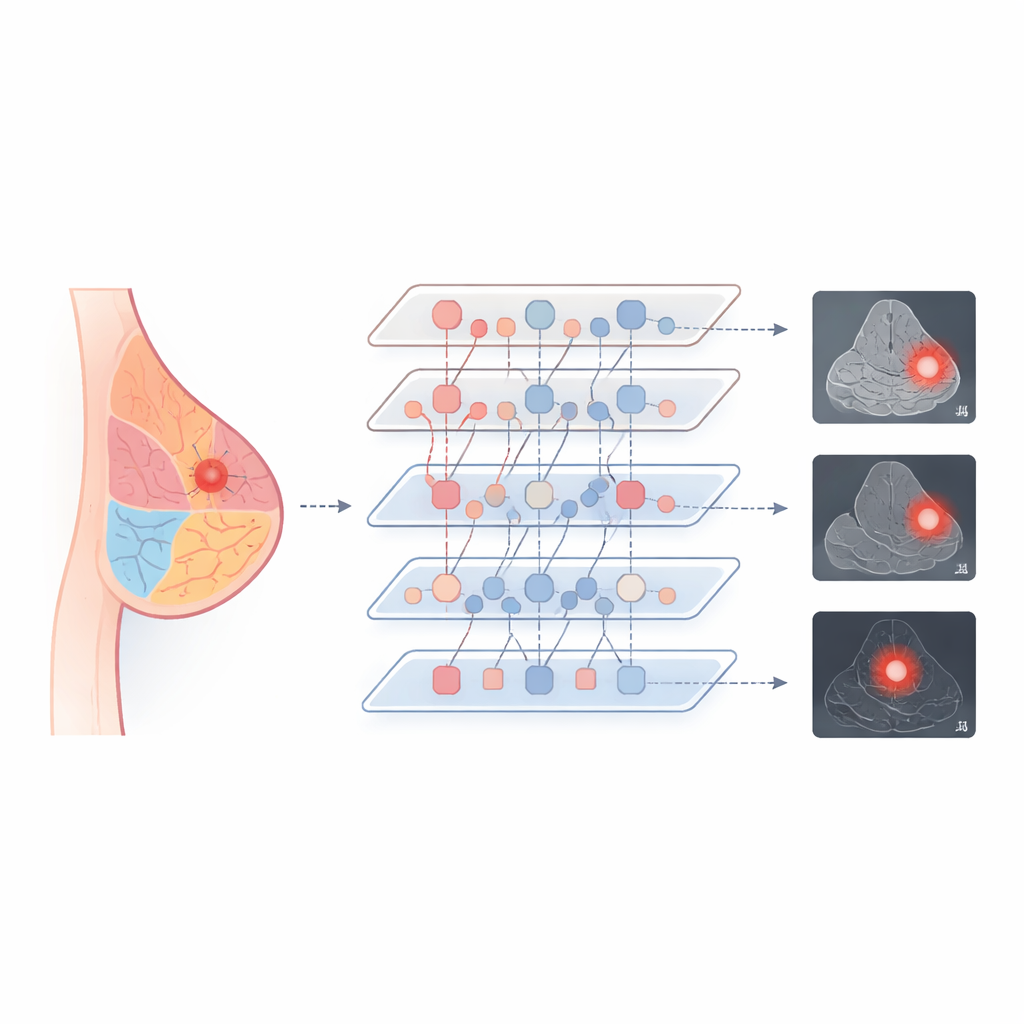

Les chercheurs soutiennent que, même si les images paraissent différentes, la biologie réelle du sein ne change pas entre les examens. Chaque image contient toujours du tissu glandulaire, de la graisse et des conduits disposés selon un schéma reconnaissable. Leur méthode, appelée Anatomy-Guided Visual Prompt Tuning (A-VPT), intègre cette carte anatomique de base directement dans le modèle d’IA. Plutôt que d’ajuster des millions de poids internes, le système ajoute un petit ensemble de signaux « d’invite » qui indiquent au réseau quelles régions tissulaires il observe. Ces invites sont générées à partir de cartes anatomiques grossières ou d’indices tissulaires appris, puis injectées couche par couche dans un transformeur pré-entraîné et gelé. En pratique, le modèle est constamment rappelé de l’emplacement des conduits, des glandes et de la graisse, ce qui lui permet d’évaluer les zones suspectes dans le bon contexte.

Apprendre à un seul système à parler plusieurs langages d’imagerie

Pour faire fonctionner le modèle sur plusieurs modalités, l’équipe a conçu un schéma d’entraînement qui oblige l’IA à traiter de façon similaire des tissus semblables, quel que soit le mode d’imagerie. Ils alignent les empreintes internes des régions graisseuses, glandulaires et canalaires extraites de la mammographie, de l’échographie et de l’IRM, en les rapprochant dans un espace partagé. Lorsque des comptes rendus textuels sont disponibles, le système relie aussi ces motifs tissulaires à de courtes phrases descriptives, associant ainsi des caractéristiques visuelles au langage médical. Lors du traitement, des modules d’interaction spécialisés permettent aux invites anatomiques et aux caractéristiques d’image d’échanger des informations dans les deux sens, avec une étape de verrouillage (gating) qui contrôle l’intensité de l’influence de l’anatomie à chaque couche. Cette combinaison aide le modèle à se concentrer sur les structures pertinentes tout en restant stable et efficace.

Meilleure précision avec une intervention plus légère

Les auteurs ont testé A-VPT sur trois collections bien connues d’imagerie mammaire couvrant les trois modalités. Comparée aux réseaux profonds traditionnels et à plusieurs façons populaires d’ajuster des modèles de grande taille, leur méthode a obtenu les meilleurs scores tant pour la classification des lésions en bénignes ou malignes que pour le tracé de leurs contours. Elle a particulièrement bien performé lorsqu’il s’agissait d’utiliser la connaissance d’un type d’examen pour interpréter un autre — par exemple, entraînement sur des mammographies puis évaluation sur échographies — là où les méthodes antérieures échouaient souvent. Fait remarquable, A-VPT a obtenu ces résultats tout en mettant à jour moins de 2 % des paramètres du modèle, ce qui réduit les besoins de calcul et facilite le déploiement dans de vrais hôpitaux. Les visualisations des zones où le modèle « regardait » montrent qu’il se concentrait sur des régions glandulaires et péritumorales réalistes, suggérant que ses décisions correspondent au raisonnement des radiologues.

Ce que cela signifie pour les patientes et les cliniques

En termes simples, ce travail montre que l’enseignement de l’anatomie de base aux systèmes d’IA peut les rendre à la fois plus intelligents et plus compréhensibles. En ancrant son raisonnement sur la structure réelle du sein, A-VPT est meilleur pour repérer et délimiter les tumeurs à travers différentes méthodes d’imagerie, avec moins d’ajustements et un comportement plus transparent. Si cette stratégie est validée plus avant, elle pourrait soutenir un dépistage et un diagnostic plus cohérents dans des contextes variés, des grands centres médicaux aux petites cliniques, et être étendue à d’autres organes tels que le poumon ou le foie. En définitive, une IA sensible à l’anatomie pourrait devenir un partenaire clé pour une détection du cancer plus précoce et plus fiable.

Citation: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Mots-clés: imagerie du cancer du sein, IA médicale, transformeurs visuels, apprentissage cross-modal, prompts guidés par l’anatomie