Clear Sky Science · fr

Performance indépendante et collaborative des grands modèles de langage et des professionnels de santé en diagnostic et en triage

Pourquoi cela compte pour votre prochaine visite chez le médecin

Lorsque vous saisissez vos symptômes dans un chatbot en ligne ou demandez à une application d’IA ce qui pourrait clocher, vous utilisez le même type de technologie que les médecins commencent à tester à l’hôpital : les grands modèles de langage, ou GML. Cette étude pose une question simple mais essentielle : dans quelle mesure ces outils diagnostiquent-ils réellement les maladies et évaluent-ils l’urgence d’un cas, comparés aux professionnels de santé — et que se passe-t-il lorsque les deux travaillent ensemble ?

Comment les chercheurs ont pris du recul

Les auteurs n’ont pas testé un seul chatbot dans une seule clinique. Ils ont plutôt rassemblé des preuves issues de 50 études distinctes menées dans le monde entre 2020 et 2025. Ces études couvraient de nombreuses spécialités, des maladies oculaires aux scanners cérébraux en passant par les soins d’urgence. Dans chacune, des médecins et un ou plusieurs GML ont reçu les mêmes descriptions de cas patients réels ou soigneusement conçus. Les GML devaient proposer des diagnostics possibles ou décider de la rapidité avec laquelle un patient nécessitait des soins, tandis que les médecins faisaient de même. Dans certaines études, les médecins ont également vu les suggestions de l’IA pour vérifier si cela améliorait leurs performances.

Que valent les systèmes d’IA seuls ?

Sur l’ensemble des études, les outils d’IA pouvaient souvent inclure le bon diagnostic quelque part dans leur liste, mais ils restaient généralement moins performants que les médecins lorsqu’on les obligeait à choisir une seule réponse. Lorsque seule la première proposition était prise en compte, les GML étaient en moyenne environ 11 % moins précis que les professionnels de santé. À mesure que la liste des réponses autorisées s’allongeait, cet écart diminuait et finissait par disparaître — dès que dix diagnostics possibles étaient admis, les systèmes d’IA étaient au moins aussi susceptibles que les médecins d’inclure la bonne réponse. Pour les décisions de triage — juger l’urgence d’un cas et le niveau de soins requis — les performances de l’IA et des humains étaient globalement similaires. Toutefois, les résultats variaient fortement selon les modèles et les protocoles de test, ce qui laisse entendre que certains outils sont bien plus fiables que d’autres.

Que se passe-t-il quand les médecins utilisent l’IA comme coéquipier ?

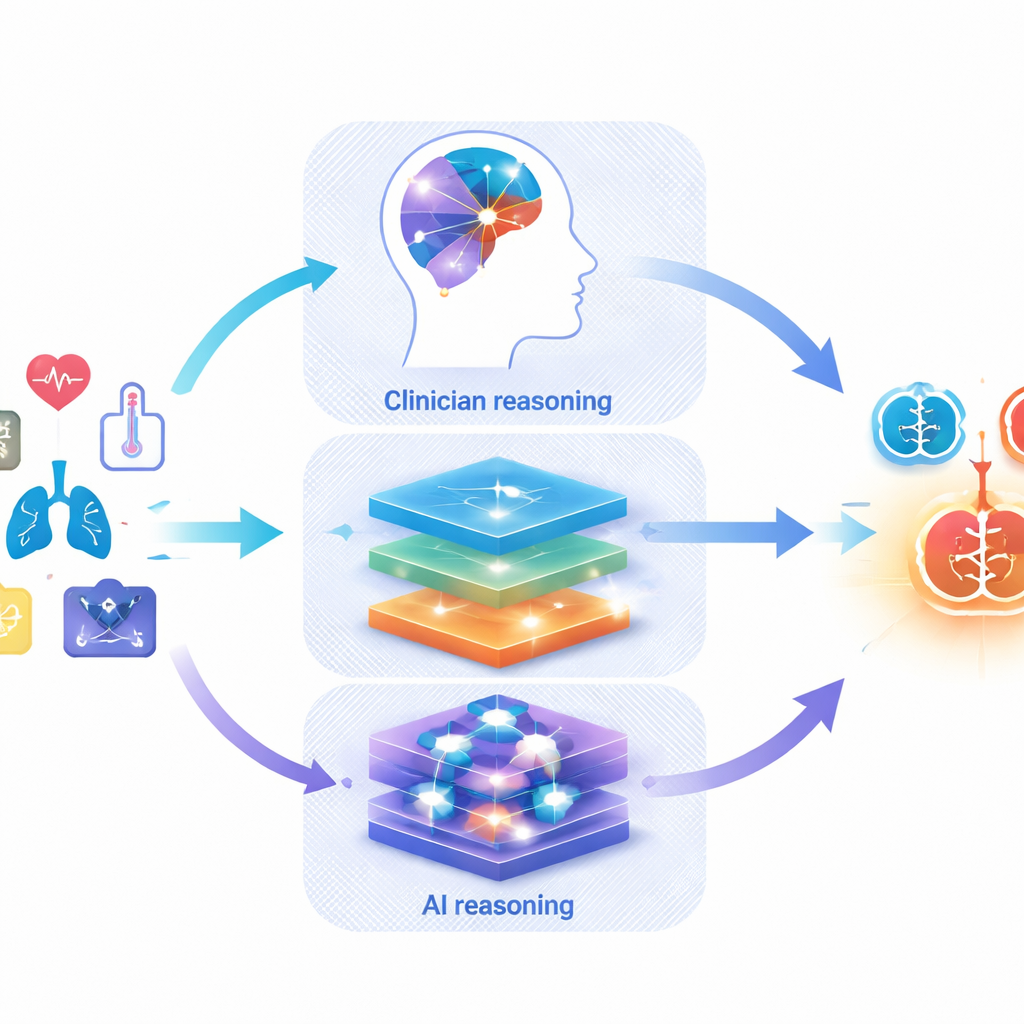

Neuf études ont examiné directement la collaboration : les médecins ont d’abord travaillé seuls, puis ont répété la tâche avec l’aide d’un GML. Les résultats sont encourageants. Avec le soutien de l’IA, les médecins étaient globalement plus précis, en particulier lorsqu’ils pouvaient fournir plusieurs diagnostics possibles. Par exemple, avec l’aide d’un GML, leur précision sur des listes courtes de candidats s’est améliorée d’environ 10 à 40 %, selon le nombre d’options considéré. Cela suggère que l’IA est particulièrement utile comme partenaire de réflexion, élargissant l’éventail des possibilités et incitant les cliniciens à considérer des affections moins évidentes, tandis que l’expert humain conserve la décision finale.

Pourquoi les résultats d’aujourd’hui peuvent sembler meilleurs que la réalité

Malgré des chiffres prometteurs, les auteurs avertissent que la plupart des études existantes sont loin d’être parfaites. Beaucoup s’appuyaient sur des résumés de cas propres, au format manuel, ou sur des cas rares choisis à des fins pédagogiques, et non sur les histoires désordonnées et incomplètes que présentent les patients en consultation. Seules quelques études utilisaient des patients en temps réel. Les détails sur la sélection des cas, la configuration des outils d’IA et l’évaluation des réponses faisaient souvent défaut. Les informations visuelles, telles que les images d’examens ou les photos de peau, ont été moins utilisées, et lorsqu’on a testé les images seules, les cliniciens expérimentés surpassaient nettement l’IA. Les chercheurs soulignent aussi que les cliniciens juniors et les experts peuvent réagir différemment aux conseils de l’IA, et que des enjeux comme la confidentialité des données, les biais cachés et la confiance excessive envers les suggestions machine restent largement non évalués dans la pratique quotidienne.

Ce que cela signifie pour les patients et l’avenir des soins

Dans l’ensemble, l’étude suggère que les chatbots et GML actuels ne sont pas prêts à remplacer votre médecin, mais qu’ils pourraient bientôt devenir des assistants précieux. Utilisés judicieusement, ils peuvent aider à générer des listes plus larges de diagnostics possibles et soutenir une prise de décision plus précise, surtout si les médecins restent aux commandes et considèrent l’IA comme un second avis plutôt que comme un verdict définitif. Avant que ces outils ne soient intégrés de façon routinière aux soins, les auteurs estiment cependant qu’il faut des essais en conditions réelles mieux conçus, des normes de reporting plus claires et des garanties solides en matière de sécurité, d’équité et de confidentialité. Pour les patients, cela signifie que l’IA pourrait finalement aider votre équipe soignante à penser plus largement et à agir plus rapidement, mais qu’un système digne de confiance doit être testé aussi rigoureusement qu’un nouveau médicament ou un dispositif médical.

Citation: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Mots-clés: diagnostic médical IA, triage clinique, grands modèles de langage, collaboration médecin IA, sécurité en santé numérique